Entropia e Complexidade

Aula 1

• Qual a engrenagem fundamental do

universo?

Entropia

• O que é entropia?

Entropia

• Probabilidade

• Postulado fundamental da Mecânica

estatística.

S = Kbln()

• Relação entre probabilidade e Entropia

Entropia

• Segunda lei da termodinâmica

– "Não ocorrem processos nos quais a entropia do

sistema ISOLADO decresça: em qualquer

processo que tenha lugar em um sistema

isolado, a entropia do sistema AUMENTA ou

permanece CONSTANTE".

– Em outras palavras, um sistema isolado, sem

nenhuma ajuda exterior, é incapaz de se autoestruturar.

Entropia e Equilíbrio

• Equilíbrio mecânico, químico, hidrostático, térmico e

termodinâmico.

• Um estado de equilíbrio será aquele, em que, pelo

menos, localmente a entropia seja máxima.

• Um sistema que esteja em estado de equilíbrio está em

um estado estável. Contudo existem os estados metaestáveis

Meta-estabilidade

• Exemplo da cerveja no congelador

• Meta-estabilidade e a vida

• Entropia e vida

Meta-balanceamento

• Comportamentos muito

organizados surgem em sistemas

de extrema complexidade. Ex.:

organismos vivos

• Bilhões de células interagem

apresentando um comportamento

notavelmente organizado.

• São sistemas meta-balanceados

Meta-balanceamento

• O sistema está desbalanceado localmente

e estável e ordenado em uma perpectiva

global.

• Sistema balanceado=sem gasto de

energia

• Sistema desbalanceado = gasto de

energia e termaliza

• Sistema meta-balanceado necessita

continuamente de energia

Complexidade e Sistemas

Complexos

Temas

• O que é complexidade?

• Discutir a complexidade como um paradigma

epistemológico.

• Delimitar complexidade e sistemas complexos.

• Listar características de um sistema complexo.

Algumas visões sobre a

complexidade

• MAÍRA BAUMGARTEN (sociologia)

“...que estaria a mudar não só a nossa

imagem mecanicista da natureza mas,

inclusive, a nossa relação com ela e o

modo de fazer ciência, numa aproximação

mais qualitativa, menos agressiva e mais

humana.”

complexidade

• Complexidade e subjetividade

• González Rey (Psicólogo)

• “Hemos utilizado el concepto de subjetividad social

precisamente para dar cuenta de la complejidad

constituida en cada uno de los sentidos subjetivos de la

vida social, aspecto que con frecuencia se subordina a

aspectos económicos, políticos o de otra naturaleza, sin

comprender que aquellos actuan sobre la población en

dependencia de su sentido subjetivo, no como "cosa en

sí". La multiplicidad de niveles y de escenarios de la vida

social determina el desarrollo de múltiples elementos de

sentido que actuan simultáneamente en la acción social

del sujeto, quien constituye el escenario de su propio

desarrollo subjetivo.”

Complexidade

• Rita M.C. de Almeida (Física)

• “Na realidade, a Ciência da Complexidade

não é uma nova Ciência, mas sim novos

resultados para a mesma Ciência

Natural.”

Complexidade X Sistemas

complexos.

• Complexidade: Paradigma epistemológico

• Sistemas Complexos: Objeto de estudo da

complexidade. Uma disciplina científica

(Puramente interdisciplinar).

Complexidade na Física.

• Normalmente utilizado como um atributo

• Quanto maior a quantidade de informação

necessária para descrevê-lo mais

complexo será o sistema.

C ln()

A complexidade pode ser

definida como o um conjunto

de propriedades que

emergem de um sistema com

muitos constituintes.

Sistemas Complexos

• Basicamente todos as definições na literatura escapam

de uma definição formal, indo na direção de uma

listagem de características, não fugiremos à regra:

• Contém muitos constituintes interagindo nãolinearmente

• Seus constituintes são independentes

• Possui uma estrutura que se repete em diversas escalas

• Exibe comportamento emergente

• Envolve um limiar entre caos e não-caos.

• Envolve um limiar entre cooperação e competição

• Uma outra forma de definir o conceito pode ser em

relação à quantidade de informação necessária para se

modelar um dado sistema.

Complexo x Simples

• A diferença entre complexo e simples não

é complicada.

ENTROPIA

• O que é isso mesmo?

Postulado fundamental da M.E. e

Conceitos de Macro e

Microestados

• Com o advento da teoria quântica nos primeiros anos do século

passado pessoas como Bose, Einstein, Fermi e Dirac introduziram

certas modificações nas idéias originais de Boltzmann e

conseguiram, com isso, esclarecer alguns aspectos insatisfatórios

da teoria de Boltzmann.

• Os princípios da mecânica quântica conduzem ao resultado de que

a energia de uma partícula sob um campo conservativo, como o

gravitacional, magnético ou elétrico, não podem assumir qualquer

valor continuamente, se diz que a energia é quantizada, ou seja, a

partícula só pode existir em alguns dos ESTADOS que têm uma

energia bem específica.

• Podemos utilizar como ilustração do conceito quântico o exemplo

clássico da onda estacionária em uma corda:

Postulado fundamental da M.E. e

Conceitos de Macro e

Microestados

• Nesse sistema os comprimentos de onda

possíveis são dados por:

1

i 2 L

ni

• Onde ni é um número inteiro que representa o

número de antinodos da vibração da corda.

• E o comprimento de onda da onda estacionária

está relacionado com o momento da partícula por:

p

• O que nos leva a:

pi

h

i

ni

h

2L

h

L

Postulado fundamental da M.E. e Conceitos

de Macro e Microestados

• Relembrando do conceito clássico introduzido por Boltzmann, não

existia restrições para a energia do sistema, ele poderia se encontrar

em qualquer valor, assim as média deveriam ser efetuadas sobre

todo o universo de parâmetros possíveis. No caso quântico não

poderemos fazer o mesmo, a contabilização dos estados acessíveis

é imprescindível para a operacionalização da estatística (valores

médios, desvios, etc.). Por exemplo, a menor energia possível

assumida pelo sistema, a que denominaremos E1, será dada para os

valores nx=ny=nz = 1, assim

3h 2

E1

8m L2

Postulado fundamental da M.E. e Conceitos

de Macro e Microestados

• Na determinação do segundo estado a coisa fica um pouco mais

complicada

Estado nx ny nz Energia

1

2 1 1 3h 2

4mL2

2

1 2 1

3h 2

4mL2

3

1 1 2

3h 2

4mL2

• Ou seja as três configurações terão o mesmo estado energético. A

isso chamamos de estado degenerado, ou seja, o estado referente a

energia é DEGENERADO e com DEGENERESCÊNCIA 3 (g2=3),

pois existem três configurações possíveis que levam a este mesmo

valor.

Postulado fundamental da M.E. e Conceitos

de Macro e Microestados

• Obviamente, não poderemos fazer estatística com apenas uma

partícula, assim que consideremos um sistema com N partículas

onde em cada estado de energia j teremos uma população de Nj

partículas, a energia total deste sistema será dada por:

U Ej N j

j

• De forma que, se conhecemos como estão distribuídas as partículas

sobre seus estados energéticos teremos toda a informação do

sistema. ESTE É O PROBLEMA CENTRAL DA MECÂNICA

ESTATÍSTICA.

Macro e Microestados

• Redefinindo o conceito de estado

• No esquema abaixo ilustramos o exemplo dado anteriormente em

um sistema com 11 partículas idênticas.

g3=3, N2=3

E3

(2,2,1)

(1,2,2)

(2,1,2)

g2=3, N2=5

E2

(2,1,1)

E1

(1,1,1)

(1,2,1)

(1,1,2)

g1=1, N1=3

• onde cada caixinha representa um estado energético. Estando as

caixas a mesma altura significa que têm a mesma energia.

• A energia deste sistema COM ESTA CONFIGURAÇÃO será dada

por:

2

2

2

E 3

3h

3h

9h

5

3

8m L2

4m L2

8m L2

Macro e Microestados

• Contudo vale ressaltar que ao trocar de caixa uma partícula, no

mesmo nível de energia, a configuração será diferente, contudo a

energia será a mesma! Desta forma, vem-se a necessidade de

subdividirmos o conceito de estado.

g3=3, N2=3

E3

(2,2,1)

(1,2,2)

(2,1,2)

g2=3, N2=5

E2

(2,1,1)

E1

(1,1,1)

(1,2,1)

(1,1,2)

g1=1, N1=3

3h 2

3h 2

9h 2

E 3

5

3

2

2

8m L

4m L

8m L2

Macro e Microestados

• Macroestado

• É caracterizado pelo número de partículas para cada nível. No

exemplo anterior temos: N1=3, N2=5 e N3=3.

• Microestado:

• Definido por cada nível e cada degenerescência. No exemplo

anterior temos.

Nível Nj gj

1

2

3

3

2

1

2

2

1

(1,1,1)

(2,1,1)

(1,2,1)

(1,1,2)

(2,2,1)

(2,1,2)

• Note que para uma mesma energia teremos diversos macroestados

e para cada macroestado pode conter uma infinidade de

microestados!!!

Postulado fundamental da M.E.:

• “Todo microestado possível de um sistema

isolado em equilíbrio é igualmente

provável”

• O que significa que se fazemos N réplicas de um conjunto de

sistemas (ensamble), e contamos a freqüência com que cada

microestado ocorre, obteremos que todo o microestado terá a

mesma freqüência!

Postulado fundamental da M.E.:

• O número de microestados igualmente prováveis, que corresponde a

um macroestado k é chamado de PROBABILIDADE

TERMODINÂMICA (Wk). Ou seja, quanto mais microestados tenha

um macroestado maior será sua probabilidade termodinâmica.

Funciona, exatamente como o exemplo do dado comentado

anteriormente, quanto mais possibilidades existam de que um evento

ocorra maior será a sua probabilidade.

• A Probabilidade termodinâmica de todo o ensamble será a soma de

todas as probabilidades termodinâmicas de cada macroestado.

( E,V , N ) WK

k

Postulado fundamental da M.E.:

• Assim que para uma mesma energia teremos diversos

macroestados e respectivamente diversos microestados. O valor de

energia mais provável será aquele que MAXIMIZE a quantidade de

configurações possíveis, ou seja, que maximize a probabilidade

termodinâmica.

• De fato a probabilidade termodinâmica do ensamble dependerá das

propriedades do sistema e dos vínculos internos que o configuram

(E,V,N,{Xi}).

• Logo, podemos concluir que a probabilidade de encontrarmos um

sistema no estado definido por (E,V,N,{Xi}) será:

P( E,V , N ,{X i }) (E,V , N ,{X i })

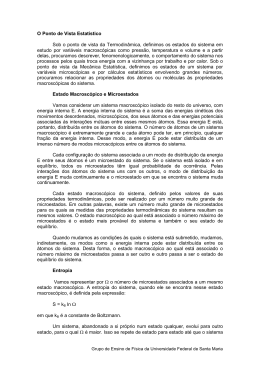

Interpretação estatística da entropia

A partir da lei de conservação da energia sabemos que:

S U PV N .

( 1)

Ou seja, S=f(U,V,N). Contudo sabemos a partir da teoria desenvolvida no item anterior

sobre a probabilidade termodinâmica que =f(U,V,N). De forma que podemos escrever

uma função J que estabeleça a ligação entre S e .

S J () .

( 2)

Sabemos que S é aditiva e é probabilística, logo:

S S1 S 2

1 2

( 3)

.

Desta forma a função J será dada por:

J (1 ) J (2 ) J (12 ) .

( 4)

Interpretação estatística da entropia

Derivando a relação anterior em relação a 1 temos:

dJ (1 ) dJ (1 2 ) dJ (1 2 ) d (1 2 )

d1

d1

d (1 2 ) d1 .

( 1)

O que nos leva a:

dJ (1 )

2 J (1 2 ) .

d1

( 2)

Fazendo o mesmo para 2 obtemos:

dJ ( 2 )

1 J (1 2 ) .

d 2

( 3)

Interpretação estatística da entropia

Comparando as equações anteriores temos

dJ ( 2 ) 1 dJ (1 ) 1

d1 2

d 2 1

( 1)

.

dJ (1 )

dJ ( 2 )

1

2

d1

d 2

Sendo 1 e 2 independentes esta equação só poderá ser satisfeita para

dJ ()

KB .

d

( 2)

Interpretação estatística da entropia

O que nos leva finalmente a

expressão para a função J.

S K B ln()

Que é a conhecida definição da entropia

de Boltzmann.

Agora eu pergunto:

O que é a entropia?

Entropia e informação

(Shanonn)

• Claude E. Shannon (1916-2001), "o pai da

teoria da informação".

• Estabeleceu um modo de determinar a

capacidade de um canal de comunicação

em termos de ocorrência de bits.

• Medida capaz de determinar a quantidade

de informação não previsível em uma

mensagem.

• H(p1, p2 ,..., pn ), a entropia de Shannon

aplicada para n elementos que compõem

uma mensagem.

• Pi = probabilidade de ocorrência do

elemento i da mensagem.

Entropia e informação

(Shanonn)

• Principais Postulados de Shannon

– 1- A função H deve ser contínua em pi.

– 2- Caso os elementos da mensagem sejam

igualmente prováveis, pi=1/n, então H deve

ser monotonicamente crescente em relação a

n, pois quanto mais elementos tenha a

mensagem maior será a capacidade de

transmissão de informação da mensagem.

– 3- Deve ser probabilisticamente somada

H(p1)+H(p2)=H(p1. p2)

n

H K pi log pi

i 1

b

1.2

1

0.8

H(p)

• Propriedades da função H:

• Para um sistema simples com

dois bits.

H p1 log p1 (1 p1 ) log(1 p1 )

2

2

• 1) H=0 se e somente se, todas

as probabilidades forem nulas

com exceção de uma.

• 2) Para um dado n, H será

máximo quando todas as pi

forrem iguais, ou seja, pi=1/n.

0.6

0.4

0.2

0

0

0.5

p

1

• Exercício:

• Calcule a entropia de Shannon para as

seguintes conjuntos de caracteres.

• 11111111

• 00001111

• 01111111

Baixar