CONTROLE HÍBRIDO DE POSIÇÃO-FORÇA PARA MANIPULAÇÃO ROBÓTICA COOPERATIVA BASEADO EM ESTIMAÇÃO DE FORÇA INDIRETA Rafael O. Faria, Antonio C. Leite, Fernando Lizarralde∗ ∗ Departamento de Engenharia Elétrica Universidade Federal do Rio de Janeiro - COPPE Caixa Postal 68504, CEP 21941-972 RJ, Rio de Janeiro, Brasil Email: [email protected], [email protected], [email protected] Resumo— Neste trabalho considera-se o problema de manipulação robótica cooperativa de objetos. O objetivo consiste em utilizar um sistema robótico com dois manipuladores e duas câmeras acopladas, para identificar visualmente a pose de um objeto localizado no espaço de trabalho para em seguida manipulá-lo de maneira segura e eficiente. Uma metodologia de controle hı́brido de posição e força é utilizada para combinar o controle de movimento e o controle da interação do efetuador com o objeto, a fim de garantir uma preensão adequada durante a execução da tarefa de manipulação. Além disso, um método de medição de força indireta é proposto para estimar as forças externas aplicadas ao efetuador a partir do torque medido em cada junta do robô, que é uma alternativa viável para sistemas robóticos que não possuem sensores de força/torque acoplados ao efetuador. Resultados experimentais, obtidos com um robô Baxter, ilustram o desempenho do esquema de controle proposto. Palavras-chave— controle de robôs, controle hı́brido, manipulação de objetos, medição indireta de força, identificação visual de pose, robôs cooperativos. 1 Introdução Diversas aplicações de robótica na área de automação industrial requerem que um robô manipulador interaja com objetos do ambiente ou execute operações sobre uma superfı́cie de contato, tais como polimento, perfuração, etc. Outras tarefas como, por exemplo, agarrar e mover um objeto de grandes dimensões requerem a utilização de múltiplos robôs trabalhando cooperativamente. Neste contexto, não somente o movimento do efetuador e a força de contato devem ser simultaneamente controlados, mas também é necessário que a pose do objeto manipulado seja modificada durante a execução da tarefa (Siciliano et al., 2009). Para lidar com esses desafios, diferentes metodologias foram desenvolvidas para combinar o controle de movimento com o controle de interação para sistemas robóticos compostos por múltiplos manipuladores (Wen e Kreutz-Delgado, 1992; Caccavale e Uchiyama, 2008). As estratégias de controle de interação podem ser classificadas em métodos indiretos (e.g., controle de complacência, controle de impedância) e métodos diretos (e.g., controle hı́brido, controle paralelo). A principal diferença entre os dois métodos é que as estratégias do segundo grupo permitem que a força de contato seja controlada, a partir do fechamento explı́cito de um laço de realimentação de força. Neste contexto, alguns autores tem considerado o uso de controle de impedância como uma solução viável quando um sensor de força não está disponı́vel (Schneider e Cannon, 1992; Caccavale et al., 2008). Porém, as soluções mais utilizadas são baseadas na estratégia de controle hı́brido, que apresenta laços de controle de posição e de força desacoplados e projetados de maneira independente (Yamano et al., 1998; Tinos et al., 2006). Seguindo essa tendência, diversas estratégias foram desenvolvidas e aplicadas para solucionar o problema de controle hı́brido de posição e força de manipuladores cooperativos (Hayati, 1986; Caccavale e Uchiyama, 2008). Alguns desafios relacionados ao problema de controle hı́brido envolvem, por exemplo, a interação do efetuador com superfı́cies de contato com geometria incerta, bem como a utilização de estratégias de controle adaptativo, que são mais robustas às incertezas nos parâmetros mecânicos do sistema robótico (Doulgeri e Karayiannidis, 2007; Leite et al., 2009). Em geral, para realizar um controle de interação bem sucedido sensores de força podem ser acoplados aos efetuadores dos sistemas robóticos, de acordo com a tarefa de interesse. Porém, a instalação desses sensores requer uma adaptação customizada do efetuador ou da ferramenta do robô, já que os mesmos adicionam massa ao sistema e possuem diferentes interfaces de comunicação. Além disso, sensores de força especı́ficos para uma aplicação particular podem ter custo elevado ou não estar disponı́veis comercialmente. Nesse sentido, alguns autores apresentam soluções para o problema de controle de interação sem o uso de sensores de força (Eom et al., 1998; Choi et al., 2008). Atualmente, existe uma tendência de utilizar robôs com elementos flexı́veis (e.g., juntas e elos) para aplicações práticas que requerem uma interação segura com seres humanos. Por exemplo, os robôs Dexter (Scienzia Machinale), DLR LWR-III (German Aerospace Center), e Baxter (Rethink Robotics) são fabricados com atuadores elásticos do tipo SEA (do inglês, series elastic actuator) compostos por molas e possuem sensores de torque acoplados nas juntas (De Luca e Book, 2008). Nesse enfoque, o problema de estimação de força a partir da informação de torque nas juntas pode ser formulado como um problema de otimização convexa em tempo real (Linderoth et al., 2013) ou pode ser solucionado pela combinação de diferentes técnicas de estimação (Choi et al., 2012). Neste trabalho, apresenta-se uma metodologia para lidar com o problema de manipulação robótica cooperativa de objetos. A solução proposta é aplicada para sistemas robóticos compostos por dois manipuladores com câmeras acopladas, e sensores de torques nas juntas. Um esquema de controle hı́brido de posição e força é utilizado para realizar primeiramente a preensão do objeto e em seguida sua manipulação. É apresentado também um método analı́tico para estimar a força de interação entre o efetuador e o objeto a partir dos torques medidos nas juntas e do vetor de ação gravitacional no robô. O desempenho e a viabilidade do esquema de controle proposto são verificados a partir de ensaios experimentais de manipulação de objetos com um robô Baxter. 2 Formulação do Problema Considere um sistema robótico cooperativo composto por dois robôs manipuladores, duas câmeras acopladas, uma em cada braço, e sensores de torques nas juntas. A tarefa de interesse consiste em realizar a preensão de um objeto e a sua posterior movimentação até uma localização desejada no espaço de trabalho. As caracterı́sticas fı́sicas do objeto são consideradas incertas, mas considera-se que sua largura seja determinada durante a execução do procedimento de preensão. Por simplicidade, assume-se que as dimensões do objeto não sejam suficientemente pequenas para que ele possa ser agarrado por uma pinça ou garra, mas que sua largura seja suficientemente grande para que ele possa ser transportado por dois robôs manipuladores com capacidade de carga conhecida. O problema de manipulação cooperativa proposto é ilustrado na Figura 1, juntamente com os seguintes sistemas de coordenadas: base do robô Fb , centro de massa do objeto Fo , câmeras esquerda/direita FcL /FcR , efetuadores esquerdo/direito FeL / FeR . do objeto, inserido em seu espaço de trabalho, e realizar a preensão entre dois pontos de contato diametralmente opostos, a fim de assegurar que objeto permaneça seguro durante a manipulação. Para identificar a pose do objeto utiliza-se as câmeras posicionadas na extremidade dos manipuladores e o algoritmo de estimação visual proposto em (Faria et al., 2015). A força de contato desejada fd é definida experimentalmente e não pode ultrapassar os valores limites, durante a preensão e a movimentação do objeto, a fim de evitar que o contato seja perdido (fd < fmin ) ou que o objeto seja danificado (fd > fmax ). Neste trabalho, considera-se que não existe sensor de força acoplado ao efetuador do robô e a estimativa da força de contato é obtida a partir da medição direta dos torques em cada junta. Portanto, a solução proposta envolve diversos desafios como, por exemplo, (i) controlar a pose de um objeto manipulado por dois braços robóticos; (ii) controlar a força de contato indiretamente a partir da medição dos torques nas juntas; (iii) identificar visualmente a pose inicial do objeto para realizar o procedimento de preensão de maneira segura e eficiente. 3 Nesta seção, apresenta-se o procedimento desenvolvido para realizar a preensão do objeto durante a tarefa de manipulação cooperativa. Primeiramente, considera-se a estimação visual da pose do objeto localizado no espaço de trabalho e em seguida essa informação é utilizada no procedimento de alinhamento dos manipuladores que antecede o procedimento de preensão. No presente trabalho, utiliza-se o algoritmo iterativo de estimação visual proposto em (Faria et al., 2015) que foi desenvolvido para a manipulação automatizada de válvulas de controle baseada em sensoreamento visual. Em contraste com a solução original onde os autores utilizam LEDs como caracterı́stica visual, no presente trabalho utilizase marcadores circulares coloridos, por serem de fácil fixação no objeto e não necessitarem de fonte de alimentação externa. 3.1 Figura 1: Sistemas de coordenadas, robô Baxter do CENPES/Petrobras e objeto a ser manipulado. Na tarefa de manipulação cooperativa o sistema robótico deve ser capaz de identificar a pose Procedimento para Preensão Modelagem do objeto Considere um objeto de forma retangular com massa m, largura l e superfı́cie sujeita à deformação elástica, com constante elástica ks . Assumese que as forças de contato ηL e ηR são aplicadas nesse objeto através dos manipuladores esquerdo E L e direito E R respectivamente. Essas forças atuam no objeto apenas na direção do vetor unitário ~hLR , paralelo ao segmento de reta que interliga os pontos de contato dos efetuadores. Seja p ∈ R3 o vetor posição do sistema de coordenadas do ob3 jeto Fo , pL e ∈ R o vetor posição do sistema de co3 ordenadas do efetuador esquerdo FeL e pR e ∈R o l d EL FeL ks L Fm ks Fo m R Fm E R ~hLR FeR Figura 2: Modelo do objeto a ser manipulado. vetor posição do sistema de coordenadas do efetuador direito FeR , ambos expressos com respeito ao sistema de coordenadas da base do robô Fb . Nas laterais esquerda e direita do objeto adicionam-se marcadores visuais, e os sistema de coordenadas L R Fm e Fm , respectivamente. Uma vez que as forças de contato são projetadas ao longo da direção do vetor unitário ~hLR , o problema de controle de força é essencialmente unidimensional. Nesse caso, utiliza-se um modelo massa-mola como mostrado na Figura 2 e a equação de movimento para o objeto é dada por (Kruse et al., 2015): R m p̈ = η L + η R = ks (p − pL e ) + ks (p − pe ) . (1) 3.2 Alinhamento dos manipuladores Seja Tij ∈ R4×4 a matriz de transformação homogênea usada para denotar a pose do sistema de coordenadas Fj em relação ao sistema de coordenadas Fi (Siciliano et al., 2009). O problema de alinhamento dos manipuladores para a preensão do objeto consiste em combinar a pose do objeto em relação à câmera acoplada a um dos robôs manipuladores, Tco , com a pose da câmera em relação ao sistema de coordenadas da base do robô, Tbc , obtendo-se a pose do objeto em relação à base do robô, Tbo . Então, Tbo será utilizada como referência para calcular as poses desejadas para os efetuadores esquerdo e direito em relação a base L R do robô, Tbe e Tbe , respectivamente. Considere o modelo do objeto apresentado na R 3 Fig. 2. Seja pL c , pc ∈ R as posições das câmeras acopladas aos efetuadores esquerdo e direito, resR 3 pectivamente. Considere também pL m , pm ∈ R as posições dos marcadores visuais fixados do lado esquerdo e do lado direito do objeto, respectivamente. Assume-se como hipótese que o objeto encontra-se no plano xb -yb do sistema de coordenadas da base Fb e sua pose inicial é incerta. No presente trabalho, utiliza-se a informação visual de ambos conjuntos de marcadores como entrada do algoritmo de estimação visual proposto em (Faria et al., 2015) e obtém-se como saı́da uma estimativa do vetor unitário ~hLR , bem como a disi tância rmc de cada câmera ao marcador correspondente. Dessa forma, pode-se determinar a posição de cada marcador pim , como: i pim = pic + rmc . i = {L, R} . (2) É válido mencionar que, a posição de cada marcador pim representa um ponto de contato sobre o objeto que também pode ser utilizada para a preensão do mesmo durante a tarefa de manipulação. Adicionalmente, define-se uma distância d ∈ R que os efetuadores devem, inicialmente, manter em relação aos pontos de preensão. Dessa forma, calcula-se as posições desejadas pid antes da preensão, para os braços direito e esquerdo usando: pid = pim + d hLR , i = {L, R} . (3) Finalmente, define-se o ângulo α, que representa o rumo do objeto quando este está posicionado sem inclinação em relação ao plano xb -yb . Este ângulo pode ser obtido a partir dos vetores unitários ~hLR e ~xb , da base do robô, usando a seguinte relação: α = arccos(~hLR · ~xb ) − π/2 . Então, a orientação desejada para a preensão pode ser expressa em termos do ângulo α como: Rdi = Rx (α) , i = {L, R} . (4) Após a realização deste procedimento de posicionamento inicial, utiliza-se o controle de força para aproximar os efetuadores na direção do vetor unitário ~hLR até que uma força de contato mı́nima fmin seja atingida. 4 Estimação da Força de Contato O objetivo do método de estimação de força utilizado nesse trabalho é determinar as forças generalizadas nos efetuadores (forças e momentos) quando os mesmos interagem com um objeto do ambiente. Nesse contexto, considera-se que existem sensores de torque acoplados em cada junta dos robôs manipuladores. O torque medido em cada junta é obtido por (Linderoth et al., 2013): τm = τg + τdin + τext + τd , (5) onde τm ∈ Rn é o vetor de torques medidos pelos sensores acoplados às juntas flexı́veis, τg ∈ Rn é o vetor de torques provenientes das forças gravitacionais sobre o manipulador, τdin ∈ Rn é o vetor de torques dinâmicos gerados pelas acelerações do manipulador, τext ∈ Rn é o vetor de torques gerados pela ação de elementos externos e τd ∈ Rn é o vetor de torques devido à perturbações como, por exemplo, erros de modelagem, ruı́dos de medição e forças de atrito. Os torques dinâmicos τdin podem ser calculados a partir dos parâmetros dinâmicos do robô. Contudo, para as tarefas de manipulação consideradas nesse trabalho, esse valores serão considerados desprezı́veis uma vez que ao interagir com um objeto ou com o ambiente externo não é adequado utilizar velocidades elevadas e/ou acelerações com grandes variações. Por outro lado, os torques devido à perturbações τd exigem uma análise mais complexa, baseada em modelos de atrito, para serem precisamente estimados. Nesse trabalho, es- ses torques também serão considerados desprezı́veis implicando, portanto, no surgimento de erros na estimação da força externa. Os torques externos τext são produzidos pela interação do efetuador com um objeto ou com o ambiente, produzindo forças externas generalizadas Fext = [ f T µT ]T , onde f ∈ R3 é a força de contato e µ ∈ R3 é o momento angular. A aplicação do princı́pio do trabalho virtual permite expressar a relação entre os torques externos e as forças externas generalizadas como (Siciliano et al., 2009): τext = J T (θ) Fext . (6) Levando em consideração que τdin e τd são desprezı́veis, pode-se finalmente obter a estimação da força externa aplicada ao efetuador a partir dos torques medidos e do torque gravitacional como: fˆ T T F̂ext = = τext J † (θ) = (τm − τg )T J † (θ) . (7) µ̂ 5 Modelagem e Controle Cinemático Considere o problema de controle cinemático para um robô manipulador com n graus de mobilidade. Assume-se aqui que o robô possui uma malha interna de controle de velocidade de alto desempenho para acionamento direto das juntas. Então, o movimento do robô pode ser descrito por: θ̇i = ui , i = 1, · · · , n , (8) em que θi and θ̇i são respectivamente a posição e a velocidade angulares da i-ésima junta e ui é o sinal de controle de velocidade aplicado ao driver do motor da i-ésima junta. Essa abordagem é válida quando as taxas de redução nas engrenagens são elevadas e as tarefas de interesse não exigem altas velocidades ou rápidas acelerações. A posição e orientação dos sistemas de coordenadas do efetuador Fe em relação ao sistema de coordenadas da base Fb pode ser obtida através da cinemática direta como: pe = f (θ) , qe = h(θ) , (9) em que pe ∈ R3 denota a posição do efetuador com respeito à base do robô, qe ∈ H denota o quatérnio unitário1 que representa a orientação do efetuador em relação à base. Note que, f (·) : Rn 7→ R3 é uma função de mapeamento não-linear do espaço das juntas para o espaço Cartesiano, h(·) : Rn 7→ H é uma função de mapeamento não-linear do espaço das juntas para o espaço de quatérnios. A partir da derivada no tempo da equação de cinemática direta (9), obtém-se a seguinte relação de cinemática diferencial: ṗe = Jp (θ) θ̇ , q̇e = Jq (θ) θ̇ , (10) 1 O sı́mbolo H denota o grupo dos quatérnios unitários que satisfaz a álgebra dos quatérnios (Siciliano et al., 2009). 3×n 4×n em que Jp = ∂f e Jq = ∂h denotam ∂θ ∈ R ∂θ ∈ R as matrizes que relacionam as contribuições das velocidades das juntas para as derivadas no tempo da posição e da orientação do efetuador. A partir da regra de propagação do quatérnio, a derivada no tempo do quatérnio unitário q̇e ∈ H pode ser relacionada a velocidade angular do efetuador ωe ∈ R3 como ωe = Jr (qe ) q̇e , onde Jr (qe ) ∈ R3×4 é o Jacobiano da representação. A velocidade do efetuador no espaço Cartesiano ve é relacionada a velocidade das juntas através da equação de cinemática diferencial: ṗe Jp (θ) ve = = θ̇ = J(θ) θ̇ , (11) ωe Jo (θ) em que J(θ) ∈ R6×n é o Jacobiano geométrico do manipulador e Jo (θ) = Jr (qe ) Jq (θ) ∈ R3×n . Um sinal de controle vc (t) projetada no espaço Cartesiano pode ser transformada em um sinal de controle no espaço das juntas usando a seguinte relação linearizante: vh u = J † (θ) vc , vc = , (12) vo em que vh , vo ∈ R3 são os sinais de controle Cartesiano projetados para controlar a posição e orientação do efetuador respectivamente. Pode-se mostrar que, o sinal de controle (12) minimiza localmente a norma das velocidades das juntas desde que a cinemática do robô seja conhecida e vc (t) não conduza o robô para configurações singulares, onde a matriz Jacobiana tem posto deficiente. Na abordagem de controle hı́brido, a variável de controle vh é utilizada para controlar a posição do efetuador e a interação entre o efetuador e a superfı́cie de contato como (Siciliano et al., 2009): vh = vhp + vhf , T vhp = Rbs Sp Rbs vp , (13) T vhf = Rbs Sf Rbs vf , onde Sp , Sf ∈ R3×3 são matrizes de seleção, ortogonais complementares, que determinam quais os graus de liberdade são controlados por posição ou força; Rbs ∈ SO(3) é a matriz de rotação do sistema de coordenadas da superfı́cie Fs em relação ao sistema de coordenadas da base Fb ; vp , vf ∈ R3 são as leis de controle de posição e força respectivamente, que são projetadas de acordo com as estratégias de controle propostas em (Leite et al., 2010). 6 Resultados Experimentais Nesta seção, apresenta-se os resultados experimentais obtidos com um robô Baxter (Rethink Robotics) para demonstrar o desempenho e a viabilidade da metodologia de controle proposta. O robô Baxter possui dois manipuladores de 7 graus de liberdade com sensores de torque, posição e velocidade embutidos em cada junta. Cada manipulador possui um efetuador no qual foi adicionado um disco emborrachado para facilitar a preensão do objeto e uma câmera embutida. Contudo, para obter um melhor desempenho para o algoritmo de estimação visual utiliza-se uma câmera Logitech HD Webcam C270, diretamente conectada ao computador por uma porta USB. Posição do objeto, p e trajetória desejada, p d px pxd m 0.6 20 40 0.6 60 0.5 py m −0.5 0 1 20 z, m 0 pyd 40 fˆL 0.3 60 pz (a) Força nos efetuadores, fˆ 15 0.4 N m 0.5 0 0.5 ção desejadas para o objeto utilizando uma interface gráfica desenvolvida ad-hoc. A referência de posição é uma trajetória circular definida no plano yb -zb com raio rc = 0, 2 m e frequência angular ωc = π/10 rad s−1 . O algoritmo de controle é implementado em Python e o laço de controle é executado com periódo de amostragem de 20 ms em um processador Intel i7-3770 3.4 GHz com 4 GB de memória RAM. Os parâmetros de controle utilizados foram: kp = 0,8 s−1 , ko = 0,7 rad s−1 , e kf = 0,5 m N −1 s−1 . 0.2 pzd p pd 0.1 0.5 0.2 0 0 20 40 0 y, m−0.2−0.4 60 0.5 fdL fdR 10 5 0 10 20 30 40 50 60 70 (b) Erro de força, ef 5 x, m N Tempo, s 0.55 fˆR 0 eLf Figura 3: Posição do objeto e trajetória desejada. −5 0 10 20 30 40 50 eR f 60 70 Tempo, s O software do robô é desenvolvido em C++ e Python e é estruturado para utilização com o ROS (Robot Operating System), uma plataforma de código aberto com bibliotecas e ferramentas disponı́veis para auxiliar no desenvolvimento de aplicações para sistemas robóticos. Nesse ambiente de programação, cria-se um cenário experimental, onde um objeto de formato retangular é inserido dentro do espaço de trabalho do robô. Neste objeto foram adicionados quatro marcadores circulares. O algoritmo de estimação visual identifica a pose do objeto por meio destes marcadores e alinha os manipuladores para iniciar a etapa de preensão do objeto. Após a pegada do objeto, o sistema robótico utiliza a estratégia de controle hı́brido proposta em (Leite et al., 2010) para realizar a tarefa de manipulação cooperativa. (a) Erro de posição, ep m 0.1 epx epy epz 0 −0.1 0 10 20 30 40 50 60 70 Figura 5: (a) Força estimada nos efetuadores; (b) erro de força nos efetuadores. A evolução no tempo da posição do objeto e a posição do objeto no espaço Cartesiano são ilustradas na Figura 3, onde ambas são comparadas com a trajetória desejada. A Figura 4, (a) e (b), ilustra a evolução no tempo dos erros de posição e de orientação do objeto durante a tarefa de manipulação. A evolução no tempo da força de contato, estimada indiretamente, que os efetuadores aplicam sobre o objeto é ilustrada na Figura 5 (a). A Figura 5 (b) ilustra o comportamento temporal do erro de força, onde observa-se que a interação dos efetuadores com o objeto foi satisfatória não ocorrendo perda de contato ou escorregamento durante a execução da tarefa de manipulação. Os sinais de controle nas juntas para os braços direito e esquerdo são apresentados na Figura 6, (a) e (b) respectivamente, onde pode-se observar a limitabilidade das velocidades das juntas. 7 Considerações Finais (b) Erro de orientação, eo 0.2 eoy eox eoz 0 −0.2 0 10 20 30 40 50 60 70 Tempo, s Figura 4: (a) Erro de posição do objeto; (b) erro de orientação do objeto. Inicialmente, o robô posiciona o objeto em uma posição inicial fixa e, posteriormente, o operador transmite a referência de posição e orienta- Neste trabalho, considera-se o problema de manipulação cooperativa de objetos utilizando um sistema robótico de dois braços e duas câmeras acopladas, uma em cada braço. O algoritmo de estimação visual é baseado no uso de marcadores fixados na superfı́cie do objeto para identificar a sua pose antes da etapa de manipulação. Uma estratégia de controle hı́brido é utilizada para controlar o movimento e a interação entre os efetuadores e o objeto, a fim de garantir uma preensão segura e eficiente durante a execução da tarefa. Como uma alternativa para sistemas robóticos que não De Luca, A. e Book, W. (2008). Robots with flexible elements, in B. Siciliano e O. Khatib (eds), Springer Handbook of Robotics, Springer Berlin Heidelberg, pp. 287–319. (a) Velocidade das juntas do braço esquerdo, uL rad s−1 0.2 0 −0.2 0 u L1 10 u L2 20 u L3 30 u L4 40 u L5 u L6 50 u L7 60 70 (b) Velocidade das juntas do braço direito, uR rad s−1 0.2 0 −0.2 0 uR 1 10 uR 2 20 uR 3 30 uR 4 40 uR 5 50 uR 6 uR 7 60 70 Tempo, s Figura 6: Sinais de controle nas juntas: (a) braço esquerdo uL ; (a) braço direito uR . possuem sensores de força, é proposto um método de estimação de forças externas generalizadas a partir de um sensor de torque instalado em cada junta do robô. Ensaios experimentais, conduzidos com um robô Baxter manipulando um objeto retangular, ilustram o desempenho e a viabilidade da metodologia de controle apresentada. Como propostas para trabalhos futuros pretende-se considerar a flexibilidade das juntas do robô Baxter na formulação do problema de controle hı́brido e utilizar objetos de dimensões, formatos e elasticidades diferentes para as tarefas de manipulação cooperativa. Uma ideia interessante é desenvolver uma metodologia de manipulação de objetos, onde operador pode posicionar o objeto em locais desejados a partir de um procedimento de reconhecimento de comandos de voz e movimentos dos braços para coordenar os movimentos entre o ser humano e o robô. Neste procedimento, os movimentos dos braços do operador são capturados por um dispositivo de interface natural e transformados em sinais de referência para o sistema de controle de posicionamento do robô. Referências Caccavale, F., Chiacchio, P., Marino, A. e Villani, L. (2008). Six-dof impedance control of dual-arm cooperative manipulators, IEEE/ASME Trans. Mech. 13(5): 576–586. Caccavale, F. e Uchiyama, M. (2008). Cooperative manipulators, in B. Siciliano e O. Khatib (eds), Springer Handbook of Robotics, Springer Berlin Heidelberg, pp. 701–718. Doulgeri, Z. e Karayiannidis, Y. (2007). Force/position tracking of a robot in compliant contact with unknown stiffness and surface kinematics, Proc. IEEE Int. Conf. Rob. Aut., pp. 4190–4195. Eom, K. S., Suh, I. H., Chung, W. K. e Oh, S.-R. (1998). Disturbance observer based force control of robot manipulator without force sensor, Proc. IEEE Conf. Rob. and Aut., pp. 3012–3017. Faria, R. O., Kucharczak, F., Freitas, G. M., Leite, A. C., Lizarralde, F., Galassi, M. e From, P. J. (2015). A methodology for autonomous robotic manipulation of valves using visual sensing, Proc. 2nd IFAC Works. Aut. Cont. Offshore O&G Produc., pp. 228–234. Hayati, S. (1986). Hybrid position/force control of multi-arm cooperating robots, Proc. IEEE Int. Conf. Rob. Aut., pp. 82–89. Kruse, D., Wen, J. e Radke, R. (2015). A sensorbased dual-arm tele-robotic system, IEEE Trans. Autom. Science and Eng. 12(1): 4–18. Leite, A. C., Lizarralde, F. e Hsu, L. (2009). Hybrid adaptive vision-force control for robot manipulators interacting with unknown surfaces, Int. J. Rob. Res. 28(7): 911–926. Leite, A. C., Lizarralde, F. e Hsu, L. (2010). A cascaded-based hybrid position-force control for robot manipulators with nonnegligible dynamics, Proc. Amer. Contr. Conf., pp. 5260–5265. Linderoth, M., Stolt, A., Robertsson, A. e Johansson, R. (2013). Robotic force estimation using motor torques and modeling of low velocity friction disturbances, Proc. IEEE/RSJ Int. Conf. Intell. Rob. Syst., pp. 3550–3556. Schneider, S. e Cannon, R.H., J. (1992). Object impedance control for cooperative manipulation: theory and experimental results, IEEE Trans. Rob. Autom. 8(3): 383–394. Siciliano, B., Sciavicco, L., Villani, L. e Oriolo, G. (2009). Robotics: Modeling, Planning and Control, Springer Verlag London. Tinos, R., Terra, M. e Ishihara, J. (2006). Motion and force control of cooperative robotic manipulators with passive joints, IEEE Trans. Cont. Syst. Tech. 14(4): 725–734. Choi, J., Kang, S. et al. (2012). External force estimation using joint torque sensors for a robot manipulator, Proc. IEEE Int. Conf. Rob. Aut., pp. 4507–4512. Wen, J. T. e Kreutz-Delgado, K. (1992). Motion and force control of multiple robotic manipulators, Automatica 28(4): 729–743. Choi, J. Y., Choi, Y. e Yi, B.-J. (2008). Force sensor-less interaction force control in the deburring task using dual-arm manipulation, Proc. IEEE/RSJ Int. Conf. Intell. Rob. and Syst., pp. 967–973. Yamano, M., Kim, J.-S. e Uchiyama, M. (1998). Hybrid position/force control of two cooperative flexible manipulators working in 3d space, Proc. IEEE Int. Conf. Rob. Aut., pp. 1110–1115.

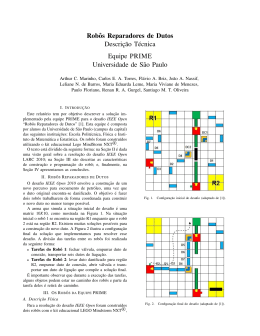

Baixar