Regressão

e

Previsão Numérica

Objetivos

Obter um modelo que explique o

comportamento dos exemplos

observados (respostas) e usar

esse modelo para fazer predições

Amostra

A amostra de dados deve ser representativa,

isto é, cobrir amplamente o domínio do

problema considerando as operações

rotineiras, e as exceções

Planejamento

Definição da metodologia a ser aplicada,

avaliação da adequação do modelo e

interpretação dos resultados

Previsão

Previsão é similar à Classificação

Primeiro construa um modelo

Depois, use o modelo para a previsão do valor

desconhecido

O método mais importante de previsão é a

regressão

Regressão linear e múltipla

Regressão não linear

Previsão é diferente de Classificação

Na classificação, a variável a “explicar” é categórica

Na previsão, a variável a “explicar” é contínua

Relação entre Variáveis

Com muita freqüência, na prática, verifica-se que

existe uma relação entre duas ou mais varáveis.

Exemplo:

Peso x Altura

Circunferência x Raio

Quantidade de vapor x Temperatura

Ajustamento de curva

Para ajustar uma equação que relacione as

variáveis, é necessário:

Colecionar dados que indiquem valores

Colocar os dados em um sistema de coordenadas

cartesianas (Diagrama de dispersão)

Visualizar a curva de dispersão (curva regular que

aproxima os dados)

Correlação Linear

É quando os dados parecem estar bem próximos a

uma linha reta. É o tipo mais simples de ajustamento e

pode ser descrito pela equação:

Y = 0 + 1 X

Correlação Não-Linear

Quando os dados não estão próximos a uma linha

reta. Existem várias equações:

Y = 0 + 1 X + 2 X2

Y = 0 + 1 X + 2 X2 + 3 X3

Y = 0 + 1 X + 2 X2 + 3 X3+ ... + nXn

Regressão Linear Múltipla

Sejam os valores de uma variável dependente (resposta) Y

relacionados com os valores valores de m variáveis

independentes Xk por meio de um modelo estocástico

Yt = 0+ 1X1+ 2X2+...+ mXm + t

t = 1,...,n

k – parâmetro desconhecido que indica o grau de associação

linear da variável independente Xk com a variável

dependente Y

t – erro aleatório devido a natureza estocástica de Y

Suposições para a análise do modelo

de Regressão Linear

Resíduos com variância constante,

não correlacionados e média zero

Normalidade nos resíduos (não necessariamente)

Número de parâmetros menor que o número de

observações (problema de overfitting)

Métodos de Estimação dos

Parâmetros

Mínimos Quadrados

Modelo

Y = X +

Y – vetor de respostas (n 1)

X - matriz de observações independentes (n p)

- vetor de parâmetros

- vetor de erros (n 1)

Método dos mínimos quadrados

Para evitar o critério individual na construção de

retas, parábolas ou outras curvas de ajustamento que se

adaptem ao conjunto de dados, é necessário instituir uma

definição da “melhor reta de ajustamento”, da “melhor

parábola de ajustamento”, etc.

Para um dado valor X, por exemplo X1, haverá uma

diferença entre o valor Y1 e o valor correspondente na

curva. Representamos esta diferença por 1 que é muitas

vezes designado como desvio, erro ou resíduo e pode ser

positivo negativo ou nulo.

Método dos mínimos quadrados

De todas as curvas que se ajustam a um conjunto

de pontos, a que tem a propriedade de apresentar um

mínimo valor de

12+ 22 + 32 + ...+ n2

é denominada a melhor curva de ajustamento.

Diz-se que uma curva, que apresenta esta

propriedade, ajusta os dados no sentido dos mínimos

quadrados é denominada curva de mínimos quadrados.

Métodos de Mínimos Quadrados

com suposição de normalidade

A idéia é obter uma estimativa b para o vetor de parâmetros

que minimize a soma de quadrados dos erros ’

Como E()=0 então o modelo é expresso por E(Y) = X

A soma de quadrados de resíduos

’ = (Y - X)’ (Y - X)

= Y’ Y - ’X’Y – Y’X + ’X’X

= Y’ Y - 2’X’Y + ’X’X

Condição de mínimo

ε'ε

0

β

A solução do sistema é

(X t X)β X tY

b βˆ (Xt X)1 XtY

Vetor de valores ajustados

ˆ Xb

Y

O erro nas observações é:

ei yi yˆi yi (b0 b1xi )

Para n observações, a média do erro é:

1

1

e ei { yi (b0 b1 xi )}

n i

n i

e y b0 b1 x

Supondo que a média do erro é zero

b0 y b1 x

Substituindo b0 na equação de erro vamos obter:

b1

xy nx y

x nx

2

2

Experimento 1

25 pares de observações onde Y =quantidade de vapor usado por mês

e X = temperatura em graus Farenheit

No obs.

1

2

3

4

5

6

7

8

9

10

11

12

Y

10.98

11.13

12.51

8.40

9.27

8.73

6.36

8.50

7.82

9.14

8.24

12.19

X

35.3

29.7

30.8

58.8

61.4

71.3

74.4

76.7

70.7

57.5

46.4

28.9

No obs.

13

14

15

16

17

18

19

20

21

22

23

24

25

Y

X

11.88

9.57

10.94

9.58

10.09

8.11

6.83

8.88

7.68

8.47

8.86

10.36

11.08

28.1

39.1

46.8

48.5

59.3

70.0

70.0

74.5

72.1

58.1

44.6

33.4

28.6

Para n = 25 e

X

i

Xi

2

1315

X Y 11821.432

i i

76323.42 X 52.60 Y 9.424

Portanto

b1

571 .128

0.080

7154 .42

b0 9.424 0.080* 52.60 13,623

Yˆi b0 b1 X i 13.623 0.080X i

Gráfico 1: Temperatura

versus Qtd de vapor

13

Gráfico 2: Temperatura

versus valores ajustados

11,5

12

10,5

11

Valores

ajustados

Y 10

9,5

9

8

8,5

7

7,5

6

30

40

50

X

60

70

80

30

40

50

60

70

80

X

O gráfico 1 mostra que existe uma relação linear entre a qtd

de vapor e a temperatura. O gráfico 2 ilustra a regressão linear.

Avaliação de desempenho do modelo

de Regressão

Estatística R

(Yˆ Y )

(Y Y )

2

i

2

i

2

i

i

R2 – mede a variabilidade de Y explicada

pelo modelo de regressão

Exemplo: Para os dados do experimento 1

R2

45.5924

0.71

63.81

Teste de aceitação do modelo

H0 : = 0

H1 : 0

Tabela 1 : Análise de Variância

Variação

Regressão

Resíduo

Graus de

Liberdade

p-1

n-p

Soma de

Quadrados

( SS)

n-1

Estatística do teste

(F)

n

(Yˆ Y)

t 1

n

2

i

(Y Yˆ )

t 1

Total correto

por Y

Soma de

Quadrados média

(MS)

i

2

i

SSReg/(p-1)

SS Re g /(p 1)

s2 = SSRes/(n-p)

SS Re s /(n p)

n

(Y Y )

t 1

2

i

F tem distribuição com p-1,n-p graus de liberdade

e nível de significância 1-

Teste de aceitação do modelo

H0: Rejeita-se o modelo

H1: Aceita-se o modelo

Região de aceitação da hipótese H0

F

SSRe g /( p 1)

SSRe s /(n p)

Fp1,n p 1 (1 )

Exemplo: Considere o modelo do exemplo anterior

Tabela 1 : Análise de Variância

Variação

Graus de

Liberdade

Soma de

Quadrados

( SS)

Soma de

Quadrados média

MS

Regressão

1

45.59

45.59

Resíduo

23

18.22

0.79

Total correto

por Y

24

63.81

Valor de F1,22(0,95) = 4.28

Como a estatística F=57.54 > 4.28 rejeitamos H0

Valor da

Estatística do teste

(F)

57.54

Teste de significância do vetor de

parâmetros ()

H0 : i = 0

H1 : i 0

Estatística do teste

(i = 1,...,p)

T

bi

Var (bi )

T tem distribuição t-student com n-p graus de liberdade

Região de aceitação da hipótese H0

T tn p (1 / 2)

Regression Analysis: C1 versus C2

The regression equation is

C1 = 13,6 - 0,0798 C2

Predictor

Coef

Constant

13,6230

C2

-0,07983

S = 0,8901

SE Coef

T

0,5815

0,01052

R-Sq = 71,4%

P

23,43 0,000

-7,59 0,000

R-Sq(adj) = 70,2%

Analysis of Variance

Source

DF

Regression

SS

1

45,592

Residual Error 23

Total

24

18,223

63,816

MS

F

45,592

57,54 0,000

0,792

P

Intervalo de confiança para o vetor b

b tem distribuição t-student(n-p)

bi t n p ( / 2) Var (bi )

i = 1,...p

Exemplo: Continuando com o exemplo anterior

H0: 1 = 0

H1: 1 0

(i = 1,...,p)

|T| =| -0.07980/0.0105| = 7.6 > t23(0.975)=2.069

Rejeita H0

Intervalo de confiança :

-0.1016 < 1< -0.0581

Diagnóstico da Regressão

Análise do modelo

Exemplo 1

Os resultados do ajustamento revelam que :

a variável temperatura é significativa no modelo (|t|=2.069 > 2)

a variabilidade dos dados explicada pelo modelo é boa (R2 = 0.71)

o valor da F=57.54 > F1,23(5%) indica que a regressão é significativa

ao nível de confiança de 95%

Diagnóstico da Regressão

Análise gráfica dos resíduos

1 – Normalidade da variável resposta

2 – Independência das observações

3 – Se uma variável explicativa não incluída no

modelo é relevante

Diagnóstico da Regressão

Residuals Versus the Order of the Data

Residuals Versus the Fitted Values

(response is C1)

(response is C1)

1

Residual

Residual

1

0

0

-1

-1

-2

-2

5

10

15

20

25

Observation Order

Os resíduos são aleatórios.

7,5

8,5

9,5

10,5

Fitted Value

Os valores ajustados não

apresentam tendência

11,5

Diagnóstico da Regressão

Histogram of the Residuals

Normal Probability Plot of the Residuals

(response is C1)

(response is C1)

2

7

6

1

Normal Score

Frequency

5

4

3

2

0

-1

1

0

-2

-1,5

-1,0

-0,5

-0,0

0,5

1,0

1,5

Residual

-2

-1

0

Residual

Os resíduos apresentam normalidade.

O modelo proposto se ajusta aos dados, pois as hipóteses

básicas da regressão clássica são satisfeitas.

1

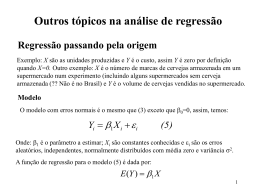

Modelos de Regressão Não Linear

A não linearidade é dada pela função de regressão

Yt = 0+ 1X1+ X2 + t

t = 1,...,n

Um método de estimação: Mínimos Quadrados não

Lineares

Download