Diagnóstico na análise de regressão • O modelo que estamos usando é adequado? • Os erros tem distribuição normal? • Os erros são independentes? • Os erros tem variância constante? • existem valores discrepantes (“outliers “) ? uma ou mais variáveis preditoras importantes foram omitidas do modelo? Qualidade do modelo Métodos gráficos Testes estatísticos Obs: recomenda-se a leitura do capítulo 9 do livro texto. Diagnóstico para a variável preditora Verificar se existe algum valor de X discrepante que possa influenciar o ajuste da função de regressão*. Útil para verificar a faixa de validade da análise de regressão. *Ponto influente (Capítulo 9 do livro texto). Seja o exemplo dado em SNEDECOR AND COCHRAN (1976), no livro Statistical methods. 1 O box-plot não indica que existe algum valor de X1 muito distante dos demais, isto é, que foge da distribuição dos demais. A distribuição é um pouco assimétrica. Outros métodos: Y=produção de milho; •diagrama de pontos X1=concentração de fósforo inorgânico •gráfico seqüencial X2=concentração de fósforo orgânico (tempo) 1=Amostras de solos. •ramo-e-folhas Exercício: fazer o box-plot para X2. Interpretar 2 Exemplo: 26 programas foram monitoradas para estudar a demanda por recursos. Y=cpu time; X1=disk I/O X2=memory size Box Plot (cputime.STA 10v*26c) 450 400 350 300 250 200 150 100 50 0 T AM_MEMO Max = 400 Min = 70 75% = 238 25% = 140 Median = 210,5 3 Resíduos Diagnóstico para a variável resposta é realizado através de uma análise de resíduos. Os resíduos são definidos como: ei Yi Yˆi Os resíduos podem ser considerados como erros observados, para distingui-los do erro verdadeiro desconhecido i no modelo de regressão: i Yi E(Yi ) Para o modelo de regressão, temos: iid i ~ N (0, 2 ) pressuposição Se o modelo é adequado para os dados, os resíduos observados devem refletir essas propriedades. Propriedades dos resíduos Média Variância e e n i 0 ( ei e ) 2 ei2 n2 n2 SQE n2 QME Se o modelo está adequado, o QME é um estimador não tendencioso da variância do erro (2). 4 Dependência: os resíduos não são variáveis aleatórias independentes pois eles envolvem os valores Y(chapéu)i os quais são baseados na mesma equação de regressão. Quando o tamanho da amostra é grande em comparação com o número de parâmetros no modelo de regressão, o efeito de dependência entre os resíduos ei é relativamente sem importância e pode ser ignorado. 5 Resíduos semistudentizados ei* ei e QME ei QME • importante para detectar valores discrepantes. Diagnóstico: Gráficos utilizados: 1. Gráfico dos resíduos versus variáveis preditoras. 2. Gráfico dos resíduos absolutos ou quadráticos versus variáveis preditoras. 3. Gráficos dos resíduos versus valores ajustados (estimados). 4. Gráficos dos resíduos versus tempo ou outra sequência. 5. Gráfico dos resíduos versus variáveis preditoras omitidas do modelo. 6. Box-plot dos resíduos. 7. Gráfico normal de probabilidades dos resíduos. 6 Não linearidade da função de regressão: A verificação de que a função de regressão é adequada aos dados pode ser feita através do gráfico dos resíduos versus valores ajustados ou dos resíduos versus variáveis preditoras. Caso verificar-se um comportamento Exemplo: Uma pesquisadora estava interessada em estudar o comportamento do pH de tomates sistemático, termos adicionais ou de Chronos, inteiros minimamente processados, submetidos ao tratamento vácuo, durante 22 dias estocagem, a uma temperatura média de 8oC e umidade relativa dedevem 62,78%. ser incluídos no alternativos A figura apresenta o gráfico dos resíduos versusmodelo. a variável preditora Dias. Note que os desvios a partir de resíduo=zero apresenta um padrão sistemático; eles são positivos para valores baixos de dias de estocagem, negativos para valores médios e, novamente, positivos para valores altos. 1 2 3 4 5 6 7 8 9 10 11 12 PH 5,700 5,800 5,600 4,800 4,700 4,600 4,600 4,500 4,500 4,400 4,300 4,200 DIAS 1,000 1,000 1,000 8,000 8,000 8,000 15,000 15,000 15,000 22,000 22,000 22,000 7 Nesta figura temos um protótipo da situação em que um modelo de regressão linear é adequado. Observe que os resíduos se distribuem aleatoriamente em torno da média zero. Pode-se usar, como neste gráfico, os resíduos versus valores ajustados. 8 Exemplo: a pesquisadora deseja encontrar o modelo de regressão da porcentagem de acertos sobre o tamanho da cache. Foi usado um modelo RLS. 1,6 Standard residuals 1,0 0,4 -0,2 -0,8 -1,4 -2,0 2,2e5 2,6e5 3e5 3,4e5 3,8e5 4,2e5 Regression 95% confid. TAMANHO CACHE Este gráfico de resíduos mostra que o modelo de regressão linear simples está adequado. 9 Heterogeneidade de variâncias O gráfico dos resíduos versus variáveis preditoras ou versus os valores ajustados são apropriados para examinar a suposição de variância constante. Geralmente, a falta de homogeneidade de variâncias tende a produzir um gráfico com forma de megafone, como na figura a seguir: Maior dispersão e 0 Yˆi Menor dispersão Exemplo: uma pesquisadora está estudando o comportamento da perda de peso de tomates Chronos, inteiros minimamente processados, do tratamento controle durante 22 dias de experimento, estocado a uma temperatura média de 8oC e umidade relativa de 62,78%. 10 O gráfico dos resíduos versus valores preditos (ajustados) mostra que quanto maiores são os valores preditos maior é a dispersão dos resíduos. Isto sugere que a variância é maior para os tempos de estocagem maiores. 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 DIAS 1,000 1,000 1,000 1,000 1,000 1,000 8,000 8,000 8,000 8,000 8,000 8,000 8,000 15,000 15,000 15,000 15,000 15,000 15,000 22,000 22,000 22,000 22,000 22,000 22,000 22,000 22,000 PERDAPES ,700 ,800 ,300 ,400 ,900 1,000 2,500 2,600 2,700 2,800 2,900 3,000 3,200 2,900 5,700 7,100 7,500 7,800 8,700 4,600 5,500 7,700 8,300 9,300 9,500 10,800 11,600 11 Presença de outliers Outliers são valores extremos, atípicos, ou seja, são observações que não são bem ajustadas pelo modelo. Resíduos que são outliers podem ser identificados a partir de um gráfico dos resíduos versus a variável preditora ou valores ajustados. Pode-se usar também o box-plot ou ramo-efolhas. O uso dos resíduos semi-studentizados são particularmente úteis, pois é fácil identificar resíduos que estão muitos desvios padrões a partir de zero. Regra: considera-se outliers os resíduos que estão 4 ou mais desvios padrões a partir de zero. O gráfico ao lado apresenta os resíduos semi-studentizados e não contém outliers. Outliers podem introduzir grandes dificuldades na análise estatística. Deve-se descartar um outlier se ele representa um erro de registro, erro de medida, falha de equipamento ou algum outro problema similar. 12 Falta de independência dos erros Sempre que os dados são obtidos ao longo do tempo (série temporal), ou de algum outro tipo de seqüência (p.e., a seqüência em que os dados foram coletados, áreas geográficas adjacentes), deve-se fazer um gráfico dos resíduos versus seqüência. Resíduos (ei) Resíduos (ei) 0 0 (a) tempo tempo (b) Quando os resíduos são independentes, eles devem se distribuir aleatoriamente em torno de zero. Deve alternar os pontos em torno de zero. Algumas vezes, o problema de falta de independência, é devido a alguma variável importante (p.e. tempo) que foi omitida do modelo. No gráfico (b) é um problema de falta de ajuste da função de regressão (ajuste pobre). 13 Para os dados de população de Staphilococcus observa-se que os resíduos se distribuem aleatoriamente em torno de zero. Falta de normalidade dos erros Gráfico normal de probabilidades (Normal Probability Plot) Cada resíduo é grafado com o seu valor esperado sob normalidade. Se o padrão de distribuição é linear assume-se que a distribuição dos erros é normal, caso contrário, a distribuição não é normal. Mostra-se que para uma variável aleatória normal com média 0 (zero) e variância 2 ( quadrado médio residual), o valor esperado da k-ésima menor observação (observações ordenadas crescentemente) numa amostra aleatória de tamanho n é: QME z k 0, 375 n 0, 25 z(A) denota o (A)100 percentil da distribuição normal padrão. Qual é o valor de z para uma área acumulada igual a A? 14 Exemplo: vamos calcular os valores esperados para os dados de população de Staphilococcus Observações 1 2 3 4 5 6 Resíduos e valores esperados sob normalidade - pop. Staphilococcus Resíduos Posto (Rank) - k -0,211 0,375 -0,216 0,150 -0,097 -0,001 2 6 1 5 3 4 Obs.: resíduos com o mesmo valor: calcular a média dos ranks. Valor esperado sob normalidade -0,1657 0,3288 -0,3288 0,1657 -0,0527 0,0527 Exercício: obtenha o valor esperado para a observação 1. Seja z(0,26)=-0,6433. 2. QME=0,0659 Observamos no gráfico que os pontos caem próximos da reta, sugerindo que a amostra segue aproximadamente uma distribuição normal. A falta de normalidade pode ser devida a heterogeneidade de variâncias e falta de ajuste do modelo, portanto, inicialmente verificar essas suposições. 15 Omissão de importantes variáveis preditoras Fazer um gráfico dos resíduos versus variáveis preditoras omitidas do modelo que podem ter um efeito importante na resposta. Exemplo: objetivo: estimar o volume da árvore em pé a partir de medidas mais facilmente obtidas. Y=volume da árvore em pés cúbicos; X1=diâmetro da árvore em polegadas a 4 pés e 6 polegadas acima do solo; X2=altura da árvore em pés. Foi realizada uma regressão do volume sobre a altura. Mostra uma relação linear forte entre os resíduos e a variável X1 (DAP) ainda não incluída no modelo. Mostra também heterogeneidade de variâncias. 16 A inclinação sugere a inclusão de log dap no modelo. Eliminou-se a heterocedasticidade. 17 Teste F para falta de ajuste do modelo (Lack of fit) Iremos desenvolver um teste formal para verificar se uma específica função de regressão linear simples representa um bom ajuste para os dados. Suposições: O teste de ajuste do modelo assume que as observações Y para um dado X são: 1) independentes 2) normalmente distribuídos 3) as distribuições de Y tem a mesma variância 2 O teste para falta de ajuste necessita de repetições em um ou mais níveis de X. Exemplo: num estudo observacional da produtividade de trabalhadores e suas idades, diversos trabalhadores de mesma idade são incluídos no estudo; num estudo experimental para verificar o efeito de seis diferentes porcentagens sobre as vendas oferecidas aos vendedores (as), pode-se tomar 3 vendedores (as) para cada porcentagem. 18 Exemplo (Neter et al.) : num experimento envolvendo 12 filiais suburbanas similares, mas distribuídas, de um banco comercial, aos possuidores de conta bancária nas filiais foram oferecidos presentes para aplicação de dinheiro no mercado. Um valor mínimo de aplicação foi estabelecido para se qualificar a receber o presente. O valor do presente foi diretamente proporcional ao valor mínimo depositado.Vários níveis de depósitos mínimos iniciais e valores de presentes foram usados no experimento para se estabelecer a relação entre o depósito mínimo e o valor do presente, de um lado, e o número de contas abertas nas filiais , de outro. Foram usados seis níveis de depósitos iniciais e os valores dos presentes, com duas filiais atribuídas aleatoriamente para cada nível. Uma filial foi eliminada do estudo. Os resultados foram: Repetições i=1 i=2 Média Y j Número de novas contas abertas nas filiais (Y) Tamanho mínimo de depósitos j=1 j=2 j=3 j=4 j=5 X1=75 X2=100 X3=125 X4=150 X5=175 28 112 160 152 156 42 136 150 124 35 124 155 152 140 j=6 X6=200 124 104 114 19 A função de regressão ajustada aos dados é dada por: Yˆ 50,7225 0,4867X Regression Summary for Dependent Variable: CONTAS R= ,50850840 R²= ,25858079 Adjusted R²= ,17620088 F(1,9)=3,1389 p<,11021 Std.Error of estimate: 40,472 St. Err. St. Err. BETA of BETA B of B Intercpt 50,72251 39,39791 DEPOSITO ,508508 ,287019 ,48670 ,27471 Obs.: O vlaor de R2 não está correto. t(9) 1,287442 1,771689 A análise de variância fica: Analysis of Variance; DV: CONTAS (deposito.sta) Sums of Mean Squares df Squares F Regress. 5141,34 1 5141,338 3,138882 Residual 14741,57 9 1637,952 Total 19882,91 p-level ,230060 ,110212 N.S. p-level ,110212 N.S. Conclusão: indica que a função de regressão linear não é adequada. 20 P re d ic te dv s .R e s id u a lS c o re s D e p e n d e n tv a ria b le :C O N T A S 6 0 4 0 Existe uma forte evidência de que o modelo de regressão linear simples não está bem ajustado aos dados. 2 0 Residuals 0 -2 0 -4 0 -6 0 -8 0 8 0 9 0 1 0 0 1 1 0 1 2 0 1 3 0 1 4 0 1 5 0 1 6 0 P re d ic te dV a lu e s Notação: Xj com j=1,2,...,c indica os níveis da variável preditora. Para o exemplo, o valor de c é 6. O número de repetições para o nível j de X é representado por nj; para o exemplo temos: n1=n2=n3 =n5=n6=2 e n4=1. Vamos representar o valor observado da variável resposta da i-ésima repetição e j-ésimo nível de X por Yij, onde i=1,2,...,nj e j=1,2,...,c. 21 Objetivo: Vamos particionar o soma de quadrados do erro em dois componentes: soma de quadrados do erro puro (modelo completo) e soma de quadrados da falta de ajuste (modelo reduzido). Vamos fazer o teste para a falta de ajuste do modelo. Modelo completo O modelo completo é dado por: Yij j ij (4) Onde j são os parâmetros, j=1,2,...,c; ij são independentes N(0,2). Como a E(ij )=0, segue-se que: E(Yij ) j Assim, o parâmetro j (j=1,2,...,c) é a resposta média quando X=Xj. O modelo completo (4) é da mesma forma que o modelo de regressão (3) no sentido que cada resposta Y é o resultado de dois componentes: a resposta média quando X=Xj e o termo do erro aleatório. A diferença entre eles é que no modelo completo (4) não existem restrições sobre as médias j, ao passo que no modelo de regressão (3) as respostas 22 médias são linearmente dependentes com X, ou seja, E(Y)= 0+1X. Demonstra-se que os estimadores de mínimos quadrados ou máxima verossimilhança de j são simplesmente as médias amostrais no j-ésimo nível: ˆ j Yj Assim o valor esperado estimado de Yij é: Eˆ (Yij ) Y j E a soma de quadrados do erro do modelo completo é dada por: SQErro(C) (Yij Y j )2 SQ Erro Puro j i A soma de quadrados do erro puro é atribuído essencialmente ao acaso (2). É entre os valores de y’s observados. Não importa qual a função de regressão é adequada. Para o exemplo temos: SQerro puro (28 35) 2 (42 35) 2 ... (104 114) 2 SQerro puro 1148 23 Os graus de liberdade associados com a soma de quadrados do erro puro é dado por: glC (n j 1) n j c n c j j Para o exemplo, temos: 11-6=5 graus de liberdade. Modelo reduzido ( modelo sob hipótese, em estudo) Devemos levar em consideração o modelo que está sob estudo, isto é, sob hipótese. Neste caso, estamos considerando um modelo de regressão linear simples, portanto, as hipóteses são: H 0 : E (Y ) 0 1 X H a : E (Y ) 0 1 X Pela hipótese nula, j no modelo completo (4) está linearmente relacionada com Xj, do seguinte modo: j 0 1 X j Dessa forma, o modelo em estudo, sob H0, é dado por: Yij 0 1 X j ij (5) 24 Este modelo é justamente o modelo de regressão linear simples (3), com os índices para reconhecer as repetições e os níveis da variável preditora. Sabemos que: Yˆij b0 b1 X j Portanto, a soma de quadrados do erro do modelo em estudo, é exatamente a soma de quadrados do erro usualmente calculado: SQErro( R) (Yij (b0 b1 X j ))2 i j 2 ˆ SQErro( R) (Yij Yij ) i j SQErro( R) SQE Da tabela da análise de variância obtemos: SQErro( R) 14.741,6 O cálculo dos graus de liberdade é dado por:n-2. No exemplo, temos: 11-2=9. 25 Teste para falta de ajuste (lack of fit) Vimos que o teste é dado por: F* SQE ( R ) SQE ( C ) gl R glC SQEglC(C ) Aqui fica: F * SQErro ( R )SQErroPuro ( n2)( nc ) SQErroPuro ( n c ) A soma de quadrados para falta de ajuste é calculada por: SQFA=SQER-SQEP (Veja gráfico adiante) Podemos escrever o teste F* como: F* SQFA (c2) F* QMFA QMEP SQEP ( n c ) 26 Rejeitamos H0 se F* > F(; (c-2),(n-c)) o modelo não está bem ajustado aos dados. ** Usar o valor p. Exercício: faça o este F* para o exemplo e conclua. SQFA 14741,6 1148 13593,6 com 6 - 2 4 gl F * 13593 , 6 4 1148 5 3398 , 4 229 , 6 14,801 F (0.01;4;5) 11,4 o m odelode regressão não está adequado. 27 Tabela da análise de variância A decomposição da soma de quadrados do erro em soma de quadrados do erro puro e falta de ajuste, segue da seguinte identidade: Yij Yˆij (Yij Y j ) (Y j Yˆij ) Desvios da regressão Erro puro Falta de ajuste A figura a seguir ilustra esta partição com o exemplo do banco comercial para a observação Y13=136, X3 =100. 28 C O N T A S = 5 0 7 , 2 3 + 4 , 8 6 7 0 *D E P O S T I O 1 6 5 Y22=136 1 5 0 Y2 124 Erro puro 1 3 5 (Y22 Y2 12) 1 2 0 Falta de ajuste CONTAS 1 0 5 (Y2 Yˆ22 24,6) Erro (Y22 Yˆ22 36,6) 9 0 7 5 Yˆ22 99,4 6 0 4 5 3 0 6 0 7 0 8 0 9 0 1 0 0 1 1 0 1 2 0 1 3 0 1 4 0 1 5 0 1 6 0 1 7 0 1 8 0 D E P O S T I O 29 Como todos os Yij, num mesmo nível Xj, tem o mesmo valor ajustado, representados por Yj (chapéu), podemos escrever a soma de quadrados para falta de ajuste como: c SQFA n j (Y j Yˆ j )2 j 1 Observe, na fórmula, que se a função de regressão linear simples está bem ajustada aos dados, então as médias das observações vão estar próximas dos valores estimados e a soma de quadrados para falta de ajuste será pequena Y j Yˆj SQFA 0 Por outro lado, se a função não está bem ajustada aos dados, a SQFA será maior. Como temos c médias na soma de quadrados para falta de ajuste e 2 graus de liberdade são perdidos para estimarmos os parâmetros 0 e 1 do modelo de regressão, o número de graus de liberdade associados a soma de quadrados é c-2. A soma de quadrados do erro puro é dada por: c nj 2 ( Y Y ) ij j j 1 i 1 30 A seguir apresentamos a tabela da ANOVA geral e para o exemplo do banco comercial. Causas de variação Regressão Erro Tabela geral da ANOVA Soma de quadrados Graus de Quadrados médios liberdade 2 1 QMR=SQR/1 SQR= (Yˆij Y ) 2 n-2 QME=SQE/(N-2) SQE= (Yij Yˆij ) Falta de ajuste SQFA= (Y j Yˆij ) 2 Erro puro SQEP= (Yij Y j ) 2 Total SQT= (Yij Y ) 2 F QMR/QME (c-2) QMFA=SQFA/(C-2) QMFA/QMEP (n-c) n-1 QMEP=SQEP/(N-C) Tabela da ANOVA para o exemplo do banco comercial Causas de Soma de quadrados Graus de Quadrados médios variação liberdade Regressão 5.141,3 1 5.141,3 Erro 14.741,6 9 1.638,0 Falta de ajuste 13.593,6 (4) 3.398,4 Erro puro 1.148,0 (5) 229,6 Total 19.882,9 10 R2=SQR/(SQTOTAL-SQEP)=5141,3/(19882,9-1148,0)=0,2744 F 3,14NS 14,80** 31 Valor p: 0 ,110158 (com 1 e 9 gl e F=3,14) Valor p: 0,005595 (com 4 e 5 gl F=14,80) Conclusão: o modelo de regressão linear simples não é adequado para os dados. Pode-se mostrar que as esperanças dos quadrados médios são dadas por: E (QMEP) 2 n j [ j ( 0 1 X j )]2 E (QMFA) c 2 2 O QMEP é um estimador não tendencioso da variância 2 , seja qual for o modelo de regressão. O valor esperado do QMFA também é 2 se a função de regressão é linear, pois j=0+1Xj, então o segundo termo é nulo. Por outro lado, se a função de regressão não é linear, j0+1Xj, e a E(QMFA) será maior do que 2 . Então: F 1 o m odelode regressão é adequado F 1 o m odelolinear simples não está bem ajustadoaos dados 32 Os termos SQE e QME não são precisos quando o modelo de regressão sob hipótese em H0 não é a função verdadeira pois a SQE e o QME refletem os efeitos da falta de ajuste e a variabilidade do termo dos erros. Continuaremos usando a mesma terminologia para que se tenha coerência e agora usar o termo erro puro para identificar a variabilidade associada apenas com o termo do erro. O teste aqui aplicado pode ser usado para testar o ajuste de outras funções de regressão. Quando aceitamos que o modelo em estudo é apropriado, na prática é usual usar o quadrado médio do erro, QME, como um estimador de 2, em preferência ao quadrado médio do erro puro, pois o QME contém mais graus de liberdade. 33 Exercício: é dada uma amostra de 12 valores Xj 1 1 1 1 Yij 2 4 3 5 Xj 2 2 4 4 Yij 8 6 9 13 Xj 5 5 5 5 Yij 11 10 16 9 Y1 3,5 Y2 7,0 Y4 11,0 Y5 11,5 Admite-se que as variáveis X e Y estão relacionadas de acordo com modelo Yij=0+1Xj+ij, onde os ij são variáveis aleatórias independentes com distribuição normal de média zero e variância 2. a) determine as estimativas dos parâmetros da regressão linear; b) faça a análise de variância e interprete o valor de F; c) verifique se há razões para rejeitar o modelo linear inicialmente proposto. d) fazer um gráfico dos valores ajustados versus resíduos. e) Calcule o coeficiente de determinação (r2) 34 Regression Summary for Dependent Variable: Y R= ,86154979 R²= ,74226804 Adjusted R²= ,71649485 F(1,10)=28,800 p<,00032 Std.Error of estimate: 2,2361 St. Err. St. Err. BETA of BETA B of B t(10) p-level Intercpt 2,000000 1,290994 1,549193 ,152378 X ,861550 ,160540 2,000000 ,372678 5,366563 ,000316 Analysis of Variance; DV: Y (dozepare.sta) Sums of Mean Squares df Squares F p-level Regress. 144,0000 1 144,0000 28,80000 ,000316 Residual 50,0000 10 5,0000 Total 194,0000 A soma de quadrados do erro do modelo completo (ou soma de quadrados do erro puro) vale: (Y ij Y j )2 (2 3,5)2 (4 3,5)2 ... (9 11,5)2 44 com12 - 4 8 gl 35 A soma de quadrados do erro do modelo reduzido (ou soma de quadrados do erro) vale: SQER 50,00 com 10 gl A soma de quadrados de falta de ajuste vale: SQFA 50 44 6 com 4 - 2 2 gl O teste F fica: F 6 2 44 8 0,55 com 2 e 8 gl valor p : 0,597303 não rejeitamoso modelolinear proposto 144,00 r 0,96 194 44 2 36 Algumas medidas para contornar problemas do modelo de regressão Usar um modelo apropriado Modelo de regressão linear simples não é adequado Usar transformações Não linearidade do modelo de regressão • Mudar o modelo E( Y ) 0 1 X 2 X 2 E( Y ) 0 1 (Exponencial) X E( Y ) 1 exp( X ) (logístico) 0 1 2 i • Usar transformação (será visto na próxima seção) Variâncias heterogêneas Usar o método de mínimos quadrados ponderados para estimar os parâmetros Usar transformação (será visto na próxima seção) 37 Erros correlacionados Usar modelos que levam em consideração a dependência entre os erros (modelos de séries temporais, modelar a matriz de covariâncias) Usar transformação (Yt ' Yt Yt 1 ) Falta de normalidade A falta de normalidade geralmente vem junto com falta de homogeneidade de variâncias. Frequentemente, a mesma transformação estabiliza a variância e aproxima para normalidade, portanto, primeiro usar uma transformação para estabilizar a variância (será visto na próxima seção). Omissão de variável preditora importante Modificar o modelo (Regressão linear múltipla) Outliers Usar procedimentos de estimação robustos (método dos mínimos quadrados reponderados iterativamente), pois os métodos de mínimos quadrados e máxima verossimilhança produzem estimativas distorcidas. 38 Transformações Transformação da variável Y ou da variável preditora X, ou de ambas, frequentemente é suficiente para tornar o modelo de regressão linear simples apropriado para os dados transformados. Transformações para não linearidade do modelo Vamos considerar algumas transformações quando a distribuição dos erros é aproximadamente normal e com variância constante. Deve-se realizar uma transformação apenas na variável X. Padrões de relação entre X e Y X ' log10 X X ' X X X X ' exp(X ) ' 2 X ' 1/ X X ' exp( X ) 39 Exemplo: Uma pesquisadora estava interessada em estudar o comportamento do pH de tomates Chronos (Y), inteiros minimamente processados, submetidos ao tratamento vácuo, durante 22 dias de estocagem (X), a uma temperatura média de 8oC e umidade relativa de 62,78%. D ia g ra m a d e d is p e rs ã o d o s d a d o s d e o t m a e t s C h ro n o s : p H (Y )e d ia s (X ) 6 0 , O diagrama de dispersão indica uma relação curvilínea. A variabilidade nos diferentes níveis de X parece constante, portanto, vamos considerar a transformação X’=1/X. 5 6 , PH 5 2 , 4 8 , 4 4 , 4 0 , -2 2 6 1 0 1 4 1 8 2 2 2 6 D A I S 40 Valores originais e os valores transformados (1/X). DIAS 1,000 1,000 1,000 8,000 8,000 8,000 15,000 15,000 15,000 22,000 22,000 22,000 1/DIAS 1,000 1,000 1,000 ,125 ,125 ,125 ,067 ,067 ,067 ,045 ,045 ,045 D a d o s ra t n s o f rm a d o s (1 X / ) 6 0 , 5 6 , 5 2 , PH 1 2 3 4 5 6 7 8 9 10 11 12 PH 5,700 5,800 5,600 4,800 4,700 4,600 4,600 4,500 4,500 4,400 4,300 4,200 4 8 , 4 4 , 4 0 , -0 1 , 0 1 , 0 3 , 0 5 , 0 7 , 0 9 , 1 1 , 1 D / A I S Os dados continuam mostrando um comportamento curvilíneo. A variabilidade nos diferentes níveis de X continua constante (pois não foi feita a transformação em Y). Exercício: usar a transformação X’=log10(X). Fazer a análise de resíduos para ver se a transformação foi efetiva. * Nota: fazer análise de resíduos para verificar a transformação mais efetiva. 41 A transformação log10 (dias) linearizou a função de regressão. A variabilidade permanece constante. Transformações para não normalidade e heterocedasticidade 42 Variâncias heterogêneas e não normalidade dos erros frequentemente aparecem juntas. Necessita-se fazer uma transformação em Y, pois a forma e a dispersão em Y precisam ser modificadas. A transformação em Y pode também eliminar o problema de não linearidade do modelo. Outras vezes uma transformação também em X é necessária para manter ou obter uma relação linear. A figura ilustra algumas formas de relacionamento onde a assimetria e as variâncias aumentam com a reposta média E(Y). Transformações sobre Y: Y' Y Nota: uma transformação em X pode ser útil ou necessário. Y ' log10 Y Fazer análise de resíduos Y ' 1/Y 43 Exemplo: objetivo: estimar o volume da árvore em pé a partir de medidas mais facilmente obtidas. Y=volume da árvore em pés cúbicos; X1=diâmetro da árvore em polegadas a 4 pés e 6 polegadas acima do solo; X2=altura da árvore em pés. ALTURA 70,000 65,000 63,000 72,000 81,000 83,000 66,000 75,000 80,000 75,000 79,000 76,000 76,000 69,000 75,000 74,000 85,000 86,000 71,000 64,000 78,000 80,000 74,000 72,000 77,000 81,000 82,000 80,000 80,000 80,000 87,000 VOLUME UM_VOLUM 10,300 ,097 10,300 ,097 10,200 ,098 16,400 ,061 18,800 ,053 19,700 ,051 15,600 ,064 18,200 ,055 22,600 ,044 19,900 ,050 24,200 ,041 21,000 ,048 21,400 ,047 21,300 ,047 19,100 ,052 22,200 ,045 33,800 ,030 27,400 ,036 25,700 ,039 24,900 ,040 34,500 ,029 31,700 ,032 36,300 ,028 38,300 ,026 42,600 ,023 55,400 ,018 55,700 ,018 58,300 ,017 51,500 ,019 51,000 ,020 77,000 ,013 Observamos maior variabilidade para valores maiores de altura. A relação entre volume e altura é linear. 44 Transformação: valores inverso de Y (1/Y). D ia g ra m a d e d is p e rs ã o a : u lt ra v e rs u s 1 v / o lu m e 0 1 , 2 Note que a transformação tornou a variância razoavelmente constante para os diferentes níveis de X. 0 1 , 0 0 0 , 8 1/volume(transformação) 0 0 , 6 0 0 , 4 0 0 , 2 0 0 , 0 6 0 6 6 7 2 7 8 8 4 9 0 A u lt ra d a s á rv o re s O modelo de regressão linear simples ajustado aos dados com a transformação Y’=1/Y é dado por: Yˆ ' 0,22386 0,002377X Exercício: fazer o gráfico normal de probabilidades dos resíduos. Interpretar. 45 R a w re s id u a ls v s A . L T U R A 0 0 , 5 0 0 , 4 Indica que o modelo é apropriado para os dados transformados 0 0 , 3 0 0 , 2 Rawresiduals 0 0 , 1 0 0 , 0 Se desejamos estimar os valores de Y, na unidade original, fazemos: -0 0 , 1 -0 0 , 2 -0 0 , 3 -0 0 , 4 6 0 Yˆ 6 6 7 2 7 8 8 4 9 0 1 0,22386 0,002377X A L T U R A Transformação Box-Cox A transformação Box-Cox automaticamente identifica uma transformação a partir de uma família de transformações potência de Y. A família de transformações potência é dada por: Y' Y Onde é um parâmetro a ser determinado a partir dos dados da amostra. Esta família inclui, por exemplo, ' 2 ' 2 Y Y 0,5 Y Y 0,5 Y ' 0 Y ' loge Y (por definição) 1 Y -1,0 Y ' Y1 46 O modelo de regressão com erros normais com a variável resposta pertencente a família de transformação potência fica: Yi 0 1 X i i O procedimento Box-Cox usa o método de máxima verossimilhança para estimar , 0, 1e 2. A função de verossimilhança é dada por: n L( 0 , 1, 2 , ) ( 212 )n / 2 exp 212 (Yi 0 1 X i )2 i 1 Desta forma, o procedimento de Box-Cox encontra a estimativa de máxima verossimilhança de para usar na transformação potência. 47 Procedimento (simples) para obter uma estimativa de Vamos usar a análise de regressão padrão do modelo de regressão linear simples Vamos fazer uma busca numérica (menor SQE) para uma faixa de valores de lambda, por exemplo: 2 -1 -0,5 0 0,5 1 2 Para cada valor de , as observações Yi são padronizadas do seguinte modo: K1 (Yi 1) Wi K 2 (loge Yi ) 0 0 1/ n n K 2 Yi i 1 K1 K1 1 2 Faz-se a regressão das observações Wi sobre X e obtêm-se as SQE.. Pode-se mostrar que a estimativa de máxima verossimilhança de é o valor de para a qual a SQE é mínima. 48 Exemplo: continuamos com o exemplo das árvores (X=altura e Y=volume). Vamos tomar os seguintes valores para lambda 1 -0,3 0,2 -0,1 0 0,1 0,2 0,3 1 K2 K1 SQE 1,00 -0,30 26,3833 -696,0792 4201,9 26,3833 -34,0792 3324,5 0,2 26,3833 -253,8430 3310,3 0,10 26,3833 -365,9841 3319,8 0,00 0,10 0,20 0,30 1,00 26,3833 26,3833 190,1938 3409,7 26,3833 68,5541 3490,5 26,3833 32,9465 3596,3 26,3833 1 5204,9 3352,9 Observe na tabela acima que a transformação Box-Cox indica próximo de -0,20. Entretanto, a SQE é aproximadamente estável na faixa de -0,30 a 0,00, portanto, vamos usar a transformação logarítmica por ser a preferida dos pesquisadores (é uma transformação que os pesquisadores entendem melhor). A transformação Box-Cox dá um direção no sentido da escolha da melhor transformação. Observe que a transformação usada anteriormente, 1/Y, não foi razoável de acordo com transformação de Box-Cox. (compare os dois gráficos de resíduos). Quando a transformação Box-Cox produz um próximo de 1, não é necessário transformar os dados. 49 R a w re s id u a ls v s A . L T U R A 0 8 , 0 6 , 0 4 , Indica a adequação do modelo de regressão para os dados transformados (transformação logarítmica) 0 2 , Rawresiduals 0 0 , -0 2 , -0 4 , -0 6 , -0 8 , 6 0 6 6 7 2 7 8 8 4 9 0 A u lt ra 50 Estudo da forma da função de regressão Método Loess (Locally weighted regression scatterplot smoothing) É um método não paramétrico de ajuste de curvas. Fornece uma curva alisada (suavizada) através do ajuste de várias funções de regressão linear em pontos vizinhos. É indicada em casos de difícil decisão sobre a aplicação de uma curva paramétrica. Também em presença de valores discrepantes. ** Fazer lista de exercícios número 3. 51 Este gráfico foi feito no SAS (Interactive Data Analysis), arquivo: sasuser.custdet1. I N C O M E 20 40 AGE 60 52

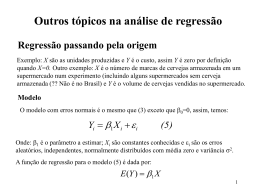

Baixar