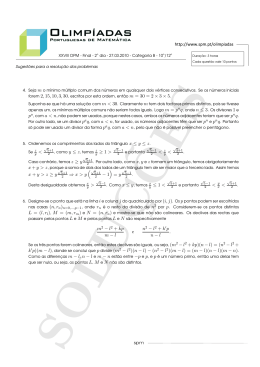

Introdução À Álgebra Linear Cristian Patricio Novoa Bustos Departamento de Matemática e Fı́sica Pontifı́cia Universidade Católica de Goiás Goiânia-2012 Sumário Prefácio 1 Vetores 1.1 Vetores . . . . . . 1.2 Álgebra Vetorial . 1.2.1 Exercı́cios 1.3 Produto Escalar e 1.3.1 Exercı́cios 1 . . . . . . . . . . . . . . . Vetorial . . . . . 2 Matrizes 2.1 Matrizes . . . . . . . . . . 2.1.1 Exercı́cios . . . . . 2.2 Adição de Matrizes . . . . 2.3 Multiplicação por Escalar 2.3.1 Exercı́cios . . . . . 2.4 Multiplicação de Matrizes 2.4.1 Exercı́cios . . . . . 2.5 Inversão de Matrizes . . . 2.5.1 Exercı́cios . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 3 Sistemas de Equações e Inversão 3.1 Forma Reduzida de Matrizes . . 3.1.1 Exercı́cios . . . . . . . . 3.2 Inversão de Matrizes . . . . . . 3.2.1 Exercı́cios . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . de . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12 12 14 14 17 18 19 27 29 35 Matrizes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 37 37 45 46 52 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 54 54 57 57 61 63 65 66 . . . . . . . . . 4 Espaços Vetoriais 4.1 Espaços Vetoriais . . . . . . . . . . . 4.1.1 Exercı́cios . . . . . . . . . . . 4.2 Subespaços Vetoriais . . . . . . . . . 4.2.1 Exercı́cios . . . . . . . . . . . 4.3 Dependência e Independência Linear 4.3.1 Exercı́cios . . . . . . . . . . . 4.4 Base e Dimensão . . . . . . . . . . . i . . . . . 3 3 4 9 9 11 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 4.4.1 Exercı́cios . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73 5 Transformações Lineares e Cônicas 5.1 Transformações Lineares . . . . . . . . . . . . 5.1.1 Exercı́cios . . . . . . . . . . . . . . . . 5.2 Núcleo e Imagem de Transformações Lineares 5.2.1 Exercı́cios . . . . . . . . . . . . . . . . 5.3 Representação de Transformações Lineares por 5.3.1 Ecercı́cios . . . . . . . . . . . . . . . . 5.4 Autovalor, Autovetor e Diagonalização . . . . 5.4.1 Exercı́cios . . . . . . . . . . . . . . . . 5.5 Reconhecimento de Cônicas . . . . . . . . . . 5.5.1 Exercı́cios . . . . . . . . . . . . . . . . A Introdução à Estruturas Algébricas A.1 Conjuntos . . . . . . . . . . . . . . A.1.1 Exercı́cios . . . . . . . . . . A.2 Naturais, Inteiros e Racionais . . . A.2.1 Exercı́cios . . . . . . . . . . A.3 Reais e Complexos . . . . . . . . . A.3.1 Exercı́cios . . . . . . . . . . Referências Bibliográficas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . Matrizes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 75 75 77 79 84 86 88 89 96 97 102 . . . . . . . . . . . . . . . . . . . . . . . . . . 103 . 103 . 109 . 110 . 115 . 116 . 118 119 ii Prefácio Caros leitores, gostaria de enfatizar que este texto não tem a intenção de substituir outros textos de Álgebra Linear, ao contrário, visto que este trabalho vem a contribuir e complementar alguns textos já existentes. Na verdade, o desenvolvimento de este texto é o fruto do trabalho desenvolvido junto das turmas de Engenharia da Pontifı́cia Universidade Católica de Goiás, na disciplina de Álgebra Linear, onde foi detectada a necessidade de ter um texto não muito extenso, mas que desse um bom suporte para esta disciplina de quatro créditos, por isto é que o nosso enfoque é meramente introdutório, deixando alguns conteúdos de lado, como conceitos de espaços com produto interno e determinantes entre outros. Também procuramos de colocar listas de exercı́cios muito extensas, mas sem deixar de abranger todo o conteúdo, procurando sempre introduzir novos conceitos com a intenção de desenvolver um raciocı́nio lógico abstrato. Uma das grandes dificuldades observadas no decorrer do tempo ministrando esta disciplina é o desconhecimento de algumas estruturas algébricas por parte dos alunos, e como elas aparecem, como por exemplo a construção dos Corpos Numéricos, em particular os Reais e Complexos. Existem muitas construções destas estruturas algébricas, mas usamos a teoria de Conjuntos e relações de equivalência para fazer isto. Estas idéias são dadas no nosso primeiro capı́tulo, que pode ser omitido dependendo do grau de familiaridade que o nosso leitor pode ter com os conceitos básicos de estruturas algébricas. Já no segundo Capı́tulo, trabalhamos o conceito de matriz e exploramos suas propriedades operatórias, com a finalidade de caracterizar a inversão de matrizes. Como uma aplicação, vemos no capı́tulo três como trabalhar a inversão de matrizes via operações elementares. Agora, no Capı́tulo quatro trabalhamos o conceito de Espaço Vetorial e enfocamos o nosso trabalho para Espaços Vetoriais de dimensão finita, tentando mostrar alguns exemplos conhecidos pelo aluno a partir dos cursos de Cálculo e, em particular o Espaço Vetorial formado pelas matrizes, estudado no Capı́tulo dois. Particularmente, são explorados os conceitos de base e dimensão e a relação entre estes conceitos. No capı́tulo cinco, fazemos uma analogia com funções dos cursos de Cálculo e introduzimos o conceito de Transformação Linear entre Espaços Vetoriais. Um dos objetivos fundamentais deste Capı́tulo é dado pelo fato de que, se consideramos transformações Lineares entre Espaços Vetoriais de dimensão finita, então existe uma correspôndencia biunı́voca com matrizes, isto é, Matrizes e transformações Lineares entre espaços Vetoriais de dimensão finita ”são a mesma coisa”. Desta forma, todo o trabalho feito com matrizes 1 2 nos Capı́tulos dois e três pode ser transportado para Transformações Lineares. Como, no capı́tulo dois estabelecemos uma partição no conjunto das Matrizes, via a relação de semelhança, esta relação é melhorada neste Capı́tulo via o Cálculo de autovalores e de diagonalização de matrizes. Para fechar este Capı́tulo e trabalho, damos uma pequena aplicação de Diagonalização de matrizes no reconhecimento de Cônicas tão conhecidas e estudadas no curso de Geometria Analı́tica. Gostaria de deixar registrado o meu agradecimento aos vários alunos dos nossos cursos de Engenharia da Pontifı́cia Universidade Católica de Goiás, que leram versões preliminares deste texto e me apontaram as falhas, para desta forma contribuir com a melhoria deste. Em particular, gostaria de agradecer a professora, Elisangela Silva Dias, do Instituto de Informática da Universidade Federal de Goiás pela paciência nas correções. Crı́ticas, sugestões e informações sobre eventuais erros ou enganos, serão muito bem recebidos. Cristian Patricio Novoa Bustos [email protected] Capı́tulo 1 Vetores Este capı́tulo tem por finalidade recordar alguns conceitos vistos em outras disciplinas, como geometria analı́tica, cálculo etc., então não aprofundaremos muito os conceitos com enunciados e demostrações de propriedades destas estruturas, mas queremos reforçar algumas propriedades mais importantes para o futuro desenvolvimento dos conteúdos deste texto. 1.1 Vetores O conceito de vetor tem sido a base para estudar fı́sica e geometria, entre outras disciplinas, no segundo grau. Em particular, na disciplina de geometria analı́tica, este conceito esta associado a um sistema de coordenadas, mas para trabalhar este conceito, na verdade não é necessário, como veremos a seguir. Definição 1.1.1 Chamaremos de Vetor a magnitude que é determinada pelo seu módulo, direção e sentido. Esta noção é tão familiar, que basta olhar ao redor que vemos muitos exemplos de vetores, como é o deslocamento, a velocidade, aceleração ou a força aplicada em um determinado corpo, etc. Geometricamente, podemos representar um vetor pelo segmento orientado OP , e o tamanho do vetor OP é dito o módulo do vetor, e a direção do segmento denota a direção do vetor OP . O ponto O é dito a origem do vetor OP ou ponto de aplicação, e P é o extremo do vetor OP . P OP O Como notação, representaremos um vetor com uma letra minúscula com uma seta → acima. No exemplo anterior então temos OP = − v , e o seu módulo que o denotaremos − → −→ ← − por | v |. Também podemos usar a notação OP para o vetor, e para o seu módulo | OP |. 3 4 CAPÍTULO 1. VETORES Exemplo 1.1.1 Representemos geometricamente as seguintes situações: 1. Uma força de 10 newtons na direção Leste 30o Norte, como na figura (a) abaixo. N N 15N 10N 30o ⌢ )30o O S L O L Fig. (a) S Fig. (b) 2. Uma força de 15 newtons na direção Norte 30o Leste, como na figura acima. Chamaremos de escalar a magnitude que é determinada pelo seu valor numérico, que é a quantidade com relação a uma unidade de medida do mesmo tipo. Como exemplos de magnitudes escalares podemos citar, comprimento, massa, tempo, temperatura, trabalho etc., e qualquer número Racional Q, Real R, ou Complexo C. De agora em diante, denotaremos por K o conjunto dos escalares. 1.2 Álgebra Vetorial Nesta seção mostraremos a estrutura algébrica que possui o conjunto de vetores, definido na seção anterior, definindo uma operação interna, que chamaremos de soma e uma operação externa que chamaremos de produto por escalar, tentando estender as operações realizadas para o conjunto dos escalares K. → → − − Definição 1.2.1 Sejam − u e− v dois vetores. Diremos que os vetores → u e→ v são equipolentes se eles tem o mesmo módulo, a mesma direção e sentido. Geometricamente temos: P − → u Q − → v O R − → → − Se dois vetores u e v são equipolentes com a mesma origem, então diremos que os → → → → vetores − u e− v são iguais, que denotaremos por − u =− v. 5 CAPÍTULO 1. VETORES → → Definição 1.2.2 Seja − u um vetor. Chamaremos de vetor oposto ao vetor − u , que deno→ − taremos por − u , o vetor que tem o mesmo módulo e direção, mas sentido oposto. Geometricamente, temos a seguinte figura: P P → −− u − → u 0 O Agora estamos em condições de definir formalmente uma lei de eperação interna entre vetores, da seguinte forma. → → → Definição 1.2.3 Sejam − u e − v dois vetores. Chamaremos de soma dos vetores − u e → − → − → − v , ao vetor w que se obtem trasladando a origem do vetor v ao extremo do vetor → − → → u e juntando a origem do vetor − u com o extremo do vetor − v , que denotaremos por → − → − → − w = u + v. → → Veja que trasladando os dois vetores − u e − v a um origem comum, o vetor soma corresponde à diagonal do paralelograma com origem comum (veja a figura abaixo). − → u − → v − → u − → v − → → u +− v → → → Para, a soma de − u +− v +− w , primeiro fazemos a soma de dois vetores, e o vetor resultante soma com o terceiro vetor, desta forma podemos estender para qualquer soma → →. finita de vetores − u1 + ... + − u n Exemplo 1.2.1 Vamos usar a soma de vetores e as suas propriedades para provar um resultado conhecido de geometria plana. Seja um triâgulo ABC e sejam M e N os pontos médios dos segmentos AC e BC, respectivamente. Vamos provar que o segmento MN é paralelo ao segmento AB e tem comprimento igual a metade do comprimento do segmento AB. Então devemos provar que : −−→ 1 −→ |MN | = |AB| 2 : 6 CAPÍTULO 1. VETORES C M N A B Agora, a partir da figura acima temos que −−→ −−→ −−→ MN = MC + CN Agora, como M é o ponto médio do segmento AC e N é o ponto médio do segmento BC, então −−→ 1 −→ MC = AC 2 e −−→ 1 −−→ CN = CB 2 Logo, −−→ 1 −→ 1 −−→ 1 −→ −−→ 1 −→ MN = AC + CB = (AC + CB) = AB 2 2 2 2 − − Definição 1.2.4 Chamaremos de diferença dos vetores → u e → v , que denotaremos por → − → − → − → − − → → − u − v , o vetor w tal que w + v = u . → → − → No caso em que os vetores sejam iguais − u =− v , o vetor diferença → u −− v é chamado → − de vetor nulo, que representaremos por 0 . → Definição 1.2.5 Sejam − u um vetor e λ um escalar. Chamaremos de produto por → − → → escalar λ do vetor u ao vetor − w = λ− u , que tem a mesma direção, e | λ | vezes o → → módulo do vetor − u com sentido igual ou oposto ao do vetor − u , dependendo do valor de → − → − | λ | ser negativo ou positivo, e se λ = 0 então temos que λ u = 0 é o vetor nulo. As propriedades que enunciaremos a seguir podem ser encontradas em qualquer curso de cálculo, onde estes vetores podem ser vistos como pares ordenados, ou triplas ordenadas ou em forma de n-uplas ordenadas em geral. 7 CAPÍTULO 1. VETORES − → − Proposição 1.2.1 Sejam → u,− v e→ w vetores e α, β escalares. Então são válidas: − → → → • → u +− v =− v +− u − → → → → → • → u + (− v +− w ) = (− u +− v)+− w → → • α− u =− uα → → • α(β − u ) = (αβ)− u → → → • (α + β)− u = α− u + β− u → → → → • α(− u +− v ) = α− u + α− v Um dos objetivos deste texto é estudar, entender e nos familiarizar um pouco mais com os conjuntos que admitem as propriedades da proposição anterior, como veremos nos capı́tulos 4 e 5. → − Definição 1.2.6 Seja − v um vetor. Diremos que o vetor → v é unitário se o seu módulo → − | v | é uma unidade escalar. − → → v Veja que se | − v |6= 0, então o vetor |− é um vetor unitário no mesmo sentido e direção → v| → − que o vetor v . Um sistema muito importante e conhecido, é o sistema dado pelos vetores unitários associados aos eixos coordenados do sistema cartesiano do espaço, por exemplo, cujos eixos são geralmente identificados com X, Y e Z, com sentidos positivos destes eixos, → → − − → − e são denotados por i , j e k , respectivamente, como mostra a figura abaixo. Z − → k − → j Y − → i X Fig. (a) → → Todo vetor − v pode ser representado pelo produto de um vetor unitário − u na direção e − → → − → − → v − 3 sentido do vetor v , isto é, v = |− | v |. Todo vetor do espaço R pode ser representado → v| com a sua origem a origem do espaço R3 . Sejam (x, y, z) as coordenadas cartesianas do → → − − → − → ponto extremo do vetor − v cuja origem é 0. Os vetores x i , y j , z k são conhecidas como 8 CAPÍTULO 1. VETORES → as componentes retangulares do vetor − v nas direções x, y, z, respectivamente. Veja que → − → − → − → a soma dos três vetores, x i + y j + z k é novamente o vetor original − v isto é, → − → − → − − → v =x i +y j +zk onde o módulo é dado por: → |− v|= p x2 + y 2 + z 2 Se a cada ponto (x, y, z) de uma determinada região R do espaço R3 associamos um escalar dado pela função f (x, y, z), temos definido o que se conhece como campo escalar, onde a função f (x, y, z) tambem é conhecida como função escalar de posição. Vejamos os seguintes exemplos. Exemplo 1.2.2 1. Para cada posição de um carro, hoje em dia usamos o famoso GPS para fazer isto, podemos associar a temperatura do motor em um determinado instante. Então esta função de associar a temperatura pode ser vista como um campo escalar. 2. A função f (x, y, z) = x2 + y 2 + z 2 determina um campo escalar. Um outro campo muito conhecido é o campo vetorial, onde em cada ponto (x, y, z) de uma determinada região R do espaço R3 associamos um vetor dado pela função → − → f (x, y, z) = − v , esta função tambem é conhecida como função vetorial ou de posição vetorial. Exemplo 1.2.3 1. Para cada carro, determinamos a sua posição, hoje em dia usamos o famoso GPS para fazer isto, que é vetorial, e podemos associar a sua velocidade em um determinado instante, que tambem é vetorial. Então esta função de associar a velocidade a cada carro pode ser vista como um campo vetorial. → − → − → − → − 2. A função f (x, y, z) = x2 y i + y 2 z 2 j + xz k determina um campo vetorial. 9 CAPÍTULO 1. VETORES 1.2.1 Exercı́cios 1. Das grandezas a seguir, indique quais são escalar e quais são vetoriais. (a)P eso (c)Densidade (e)Energia (g)velocidade (b)Calor (d)Impetu (f )P otencia (h)distância 2. Um automóvel percorre 3Km na direção Norte e logo 5Km na direção Nordeste. Represente geometricamente o deslocamento e calcule o vetor resultante. 3. Considere os seguintes deslocamentos: − • → u = 10m na direção Nordeste. → • − v = 20m , na direção Leste. → • − w = 35m na direção Sul. → → − → − → → Então calcule − u +− v ;→ u −− w ;→ v +− v −− w e faça a sua representação geométrica. − → − → → → 4. Sejam → u ,− v vetores. Mostre que → u +− v =− v +− u. → − − 5. Calcule o vetor unitário com direção e sentido da resultante dos vetores → u =2i − → → − → − → − → − → − 5 j + 9 k ;− v =6 i +2j −7k → → → 6. Sobre um solido atuam três forças − u,− v e− w que, em função das suas componentes, → → − → − → − → − → − → − → − estão dadas pelas equações vetoriais u = u1 i +u2 j +u3 k ; − v = v1 i +v2 j +v3 k → − → − → − → e− w = w1 i + w2 j + w3 k . Calcule o módulo da força resultante. → − → − → − → 7. Determine os angulos α, β e γ que o vetor − v = x i + y j + z k forma com os eixos positivos do sistema de coordenadas de R3 . e mostre que cos2 α + cos2 β + cos2 γ = 1 8. Considere o campo escalar dado por f (x, y, z) = 3x2 z − xy + z 2 , calcule o valor do campo escalr f nos pontos (2, −3, 6); (−2, 4, 9); (6, −9, −3). → − − → → − 9. Represente Geometricamente o campo vetorial dado por f (x, y, z) = x i − y j + → − zk. 1.3 Produto Escalar e Vetorial Na seção anterior mostramos como podemos obter novos vetores a partir de vetores, e como podemos gerar outros vetores a partir da multiplicação por escalar. Então agora mostraremos como a partir de dois vetores podemos associar um escalar, mostrando algumas propriedades. 10 CAPÍTULO 1. VETORES → → Definição 1.3.1 Seja − u e − v dois vetores. Chamaremos de produto escalar ou in→ − → − terno dos vetores u e v , ao seguinte escalar: → → 0, se − u ou − v é o vetor nulo; → − → − u · v = → − → − | u | · | v | cos θ, Caso contrário. onde θ é o ângulo formado pelos dois vetores. Quando os vetores são dados em termos das suas componentes não sabemos diretamente o ângulo entre eles. Por isso, precisamos de uma forma de calcular o produto escalar que não necessite do ângulo entre os vetores. → → Sejam − u e− v dois vetores não nulos e θ o ângulo entre eles, então pela lei dos cossenos, temos a seguinte expressão: → → → → → → |− u −− v |2 = |− u |2 + |− v |2 − 2|− u ||− v |cosθ Assim, 1 − 2 → → → − → → → → u | + |− v |2 − |− u −− v |2 ) u ·− v = |− u ||− v |cosθ = (|→ 2 Já temos então uma fórmula para calcular o produto escalar que não depende diretamente do ângulo entre eles. Substituindo-se as coordenadas dos vetores na identidade acima, temos uma expressão mais simples para o cálculo do produto interno. Por exem→ → plo, se− u = (u1 , u2 , u3) e − v = (v1 , v2 , v3 ) são vetores no espaço, então substituindo-se → − → − → → 2 2 2 2 2 | u | = u1 + u2 + u3 , | v | = v12 + v22 + v32 e |− u −− v |2 = (u1 − v1 )2 + (u2 − v2 )2 + (u3 − v3 )2 2 2 na igualdade anterior, os termos ui e vi são cancelados e obtemos a seguinte expressão − → → u ·− v = u1 v1 + u2 v2 + u3 v3 Vejamos algumas propriedades na seguinte proposição. − → − Proposição 1.3.1 Sejam → u,− v e→ w vetores e α um escalar. Então são válidas: − → → → 1. → u ·− v =− v ·− u − → → → → → → 2. → u · (− v +− w) = − u ·− v +− u ·− w → → → → 3. α(− u ·− v ) = (α− u)·− v − → → u e− v dois vetores. Chamaremos de produto vetorial, ou pro→ − − → → → → u e v ao vetor − c =− u ×− v dado por: − → − → → − → − → − → − i j k i j k → − → → c =− u ×− v = det u1 u2 u3 = u1 u2 u3 v v v v1 v2 v3 1 2 3 Definição 1.3.2 Sejam duto externo dos vetores Algumas propriedades do produto vetorial são dadas na seguinte proposição. CAPÍTULO 1. VETORES 11 − → − Proposição 1.3.2 Sejam → u,− v e→ w vetores e α um escalar. Então são válidas: − → → → 1. → u ×− v = −− v ×− u − → → → → → → 2. → u × (− v +− w) = − u ×− v +− u ×− w → → → → → → → → 3. α(− u ×− v ) = (α− u)×− v =− u × (α− v ) = (− u ×− v )α → − → → → → − − − → − − → − → − → − − − → → − − − → → → − → 4. i × i = j × j = k × k = 0, i × j = k , j × k = i , k × i = i − → − → 5. O módulo do vetor → u ×− v representa a área do paralelogramo de lados → u e− v. → → 6. Se − u ×− v = 0 onde nenhum dos vetores é nulo, então os dois vetores tem a mesma direção. 1.3.1 Exercı́cios → → → − → − → − − → − → − − 1. Ache o ângulo formado pelos vetores → u =2 i +3j − k e − v =6 i +3j +2k. → → → → − → − − → − − → − → 2. Ache o valor de α de forma que os vetores − u = 2 i +α j + k e − v = 4 i −2 j − k sejam ortogonais. → → → − → − → − − → − → − → 3. Mostre que os seguinte vetores − u = 3i −2j + k ; − v = i − 3j + 5k e → − → − − → → − w = 2 i + j − 4 k formam um triângulo. 4. Mostre a proposição 1.3.2. → − → − → − → − − → − → − → 5. Sejam − u =2 i −3j − k e → v = 1 i + 3 j + 6 k calcule − → a → u ×− v → → b − v ×− u − → → → c (→ u +− v ) × (− u −− v) 6. Calcule a área do triângulo de vértices P (1, 3, 2), Q(2, −1, 1), R(1, 2, 3). → − 7. Calcule o momento de uma força F com relação a um ponto P . Capı́tulo 2 Matrizes 2.1 Matrizes A partir de agora, e no decorrer do texto, usaremos a letra K, para denotar o corpo dos escalares, que pode ser Q (Racionais), R (Reais) ou C (Complexos). Neste capı́tulo, introduziremos o conceito de Matriz, que é um dos conceitos matemáticos mais usados por parte da área de economia e administração entre outros como um recurso na agrupação de um grande número de informações, e claro, é uma das ferramentas básicas na pesquisa operacional. Definição 2.1.1 Chamaremos de Matriz1 de ordem n×m à ordenação de n vezes m escalares em n linhas e m colunas, que denotaremos da seguinte forma: a11 a12 · · · a1m a21 a22 · · · a2m A= · · · · · · · · · · · · = (aij )n,m an1 an2 · · · anm onde aij denota o escalar na linha i e coluna j para i = 1, . . . , n , j = 1, . . . , m Se todas as entradas da matriz A = (aij )n,m são nulas, a matriz A é dita de matriz nula ou matriz zero, que denotaremos por 0n,m . Se o número de linhas é igual ao número de colunas da matriz A = (aij )n,m , ou n = m, então diremos que a matriz A é uma matriz quadrada e a denotaremos por A = (aij )n . Chamaremos de diagonal principal da matriz quadrada A = (aij )n , os escalares da forma aii onde i = 1, . . . , n. Diremos que a matriz quadrada A = (aij )n é diagonal, se todos os elementos acima e abaixo da diagonal principal são zero. Chamaremos de matriz identidade, que denotaremos por In , a matriz diagonal de ordem n onde todos os elementos da diagonal principal são iguais a 1, então In pode ser vista da seguinte forma: 1 se i = j In = (cij ) = 0 se i 6= j 1 O matemático Ingles Arthur Cayley(1821-1895), foi o primeiro a introduzir o conceito de matriz e mostrar as suas propriedades algébricas, ele publicou mais de 300 artigos de investigação 12 13 CAPÍTULO 2. MATRIZES Denotaremos por Mn,m o conjunto de todas as matrizes de n linhas e m colunas, simbolicamente temos: Mn,m (K) = Mn,m = {A = (ai,j )n,m /ai,j ∈ K, ∀i = 1, · · · , n; j = 1, · · · , m} Exemplo 2.1.1 Vejamos agora alguns exemplos da definição anterior. 1. Um dos exemplos mais simples de ordenação matricial, é observar a ordenação das cadeiras na sala de aula, ou das poltronas em um cinema, que sempre são dados em linhas e colunas. 2. Os escalares de forma geral podem ser vistos como matrizes de ordem 1 × 1. 3. Uma linha de uma matriz A = (aij )n,m , digamos Ai = (ai1 · · · aij · · · aim ) pode ser considerada como uma matriz de ordem 1×m, de maneira análoga podemosdefinira a1j .. matriz coluna dada por uma coluna da matriz A = (aij )n como sendo Aj = . . anj 4. Consideremos o seguinte diagrama: 1 3 2 4 A forma matricial deste diagrama é 0 1 A= 0 1 dado por : 1 0 1 0 1 1 = (aij )n,m 1 0 0 1 0 0 Onde aij = 1 se o ponto i está ligado ao ponto j, e aij = 0, se o ponto i não está ligado ao ponto j. Esta matriz é conhecida como matriz de incidência. 5. Considere o plano projetivo de Fano, de ordem dois e construa a sua matriz de incidência. Definição 2.1.2 Diremos que duas matrizes da mesma ordem A = (aij )m,n (bij )m,n são iguais se aij = bij ∀i, j. e B = 14 CAPÍTULO 2. MATRIZES 2.1.1 Exercı́cios 1. Escreva a matriz A = (aij )2,3 tal que aij = ij + 2i − j. 2. (a) Escreva a matriz A = (aij )4,4 , tal que : aij = −1 se i > j A= aij = 1 se i ≤ j (b) Escreva a matriz A = (aij )3,3 tal que aij = −aji 3. Ache os possı́veis valores de x e de y, tais que : (a) (b) 2 2 0 x2 − 2 = y x 0 0 1 0 x y = 0 1 x2 y 2 P 4. Seja A = (aij )n e definamos tr(A) = ni=1 aii que é conhecida como traço da matriz A, então mostre que tr(tr(A)) = tr(A). 5. Suponha que existe uma relação de dominância entre quatro terminais, dada pelo seguinte diagrama: 1 3 2 4 onde cada seta indica a dominância do ponto i sobre o ponto j. Passe para linguagem matricial este diagrama (supondo que nenhum ponto domine ele mesmo). 2.2 Adição de Matrizes Recordemos que tanto a adição como a subtração entre os números é uma função, ou também conhecida como operação binária ou interna, onde são relacionados dois elementos do mesmo conjunto e, após esta relação ou mistura entre eles, obtemos um novo elemento do mesmo conjunto. Será que o relacionamento entre animais da mesma espécie satisfaz esta condição?. Será que com as matrizes isto é válido?. Então vejamos a seguinte definição. CAPÍTULO 2. MATRIZES 15 Definição 2.2.1 Sejam A, B ∈ Mn,m. Então a operação binária ou interna + : Mn,m × Mn,m −→ Mn,m dada por : A + B = (aij )n,m + (bij )n,m = (aij + bij )n,m será chamada de soma de matrizes. Veja que se as matrizes forem de 1 × 1, a definição anterior nos da à definição usual de soma de escalares, ou se forem matrizes de 1 × n a definição anterior nos da à definição usual de soma de n-uplas ou soma vetorial componente a componente. Vejamos agora alguns exemplos. Exemplo 2.2.1 Consideremos os seguintes exemplos dos conceitos anteriores. 1. Considere as seguintes matrizes: √ −3 π 2 −6 −1 8 −5 √ A= , B= eC= 5 −6 −2 2π 9 2 3 Observe que A + B está bem definida, mas A + C não, pois a matriz A tem ordem 2 × 2 e a matriz C tem ordem 2 × 3, isto é, a matrı́z A,e a matrı́z B não tem a mesma ordem. 2. A matriz nula 0n,m tem a propriedade de que se A ∈ Mn,m então é fácil verificar, a partir da definição que, A + 0n,m = 0n,m + A = A 3. Uma certa empresa de Computação produz um software X. Agora, para produzir este software foram necessários seis técnicos, três (um digitador, um programador e um analista de sistemas) de uma localidade A e os outros três (digitador, programador e analista) de uma localidade B. As despesas feitas pela empresa na manutenção e transporte dos técnicos pode ser vista matricialmente por : Manut. T rans. Cargo 100 150 Dig. A= 800 400 P rog. 900 850 Anal. Manut. T rans. Cargo 80 50 Dig. B= 600 400 P rog. 1000 650 Anal. A matriz que representa a despesa total com alimentação e transporte de cada um dos técnicos vindo de ambas localidades é dada por : Manut. T rans. Cargo 180 200 Dig. A+B = 1400 800 P rog. 1900 1500 Anal. 16 CAPÍTULO 2. MATRIZES Exemplo 2.2.2 Uma Universidade, pretende utilizar o perı́odo de recesso das férias para fazer a instalação de ar condicionado central nos blocos D, EeF do centreo de Ciências Exatas. Então, faz uma licitação para a realização desta obra, e pede que seja discriminado o custo por bloco, pois pode pegar a obra por bloco, e seleciona três propostas, que denotaremos por Emp.1, Emp.2 e Emp.3, como discriminada abaixo(os valores são relativos a R$1.000, 00 reais) : Bl D Emp.1 53 Emp.2 47 Emp.3 60 Bl E 96 87 92 Bl F 37 41 36 Então, a Universidade está interessada na proposta de menor custo e cada empressa só pode pegar um bloco para fazer. Como calcular a melhor proposta. Na verdade temos 3! = 3 × 2 × 1 possibilidades. Então as propostas podem ser vistas de maneira matricial como segue : 53 96 37 47 87 41 60 92 36 Então estas 53 |{z} 47 (a) 60 53 47 (d) |{z} 60 seis propostas são dadas por : 53 96 37 53 96 37 96 37 |{z} |{z} 47 47 87 41 41 87 41 (b) (c) |{z} 87 |{z} |{z} 60 92 |{z} 36 60 |{z} 92 36 92 |{z} 36 96 |{z} 37 53 |{z} 96 37 53 96 |{z} 37 87 |{z} 41 87 41 87 41 (e) 47 (f) 47 |{z} 92 36 60 92 36 60 92 36 |{z} |{z} |{z} Onde a proposta (a) = 53 + 87 + 36 = 176 a proposta (b) = 53 + 92 + 41 = 186 a proposta (c) = 47 + 96 + 36 = 179 a proposta (d) = 47 + 92 + 37 = 176 a proposta (e) = 60+96+41 = 197 e finalmente a proposta (f) = 60+87 = 37 = 184. Mostrando que a proposta (a) e (d) são as melhores. Claramente o método anterior é muito ”primitivo”e, em programação Linear poderão estudar métodos mais eficientes. Proposição 2.2.1 Sejam A, B e C ∈ Mn,m , então é válido que : i) Associatividade (A + B) + C = A + (B + C) ii) Neutro ∃0n,m ∈ Mn,m tal que A + 0n,m = 0n,m + A = A iii) Inverso ∀A ∈ Mn,m existe a matriz −A ∈ Mn,m tal que A + (−A) = 0n,m iv) Comutatividade A + B = B + A 17 CAPÍTULO 2. MATRIZES 2.3 Multiplicação por Escalar Anteriormente, definimos uma relação binária, como sendo uma função que relacionava dois elementos do mesmo conjunto, e obtinhamos como resultado um novo elemento do mesmo conjunto, como faz a adição de matrizes. Agora, estamos interessados em relacionar o corpo K, com o conjunto das matrizes de ordem n × m por exemplo, e obter desta relação uma nova matriz de ordem n×m. Como fazer isto é o que mostra a seguinte definição. Definição 2.3.1 Chamaremos de produto por escalar, a operação externa · : K×Mn,m −→Mn,m dada da seguinte forma: Sejam α ∈ K e A ∈ Mn,m então α · A = (αaij )n,m Veja que a operação externa produto por escalar nada mais é multiplicar cada uma das entradas da matriz A ∈ Mn,m pelo escalar α ∈ K. Vejamos agora alguns exemplos. Exemplo 2.3.1 Sejam 2√ 3 −5 5 −2 6 , α1 = 2, e α2 = π. Então calculemos α1 · A − α2 · A Exemplo 2.3.2 Seja A ∈ Mn e λ ∈ K, então calculemos λ · In − A. Proposição 2.3.1 Sejam A, B ∈ Mn,m e α, α1 , α2 ∈ K, então são válidas: 1. (α1 + α2 ) · A = α1 · A + α2 · A 2. α · (A + B) = α · A + α · B 3. α1 (α2 · A) = (α1 α2 ) · A 4. 1 · A = A, −1 · A = −A, 0 · A = 0n,m De agora em diante consideraremos α · A = αA. Exemplo 2.3.3 Seja X ∈ M3 . Então a seguinte igualdade: 2√ 3 5 √ −2 −4(X + 3 0 procuremos o valor da matriz X tal que satisfaz −5 1 0 4 6 ) = 5X + 5 0 3 1 1 0 1 18 CAPÍTULO 2. MATRIZES 2.3.1 Exercı́cios 1. Uma Universidade está querendo pintar quatro dos seus carros, com as cores e os sı́mbolos da universidade. Então, a Universidade faz uma licitação para executar este serviço, onde cada empressa só pode pintar um carro. Dentro das propostas ela seleciona quatro delas, cujos valores são dados segundo tabela abaixo. Of.1 Of.2 Of.3 Of.4 Então, encontre a melhor 1√ −3 2. Sejam A = 7 √ 0 −3 6 1√ −3 4 , D= 7 0 −7 carro A carro B carro C carro D 3 6 7 5 7 7 4 3 6 2 6 5 5 3 4 7 proposta para a Universidade. 10 √ 13 9 4 2 0 9 ,C = √ 7 −3 , −7 , B = 0 √ 3 8 2 18 1 4 11 1 4 0 −7 e E= √ 5 18 Então veja se é possı́vel calcular e, se fôr possivel, então calcule: (a) 2A + B (b) E − 2C (c) −4A + 5B − 3C + D (d) D + I2 − E 3. Sejam α ∈ K e r ∈ R e A ∈ Mn,m então mostre que: (a) α(rA) = (αr)A (b) (α + r)A = αA + rA 4. Mostre que se r ∈ R, e A, B ∈ Mn,m então, r(A + B) = rA + rB. 5. Determine o valor da matriz X 0√ 9 2 10 √ 5 6 da seguinte igualdade: 8 0 3 19 6 + 3X = 10 7 −13 √ 11 6 11 9 19 CAPÍTULO 2. MATRIZES 10 −3 4 6. Sejam A = 7 √ 0 −7 , B = 0 6 −3 18 1 Justifique cada um dos seus passos para achar igualdades: √ (a) 2(2X + B) = 35 X + C − 2A 1√ 13 9 √ 7 √ −3 , C = 4 11 o valor da matriz X, 2 0√ 9 3 8 . 2 2 −4 7 das seguintes (b) −3A + 5X = πC − 72 B √ √ (c) 7(3X + 2A) + −2(A − 5C) = 23 B 7. Mostre as propriedades da soma de matrizes e do produto por escalar. 8. Sejam A1 , ..., Ar ∈ Mn e sejam λ1 , ..., λr ∈ K. Usando a definição de traço de uma matriz mostre que : tr(λ1 A1 + · · · + λr Ar ) = λ1 tr(A1 ) + · · · + λr tr(Ar ). 2.4 Multiplicação de Matrizes Até agora temos definido a soma de matrizes e a multiplicação por escalar, agora nos resta trabalhar em uma definição de multiplicação de matrizes. Começaremos primeiro considerando uma situação particular com matrizes de ordem 1 × n e de ordem n × 1, como será dado na seguinte definição. y1 y2 Definição 2.4.1 O produto da matriz X = x1 x2 · · · xn pela matriz Y = .. . yn é a matriz de ordem 1 × 1 dada por : y1 y2 X · Y = x1 x2 · · · xn · .. = (x1 y1 + x2 y2 + · · · + xn yn ) . yn Ilustremos esta definição com o seguinte exemplo. 4 Exemplo 2.4.1 Sejam X = 3 2 −6 e Y = 9 , a partir da definição segue que 7 4 X · Y = 3 2 −6 9 = (3 · 4 + 2 · 9 + −6 · 7) = (−12)1,1 . 7 Veja que, a partir da definição anterior o número de colunas da matriz X deve ser igual ao número de linhas da matriz Y , se isso acontece, diremos que as matrizes X e Y são compatı́veis para a multiplicação. 20 CAPÍTULO 2. MATRIZES Definição 2.4.2 Sejam A ∈ Mn,p e B ∈ Mp,m. O produto das matrizes A e B, que denotaremos por C = AB, é a matriz cujo elemento genérico cij , é o produto da i-ésima linha Ai da matriz A pela j-ésima coluna Bj da matriz B, isto é, cij = Ai Bj = ai1 b1j + · · · + aip bpj onde 1 ≤ i ≤ n e 1 ≤ j ≤ m. Vejamos como esta definição funciona no seguinte exemplo. 2 6 7 1 5 , então eB= Exemplo 2.4.2 Sejam A = 8 5 −3 3 2 1 · 2 + 5 · 8 1 · 6 + 5 · 5 1 · 7 + 5 · −3 AB = = 3 · 2 + 2 · 8 3 · 6 + 2 · 5 3 · 7 + 2 · −3 42 31 −8 2 + 40 6 + 25 7 − 15 = 22 28 15 6 + 16 18 + 10 21 − 6 Veja que o exemplo anterior mostra que o produto de matrizes pode não ser comutativo, visto que existe o produto AB, mas não existe o produto BA. Exemplo 2.4.3 A notação matricial foi introduzida pelo matemático Inglês Artur Cayley em 1958. Ele usou-a para abreviar a notação para expressar um sistema de equações lineares. Isto é, o sistema a11 x1 + a12 x2 + · · · +a1m xm = b1 a21 x1 + a22 x2 + · · · +a2m xm = b2 .. .. .. .. .. . . . . . a x + a x + · · · +a x = b n1 1 n2 2 nm m n pode ser representado matricialmente pela seguinte equação : AX = B a11 .. onde A = . an1 a12 · · · .. . an2 · · · a1n .. e a matriz X = . anm x1 x2 .. . e B = b1 b2 .. . onde o xm bn anterior se verifica facilmente usando as definições de produto de matrizes. x1 x2 Este problema consiste em determinar um conjunto S de n-uplas x = .. cujas . xn coordenadas satifazem simultaneamente a cada uma das equações do sistema dado por 21 CAPÍTULO 2. MATRIZES AX = B. O conjunto S é chamado de conjunto solução do sistema de equações lineares. O sistema de equações lineares anterior é dito Homogêneo se a matriz coluna 0 b1 0 b2 B = .. = 0 = .. . . 0 bm fôr nula. Uma matriz que será estudada no próximo capı́tulo é a matriz aumentada, que denotaremos por (A : B), associada ao sistema de equações lineares anterior, observe que (A : B) ∈ Mn,m+1 . Vejamos uma pequena aplicação do exemplo anterior: Exemplo 2.4.4 Sabemos que dados dois pontos no plano R2 , só pode passar uma única reta, que a partir de geometria analitica é dada pela equação ax + by + c = 0 Onde a, b, c ∈ R. Então, encontremos a equação da reta que passa pelos pontos (1, 2), (2, 3). Veja que os pontos anteriores devem satisfazer a equação ax + by + c = 0, ou seja que temos a seguinte situação : a1+ b2+ = −c a2+ b3+ = −c Veja que não é dificı́l, usando alguns conhecimentos de segundo grau, mostrar que a = −3c e b = c, ou seja, a equação da reta procurada é dada por −3cx + cy = −c ou y = 3x − 1 onde c 6= 0. Se A ∈ Mn pode-se verificar facilmente que AIn = In A = A. CAPÍTULO 2. MATRIZES 22 Exemplo 2.4.5 : as seguintes matrizes Consideremos 4 0 0 0 0 0 1 0 1 3 ; ;E= ;D= ;C= ;B= A= 2 1 1 0 1 4 7 −1 2 0 4 0 1 0 −1 0 1 0 F = ;I= ;J= ;K= ; 6 7 0 1 0 1 0 −1 −1 0 e L= . 0 −1 −2 3 1 3 1. AB = 6= = BA, o que mostra que o produto de matrizes não −3 7 3 4 é comutativo. 0 0 , onde tanto a matriz C como a matriz D são diferente da matriz 2. CD = 0 0 nula. 0 0 3. Veja que DE = = DF , mas a matriz E 6= F , isto mostra que não existe 8 0 uma lei de cancelamento entre matrizes. 4. Temos que I 2 = I, J 2 = I, K 2 = I, L2 = I, isto mostra que a matriz I tem pelo menos quatro raı́zes quadradas, sendo que com escalares só poderia ter no máximo duas raı́zes. Por outro lado, a seguinte proposição mostra as propriedades válidas com o produto de matrizes. Proposição 2.4.1 Sejam A, B, C ∈ Mn . Então são válidas : i) Associatividade : A(BC) = (AB)C. ii) Neutro : Existe In ∈ Mn tal que In A = AIn = A. iii) Lei Distributiva Esquerda : A(B + C) = AB + AC. iv) Lei Distributiva Direita : (A + B)C = AC + BC. Se considerarmos matrizes quadradas, digamos de n × n, podemos ter o conceito de potência de uma matriz, ou seja que se A ∈ Mn segue que A0 = In ; A1 = A; AA = A2 , · · · , An+1 = AAn . Fazendo uso de indução finita, como visto no capı́tulo 1, podemos mostrar que An+m = An Am . A partir do anterior, podemos trabalhar expressões polinômiais como p(x) = an xn + an−1 xn−1 + · · · + a0 ∈ K[x], isto é, podemos calcular p(A) = an An + an−1 An−1 + · · · + a0 In ∈ Mn , vejamos o anterior no seguinte exemplo. 23 CAPÍTULO 2. MATRIZES Exemplo 2.4.6 Seja A = 1 4 3 8 então ∈ M2 e consideremos o polinômio p(x) = x3 +x−2, 3 1 0 1 4 1 4 −2 + p(A) = A + A − 2I2 = 0 1 3 8 3 8 120 344 121 + 1 − 2 340 + 4 + 0 −2 0 1 4 121 340 = = + + = 258 722 255 + 3 + 0 716 + 8 − 2 0 −2 3 8 255 716 3 Exemplo 2.4.7 Consideremos o seguinte sistema de comunicação (esses centros de comunicação podem representar pessoas, nações, computadores etc.) dado pelo seguinte diagrama. 1 3 2 4 onde a seta indica que o terminal i se comunica deste diagrama é dado pela matriz. 0 1 1 1 0 1 A= 0 0 0 1 1 1 com o terminal j. A forma matricial 1 1 0 0 onde aij = 1 se existe comunicação entre o terminal i e o terminal j e aij = 0, caso contrário. Estamos considerando que os terminais não se comunicam com si próprios. Então temos: 2 1 2 1 1 2 2 1 B = AA = A2 = 0 0 0 0 = (aij )n,m 1 1 2 2 Aqui b11 = a11 a11 + a12 a21 + a13 a31 + a14 a41 = 2, veja que esses produtos a1j aj1 é um, se, e somente se a1j e aj1 são um, isto diz que o terminal 1 está comunicado com o terminal j e o terminal j está comunicado com o terminal 1, logo como b11 = 2, diz que temos duas chances de isto acontecer, o terminal 1 via outro terminal se comunicar com o terminal 1 novamente. Assim A + A2 diz sobre o número total de chances de comunicação que estão abertas entre vários terminais usando nenhum terminal ou um terminal intermediário. Uma das grandes ferramentas na área de transportes hoje em dia, é dada pela teoria de grafos, que claramente não é o nosso objeto de estudo, mas daremos a definição de grafo dirigido para ilustrar uma outra aplicação destes conceitos matriciais vistos até aqui. 24 CAPÍTULO 2. MATRIZES Definição 2.4.3 Chamaremos de Grafo Dirigido á quádrupla G = (G0 , G1 , o, t), onde G0 é o conjunto de vértices, e G1 é o conjunto de flechas, e para qualquer flecha α ∈ G1 temos a função o : G1 −→G0 tal que o(α) é o vértice origem da flecha α, e a função t : G1 −→G0 é o vértice final ou término da flecha α. Ilustremos a definição anterior com o seguinte exemplo. Exemplo 2.4.8 Consideremos uma famı́lia, com a Mãe, Pai, uma filha e dois filhos. Cada um dos membros desta famı́lia tem influência sobre os outros membros da famı́lia da seguinte forma : A Mãe tem influência sobre a sua filha e sobre o filho mais velho; e o Paı́ tem influência sobre os dois filhos; e a filha pode influenciar sobre o Pai; e o filho mais velho pode influenciar o irmão mais novo, e finalmente o filho mais novo pode influenciar a Mãe. Então, usando grafos podemos modelar esta familia da seguinte forma : G0 = {Mãe, Pai, Filha, Filho mais velho, Filho mais novo} = {M, P, F, Fv , Fn } e G1 = {Inflbeuncia na familia} = {α1 , α2 , α3 , α4 , α5 , α6 , α7 } •1 Fv α2 α2 α1 α1 α3 α3 α4 M α5 F Fn α5 α6 α7 P α4 •2 •4 (a) •3 α6 α7 •5 (b) Em um grafo dirigido com n vértices, podemos associar uma matriz M = (nij ) ∈ Mn , chamada de matriz de incidência do grafo dirigido. As entradas da matriz de incidência são dados da seguinte forma : 1 se Pi −→Pj nij = 0 outra para i, j = 1, 2, ..., n. Agora, a matriz de incidência pela seguinte matriz : 1 2 3 4 1 0 1 0 0 2 0 0 1 0 M = 3 1 0 0 0 4 0 1 0 0 5 0 0 0 1 associado ao exemplo 2.4.8 é dado 5 1 0 1 0 0 25 CAPÍTULO 2. MATRIZES Exemplo 2.4.9 Consideremos a seguinte situação de migração entre a região Nordeste do Brasil e a região de Rio- São Paulo da seguinte forma. cada ano, 50% da População do Nordeste migra para a região de Rio-São Paulo, não entanto 25% da População de Rio-São Paulo migra para a região Nordeste. 0.5 0.5 RSp ND 0.75 0.25 Se esta migração tende a continuar, nos parâmetros anteriores, será que acabará a população no Nordeste, ou a futuro esto se estabilizará?. Então, vamos supor que sejam nk e sk as proporções das populações no Nordeste e no Rio-São Paulo respectivamente, em um determinado ano k, e então temos que nk +sk = 1. Logo, estas diretrizes determinam que no ano seguinte, isto é, no ano k + 1 as proporções de populações será dado por nk+1 = nk 0.5 + sk 0.25 sk+1 = nk 0.5 + sk 0.75 Se pTk = (nk , sk ) e pTk+1 = (nk+1 , sk+1 ) representam as populações no final do ano k e no ano k + 1 respectivamente, então temos a matriz 0.5 0.5 T = 0.25 0.75 Sendo a matriz de transição, de onde temos que pTk+1 = pTk T . Logo, temos a seguinte sequência pT1 = pT0 T ; pT2 = pT1 T = pT0 T 2 ; pT3 = pT2 T = pT0 T 3 ; . . . ; pTk = pT0 T k Calculando as potências da matriz T temos 0.333 0.667 0.375 0.625 7 2 ··· T = T = 0.333 0.667 0.312 0.687 Não é difı́cil de ver que esta sequência tende a matriz 1 2 ∞ k 3 3 T = lim T = 1 2 k −→∞ 3 3 Portanto, a migração a futuro estará estabilizada, onde deste, e 32 da população ficará no Rio-São Paulo. 1 3 da população ficará no Nor- Vejamos agora uma aplicação entre matrizes que será de muita utilidade na parte final deste texto. Definição 2.4.4 Seja A = (aij ) ∈ Mn,m . A transposta da matriz A, que indicaremos por At , é a matriz obtida da matriz A trocando as linhas por colunas, isto é, At = (aji ) ∈ Mm,n 26 CAPÍTULO 2. MATRIZES Veja que transposta pode ser vista como uma transformação ()t : tremos esta definição com o seguinte exemplo. 24 24 2 6 8 2 Exemplo 2.4.10 Seja A = 12 3 10 1 então At = 6 11 0 1 7 8 Mn,m −→Mm,n . Ilus12 3 10 1 11 0 1 7 Na seguinte proposição, damos as propriedades satisfeitas pela transposta de matrizes. Proposição 2.4.2 Sejam A ∈ Mn,p , B ∈ Mp,m e c ∈ K. Então são válidas : i) (At )t = A. ii) (A + B)t = At + B t . iii) (cA)t = cAt . iv) (AB)t = B t At . Definição 2.4.5 Seja A ∈ Mn . Então diremos que a matriz A é simétrica se At = A, e diremos que a matriz A é anti-simétrica se At = −A. Um dos fatos importantes sobre simetria e anti-simetria de matrizes é dada na seguinte proposição. Proposição 2.4.3 Seja A ∈ Mn . Então a matriz A se decompõe como a soma de uma matriz simétrica, que denotaremos por As , mais uma matriz anti-simétrica, que denotaremos por Aa , isto é, A = As + Aa Dem. Seja A uma matriz como no enunciado, então consideremos as seguintes matrizes As = A + At 2 e Aa = A − At 2 Claramente As + Aa = A, então só resta mostrar que a matriz As é simétrica e que a matriz Aa é anti-simétrica. Mas pelas propriedades da transposta temos: (As )t = ( A + At A + At t At + (At )t ) = = = As 2 2 2 portanto As é simétrica. De forma análoga temos que (Aa )t = −Aa logo é anti-simétrica, como querı́amos. 27 CAPÍTULO 2. MATRIZES 2.4.1 Exercı́cios 1. Ache a equação da reta que passa pelos pontos (−2, 1); (3, 8). 2. Construa a matriz de incidência dos seguintes grafos orientados. •1 •1 α2 α2 α1 α1 •2 α5 •3 α3 α8 α3 α5 (a) α6 •4 α4 •2 α5 •4 •3 α6 α9 •5 α7 (b) 3. Ache o grafo orientado, associado as seguintes matrizes : 0 0 1 0 0 1 0 0 0 1 0 0 1 0 0 1 0 1 0 1 0 1 0 1 1 1 0 0 1 0 1 0 1 0 0 1 1 0 0 0 1 0 0 1 1 1 0 1 1 1 1 1 1 0 0 0 1 1 1 0 0 1 1 1 1 0 0 1 (a) (b) 1 0 0 1 1 1 1 0 1 0 0 1 0 1 0 0 1 0 0 1 0 (c) 1 1 0 0 0 1 1 0 0 1 1 1 0 1 1 0 1 0 1 0 0 4. Expresse o seguinte sistema linear, como uma equação matricial da forma AX = B, identificando cada uma das matrizes, A; X e B. +6x2 −x3 = 6 3x1 −4x1 +2x2 = 9 3x2 +5x3 = 5 5. Mostre que 2 3 4 − 1 − 1 − 1 0 1 0 0 1 0 0 1 0 = − 1 − 1 − 1 = 0 0 1 = I3 0 0 1 0 0 1 − 1 − 1 − 1 6. Sejam A, B ∈ M2 , tais que AB = BA. Então mostre que (A + B)2 = A2 + 2AB + B 2 Se as matrizes A, B ∈ Mn são quaisquer, a igualdade é sempre verdadeira?. Mostre um contraexemplo se não fôr verdadeiro. CAPÍTULO 2. MATRIZES 28 7. Seja A ∈ Mn e p(x) = an xn + an−1 xn−1 + · · · + a0 ∈ K[x], então mostre que Ap(A) = p(A)A. 8. Consideremos a seguinte situação de migração entre Rio e São Paulo da seguinte forma: cada ano, 30% da população do Rio migra para a região de São Paulo, no entanto 20% da população de São Paulo migra para o Rio. Será que esta migração se estabiliza? 9. Uma matriz A de ordem n é dita idempotente se A2 = A. 2 − 2 − 4 3 4 é idempotente ou não. a) Verifique se a matriz − 1 1 − 2 3 b) Mostre que se AB = A e BA = B, então A e B são idempotentes. c) Se a matriz A é idempotente, mostre que a matriz B = I − A é idempotente e AB = BA = 0. 10. Sejam A, B ∈ M2 , mostre que: a) tr(A ± B) = tr(A) ± tr(B). b) tr(αA) = αtr(A), onde α ∈ K. c) tr(AB − BA) = 0. onde tr(A) denota o traço da matriz A, ou seja a soma da diagonal principal da matriz A. 11. Mostre as propriedades da transposta. 12. Mostre que se A ∈ Mn então a matriz AAt é uma matriz simétrica. 13. Diga se é verdadeiro ou falso, e justifique a sua resposta : a) Se as matrizes A e B são simétricas, então A + B e A − B são simétricas. b) Se as matrizes A e B são anti-simétricas então A+B e A−B são anti-simétricas. 3 1 8 2 como soma de uma matriz simétrica e 14. Expresse a matriz − 4 − 9 6 − 5 1 outra anti-simétrica. CAPÍTULO 2. MATRIZES 2.5 29 Inversão de Matrizes Temos visto, nas seções anteriores, que podemos somar e multiplicar matrizes no conjunto Mn , onde as matrizes com a soma, tem estrutura de grupo abeliano, e com o produto é só um grupoide com unidade I. Então, é natural se perguntar: dada uma matriz A ∈ Mn quando é possı́vel achar uma outra matriz B ∈ Mn tal que o produto AB = I seja a matriz identidade?. Este conceito é dado na seguinte definição. Definição 2.5.1 Seja A ∈ Mn . Diremos que a matriz A é invertı́vel pela esquerda (direita) se existe uma matriz C ∈ Mn (B ∈ Mn ) tal que AC = In (BA = In ). A definição anterior diz, que uma matriz quadrada A de ordem n pode ter inversa só pela direita ou só inversa pela esquerda, mas se tiver inversa pelos dois lados temos a seguinte proposição. Proposição 2.5.1 Seja A ∈ Mn . Se A tem inversa pela direita B e pela esquerda C, então temos que B = C. Dem. A partir da definição de inversa temos que BA = In e AC = In . Então, B = BIn = B(AC) = (BA)C = In C = C Desta forma, se a matriz A tem inversa pela direita e pela esquerda, então a partir da proposição anterior a matriz A tem uma única inversa, que denotaremos por A−1 , e neste caso diremos que a matriz A é invertı́vel (ou não singular), e A−1 A = AA−1 = In , caso contrário diremos que a matriz A não é invertı́vel (ou singular). 3 −5 7 5 Exemplo 2.5.1 Sejam A = eB= , então 4 3 −4 7 3 −5 7 5 1 0 7 5 −1 AB = · = = BA. Portanto A = . −4 7 4 3 0 1 4 3 Observe que, nem toda matriz admite inversa, como veremos no seguinte exemplo. 3 6 Exemplo 2.5.2 Seja A = , então achar a inversa da matriz A significa achar 4 8 x y 3 6 x y 1 0 uma matriz X = , tal que AX = · = , de onde z w 4 8 z w 0 1 pode-se obter o seguinte sistema de equações. 3x +6z = 1 3y +6w = 0 4x +8z = 0 4y +8w = 1 O cálculo anterior mostra que o sistema é inconsistente, logo não é possı́vel achar x, y, z nem w, tal que AX = I2 . Portanto a matriz A não é invertı́vel. 30 CAPÍTULO 2. MATRIZES Proposição 2.5.2 Sejam A, B ∈ Mn inversı́veis. Então é válido que: i) (A−1 )−1 = A ii) (AB)−1 = B −1 A−1 Dem. A primeira afirmação decorre diretamente da definição. Então vejamos a segunda, na qual basta verificar que: (AB)(B −1 A−1 ) = A(BB −1 )A−1 = AIn A−1 = AA−1 = In e de maneira análoga verifica-se (B −1 A−1 )(AB) = In . Corolário 1 Sejam A1 , A2 , . . . , An ∈ Mn , matrizes inversı́veis, então (A1 A2 · · · An )−1 = −1 −1 A−1 n · · · A2 A1 Assim como tı́nhamos definido potências na multiplicação de matrizes, temos que se A é uma matriz quadrada de ordem n e inversı́vel, então por indução segue que A−n = (A−1 )n , onde n ∈ N. Proposição 2.5.3 Sejam A, B ∈ Mn . Se AB = 0, então a matriz A = 0 ou a matriz B = 0 ou ambas A e B não são inversı́veis. Dem. Claramente se a matriz A ou a matriz B é zero, o anterior é claro, logo só resta assumir que as matrizes A e B são diferentes da matriz nula. Então vamos supor que a matriz A ou a matriz B é invertı́vel, e obtenhamos uma contradição. Consideremos a matriz A invertı́vel, logo como AB = 0 ⇒ A−1 (AB) = A−1 0 ⇒ In B = 0 Ou seja, que a matriz B é nula, o que é uma contradição pois ela é inversı́vel. De forma análoga, segue que B não pode ser invertı́vel, portanto as matrizes A e B não são inversı́veis. 0 0 3 0 0 5 0 0 , segue que AB = BA = e B = Exemplo 2.5.3 Sejam A = 0 0 , onde tanto a matriz A como a matriz B são diferentes da matriz nula, logo 0 0 pela proposição anterior podemos concluir que, as matrizes A e B não são inversı́veis. Proposição 2.5.4 Seja A ∈ Mn . Se a matriz A tem inversa pela esquerda (ou direita), então a matriz A é inversı́vel. A demonstração desta proposição será deixada para depois, mas esta proposição diz que para uma matriz A quadrada de ordem n ser invertı́vel, basta ter somente inversa ou pela direita ou pela esquerda. 31 CAPÍTULO 2. MATRIZES Recordemos que um sistema de equações da a11 x1 + a12 x2 + · · · a21 x1 + a22 x2 + · · · .. .. . .. . . a x + a x + ··· n1 1 n2 2 forma: +a1n xn = b1 +a2n xn = b2 .. .. . . +ann xn = bn Pode ser representado matricialmente pela seguinte equação matricial AX = B a11 .. onde A = . an1 a12 · · · .. . an2 · · · a1n .. e a matriz X = . ann x1 x2 .. . eB= b1 b2 .. . bn xn Se consideramos a matriz anterior A inversı́vel, a equação matricial AX = B tem uma única solução, a saber dada por: X = A−1 B Que é solução, isto é claro, pois é só substituir na equação matricial X = A−1 B em AX = B, então mostremos agora, que esta solução é única. Para isto, vamos supor que não, isto é, que existe uma outra solução Y tal que AY = B, então segue que : X = A−1 B = A−1 (AY ) = (A−1 A)Y = Y Portanto a solução X = A−1 B é única. Vejamos uma aplicação desta proposição, no seguinte exemplo prático. Exemplo 2.5.4 Uma empresa de componentes eletrônicos, usa dois tipos de maquinas P e Q para produzir dois tipos de componentes eletrônicos A e B. As máquinas P e Q podem operar 80 e 60 horas por semana, respectivamente. A máquina P requer duas horas para produzir o componente eletrônico A e quatro horas para produzir o componente eletrônico B. A máquina Q requer três horas para produzir o componente eletrônico A, e duas horas para produzir o componente eletrônico B. Estamos interessados em determinar o número de unidades de cada componente eletrônico produzidos pelas máquinas P e Q, semanais. Solução. Seja x o número de unidades do componente eletrônico A e y o número de componentes eletrônicos B produzidos por semana. Logo, a máquina P gasta 2x horas para produzir o componente A e 4y horas para produzir o componente B. Se a maquina trabalha o tempo todo, temos 2x + 4y = 80 De forma análoga a anterior, com a máquina Q temos que 3x + 2y = 60 CAPÍTULO 2. MATRIZES 32 Então matricialmente a situação anterior é dada por 2 4 x 80 = 3 2 y 60 a b 2 4 admite inversa, isto é, se existe uma matriz Vejamos se a matriz C = c d 3 2 tal que 1 0 a b 2 4 = 0 1 c d 3 2 −1/4 1/2 , portanto então temos que C −1 = 3/8 −1/4 −1/4 1/2 80 10 X= = 3/8 −1/4 60 15 Desta forma, podem ser produzidos dez componentes eletrônicos do tipo A semanais e quinze do tipo B. Podemos trabalhar outros exemplos de aplicações de matrizes, como é dado pelo encobrimento de mensagens. A história da humanidade mostra a Júlio César , o grande imperador Romano, como sendo um dos precursores na área de Criptografia, que é a ciência das comunicações secretas, que vem a resolver o seguinte problema: Transmitir a um destinatário de maneira segura uma mensagem ou informação de forma que somente o destintário possa entender o conteúdo, apesar de que outras pessoas possam ter acesso a mensagem. Quando transformamos uma mensagem ou informação de tal forma que possa ser entendida somente pelo destinatário, diremos que a mensagem ou a informação esta codificada, e que o destinatário conhece a decodificação. Vejamos um exemplo dado pela história da humanidade de como o anterior funciona. O Grande Imperador Romano Júlio César usava um deslocamento das letras do alfabeto, de tal forma que a letra A escrevia-se como D, e os espaços entre as palavras colocava-se a letra A. O anterior parece muito fácil, basta conhecer o idioma ou saber ler e escrever bem para codificar e decodifivcar estas mensagens, mas recordemos que saber ler e escrever nos tempos de Julio César era coisa de muito, mas muito poucos, o que tornava o sistema anterior complexo para a época. Vejamos o seguinte exemplo: A frase ”Historias Curiosas Na Matemática”, escreve-se da seguinte forma: KLVWRULDVAFXULRVDVAQDAPDWHPDWLFD Que tão difı́cil serı́a para o exercito inimigo decifrar esta mensagem?. Não sabemos da habilidade dos inimigos de Júlio César, mas este tipo de codificação não é difı́cil descobrir. Basta estudar a frequência em que as letras aparecem, que varia de idioma para idioma, e a quantidade de mensagem que você tem, é o que vai te ajudar muito para você descobrir a decodificação. O anterior dá uma ideia para decodificar o código de transposição de Júlio César. 33 CAPÍTULO 2. MATRIZES Agora, a história mais recente mostra uma sofisticação na forma de codificar e decodificar mensagens. Durante a primeira Guerra Mundial, os Britânicos interceptaram uma mensagem codificada do ministro de relações Exteriores de Alemanha, Arthur Zimmermann, dirigida ao embaixador no México, Heinrich von Eckardt. Depois de muito trabalho, os analistas Britânicos conseguiram quebrar a mensagem, e descobriram um plano por parte do Governo Alemão de estimular o México para participar na guerra como aliado do Governo Alemão. Em contrapartida, o México recuperaria as terras perdidas para os Estados Unidos em 1847. Foi enviado um aviso ao Presidente dos Estados Unidos, Woodrow Wilson, que o ajudou a decidir pela entrada na guerra imediatamente junto com os aliados. O que provavelmente, acelerou o final da primeira Guerra Mundial. O sistema de codificação alemão estava baseado na teoria de matrizes estudada neste texto. Por exemplo, consideremos as seguintes matrizes: 5 −3 2 3 B0 = A0 = −3 2 3 5 que são tais que: A0 × B0 = 2 3 3 5 × 5 −3 −3 2 = 1 0 0 1 Vejamos, agora como poderı́amos usar as operações com matrizes para esconder informações, de uma maneira mais eficiente que a implementada por Júlio César. Comencemos por atribuir a cada letra do alfabeto um número, da seguinte forma: A B C D E F G H I J K L M 1 2 3 4 5 6 7 8 9 10 11 12 13 N O P Q R S T U V W X Y Z 14 15 16 17 18 19 20 21 22 23 24 25 26 Codifiquemos a seguinte mensagem: O Número é a origem de todas as coisas (PLATON) Começaremos dividindo a mensagem em pares de letras, pois a matriz que estamos considerando é de tamanho 2 × 2, como segue: ON UM ER OE AO RI GE MD ET OD AS AS CO IS AS PL AT ON Com a divisão anterior, transformaremos os pares de letras, em colunas da seguinte forma: 15 21 5 1 18 7 14 13 18 15 9 5 3 1 1 15 5 13 15 19 19 4 20 4 15 1 16 1 9 14 20 12 19 19 34 CAPÍTULO 2. MATRIZES 2 3 para ocultar a nossa mensagem. Faremos Agora, usaremos a matriz A0 = 3 5 isto, multiplicando cada uma das nossas colunas pela matriz A0 anterior. Então, temos o seguinte colunas: de novas conjunto 29 63 47 64 81 72 115 128 105 78 99 46 38 70 42 59 59 51 98 59 115 65 98 84 75 59 68 62 57 122 98 108 103 115 Para decodificar a mensagem anterior, procedemos da seguinte forma: Ele, o desti5 −3 natário, deve conhecer a matriz B0 = que é a matriz inversa da matriz −3 2 A0 . Onde ele multiplica as novas colunas pela matriz B0 e poderá ler a mensagem de forma correta. Veja que a mensagem anterior é muito difı́cil de decodificar, se não se conhecem as matrizes A0 e a matriz B0 , mas não é impossı́vel. Uma outra dificuldade passa pelo fato de encontrar gente qualificada na área de Álgebra para poder entender e poder desenvolver um sistema de decodificação, que poderı́a ser comparada a dificuldade de Julio César, para encontrar gente qualificada com o idioma. A mensagem dirigida ao embaixador da Alemanha no México decodificado pelo serviço de inteligência Britânico, estava codificado via uma matriz de 6 × 6. De quantas formas podemos escolher a nossa matriz inversı́vel A0 ? A resposta a pergunta anterior é dada pelo seguinte Teorema. a b Proposição 2.5.5 Uma matriz admite inversa com entradas inteiras, se e c d somente se, ad − bc é 1 ou −1 a b e f Dem. Sejam A = eB= duas matrizes com entradas inteiras, tais c d g h que AB = I, então det(A) = ad − bc = p e det(B) = eh − gf = q também são inteiros. Portanto, det(AB) = det(A)det(B) = pq = 1 = det(I) e como p, q são inteiros temos que p, q são divisores de 1, se e somente se, p = q = 1 ou p = q = −1. Os exemplos anteriores deixam pelo menos duas perguntas: • Quando uma matriz tem inversa?ou Como decidir se uma determinada matriz admite inversa? • Como calcular esta inversa, se ela existir. Um dos objetivos no próximo capı́tulo, é tentar responder estas duas perguntas. CAPÍTULO 2. MATRIZES 2.5.1 35 Exercı́cios 1. Verifique se as seguintes afirmações são verdadeiras ou falsas, e justifique a sua resposta. a) Se A não é uma matriz quadrada, então não existe A−1 . b) Se A, B ∈ Mn são matrizes inversı́veis, então A + B também é invertı́vel. c) Se A, B ∈ Mn são matrizes singulares, então A + B é singular. 2. Sejam A, B, C ∈ Mn matrizes inversı́veis. Então ache o valor da matriz X nas seguintes igualdades. a) A(X + C) = BC b) B(X + AC) = X + C 3. Seja A ∈ Mn tal que, Am = In para algum inteiro m. Mostre que a matriz A é invertı́vel. Qual é a inversa da matriz A?. 4. Seja A ∈ Mn . Diremos que a matriz A é nilpotente, se existe um inteiro k > 0, tal que Ak = 0 e Ak−1 6= 0. Mostre que, se a matriz A é nilpotente, então a matriz A não é invertı́vel. 2 5 3 5. Sejam A = e B = . Ache a matriz X que satisfaz a seguinte 1 3 2 equação : AX = B 6. Use a matriz A do exercı́cio anterior para calcular A−2 e A−3 . 7. Calcule a inversa da matriz A ∈ Mn diagonal: aij 6= 0 se i = j A= aij = 0 se i = 6 j 8. Seja A = a b c d . Mostre que A é invertı́vel se ∆ = ad − bc 6= 0 e calcule A−1 . 9. Seja A ∈ Mn . a) Se A3 = 0 então mostre que I − A é uma matriz invertı́vel. b) Em geral, se An = 0 para algum n ∈ N, então mostre que a matriz I − A é invertı́vel. c) Suponha que A3 − A − I = 0. Então mostre que a matriz A é invertı́vel. cosθ −senθ cos2θ −sen2θ 10. Seja A = . Mostre que A2 = . Use induçao senθ cosθ sen2θ cos2θ para determinar An , onde n ∈ N. 36 CAPÍTULO 2. MATRIZES 11. Use sistema de Júlio César para decodificar a seguinte mensagem: HVWXGDUAPHAIDCAEHP 12. Decodifique a seguinte mensagem: 23 89 67 103 11 39 14 52 43 52 6 20 45 21 16 9 39 20 51 30 43 24 56 37 Capı́tulo 3 Sistemas de Equações e Inversão de Matrizes 3.1 Forma Reduzida de Matrizes Vimos, no final do capı́tulo anterior, a importância da existência de matriz inversa na resolução de sistema de equações lineares, como ilustra o seguinte exemplo: 2x +4y = 80 3x +2y = 60 fazendo uso da notação matricial segue que: 2 4 x 80 = 3 2 y 60 então, calculando a inversa da matriz 2 4 3 2 −1 = −1/4 1/2 3/8 −1/4 , a solução do sistema linear anterior é dada por : x −1/4 1/2 80 10 X= = = y 3/8 −1/4 60 15 Veja quena solução que encontramos no problema acima, usamos o cálculo da inversa 2 4 . Esta é a única forma de calcular o conjunto solução de da matriz 3 2 sistemas de equações lineares?. E se tivermos uma outra maneira de calcular o conjunto de soluções do sistema linear, modificando o sistema original?. Será que o conjunto de soluções do sistema de equações lineares é o mesmo?. Será que é possivel transformasr este sistema de equações lineares em um outro muito mais simples?. Como poderia ser feito isto?. Será que o conjunto de soluções do sistema inicial e o do sistema transformado coincidem?. A partir 37 CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 38 do exemplo anterior podemos mostrar o seguinte processo de resolver o mesmo sistema de equações lineares, para tentar responder algumas das perguntas feitas anteriormente: L1 : 2x +4y = 80 L2 : 3x +2y = 60 Se multiplicarmos L1 por 1 2 temos o seguinte novo sistema de equações : L1 : x +2y = 40 L2 : 3x +2y = 60 A seguir, podemos multiplicar a primeira equação do sistema L1 por −3 e somar com a segunda equação L2 , desta forma obtemos o seguinte sistema: L1 : x +2y = 40 L2 : 0x −4y = −60 Agora, se multiplicarmos a segunda equação L2 por equações: L1 : x +2y = 40 L2 : 0x +y = 15 −1 4 temos o seguinte sistema de Finalmente, se multiplicamos a segunda equação L2 por −2 e somamos com L1 temos: L1 : x +0y = 10 L2 : 0x +y = 15 Observe que, o conjunto solução do sistema de equações acima é o mesmo encontrado fazendo uso do cálculo de inversa. O método descrito no exemplo é conhecido como o método de Gauss1 para resolver sistemas de equações. Veja que se mudarmos de ordem as equações anteriores ou, se multiplicamos a igualdade por uma constante não nula as soluções do sistema continuam sendo as mesmas, então consideremos a seguinte definição. Definição 3.1.1 Chamaremos de operações elementares em um sistema de equações lineares, as seguintes : a) Trocar a ordem das equações do sistema . b) Multipilicar uma equação do sistema por uma escalar não nulo. c) Somar a uma equação do sistema o múltiplo escalar de outra equação do sistema. Veja que as operações descritas na definição anterior, diz que as novas equações resultantes, depois de aplicar estas operações elementares, são somas e multiplos escalares das equações originais, ou são uma ”combinação linear”das equações anteriores. Esta noção de combinação linear, será mostrada com mais clareza e detalhe no capı́tulo 4. Mas temos a seguinte definição: 1 Carl Friederich Gauss(1777-1855), é considerado por muitos matemáticos , como o maior Matemático que já existiu, e por muitos denominado o ”Principe da Matematica” CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 39 Definição 3.1.2 Diremos que dois sistemas de equações lineares A e B são equivalentes quando cada equação do sistema de equações lineares B pode-se obter como uma combinação linear das equações do sistema de equações lineares A, ou vice-versa. Logo, segue a seguinte proposição. Proposição 3.1.1 Sistemas equivalentes de equações lineares, têm o mesmo conjunto de soluções. Fazendo uso da notação matricial, introduzida no capı́tulo anterior, no exemplo acima, temos a seguinte sequência de novas matrizes associada a cada um dos novos sistemas de equações lineares obtidos no començo deste capı́tulo. 2 4 : 80 L1 : 2x +4y = 80 3 2 : 60 L2 : 3x +2y = 60 1 2 : 40 L1 : x +2y = 40 3 2 : 60 L2 : 3x +2y = 60 L1 : x +2y = 40 1 2 : 40 L2 : 0x −4y = −60 0 −4 : −60 1 2 : 40 L1 : x +2y = 40 0 1 : 15 L2 : 0x +y = 15 L1 : x +0y = 10 1 0 : 10 L2 : 0x +y = 15 0 1 : 15 A partir do anterior temos a seguinte definição. Definição 3.1.3 Seja A ∈ Mn,m . As seguintes operações efetuadas na matriz A, são chamadas de operações elementares de linhas : ǫ1 ) Transposição de duas linhas da matriz A. ǫ2 ) Multiplicação de uma linha da matriz A por um escalar não nulo. ǫ3 ) Subtituição da r-ésima linha da matriz A pela linha r-ésima linha da matriz A mais c vezes a linha s da matriz A, onde 0 6= c ∈ K e r 6= s. Veja que estas operações elementares nas linhas podem ser vistas como aplicações ǫi : Mn,m −→Mn,m , onde i = 1, 2, 3 na definição anterior. Neste sentido, para cada operação elementar ǫi existe uma operação elementar do mesmo tipo ǫi ′ tal que ǫi (ǫi ′ (A)) = A = ǫi ′ (ǫi (A)) para todo i = 1, 2, 3. No decorrer deste texto, sempre trabalharemos com operações elementares nas linhas, com isto queremos destacar que é possı́vel fazer um trabalho similar considerando operações elementares somente nas colunas. CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 40 Definição 3.1.4 Sejam A, B ∈ Mn,m . Diremos que a matriz A é equivalente a matriz B, se existe um número finito de operações elementares α1 , α2 , · · · , αn tal que α1 α2 · · · αn (A) = B Que denotaremos por A ∼ B. Agora vamos responder a uma das perguntas feitas anteriormente, a saber, dados dois sistemas de equações lineares equivalentes, eles têm o mesmo conjunto solução?, por meio da seguinte proposição. Proposição 3.1.2 Sejam [A : Y ], [B : Z] duas matrizes aumentadas correspondentes a sistemas de equações lineares de n equações e m indeterminadas. Se [A : Y ] ∼ [B : Z], então os sistemas de equações AX = Y e BX = Z têm o mesmo conjunto solução. Dem. Sejam [A : Y ], [B : Z] matrizes aumentadas tais que [A : Y ] ∼ [B : Z], então existe uma sucessão finita de operações elementares tal que leva a matriz [A : Y ] na matriz [B : Z], isto é, [A : Y ] = [A0 : Y0 ] ֒→ [A1 : Y1 ] ֒→ · · · ֒→ [Ak : Yk ] = [B : Z] Observe que se conseguirmos provar a proposição para um dos passos, isto é, que o sistema Aj X = Yj e o sistema Aj+1 X = Yj+1 , são equivalentes, então terão o mesmo conjunto de soluções, a proposição segue. Sem perda de generalidade, vamos supor que realizamos uma operação elementar na matriz [A : Y ] e obtemos a matriz [B : Z], então temos que as equações do sistema de equações lineares BX = Z são uma combinação das equações do sistema de equações lineares de AX = Y , e vice versa, pois recordemos que existem as operações elementares inversas. Portanto, os sistemas são equivalentes e, portanto tem o mesmo conjunto de soluções como querı́amos. Consideremos o seguinte exemplo. Exemplo 3.1.1 Sejam o sistema de equações lineares e a matriz aumentada considerada anteriormente, L1 : 2x +4y = 80 2 4 : 80 L2 : 3x +2y = 60 3 2 : 60 onde mostramos a seguinte sequência de passos, usando aumentada, como segue: 2 4 : 80 1 2 : 40 ֒→ ֒→ 3 2 : 60 21 L1 3 2 : 60 −3L1 +L2 1 0 1 2 : 40 ֒→ 0 1 : 15 −2L2 +L1 0 1 operações elementares na matriz 1 2 : 40 0 −4 : −60 : 10 : 15 ֒→ −1 L2 4 CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 41 Como vimos anteriormente, o conjunto solução dos sistemas de equações associados 2 4 : 80 e é o mesmo, veja que a partir 3.1.2 o conjunto solução associado a 3 2 : 60 1 2 : 40 1 2 : 40 é o mesmo, e de maneira análoga o conjunto solução de 3 2 : 60 3 2 : 60 1 2 : 40 e o de também é o mesmo. Portanto, podemos concluir que o con0 −4 : −60 2 4 : 80 1 0 : 10 junto solução associado a e é o mesmo, como querı́amos 3 2 : 60 0 1 : 15 mostrar. Definição 3.1.5 Seja R ∈ Mn,m . Diremos que a matriz R é escalonada reduzida por linhas se: a) O primeiro elemento não nulo em cada linha não nula da matriz R é 1 (da esquerda para direita). b) Cada coluna da matriz R que tem o primeiro elemento não nulo de alguma linha tem todos os outros elementos da coluna nulos. c) Todas as linhas nulas da matriz R (se existirem) estão abaixo das linhas não nulas da matriz R. d) Se as linhas 1, ..., r são as linhas não nulas da matriz R, e o primeiro elemento não nulo da linha i ocorre na ji -ésima coluna (i = 1, ..., r), então o primeiro elemento não nulo da linha i + 1 ocorre na coluna ji+1 , onde ji+1 > ji . Na maioria dos textos de Álgebra Linear, os itens a, b da definição anterior correspondem ao conceito de matriz reduzida. A importância do conceito anterior está dado na seguinte proposição. Proposição 3.1.3 Seja A ∈ Mn,m . Então, a matriz A é equivalente a uma matriz escalonada reduzida por linha. Dem. Seja A ∈ Mn,m . Se a matriz A tiver alguma linha nula, então fazendo uso das transposições de linhas podemos colocar estas linhas na parte inferior da matriz A, obtendo assim uma nova matriz que denotaremos por A1 , então podemos assumir que a matriz A é equivalente a matriz A1 . Sem perda de generalidade, podemos supor que a primeira linha de A1 não é nula. Se o primeiro elemento não nulo desta linha não nula estiver na coluna j, digamos a1j e não fôr 1, então podemos aplicar a segunda operação elementar multiplicando a primeira linha por 1/a1j . Agora, podemos ter que o primeiro novo termo não nulo da nova matriz é 1, então fazendo uso da terceira operação elementar podemos anular todos o termos abaixo deste 1, que como a matriz é finita, temos um núnero finito de operações elementares a serem feitas. De maneira análoga ao anterior procedemos com a segunda linha, mas desta vez anulamos também os elementos não nulos CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 42 acima deste termo igual a 1, continuando com este processo até a r-ésima linha não nula. Claramente, só falta agora colocar a matriz para que a condição d seja satisfeita, mas para isso basta usar transposições de linhas, para colocar as linhas não nulas em ordem crescente. Finalmente temos que a matriz A é equivalente a uma matriz R escalonada reduzida, como querı́amos. Como consequência da proposição anterior, temos a seguinte aplicação. Proposição 3.1.4 Seja A ∈ Mn,m tal que n < m, então o sistema homogêneo AX = 0 admite uma solução não trivial. Dem. Como toda matriz A é equivalente a uma matriz R escalonada reduzida, pela proposição anterior segue que os sistemas homogêneos AX = 0 e RX = 0 admitem o mesmo conjunto de soluções. Logo estudemos o sistema RX = 0. Seja r o número de linhas não nulas da matriz R, logo segue que r ≤ n < m, portanto teremos no sistema homogêneo mais indeterminadas que equações, logo admite soluções não triviais, ou seja que o sistema homogêneo AX = 0 admite soluções não triviais. Veja que esta proposição diz que um sistema homogêneo da forma AX = 0, onde A ∈ Mn,m , só tem solução trivial se o número de linhas da matriz A é menor ou igual ao número de colunas desta matriz. Esta observação é muito importante para a seguinte proposição. Proposição 3.1.5 Seja A ∈ Mn , e se o sistema de equações lineares homogêneo AX = 0 admite só a solução trivial, então a matriz A é equivalente a matriz identidade In . Dem. Seja R a matriz escalonada reduzida associada a matriz A, e r o número de linhas não nulas da matriz R. Como o sistema AX = 0 só admite a solução trivial, então o sistema RX = 0 tambem tem só a solução trivial. Então, pela proposição 3.1.4 temos que r ≥ n, mas por outro lado r ≤ n que é o número de linhas não nulas da matriz R, portanto r = n. Logo, a partir da definição de R temos que R = In , como querı́amos. Exemplo 3.1.2 Consideremos o seguinte sistema homogêneo: x +y +z = 0 2y +z = 0 y +z = 0 admite somente a solução trivial, então é equivalente ao sistema homogêneo: = 0 x y = 0 z = 0 onde a matriz R neste caso é a matriz identidade I3 . CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 43 Consideremos agora o caso não homogêneo. Seja [A : Y ] a matriz aumentada associada ao sistema não homogêneo AX = Y , e seja [R : Z] a matriz escalonada reduzida associada a [A : Y ], e claro!!, associada ao sistema não homogêneo RX = Z. Como ambos sistemas têm o mesmo conjunto de soluções, basta estudar o sistema RX = Z. Seja r o número de linhas não nulas da matriz R, então segue que existem (n − r) indeterminadas em função das r outras indeterminadas x1 , ..., xr e escalares z1 , ..., zr . Logo, as (n − r) equações restantes são da forma : 0 = zr+1 .. .. . . 0 = zn Portanto, para um sistema não homogêneo ter solução, ou ser consistente, temos que zi = 0 para todo i > r, caso contrário, diremos que o sistema de equações lineares é inconsistente. Para exemplificar o anterior vejamos o seguinte exemplo. Exemplo 3.1.3 Consideremos o seguinte sistema de equações lineares não homogêneo: 2x +y +z = 7 y +z = 4 x = 1 Logo, 2 0 1 a matriz aumentada e 1 1 7 1 1 1 4 0 ֒→ L1 ∼L3 0 0 1 2 reduzida escalonada associada 0 0 1 1 0 0 1 1 4 0 1 1 ֒→ −2L1 +L3 1 1 7 0 1 1 1 0 0 1 onde a última matriz 0 0 sistema AX = B, dado acima. 0x + 0y + 0z = 1, vemos que o é dada por : 1 1 0 0 1 4 ֒→ 0 1 1 4 −L2 +L3 5 0 0 0 1 0 1 1 4 é escalonada reduzida, associada a matriz A, do 0 1 Pela última linha desta matriz, que representa a equação sistema não homogêneo AX = Y é inconsistente. Em geral temos o seguinte, dado um sistema não homogêneo da forma AX = B onde A ∈ Mn e X, B ∈ Mn,1 , temos claramente um sistema homogêneo associado, a saber, AX = 0. Será que existe relação entre os conjuntos de soluções dos dois sistemas anteriores? (Homogêneo e não Homogêneo?). Vamos supor que o sistema não homogêneo admite uma solução, digamos v ∈ Mn,1 tal que Av = B. Se considerarmos agora, uma solução u ∈ Mn,1 qualquer do sistema homogêneo AX = 0, é simples verificar que u + v tambem é uma solução do sistema não homogêneo AX = B. Então temos o seguinte resultado. CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 44 Proposição 3.1.6 Seja v ∈ Mn,1 uma solução do sistema não homogêneo AX = B onde A ∈ Mn e X, B ∈ Mn,1 . Então toda solução do sistema não homogêneo é da forma v + u onde u ∈ M1,n percorre as soluções do sistema homogêneo AX = 0 associado a AX = B. Dem. Só resta mostrar que toda solução do sistema não homogêneo AX = B é da forma v +u onde v é a solução particular fixa do sistema não homogênea, e u percorre as soluções do sistema homogêneo AX = 0. Seja z ∈ M1,n uma solução qualquer de AX = B, então como z é solução temos : n X aij zj = bi j=1 Mas, como v é uma solução particular de AX = B segue que: n X aij vj = bi j=1 Portanto, fazendo a diferença das duas igualdades anteriores segue que n X j=1 aij (zj − vj ) = 0 Portanto, z − v é uma solução do sistema homogêneo AX = 0. Então, existe uma solução u do sistema homogêneo AX = 0 tal que esta solução é da forma u = z − v, isto é, z = u + v como querı́amos. Exemplo 3.1.4 Consideremos o sistema de equações lineares dado no exemplo 3.1.1 dado por : L1 : 2x +4y = 80 L2 : 3x +2y = 60 Então, podemos considerar a solução (x = 10, y = 15) como sendo uma solução particular do sistema não homogêneo. Então procuremos a solução geral do sistema homogêneo associado, isto é, procuremos a solução de : L1 : 2x +4y = 0 L2 : 3x +2y = 0 que claramente tem como solução (x = 0, y = 0, então a solução de L1 : 2x +4y = 80 L2 : 3x +2y = 60 é realmente (x = 10, y = 15) = (0, 0) + (10, 15) Observe que se o sistema homogêneo AX = 0̄ admite infinitas soluções, então o sitema não homogêneo AX = B também admite infinitas soluções. CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 3.1.1 45 Exercı́cios 1. Reduza cada uma das seguintes matrizes a sua forma escalonada reduzida. 3 6 7 2 8 − 7 2 8 4 1 8 9 b) 2 − 3 5 c) − 1 4 0 a) − 6 8 1 − 5 6 1 6 24 12 2. Quais das seguintes matrizes são equivalentes por linhas?. 3 6 0 0 1 2 1 a) b) c) 2 1 4 4 3 4 3 1 0 0 − 2 1 0 2 1 1 4 − 3 2 f) 4 0 1 d) 0 4 0 e) 2 0 1 5 6 1 6 24 12 3. Usando escalonamento reduzido ache as soluções dos seguintes sistemas, se tiver. a) c) x +y −z = 0 2x +5y −2z = 0 x −y +z = 0 d) b) x −2y −z −w = 7 = 3 e) 2x −3y x −y −z +w = 1 x +y −z = 4 x −y +z = 2 3x −6y +2z = 0 5x −y +3z = 0 x −y +2z = 4 f ) 3x +y +4z = 6 x +y +z = 1 4. Mostre, geometricamente (Fazendo o gráfico de cada uma das equações do sistema linear) e algébricamente (Usando as ferramentas desenvolvidas ate aqui), que o seguinte sistema é consistente. x +y +z = 3 2y z = 2 +y +z = 2 5. Mostre, geometricamente e algébricamente, x +y x −y 2x +y que o sistema é inconsistente. = 2 = 0 = 2 CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 3.2 46 Inversão de Matrizes Nesta seção, estamos interessados em usar as informações dadas na seção 3.1, com relação a operações elementares, e trabalhar com o conceito de matrizes elementares para encontrar condições necessárias e suficientes para que uma matriz A seja inversı́vel. Definição 3.2.1 Seja A ∈ Mn . Diremos que a matriz A é uma matriz elementar, se ela se obtem da matriz identidade In , após ter realizado uma operação elementar em In . Denotaremos por Ei = ǫi (In ), a matriz elementar associada a operação elementar ǫi , onde i = 1, 2, 3, da definição 3.1.3. Exemplo 3.2.1 Consideremos o caso particular n = 3 na definição 3.2.1, e a partir das operações definidas em 3.1.3, podemos determinar algumas matrizes elementares onde c 6= 0 ∈ K: • Com relação a primeira elementares : 0 1 1 1 0 E1 = 0 0 operação elementar ǫ1 podemos ter as seguintes matrizes 0 1 0 0 0 0 1 0 E21 = 0 0 1 E31 = 0 1 0 1 0 1 0 1 0 0 Onde foi trocada a primeira linha com a segunda linha na primeira matriz, a segunda linha com a terceira linha na segunda matriz e finalmente primeira linha com a terceira linha. • Com relação a segunda operação elementar tares: c 0 0 1 2 2 0 1 0 0 E1 = E2 = 0 0 1 0 ǫ2 , temos as seguintes matrizes elemen 0 0 1 0 0 c 0 E32 = 0 1 0 0 1 0 0 c Onde foi multiplicada a primeira linha, a segunda e terceira linha por uma constante 0 6= c ∈ K, respectivamente. • Com relação a terceira operação elementar tares: 1 c 0 1 E13 = 0 1 0 E23 = c 0 0 1 0 ǫ3 temos as seguintes matrizes elemen 0 0 1 0 0 1 0 E33 = 0 1 0 0 1 0 c 1 Onde foi multiplicada a segunda linha por uma constante c 6= 0 ∈ K e somada na primeira linha, a segunda matriz é o resutado de multiplicar a primeira linha por uma constante c 6= 0 ∈ K e somada a segunda linha, e a terceira matriz foi multiplicado a segunda linha por uma constante c 6= 0 ∈ K e somada a terceira linha. CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 47 Proposição 3.2.1 Sejam A ∈ Mn,m , B ∈ Mp,n e ǫi uma operação elementar nas matrizes de ordem p × n, onde i = 1, 2, 3. Então (∗) ǫi (B) · A = ǫi (B · A) Dem. Sejam B1 , ..., Bp as linhas da matriz B, e C1 , ..., Cp as linhas da matriz C = B · A. A partir da definição de produto de matrizes, temos que Ci = Bi · A, onde i = 1, ..., p. Como temos três tipos de operações elementares, distinguiremos três casos: ǫ1 ) Trocar a linha r com a linha s. ′ Cr = Bs · A ′ ǫ1 rs (C) = Cs = Br · A ′ Ci = Ci i 6= r, s ǫ2 ) Multiplicar a r-ésima linha por c 6= 0 ∈ K. ′ Cr = cBr · A ǫ2 (C) = ′ Ci = Ci i 6= r ǫ3 ) Susbstituir a r-ésima linha pela linha r mais c vezes a linha s. ′ Cr = (cBs + Br ) · A ǫ3 (C) = ′ Ci = Ci i 6= r ′ Claramente, em cada um dos casos anteriores temos que Cj = ǫi (Bj ) · A, para todo j = 1, ..., p. Veja que a proposição 3.2.1 diz que, aplicar uma operação elementar numa matriz B, e depois multiplicar este resultado pela matriz A é análogo a primeiro fazer a multiplicação das matrizes B e A e depois aplicar a operação elementar. Como consequência direta da proposição 3.2.1, temos o seguinte corolário. Corolário 2 Seja A ∈ Mn,m e B = In . Então E · A = ǫ(In ) · A = ǫ(In · A) = ǫ(A) onde E é uma matriz elementar. Recordemos que ǫ(In ) é uma matriz elementar, ou seja o corolário anterior diz que, realizar uma operação elementar ǫi numa matriz A, é o mesmo que multiplicar a matriz A, pela matriz elementar ǫi (In ) = Ei associada a operação elementar ǫi , onde i = 1, 2, 3, definidas em 3.1.3. A partir da observação após a definição 3.1.3, temos que toda matriz elementar é inversı́vel. CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 48 Proposição 3.2.2 Sejam A, B ∈ Mn,m . Então A ∼ B se, e somente se, existe uma matriz inversı́vel P ∈ Mn tal que A = P · B e a matriz P é o produto finito de matrizes elementares. Dem. ⇒ ) Sejam A, B ∈ Mn,m tal que A ∼ B. Logo sabemos que existe um número finito de operações elementares, digamos ǫ1 , ..., ǫt tal que ǫt ·ǫt−1 · · · ǫ1 (A) = ǫt ·ǫt−1 · · · ǫ1 (In )·A = B onde ǫt · ǫt−1 · · · ǫ1 (In ) = P e como cada uma das matrizes elementares Ei = ǫi (In ) é inversı́vel, para todo i = 1, ..., t, segue que a matriz P é inversı́vel. ⇐ ) Vamos supor que existe uma matriz inversı́vel P = Et · · · E1 , onde cada uma das matrizes Ei , com i = 1, ..., t é matriz elementar e a matriz P é tal que A = P · B. Logo segue que E1 B ∼ B, e E2 · E1 · B ∼ B, e assim sucessivamente. Mas como só temos um número finito de matrizes segue que A ∼ B. Proposição 3.2.3 Seja A ∈ Mn . Então são equivalentes : i) A matriz A é inversı́vel. ii) A matriz A tem inversa à esquerda. iii) O sistema homogêneo AX = 0 só tem solução trivial. iv) A matriz A é o produto de matrizes elementares. Dem. i) ⇒ ii)) Seja A ∈ Mn inversı́vel, então por definição ela tem inversa pela direita e esquerda. ii) ⇒ iii)) Seja P a matriz inversa à esquerda da matriz A, logo multiplicando o sistema linear AX = 0 pela matriz P pela esquerda segue que: P (AX) = P · 0 ⇔ (P · A)X = 0 ⇔ In X = 0 ⇔ X = 0 Portanto, só tem a solução trivial X = 0. iii) ⇒ iv)) Seja R a matriz reduzida escalonada associada a matriz A, então segue que RX = 0 só admite a solução trivial, logo R = In . Portanto A ∼ In , e pela proposição 3.2.1, existe uma matriz inversı́vel P , dada pelo produto de matrizes elementares, tal que A = P · In = P . iv) ⇒ i)) Seja A = Et · · · E1 , onde Ei é uma matriz elementar com i = 1, ..., t. Logo, a matriz A é o produto finito de matrizes inversı́veis, então A é inversı́vel. Corolário 3 Seja A ∈ Mn . Se A tem inversa à esquerda (ou direita) então ela é inversı́vel. Corolário 4 Seja A ∈ Mn . Se A ∼ In se, e somente se A é inversı́vel. CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 49 Corolário 5 Seja A ∈ Mn . Se A é inversı́vel, então a mesma sequência de operações elementares aplicada na matriz In , obtemos a matriz A−1 . Dem. Como a matriz A é inversı́vel, temos que pelo corolário 4 que A ∼ In , isto é, A = Et · · · E1 · In , onde as matrizes Et , ..., E1 são matrizes elementares, logo inversı́veis, portanto temos que E1−1 · E2−1 · · · Et−1 · A = In e segue que A−1 = E1−1 · E2−1 · · · Et−1 = −1 −1 −1 −1 −1 ǫ−1 1 (In ) · ǫ2 (In ) · · · ǫt (In ) = ǫ1 · ǫ2 · · · ǫt (In ), como querı́amos. Corolário 6 Se [A : In ] ∼ [In : P ], então P = A−1 Dem. Como [A : In ] ∼ [In : P ], segue que existe uma matriz inversı́vel Q, dada pelo produto finito de matrizes elementares tal que [A : In ] = Q · [In : P ] ⇔ A = Q · In e In = Q · P ⇔ A−1 = Q−1 = P 2 4 3 Exemplo 3.2.2 Determinemos a matriz inversa de A = 3 6 5 . Pelo corolário 5 2 5 2 temos a seguinte matriz aumentada: 1 2 23 : 12 0 0 1 2 23 : 21 0 0 2 4 3 : 1 0 0 3 6 5 : 0 1 0 ֒→ 3 6 5 : 0 1 0 ֒→ 0 0 1 : −3 1 0 2 2 1 −3L1 +L2 L 2 1 2 5 2 : 0 0 1 2 5 2 : 0 0 1 2 5 2 : 0 0 1 : 21 0 0 : 12 0 0 1 2 23 1 2 23 : −3 1 0 ֒→ 0 1 −1 : −1 0 1 ֒→ 0 0 12 2 L2 ∼L3 −2L1 +L3 0 0 21 0 1 −1 : −1 0 1 : −3 1 0 2 1 0 27 : 25 0 −2 1 0 72 : 52 0 −2 ֒→ 0 1 −1 : −1 0 1 ֒→ 0 1 −1 : −1 0 1 2L3 −2L2 +L1 : −3 1 0 0 0 21 0 0 1 : −3 2 0 2 1 0 27 : 25 0 −2 ֒→ 0 1 0 : −4 2 1 L3 +L2 0 0 1 : −3 2 0 ֒→ −7 L3 +L1 2 1 0 0 : 13 −7 −2 0 1 0 : −4 2 1 0 0 1 : −3 2 0 Logo, a partir do corolário 5 temos a inversa da matriz A é dada pela matriz 13 −7 −2 1 A−1 = −4 2 −3 2 0 CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 50 Exemplo 3.2.3 No seguinte exemplo, mostraremos uma pequena aplicação a sistemas de equações lineares do uso de inversa de matrizes. Seja o seguinte sistema de equações lineares : 2x +4y +3z = 3 3x +6y +5z = −1 2x +5y +2z = 2 2 4 3 Que matricialmente, o sistema anterior está dado por : A·X = B onde A = 3 6 5 2 5 2 x 3 X = y e B = −1 . z 2 Portanto, a solução do sistema é dado por 13 −7 −2 3 39 + 7 − 4 42 1 · −1 = −12 − 2 + 2 = −12 X = A−1 · B = −4 2 −3 2 0 2 −9 − 2 + 0 −11 Exemplo 3.2.4 Recordemos que os geradores elétricos, como baterias, criam correntes elétricas num circuito elétrico e os resistores, como lâmpadas elétricas, limitam as magnitudes das correntes. Existêm três quantidades básicas associadas a circuitos elétricos : Potêncial elétrico (E), a resistência (R) e a intensidade (I), que são medidas en Volt, Ohms e Amperes respectivamente. Em um circuito elétrico, o potêncial elétrico entre dois pontos é dado pela diferença de potencial ou queda de tensão entre estes dois pontos. O fluxo da corrente em um circuito elétrico é dado por três principios básicos : a) A Lei de Ohm. A diferença de potencial através de um resistor é o produto da corrente que passa por ele e a resistência : E=IR b) A Lei da corrente de Kirchhoff. A soma algébrica da corrente fluindo ao interior de qualquer circuito elétrico é igual à soma das correntes fluindo para fora do ponto. c) A Lei de Voltagem de Kirchhoff. Em torno de qualquer circuito fechado, a soma algébrica das diferenças de potencial é zero. Então, consideremos a seguinte figura a seguir, e fazendo uso dos três princı́pios anteriores determinemos I1 , I2 e I3 : Logo, a partir do princı́pio da corrente de Kirchhhoff, dado em b) anterior, segue que : I1 = I2 + I3 No ponto A I2 + I3 = I1 No ponto B CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 51 A 7Ω I1 > I3 > I2 > 11Ω 3Ω 30V B 50V Figura 3.1: Circuito Elétrico Então temos que I1 − I2 − I3 = 0. Fazendo, uso do principio da voltagem de Kirchhoff, dado em c) anterior, temos : 7I1 + 3I3 = −30 −3I3 + 11I2 = −50 Agora, como I1 = I2 + I3 temos o seguinte sistema de equações lineares : 7 10 −30 7I2 + 7I3 + 3I3 = −30 11 −3 −50 −3I3 + 11I2 = −50 Fazendo uso de operações elementares segue que : −30 7 10 −30 1 10 1 7 7 ֒→ ֒→ 1 11 −3 −50 11 −3 −50 0 −11L +L 1 2 L 7 1 ֒→ −7 L 131 2 1 0 10 7 1 −30 7 20 131 Portanto, temos que I2 = ֒→ −10 L2 +L1 7 −590 131 e I3 = I1 = I2 + I3 = Como solicitado. 1 0 0 1 20 131 −590 131 20 131 10 7 −131 7 −30 7 −20 7 e logo, podemos tambem conhecer 20 −570 −590 + = 131 131 131 CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 52 Na seção 3.1 definimos operações elementares sobre as linhas, mas de maneira análoga podem ser definidas operações elementares sobre as colunas, e ao igual que antes, obter todos os resultados enunciados neste capı́tulo trocando, nos enunciados dos resultados, linhas por colunas. Logo, podemos dizer que as matrizes A, B ∈ Mn,m são equivalentes por coluna, que denotaremos por A∼B se fizermos um número finito de operações c elementares nas colunas da matriz B até obter a matriz A, e de maneira análoga diremos que uma matriz é dita elementar se ela pode-se obter da matriz identidade após ter feito uma operação elementar nas colunas da matriz identidade. Portanto, temos que, toda matriz elementar coluna é inversı́vel e toda matriz inversı́vel pode-se escrever como um produto finito de matrizes elementares colunas. Mas, sempre estaremos interessados nas operações linha, por uma questão de comodidade e familiaridade ao trabalhar com sistemas de equações lineares. 3.2.1 Exercı́cios 1 3 9 1. Reduza a matriz A = 2 8 4 a uma matriz escalonada reduzida R. Escreva a 3 6 7 matriz elementar em cada um dos passos, e depois ache a matriz inversı́vel P dada pelo produto destas matrizes elementares e verifique que R = P A. 2. Use o corolário 6 para verificar se a matriz é inversivel, e se fôr, calcule a sua inversa em cada um dos casos. 3 −2 1 9 6 −2 2 7 3 −3 b) 5 1 8 c) 5 9 2 a) 2 7 3 1 0 7 6 −5 3 1 9 7 5 12 3 1 5 −9 d) −2 9 −3 e) f) 7 −3 1 9 11 4 6 a b . Mostre, usando operações elementares que a matriz A é in3. Seja A = c d versı́vel se, e somente se, ad − bc 6= 0. 4. Ache a solução do seguinte sistema de equações lineares, usando operações elementares. 3x −7y = 4 −2x +5y = 8 5. Uma empresa de componentes eletrónicos, usa três tipos de máquinas P , Q e R para produzir três tipos de componentes eletrónicos A, B e C. As maquinas P , Q e R podem operar 80,60 e 90 horas por semana, respectivamente. A máquina P requer duas horas para produzir o componente eletrónico A, quatro horas para produzir o componente eletrónico B e duas horas para produzir o componente C. A CAPÍTULO 3. SISTEMAS DE EQUAÇÕES E INVERSÃO DE MATRIZES 53 máquina Q requer três horas para produzir o componente eletrónico A, duas horas para produzir o componente eletrónico B, e duas horas para produzir o componente C. A máquina R requer duas horas para produzir o componente eletrónico A, quatro horas para produzir o componente eletrónico B, e uma hora para produzir o componente C. Estamos interessados em determinar o número de unidades de cada componente eletrónico produzidos pelas máquinas P , Q e R por semana. 6. Fazendo uso da figura abaixo, determine I1 , I2 e I3 . A 10 Ω <I 1 < I3 I2 > 3Ω 6V B 9Ω 8V Figura 3.2: circuito elétrico 7. Fazendo uso do sistema alemão da primeira guerra mundial, visto no final do capı́tulo anterior, para decodificar a seguinte mensagem: 67 83 111 58 55 60 79 49 59 89 169 94 76 97 95 38 41 49 87 56 38 57 53 26 Capı́tulo 4 Espaços Vetoriais 4.1 Espaços Vetoriais Recordemos que nos capı́tulos 2 e 3 trabalhamos o conjunto Mn,m das matrizes de n linhas e m colunas, onde definimos a operação soma (ou operação interna) ⊕ : Mn,m × Mn,m −→Mn,m tal que (Mn,m , ⊕) era um grupo abeliano, mas também definimos o produto por escalar (ou operação externa) ⊙ : K ×Mn,m −→Mn,m tal que eram válidas as seguintes propriedades onde α, β, 1 ∈ K e A, B ∈ Mn,m : i) (α + β) ⊙ A = α ⊙ A ⊕ β ⊙ A ii) α ⊙ (A ⊕ B) = α ⊙ A ⊕ α ⊙ B iii) (α · β) ⊙ A = α ⊙ (β ⊙ A) iv) 1 ⊙ A = A A pergunta que surge é a seguinte. Será que existem outros conjuntos não vazios tais que possuam duas operações (uma operação interna e um produto por escalar) tal que sejam satisfeitas todas as propriedaes enunciadas no parágrafo anterior?. Em outras palavras, como serı́a a definição de uma ”soma”neste conjunto e, como serı́a a definição de multiplicação por escalar, tal que sejam válidas todas as propriedades do parágrafo anterior?. Veja que até agora as únicas operações que a maioria dos nossos alunos conhece são muito similares às enuncidas acima. Mas será que existem outras operações que atendam as exigências das propriedades anteriores, isto é, ter uma operação interna que seja um grupo Abeliano, e com a operação externa atenda as propriedades dadas pelo produto escalar?. Então, vejamos a seguinte definição. 54 CAPÍTULO 4. ESPAÇOS VETORIAIS 55 Definição 4.1.1 Seja V um conjunto não vazio e K um corpo. Diremos que V é um Kespaço vetorial se existem uma operação interna, que chamaremos de soma e denotaremos por ⊕ : V × V −→V tal que (V, ⊕) é um grupo abeliano e uma multiplicação por escalar que denotaremos · : K × V −→V tal que: i) (α + β) · v = α · v ⊕ β · v ii) α · (v ⊕ w) = α · v ⊕ α · w iii) (αβ) · v = α · (β · v) iv) 1 · v = v onde α, β, 1 ∈ K e v, w ∈ V Chamaremos de vetores os elementos do K-espaço vetorial V , e os denotaremos por letras minúsculas. Denotaremos por 0 o vetor nulo de V e ele existe, pois (V, ⊕) é um grupo abeliano. Vejamos agora alguns exemplos. Exemplo 4.1.1 Consideremos V = Mn,m com a soma ⊕ : Mn,m × Mn,m −→Mn,m e produto por escalar · : K × Mn,m −→Mn,m , então pelo capı́tulo 2 temos que (Mn,m , ⊕, ·) é um K-espaço vetorial. Exemplo 4.1.2 Seja V = R com a soma e produto usuais de R. Então, temos que (R, +, ·) é um R-espaço vetorial. Observe que todo corpo K com as suas operações de soma e multiplicação forma um K-espaço vetorial. Exemplo 4.1.3 Seja V = C = {a + bi/a, b ∈ R, onde i2 = −1} e K = R onde a soma é dada por (a + bi) ⊕ (c + di) = (a + c) + (b + d)i e o produto por escalar é definido por α · (a + bi) = αa + αbi , e a + bi, c + di ∈ V , e α ∈ R, também forma um R-espaço vetorial. n Exemplo 4.1.4 Pna somai PnSeja V =i {p(x) = an x + · · · + a0 /ai ∈ K, i = 0, · · · , n} onde p(x) ⊕ q(x) = 0 (ai + bi )x e a multiplicação por escalar é dada por α · p(x) = 0 (αai )x também forma um K-espaço vetorial. Exemplo 4.1.5 Seja V = {f : X−→K/X 6= Φ} onde a soma f ⊕ g = (f + g)(x) = f (x) + g(x) e o produto por escalar α · f = (αf )(x) = αf (x). Então, (V, ⊕, ·) é um K-espaço vetorial. CAPÍTULO 4. ESPAÇOS VETORIAIS 56 Proposição 4.1.1 Seja V um K-espaço vetorial. Então são válidas: i) ∀α ∈ K, temos que α · 0 = 0. ii) 0 · v = 0. iii) Se k · v = 0 onde k ∈ K, v ∈ V , então k = 0 ou v = 0. iv) ∀k ∈ K, ∀v ∈ V temos que (−k) · v = k · (−v) = −(k · v). v) Sejam v1 , · · · , vn ∈ V e c1 , · · · , cn , d1, · · · , dn ∈ K então (c1 · v1 ⊕ · · · ⊕ cn · vn ) ⊕ (d1 · v1 ⊕ · · · ⊕ dn · vn ) = (c1 + d1 ) · v1 ⊕ · · · (cn + dn ) · vn Dem. i) Como o conjunto V 6= Φ e (V, ⊕) é um grupo abeliano, temos que 0 ⊕ 0 = 0, segue que k · 0 = k · (0 ⊕ 0) = k · 0 ⊕ k · 0, agora como (V, ⊕) é um grupo abeliano, temos que k · 0 = 0. ii) Como K é um corpo, temos que 0+0 = 0, então segue que 0·v = (0+0)·v = 0·v ⊕0·v. Como (V, ⊕) é um grupo abeliano, segue que 0 · v = 0. iii) Seja k · v = 0, vamos supor que k 6= 0. Então, como K é um corpo, todo elemento não nulo de K admite inverso multiplicativo, logo existe k −1 tal que k −1 · (k · v) = (k −1 k) · 0 = 1 · 0 = 0 = v, como querı́amos. Agora, se o vetor v 6= 0, temos que o escalar k pode ser zero ou diferente de zero, mas se for diferente de zero, pelo anterior podemos concluir que o vetor v = 0, o que é uma contradição. Portanto k = 0. iv) Como sabemos que v ⊕ (−v) = 0, para todo vetor v ∈ V , temos que 0 = k · 0k · (v ⊕ (−v)) = k · v ⊕k · (−v), portanto segue que, −(k · v) = k · (−v). Por outro lado, como K é um corpo temos que k +(−k) = 0, logo 0 = 0·v = (k +(−k))·v = k ·v ⊕(−k)·v. Portanto, temos que −(k · v) = (−k) · v. Veja que se k = 1 temos que −v = (−1) · v. v) Segue diretamente da associatividade e da distributividade de (V, ⊕). CAPÍTULO 4. ESPAÇOS VETORIAIS 4.1.1 57 Exercı́cios 1. Mostre que o corpo dos números complexos é um espaço vetorial real, e que todo elemento de C pode ser escrito como uma combinação linear real dos elementos 1, i ∈ C. 2. Seja V = R2 i) Definamos:(x, y) + (x′ , y ′) = (x + x′ , y + y ′ ) e c(x, y) = (cx, cy) com c ∈ R. Com estas operações mostre que V é um espaço vetorial real. ii) Definamos: (x, y) ⊕ (x′ , y ′ ) = (3y + 3y ′, −x − x′ ) e c ⊙ (x, y) = (3cy, −cx). Verifique se V é um espaço vetorial real ou não. iii) Definamos: (x, y) + (x′ , y ′ ) = (x + x′ , y + y ′ ) e c(x, y) = (x + c, y + c). Verifique se V é ou não un espaço vetorial real. 3. Mostre que o conjunto S, solução do sistema não homogêneo AX = B, não forma um espaço vetorial. 4. Mostre que o conjunto W = {(0, x2 , ..., xn ) ∈ Rn } com as operações usuais de soma e produto por escalar de Rn forma um espaço vetorial real. 5. Verifique que o conjunto das matrizes diagonais de dois por dois, com as operações usuais de soma de matrizes e produto por escalar de matrizes, forma um espaço vetorial real. 4.2 Subespaços Vetoriais Um dos objetivos desta seção é dar uma forma mais prática para poder decidir se um conjunto não vazio V , juntamente com operações de soma e multiplicação por escalar, forma um espaço vetorial ou não. Definição 4.2.1 Seja V um k-espaço vetorial e seja W um subconjunto não vazio de V . Se o subconjunto W de V , forma um espaço vetorial com as operações induzidas de V , então diremos que W é um subespaço vetorial do espaço vetorial V . Veja que a definição anterior, realmente não ajuda muito para decidir se um conjunto V é um espaço vetorial ou não, pois para verificar se um subconjunto W de V é um subespaço vetorial ou não temos que mostrar que o conjunto (W, ⊕) é um grupo abeliano, e (W, ·, ⊕) satisfaz todas as propriedades do produto por escalar. Uma forma de resolver este problema é dado pela seguinte proposição. CAPÍTULO 4. ESPAÇOS VETORIAIS 58 Proposição 4.2.1 Seja V um K-espaço vetorial e Φ 6= W ⊆ V . Então W é um subespaço vetorial de V se, e somente se, ∀u, v ∈ W e α ∈ K o vetor α · u ⊕ v ∈ W . Dem. Seja V um K-espaço vetorial e Φ 6= W ⊆ V tal que W é um subespaço vetorial de V , portanto W é um espaço vetorial, logo segue que ∀u, v ∈ W, e α ∈ K, temos que α · u ⊕ v ∈ W. Seja W como acima, então como Φ 6= W , então W tem pelo menos um vetor, digamos u ∈ W , assim (−1)·u⊕u = 0 ∈ W , e logo temos que α·u = α·u⊕0 ∈ W para todo α ∈ K, em particular temos que (−1) · u = −u ∈ W , e também temos que u ⊕ v = 1 · u ⊕ v ∈ W Exemplo 4.2.1 Seja V um K-espaço vetorial. Então W = {0} é um subespaço vetorial, claramente se W = V , então W também é um subespaço vetorial. Estes espaços vetoriais são conhecidos como espaços vetoriais triviais. Veja que usando o fato de W = V não é necessário verificar as oito propriedades de espaço vetorial, isto se reduz a verificar a condição dada na proposição 4.2.1, i.e., para mostrar que V é um K-espaço vetorial, basta verificar a proposição 4.2.1. Exemplo 4.2.2 Sejam V = R3 e W = {(x, y, z)/x, y, z ∈ Z}. É facil verificar que se α ∈ R e (x, y, z) ∈ W , então α · (x, y, z) = (αx, αy, αz) ∈ / W , isto é, as coordenadas de (αx, αy, αz) não são necessariamente inteiras, logo não pode estar em W . Portanto W não é um subespaço vetorial. Exemplo 4.2.3 Seja V = Rn , e seja W = {(0, x2 , ..., xn )/xi ∈ R onde i = 2, ..., n}. Veja que W é um subespaço vetorial, pois sejam (0, x2 , ..., xn ), (0, y2, ..., yn ) ∈ W e seja α ∈ R, então α · (0, x2 , ..., xn ) ⊕ (0, y2 , ..., yn ) = (0, αx2 + y2 , ..., αxn + yn ) ∈ W , pois em W estão todas as n-uplas que tem a primeira coordenada nula. Exemplo 4.2.4 Seja V = {f : R−→R/f é uma funcão real}, então os seguintes conjuntos são subespaços vetoriais de V . Claramente o conjunto W = {f ∈ V /f é contínua} é subespaço vetorial de V, pois a partir dos cursos de cálculo temos que a soma de funções contı́nuas é contı́nua, e produto de funções contı́nuas também é contı́nua, em particular a multiplicação por escalar. Consideremos agora o conjunto Wp = {f ∈ V /f (−x) = f (x)}, que é o conjunto das funções pares, e consideremos o conjunto Wi = {f ∈ V /f (−x) = −f (x)} que é o conjunto das funções ı́mpares, ambos conjuntos são subespaços vetoriais de V . P Exemplo 4.2.5 Seja V = {p(x) = n0 ai xi /ai ∈ K, ∀i = 0, ..., n} e seja W = {p(x) ∈ V /ai = 0 se i é ímpar}. Então, a soma de polinômios de grau par continúa sendo de grau par, e como multiplicação por escalar não altera o grau do polinômio, temos que W é um subespaço vetorial de V . Exemplo 4.2.6 Seja V = Mn,m e consideremos os conjuntos Ws = {A ∈ V /At = A} e Wa = {A ∈ V /At = −A}. Como visto no capı́tulo 2, temos que tanto o conjunto Ws como o conjunto Wa são subespaços vetoriais de V . 59 CAPÍTULO 4. ESPAÇOS VETORIAIS Proposição 4.2.2 Seja T V um K-espaço vetorial e sejam U e W subespaços vetoriais não vazios de V . Então U W é um subespaço vetorial de V . Dem. Veja que, como U, W são subespaços não vazios, então o 0 ∈ U ∩ W . Sejam u, w ∈ U ∩ W e α ∈ K, então u, w ∈ U e u, w ∈ W , logo segue que α · u ⊕ v ∈ U e α · u ⊕ v ∈ W pois U e W são subespaços vetoriais de V , portanto α · u ⊕ v ∈ U ∩ W como querı́amos. Portanto, U ∩ W é um subespaço vetorial de V . Exemplo 4.2.7 Seja S o conjunto solução a11 x1 + · · · .. . a x + ··· n1 1 do seguinte sistema de equações homogêneo : +a1m xm = 0 .. . +anm xm = 0 O sistema anterior pode ser visto matricialmente como AX = 0, onde a matriz A é dada pelos coeficientes do sistema homogêneo. Claramente o conjunto solução S = S1 ∩ S2 ∩ ... ∩ Sn onde Si é o conjunto solução da i-ésima equação do sistema homogêneo. Veja que cada Si é um subespaço vetorial de K m , pois sejam x1 = (x11 , ..., x1m ) e x2 = (x21 , ..., x2m ) ∈ Si , ou seja, ai1 x11 + · · · + aim x1m = 0 ai1 x21 + · · · + aim x2m = 0 Então, a partir da proposição 4.2.1, temos que αx1 + x2 ∈ Si (verifique). Em geral, sejam X, X ′ ∈ S e seja α ∈ K, então A(α · X ⊕ X ′ ) = (α)AX ⊕ AX ′ = (α)0 ⊕ 0 = 0. Portanto, o conjunto solução S é um subespaço vetorial de K m .Observemos também que poderı́amos ter usado a proposição 4.2.2 para concluir o anterior. Exemplo 4.2.8 Sejam U = {(x, 0) ∈ R2 /x ∈ R}, W = {(0, y) ∈ R2 /y ∈ R}. Não é difı́cil verificar que tanto U como W são subespaços vetoriais de R2 . Veja que U ∪ W = {(x, y) ∈ R2 /x = 0 ou y = 0} não é um subespaço vetorial de R2 , pois, (1, 1) = (1, 0) + (0, 1) ∈ / U ∪ W não tem nenhuma das coordenadas igual a zero. Definição 4.2.2 Seja v ∈ V . Diremos que o vetor v é uma combinação linear dos vetores v1 , ..., vn ∈ V , se existem escalares c1 , ..., cn ∈ K tal que : v = c1 v1 + · · · + cn vn = n X ci vi 1 Exemplo 4.2.9 Seja V um K-espaço vetorial e sejam v1 , ..., vn vetores quaisquer P de V . Consideremos o seguinte conjunto W = {v ∈ V / existem c1 , ..., cn ∈ K onde vP= n1 ci vi }. Então, verifiquemos que o conjunto W é um subespaço de V . Sejam u = n1 ai vi , v = P n 1 ci vi ∈ W e seja α ∈ K, então temos que αu + v = α( n X 1 ai vi ) + n X 1 ci vi = n X 1 Portanto W é um subespaço vetorial de V . αai vi + n X 1 ci vi = n X 1 (αai + ci )vi ∈ W 60 CAPÍTULO 4. ESPAÇOS VETORIAIS Definição 4.2.3 Seja V um K-espaço vetorial. Diremos que o conjunto de vetores de V {v1 , ..., vn }, gera o espaço vetorial V , se ∀v ∈ V , existem escalares c1 , ..., cn ∈ K tal que v = c1 v1 + · · · + cn vn = n X ci vi 1 V = [v1 , ..., vn ] denotará que o espaço vetorial V é gerado pelo conjunto {v1 , ..., vn } Exemplo 4.2.10 Seja V = R2 , e sejam {e1 = (1, 0), e2 = (0, 1)}. Então, este conjunto gera V , pois, para quaisquer (x, y) ∈ V temos que (x, y) = x(1, 0) + y(0, 1) = xe1 + ye2 . Portanto o conjuto {e1 , e2 } é um conjunto gerador de V ou V = [e1 , e2 ]. Exemplo 4.2.11 Seja V = R3 e seja {v1 = (1, 0, 0), v2 = (0, 1, 0), v3 = (1, 1, 0)}, então este conjunto não gera V , pois basta considerar um vetor v = (x, y, z) tal que a terceira coordenada seja diferente de zero, então não é possı́vel achar escalares c1 , c2 , c3 ∈ R tal que v = c1 v1 + c2 v2 + c3 v3 . Exemplo 4.2.12 Seja V = M2 o conjunto das matrizes de dois por dois, então o con1 0 0 1 0 0 junto formado pelas matrizes {E1 = , E2 = , E3 = , E4 = 0 0 0 0 1 0 0 0 } é um conjunto gerador de V , pois para qualquer matriz A ∈ V temos que : 0 1 a b A= = aE1 + bE2 + cE3 + dE4 c d Exemplo 4.2.13 Denotemos por P3 (x) o conjunto de todos os polinômios de grau menor P3 i ou igual a três, isto é, P3 (x) = {p(x) = 1 ai x /ai ∈ K, i = 1, 2, 3}. Consideremos V = P3 (x) então o conjunto {p0 (x) = 1, p1 (x) = x, p2 (x) = x2 , p3 (x) = x3 } é um conjunto gerador de V = P3 (x). Exemplo 4.2.14 Sejam S1 , S2 dois subespaços vetoriais de V , e consideremos o conjunto S1 + S2 = {s1 + s2 /s1 ∈ S1 , s2 ∈ S2 }. Então S1 + S2 é um subespaço vetorial de V . Exemplo 4.2.15 Seja V = Mn e sejam S1 = {A ∈ V /At = A} e S2 = {A ∈ V /At = −A}, então V = S1 + S2 . Exemplo 4.2.16 Seja V = {f : K−→K/f é f uncão} e sejam S1 = {f ∈ V /f (−x) = f (x)} e S2 = {f ∈ V /f (−x) = −f (x)}, então V = S1 + S2 CAPÍTULO 4. ESPAÇOS VETORIAIS 4.2.1 61 Exercı́cios 1. Seja V = R3 . Verifique se W é um subespaço vetorial de V . a) W = {(x, y, z) ∈ V /x + y + z = 0} b) W = {(x, y, z) ∈ V /x ≥ 0} c) W = {(x, y, z) ∈ V /x2 + y 2 + z 2 ≧ 0} d) W = {(x, y, z) ∈ V /x, y, z ∈ Q} e) W = {(x, y, z) ∈ V /xyz = 0} 2. Se V = Mn (K), onde n ≧ 2. Verifique se os seguintes subconjuntos de V são subespaços vetoriais de V . a) W = {A ∈ V /AT = T A}. b) W = {A ∈ V /A2 = A}. c) W = {A ∈ V /det(A) 6= 0}. d) W = {A ∈ V /det(A) = 0}. 3. Seja V = {f : R−→R} o espaço das funções reais. Verifique quais dos seguintes conjuntos é um subespaço vetorial de V . a) W = {f : R−→R/f (0) = f (1)} b) W = {f : R−→R/f (3) = 0} c) W = {f : R−→R/f ′ (0) = 1} d) W = {f : R−→R/f (x) ≤ 0} 4. Seja V = Pn (R) o espaço vetorial dos polinômios de grau menor ou igual a n com coeficientes reais. Determine se os seguintes conjuntos são ou não subespaços vetoriais de V . a) W = P5 (R) b) W é o conjunto dos polinômios de grau n. c) W é o conjunto dos polinômios de grau par menor ou igual a n. d) W = Pn (Z) 5. Seja V um espaço vetorial, e W1 , W2 subespaços vetoriais de V . Então mostre que se W1 ∪ W2 é um subespaço vetorial de V , então temos que W1 ⊂ W2 ou W2 ⊂ W1 . 6. Seja V um espaço vetorial e W1 , W2 subespaços vetoriais de V . Mostre que se V = W1 + W2 e W1 ∩ W2 = 0̄, então todo vetor v ∈ V pode-se escrever de maneira única como combinação linear de W1 e de W2 . Neste caso diremos que o espaço vetorial V é a soma direta dos subespços W1 e W2 que denotaremos por V = W1 ⊕ W2 . CAPÍTULO 4. ESPAÇOS VETORIAIS 62 7. Prove que os espaços vetoriais V = Mn e V = {f : R−→R} admitem uma decomposição em soma direta de subespaços vetoriais. 8. Seja V o espaço vetorial formado por todas as retas no plano R2 . Sejam L1 , L2 ∈ V e W = {L ∈ V /L é ortogonal ás retas L1 , L2 } um subconjunto de V . Mostre que o conjunto W não é um subespaço vetorial de V . 9. Seja V o espaço vetorial formado por todas as retas no plano R2 . Seja W = {L ∈ V /L = ax onde a ∈ R} um subconjunto de V , então mostre que W é um subespaço vetorial de V . 10. Deteremine o valor de c tal que o vetor x = (1, −2, c) ∈ R3 seja combinação linear dos vetores x1 = (3, 0, −2), x2 = (2, −1, −5). 11. Escreva o polinômio p(t) = t3 + 4t2 + t + 1 como combinação linear dos polinômios p1 (t) = t3 + t − 2, p2 (t) = −t2 + 2t + 4, p3 (t) = t + 5. 12. Mostre que o conjunto de vetores {(0, 1, −1), (0, 1, 1), (1, 1, 1)} gera o espaço vetorial R3 . 13. Descreva geometricamente os subespaços vetoriais de R3 gerados pelos seguintes conjuntos. a) {(0, 1, 2), (0, 2, 3), (0, 3, 1)} b) {(0, 2, 1), (1, 1, 1), (2, 1, 4)} c) {(1, 2, 3), (1, −1, 1)} 14. Mostre que o conjunto { 1 0 0 1 0 1 } não gera V = M2 . , 1 0 15. Mostre que o conjunto {(1 − t)3 , (1 − t)2 , 1 − t, 1} gera o espaço vetorial V = P3 (K). CAPÍTULO 4. ESPAÇOS VETORIAIS 4.3 63 Dependência e Independência Linear Um dos conceitos mais importantes em Álgebra Linear é o de dependência e independência linear, que é também muito usado em outras áreas da Matemática ou na área de exatas, como em equações diferenciais ordinárias, para decidir se duas ou mais soluções de uma equação diferencial são linearmente independentes ou não, para construir o espaço completo de soluções da equações diferenciais ordinárias. Este conceito é dado na seguinte definição. Definição 4.3.1 Seja V um K-espaço vetorial e seja {v1 , ..., vn } um conjunto de vetores de V . Se a única solução para a equação vetorial c1 v1 + · · · + cn vn = 0 é c1 = c2 = · · · = cn = 0, então diremos que o conjunto {v1 , ..., vn } é linearmente independente que denotaremos por LI, caso contrário diremos que o conjunto {v1 , ..., vn } é linearmente dependente, que denotaremos por LD. Exemplo 4.3.1 Seja V = R3 e seja {e1 = (1, 0, 0), e2 = (0, 1, 0), e3 = (0, 0, 1)}, logo este conjunto é um conjunto linearmente independente. Exemplo 4.3.2 Seja V = R2 e consideremos o seguinte sub-conjunto de V = R2 , {v1 = (1, 1), v2 = (2, 5)} que é LI, pois sejam c1 , c2 ∈ K tal que: c1 v1 + c2 v2 = c1 (1, 1) + c2 (2, 5) = (c1 + 2c2 , c1 + 5c2 ) = (0, 0) se e somente se c1 = c2 = 0. Portanto, o conjunto {v1 = (1, 1), v2 = (2, 5)} é linearmente independente. Exemplo 4.3.3 Seja V = P3 (t), e consideremos o sub-conjunto de V = P3 (t) dado por {p1 (t) = t3 + 4t2 + 2t + 3 ; p2 (t) = t3 + 6t2 − t + 4; p3 (t) = 3t3 + 8t2 − 8t + 7}, este conjunto é um conjunto LD, pois sejam c1 , c2 , c3 ∈ K tal que c1 p1 (t) + c2 p2 (t) + c3 p3 (t) = c1 (t3 + 4t2 + 2t + 3) + c2(t3 + 6t2 − t + 4) + c3(3t3 + 8t2 − 8t + 7) (c1 + c2 + 3c3 )t3 + (4c1 + 6c2 + 8c3 )t2 + (2c1 − c2 − 8c3 )t + (3c1 + 4c2 + 7c3 ) = 0t3 + 0t2 + 0t + 0 admite uma solução não trivial ou não nula, logo o conjunto {p1 (t) = t3 + 4t2 + 2t + 3; p2 (t) = t3 + 6t2 − t + 4; p3 (t) = 3t3 + 8t2 − 8t + 7} é linearmente dependente. 1 −1 ; v2 = Exemplo 4.3.4 Seja V = M2 e consideremos o conjunto {v1 = 3 0 2 −2 }. Este conjunto é LD, pois sejam c1 , c2 ∈ K tal que 6 0 0 0 2 −2 1 −1 = + c2 c1 v1 + c2 v2 = c1 0 0 6 0 3 0 64 CAPÍTULO 4. ESPAÇOS VETORIAIS de onde temos que c1 = 1, c2 = −2, portanto o conjunto {v1 = 2 −2 } é linearmente dependente. 6 0 1 −1 3 0 ; v2 = Proposição 4.3.1 Sejam r, n ∈ N tal que r > n. Então qualquer conjunto com r vetores de K n é linearmente dependente. Dem. Seja {v1 , ..., vr } um conjunto de r vetores em K n e sejam c1 , ..., cr ∈ K tal que: c1 v1 + · · · + cr vr = 0 P Como vi ∈ K n , então tem n coordenadas e cada uma das coordenadas de r1 ci vi é igual a zero. Logo, temos um sistema homogêneo de n equações iguais a zero, onde o número de indeterminadas é maior que o número de equações, portanto admite uma solução não trivial, logo o conjunto é linearmente dependente como querı́amos. Proposição 4.3.2 Seja V um K-espaço vetorial. O conjunto {v1 , ..., vn }, onde n ≥ 2, é linermente dependente se, e somente se, pelo menos um dos vetores é uma combinação linear dos outros vetores. Dem. ⇒) Seja {v1 , ..., vn } um conjunto linearmente dependente de V . Então, existem escalares c1 , ..., cn não todos nulos tal que c1 v1 + · · · + cn vn = 0 Sem perda de generalidade, podemos supor que c1 6= 0, então segue que: c1 v1 = −c2 v2 − · · · − cn vn cn c2 v1 = − v2 − · · · − c1 c1 Portanto, o vetor v1 é uma combinação linear dos vetores v2 , ..., vn . ⇐) Sem perda de generalidade, vamos supor que v1 = c2 v2 + · · · + cn vn logo, −v1 + c2 v2 + · · · + cn vn = 0, portanto o conjunto {v1 , ..., vn } é linearmente dependente. Corolário 7 Seja V um K-espaço vetorial. Qualquer subconjunto de vetores de V que contenha um subconjunto linearmente dependente, é linearmente dependente. Dem. Seja {v1 , ..., vn } um subconjunto qualquer de vetores de V . Se o conjunto {v1 , ..., vn } já é linearmente dependente, então não temos nada a mostrar. Consideremos o subconjunto {v1 , ..., vr } do conjunto {v1 , ..., vn } linearmente dependente, onde r < n. Logo, existem escalares c1 , ..., cr ∈ K, não todos nulos tal que c1 v1 + · · · + cr vr = 0 ⇔ c1 v1 + · · · + cr vr + 0vr+1 + · · · + 0vn = 0 Portanto, a combinação anterior mostra que como os c′i s não são todos nulos, então o conjunto {v1 , ..., vn } é um conjunto linearmente dependente. CAPÍTULO 4. ESPAÇOS VETORIAIS 65 Corolário 8 Seja V um K-espaço vetorial. Qualquer subconjunto {v1 , ..., vn } de vetores de V que contém o vetor nulo é linearmente dependente. Corolário 9 Seja V um K-espaço vetorial. Qualquer subconjunto de um conjunto linearmente independente é linearmente independente. Dem. Seja {v1 , ..., vn } um subconjunto linearmente independente de vetores de V e seja {v1 , ..., vr } um subconjunto de {v1 , ..., vn }, isto é, r < n, pois se r = n não temos nada a mostrar. Se {v1 , ..., vr } é linearmente dependente, então pelo corolário 8 temos que o conjunto {v1 , ..., vn } é linearmente dependente, o que induz a contradição. Portanto o subconjunto {v1 , ..., vr } é linearmente independente. Exemplo 4.3.5 Seja V = R3 , e seja {u = (1, −2, 3), v = (2, −4, 6), w = (1, 1, 1)} um subconjunto de vetores de V . Este subconjunto é linearmente dependente, pois 2u − v + 0w = (0, 0, 0). 4.3.1 Exercı́cios 1. Mostre que: a) Se v 6= 0 ∈ V , então o conjunto formado pelo vetor v é, linearmente independente. b) Sejam u, v ∈ V . O conjunto formado pelos vetores u e v são linearmente dependentes se, e somente se, um deles é múltiplo do outro. 2. Decida se o seguinte conjunto é LI ou LD e justifique. a) {u = (1, −3), v = (3, 5)} b) {u = (4, 3, −3), v = (2, 7, 5)} 2 4 9 1 3 4 } ,v = c) {u = 0 6−3 2 7 −5 d) {p1 (t) = 3t2 + 3t − 8, p2 (t) = −t2 + 5t + 7} 3. Determine três vetores de R3 que sejam LD, mas, dois quaisquer destes vetores sejam LI. 4. Seja V um espaço vetorial e sejam u, v, w ∈ V , tal que o subconjunto {u, v, w} é LI, então mostre que o conjunto {u + v, v + w, u + w} também é um conjunto LI. 5. Seja V = M2 . Determine se os seguintes conjuntos são LI ou LD e justifique. 1 3 3 −1 1 −5 } ,C = ,B = a) {A = 3 1 2 2 4 0 66 CAPÍTULO 4. ESPAÇOS VETORIAIS b) {A = 1 0 0 0 ,B = 0 1 0 0 ,C = 0 0 1 1 } 6. Seja V = P3 (R). Determine se o conjunto a seguir é LI ou LD e justifique. a) {p1 (t) = 9t3 − 6t2 + 9t − 3, p2 (t) = 3t3 − 3t + 1} b) {p1 (t) = 2t3 − 4t2 + 9t + 5, p2(t) = 3t3 − 8t2 − 8t + 7} 7. Seja V o espaço das funções reais. Determine se os seguintes conjuntos de funções a seguir são LI ou LD e justifique. a) {f (t) = sent, g(t) = cost, h(t) = t} b) {f (t) = t2 , g(t) = t, h(t) = 1} 8. Mostre que os vetores u = (1 + i, 2i), v = (1, 1 + i) ∈ C2 são linearmente independentes sobre o corpo C, mas não sobre o corpo R. 9. Mostre que se o conjunto {v1 , ..., vn } é LI e {v1 , ...vn , v} é LD, então o vetor v é combinação linear do conjunto {v1 , ...vn }. 10. Sejam v1 , ..., vn vetores LI, e suponha que v = a1 v1 + · · · + an vn , onde a1 , ..., an ∈ K. Mostre que estes escalares são únicos. 4.4 Base e Dimensão Um dos objetivos de uma democracia, é achar um certo conjunto de representantes na população, denominados deputados, de tal maneira que com o parecer deles possam ser definidas as metas e objetivos de um paı́s, sem ter que a cada momento seja consultada a população. Esta ideia pode ser vista na seguinte definição. Definição 4.4.1 Seja V um K-espaço vetorial e seja B = {v1 , ..., vn } um subconjunto de vetores de V . Diremos que B é uma base de V se: i) ∀v ∈ V , existem escalares c1 , ..., cn ∈ K tal que v = c1 v1 + · · · + cn vn . ii) O conjunto B é linearmente independente. Veja, que se o subconjunto B = {v1 , ..., vn } forma uma base para o espaço vetorial V , então qualquer informação de um outro elemento v do espaço vetorial V , pode ser obtido a partir deste conjunto B = {v1 , ..., vn }, que vem a ser os representantes do espaço vetorial V. Exemplo 4.4.1 Sejam V = R3 , e B = {(1, 0, 0), (0, 1, 0), (0, 0, 1)}. Então, claramente este conjunto gera e é linearmente independente em V , portanto é uma base de V . 67 CAPÍTULO 4. ESPAÇOS VETORIAIS Exemplo 4.4.2 Seja M2 o conjunto das o subcon por dois, então matrizes de dois V = 0 0 0 0 0 1 1 0 }, é um , E4 = , E3 = , E2 = junto B = {E1 = 0 1 1 0 0 0 0 0 conjunto gerador de V , pois para qualquer matriz A ∈ V temos que : a b A= = aE1 + bE2 + cE3 + dE4 c d Claramente é linearmente independente, portanto o subconjunto B é uma base de V = M2 . Exemplo 4.4.3 Seja S = {(x, y, z) ∈ R3 /z = x + y}. Então, qualquer vetor da forma (x, y, x + y) está no conjunto S. Mas, por outro lado, temos que (x, 0, x) + (0, y, y) = x(1, 0, 1) + y(0, 1, 1) Então, o conjunto B = {(1, 0, 1), (0, 1, 1)} é uma base do conjunto S. Exemplo 4.4.4 Seja V = P3 (t), então o conjunto B = {p0 (t) = 1, p1 (t) = t, p2 (t) = t2 , p3 (t) = t3 } é uma base de V . Exemplo 4.4.5 Seja V = R2 , então o vetor (1, 1) é linearmente independente em V , mas não é base, pois não consegue gerar todo V , ele só pode gerar a reta r(1, 1). Por outro lado, o conjunto B = {(1, 0), (0, 1), (1, 1)} gera V , mas não é linearmete independente. Proposição 4.4.1 Seja B = {v1 , ..., vn } uma base de V . Então, ∀v ∈ V , existem únicos c1 , ...cn ∈ K tal que v = c1 v1 + · · · + cn vn . Dem. Como B é uma base de V , sabemos que existem escalares c1 , ..., cn ∈ K tal que v = c1 v1 + · · · + cn vn . Então, resta mostrar que estes escalares são únicos, logo vamos ′ ′ supor que existem outros escalares c1 , ..., cn ∈ K tal que ′ ′ ′ ′ v = c1 v1 + · · · + cn vn = c1 v1 + · · · + cn vn ⇔ (c1 − c1 )v1 + · · · + (cn − cn )vn = 0 ′ Mas como B é base, logo é linearmente independente, então temos que c1 = c1 , ..., cn = cn mostrando assim a unicidade. ′ Proposição 4.4.2 Sejam V um K-espaço vetorial, e B = {v1 , ..., vn } uma base de V . Então, qualquer outra base de V tem o mesmo número de vetores. Dem. Seja A = {w1 , ..., wm } uma outra base do espaço vetorial V . Então mostremos que as duas bases têm o mesmo número de vetores, isto é, que n = m. Como B é uma base de V e os vetores w1 , ..., wm ∈ V temos, um sistema de m equações e n indeterminadas dado por: w1 = a11 v1 + a12 v2 + · · · a1n vn .. .. .. . . . w = a v + a v + ··· a v m m1 1 m2 2 mn n 68 CAPÍTULO 4. ESPAÇOS VETORIAIS Vamos supor por absurdo, isto é, vamos supor primeiro que m > n. Então, temos mais equações do que indeterminadas, ou seja w1 v1 .. . . = A .. wm vn a11 a12 · · · a1n .. .. onde a matriz A = . ∈ Mmn . Consideremos agora a matriz . am1 am2 · · · amn At ∈ Mnm e o sistema homogêneo, induzido pela matriz At , dado por: c1 0 .. t .. A . = . cm 0 Agora, como o número de equações é menor que o número de indeterminadas (n < m), c1 o sistema homogêneo anterior admite soluções não triviais, digamos ... , portanto: cm t t t c1 0 c1 t .. .. .. t A . = . ⇔ . (At ) = (0 · · · 0) cm 0 c m t c1 .. ⇔ . A = (0 · · · 0) cm v1 Multiplicando esta última igualdade pelo vetor ... segue que : vn t v1 v1 c1 . .. .. . A . = (0 · · · 0) .. = 0v1 + · · · 0vn = 0 vn vn cm v1 w1 .. .. mas como A . = . segue que : vn wm t c1 w1 .. .. . . = 0 ⇔ c1 w 1 + · · · cm w m = 0 cm wm 69 CAPÍTULO 4. ESPAÇOS VETORIAIS Portanto, o conjunto A é linearmente dependente, o que é uma contradição. De maneira análoga, se considerarmos n < m, podemos obter uma contradição. Portanto, temos que n = m como querı́amos. Definição 4.4.2 Seja n ∈ N. Se a base de um espaço vetorial V tem n vetores, diremos que o K-espaço vetorial V tem dimensão finita n, que denotaremos por dimK V = n. O espaço vetorial formado pelo vetor nulo, tem dimensão zero. No seguinte exemplo, usaremos o conceito de Grafo Orientado ou Grafo dirigido, dado na definição 2.4.3, para mostrar uma estrutura especial de espaço vetorial de dimensão finita. Exemplo 4.4.6 Consideremos o seguinte Grafo dirigido, dado pela figura abaixo : α • −→ • V1 V2 Onde, V1 e V2 são os vértices e α um caminho ligando os dois vértices. Então, podemos considerar o espaço vetorial formado pelos caminhos e1 , e2 e α, onde os caminho e1 , e2 representam os caminhos triviais (não sair do lugar ou do vértice) associados aos vértices V1 , V2 respectivamente. Logo, temos um espaço vetorial de dimensão três. Agora, se V1 = V2 , temos o caminho trivial e1 e α, α2, ...., isto é, temos um espaço vetorial de dimensão infinita, que não é difı́cil de mostrar que este espaço vetorial coincide com o anel dos polinômios na indeterminada x, ou K[x]. Exemplo 4.4.7 Vejamos os seguintes exemplos conhecidos: 1. Seja V = K n = Rn , tem dimensão n. 2. Seja V = Pn (K). Este espaço vetorial tem dimensão n + 1 = dimK Pn (K). 3. Seja V = Mn então dimK Mn = n2 . 4. Seja V = Mm,n , então dimK Mn,m = nm. CAPÍTULO 4. ESPAÇOS VETORIAIS 70 Corolário 10 Seja V um K-espaço vetorial tal que dimK V = n. Então : i) Todo conjunto com mais de n vetores de V é um conjunto linearmente dependente. ii) Todo conjunto com n vetores linearmente independentes de V , é uma base de V . Dem. i) Seja B = {v1 , ..., vn } uma base do espaço vetorial V , e seja {u1 , ..., um } um subconjunto de V com mais de n vetores. Então, temos que: u1 = a11 v1 + · · · +a1n vn .. .. . . u m = am1 v1 + · · · amn vn Então, pelo argumento da proposição anterior o conjunto {u1, ..., um } é linearmente dependente. ii) Seja {u1 , ..., un } um conjunto linearmente independente de V . Como dimK V = n, o conjunto {u1 , ..., un , v} que tem n+1 vetores é um conjunto linearmente dependente, pela parte i) anterior, onde o vetor v ∈ V é qualquer. Então, existem escalares c1 , ..., cn , c ∈ K não todos nulos (pois o conjunto anterior é LD), tal que : c1 u1 + · · · + cn un + cv = 0 Veja que c 6= 0 , pois caso contrário, temos que: c1 u 1 + · · · + cn u n = 0 e como o conjunto {u1 , ..., un } é linearmente independente, segue que c1 = c2 = · · · = cn = 0, o que é uma contradição, pois pelo menos um dos escalares c1 , c2 , · · · , cn , c é diferente de zero, visto que o conjunto {u1, ..., un , v} é linearmente dependente. Portanto c 6= 0 e temos que: v= −c1 −cn u1 + · · · + un c c Logo, segue que o conjunto {u1 , ..., un } é um conjunto gerador de V , como querı́amos. A partir do corolário e proposições anteriores, temos que para todo vetor v ∈ V , onde dimK V = n. Este vetor pode-se escrever de maneira única como combinação linear da base ordenada B = {v1 , ..., vn }, onde suas novas coordenadas são dadas pelos escalares c1 , ..., cn ∈ K tais que v = c1 v1 + · · · + cn vn . As coordenadas vetoriais do vetor v serão c1 .. denotadas por: [v]B = . , então temos a seguinte definição. cn CAPÍTULO 4. ESPAÇOS VETORIAIS 71 Definição 4.4.3 Seja v ∈ V , onde V é um espaço vetorial de dimensão finita n e base B = {v1 , ..., vn }. Então v = c1 v1 + · · · + cn vn onde os escalares c1 , ..., cn ∈ K. Estes escalares são chamados de coordenadas do vetor V com relação a base ordenada B, e o vetorcoluna c1 [v]B = ... é chamada de matriz coordenada de v com relação a base ordenada B. cn Exemplo 4.4.8 Seja V = P2 (K) o espaço vetorial dos polinômios de grau menor ou 2 igual a dois, e seja B = {1, t, t2 } uma base de V . Seja p(t) = 2t − 5t + 3 ∈ V , então a 3 matriz coordenada associada a p(t) é dada por [p(t)]B = −5 . 2 O exemplo anterior mostra dois fatos relevantes, o primeiro é dado pela ordem da base, já que esta ordem determina o posicionamento das coordenadas de seu vetor coordenada associado. Isto também determina uma correspondência biunı́voca entre os vetores v ∈ V e sua matriz coordenada, dada pelos escalares determinados pela combinação linear da base. Proposição 4.4.3 Todo conjunto finito de geradores de um espaço vetorial não nulo V , contém um subconjunto que é uma base de V . Dem. Seja B = {v1 , ..., vm } um conjunto de geradores de V . Como o espaço vetorial V não é nulo, então o conjunto B deve conter vetores não nulos, e como B é um conjunto finito, podemos considerar o subconjunto B′ = {v1 , ..., vm } ⊆ B maximal, no sentido que é o maior subconjunto de B que contém todos os vetores linearmente independentes de B. Vamos supor que B′ contém n vetores, então n ≤ m. Se n = m, então B é a base procurada, logo só nos resta uma única possibilidade, a saber n < m. Por outro lado, qualquer conjunto da forma {v1 , ..., vn , vn+i }, onde i = 1, ..., m − n é linearmente dependente, pois o conjunto B′ , é um subconjunto maximal de vetores linearmente independentes. Logo, como o conjunto {v1 , ..., vn , vn+i } é linearmente dependente, temos que existem escalares c1 , ..., cn , cn+i não todos nulos tal que: c1 v1 + · · · + cn vn + cn+i vn+i = 0 de onde se deduz que cn+i 6= 0, pois caso contrário, terı́amos que algum dos escalares c1 , ..., cn é diferente de zero, logo o conjunto B′ é linearmente dependente, o que uma contradição. Logo, temos que vn+i = −cn −c1 v1 + · · · + vn cn+i cn+i Portanto, o conjunto B′ é linearmente independente e gera V , logo é uma base. 72 CAPÍTULO 4. ESPAÇOS VETORIAIS Mostremos uma forma prática de encontrar uma base, a partir de um conjunto de vetores dados. Seja V um K-espaço vetorial de dimensão finita n > 1, vejamos uma forma prática de mostrar que todo conjunto linearmente independente pode ser completado a uma base. Fixemos uma base B = {v1 , ..., vn } de V e seja C = {w1 , ..., wk } um conjunto não necessariamente linearmente independente de de vetores de V . Recordemos que cada vetor wi , onde i = 1, ..., k, pode-se escrever da seguinte forma, na base B. wi = n X aij vj j=1 Então temos a seguinte matriz A ∈ Mk,n cujas linhas são formadas pelas coordenadas do vetor wi : a11 a12 · · · a1n .. .. A = ... . . ak1 ak2 · · · akn Consideremos agora a matriz reduzida M = (βij ) ∈ Mk,n obtida da matriz A anterior. Como temos visto no capı́tulo 3, as linhas da matriz M = (βij ) foram obtidas a partir de operações elementares nas linhas da matriz A, então os subespaços vetoriais gerados por w1 , ..., wk e o gerado por {u1 = (β11 , ..., β1n ), ..., uk = (βk1 , ..., βkn )} são o mesmo. Veja que neste processo de escalonamento, algumas linhas da matriz M podem ser nulas, ou seja, que alguns dos vetores {u1 , ..., uk } poderiam ser o vetor nulo. Reagrupando os vetores, e renomeando se fôr necessário, podemos considerar que u1 , ..., ul (l < k) são vetores diferentes do vetor nulo. A partir do escalonamento reduzido, cada um dos vetores u1 , ..., ul tem uma posição igual a 1, de esquerda para direita da matriz. Logo, os vetores u1 , ..., ul são linearmente independentes e como geram o mesmo espaço gerado pelos vetore w1 , ..., wk , temos que o conjunto u1 , ..., ul forma uma base para W . Sem perda de generalidade, vamos supor que o conjunto C = {w1 , ..., wk } é linearmente independente e que k < n. Assim, a matriz M terá k linhas não nulas e n − k linhas nulas. Consideremos a seguinte matriz M ∈ Mn , definida da seguinte forma: • As primeiras k linhas de M são as k primeiras linhas da matriz M. • As n−k linhas restantes são definidas da seguinte forma : Para cada coluna j dentre as n − k que não têm 1, coloque uma linha com 1 na coluna j e zero no resto das colunas. Desta forma a matriz M tem n linhas não nulas, e pela construção anterior, o conjunto das linhas da matriz M formam um conjunto linearmente independente em V , e portanto uma base ( pois dimK V = n ). Vejamos o seguinte exemplo para mostrar esta construção. Exemplo 4.4.9 Seja V = P3 (K). Vamos construir uma base para V a partir dos seguintes vetores: p1 (x) = 1 + 2x − x2 + 3x3 e p2 (x) = 2 + 4x + x2 + 6x3 . Consideremos a base B = {1, x, x2 , x3 } canônica de P3 (x). Então claramente a matriz A é dada por: 1 2 −1 3 A= 2 4 1 6 CAPÍTULO 4. ESPAÇOS VETORIAIS 73 Fazendo o escalonamento reduzido temos que a matriz M é dada por: 1 2 0 3 0 0 1 0 O anterior mostra que o conjunto {p1 (x), p2 (x)} é um conjunto linearmente independente (tem duas linhas não nulas na matriz M). Como V tem dimensão 4, faltam duas linhas. Veja que falta 1 na segunda coluna e na quarta coluna, logo temos a seguinte matriz: 1 2 0 3 0 0 1 0 M = 0 1 0 0 0 0 0 1 Assim, B′ = {p1 , p2 , x, x3 } forma uma base de V = P3 (K) e claramente contém {p1 , p2 }. 4.4.1 Exercı́cios 1. Verifique quais dos seguintes conjuntos de vetores formam uma base para V = R3 . a) {(1, 2, 1), (1, 3, 0), (0, 1, −1)} b) {(1, 0, 1), (2, 0, 1), (1, 1, 1)} c) {(1, 1, 1), (1, 0, 0), (0, 1, 0), (0, 0, 1)} d) {(2, 1, 4), (1, 2, 3)} 2. Seja B = {(1, 4, 2), (3, 0, −1), (2, −1, −1)} uma base de R3 . Escreva o vetor (17, 3, 19) como combinação linear dos elementos da base B. 3. Mostre que os conjuntos {t2 + t, t, 1} e {t2 + t, t, t + 1} são base de V = P2 (K). x x ∈ M2 /x ∈ K}. Mostre que W é um subespaço de V = M2 e 4. Seja W = { 0 0 ache a base de W . 5. Seja B = {v1 , v2 , v3 } uma base para o espaço vetorial V , então mostre que o conjunto B′ = {v1 + v2 , v2 + v3 , v1 + v3 } também é uma base de V . 6. Seja V um espaço vetorial que é gerado por sete vetores, então o que você pode afirmar com relação à dimensão de V ?. E estes sete vetores são linearmente dependentes?. 7. Calcule a dimensão de cada um dos subespaços vetoriais de V = M2 (K) a) {A ∈ V /At = A} b) {A ∈ V /At = −A} 74 CAPÍTULO 4. ESPAÇOS VETORIAIS c) {A = (aij ) ∈ V /a11 = a22 = 0} d) {A = (aij ) ∈ V /a21 = a12 = 0} 8. Seja x ∈ R2 , escreva a matriz coordenada [v]B na base B a seguir: i) v = (6, 2) e B = {(1, 0), (0, 1)} ii) v = (6, 2) e B = {(0, 1), (1, 0)} iii) v = (6, 2) e B = {(1, 3), (2, 5)} 9. Seja A ∈ M2 escreva [A]B 1 0 0 a) B = { , 0 0 0 1 0 0 , b) B = { 2 0 1 1 1 0 , c) B = { 0 0 0 na base B 1 0 , 0 1 1 0 , 0 0 1 2 , 2 0 a seguir: 0 0 , 0 0 1 2 , 0 0 0 0 , 0 0 0 1 0 0 0 01 }eA= }eA= 13 4 5 7 16 8 2 4 5 8 }eA= 5 2 10. Seja p(t) ∈ P1 (K) escreva [p(t)]B na base B a seguir: a) p(t) = 2t + 3 e B = {t, 1} b) p(t) = 2t + 3 e B = {t + 1, 2t − 3} c) p(t) = 5t + 4 e B = {t + 1, 2t − 3} 11. Ache uma base, formada pelos caminhos do seguinte grafo dirigido : 1 3 2 4 12. Se W é um subespaço de um espaço vetorial V de dimensão finita n, mostre que dimK W ≤ n. Em particular, se dimK W = dimK V , então W = V . 13. Encontre uma base para V = R4 que contenha os vetores {(1, 3, 8, 5), (1, 1, 4, 2)}. 14. Seja V = P4 (K). Encontre uma base para V que contenha os vetores {1 + 2x + 3x2 − x4 , 1 − 3x2 + x3 − x4 }. Capı́tulo 5 Transformações Lineares e Cônicas 5.1 Transformações Lineares No curso de Cálculo I, por exemplo, estuda-se como relacionar os Reais R com ele mesmo. Para estudar esta relação, é usado o conceito de funções em particular o conceito de funções contı́nuas, derivávaeis etc.. Mas recordemos que temos mostrado no capı́tulo 4 que o conjunto dos números reais R é, em particular, um R-espaço vetorial, então a pergunta que surge é a seguinte. como seriam as funções que relacionam R com ele mesmo, mas que preservem a sua estrutura de espaço vetorial?. Então, o nosso objetivo, neste capı́tulo é estudar uma situação mais geral que a anterior, isto é, como dois k-espaços vetoriais V e W podem-se relacionar, preservando a sua estrutura de espaço vetorial, e assim temos a seguinte definição. Definição 5.1.1 Sejam (V, +, ·) e (W, ⊕, ⊙) dois k-espaços vetoriais. A transformação T : V −→W é dita uma transformação linear se : i) T (u + v) = T (u) ⊕ T (v) ii) T (λ · v) = λ ⊙ T (v) ∀u, v ∈ V, λ ∈ K Veja, que na definição 5.1.1, demos ênfases em denotar de maneira diferente as operações de soma e operação por escalar tanto em V como em W , para mostrar que uma transformação linear preserva tanto a soma como a multiplicação por escalar do espaço vetorial V , ou seja transforma soma em V em uma soma em W , e a multiplicação por escalar em V em uma multiplicação por escalar em W . Por outro lado, veja que se T : V −→W é uma transformação linear, então T (0V ) = T (0 · 0V ) = 0 ⊙ T (0V ) = 0W . Uma forma prática de verificar se uma transformação T : V −→W é linear ou não é dada pela seguinte proposição. 75 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 76 Proposição 5.1.1 Sejam V, W dois k-espaços vetoriais e T : V −→W uma transformação. Então T : V −→W é uma transformação linear se, e somente se, T (u + λ · v) = T (u) ⊕ λ ⊙ T (v) para todo u, v ∈ V e λ ∈ K. Dem. ⇒) Seja T : V −→W uma transformação linear e u, v ∈ V e λ ∈ K. Então a partir da definição 5.1.1 parte i), temos que T (u + λ · v) = T (u) ⊕ T (λ · v), agora pela parte ii) da mesma definição segue que T (u + λ · v) = T (u) ⊕ λ ⊙ T (v), como querı́amos. ⇐) Vejamos que se λ 6= 0 ∈ K, então T (0V ) = T (0V + λ · 0V ) = T (0V ) ⊕ λ ⊙ T (0V ). Mas como (W, ⊕) é um grupo abeliano, podemos cancelar T (0V ) da igualdade anterior e, portanto, segue que λ ⊙ T (0V ) = 0W , mas como λ 6= 0 segue que T (0V ) = 0W . Po outro lado, T (λ · v) = T (0V + λ · v) = T (0V ) ⊕ λ ⊙ T (v) = λ ⊙ T (v) pois T (0V ) = 0W . Portanto, vale ii) da definição 5.1.1. Mostremos agora a parte i) da definição 5.1.1. Sejam u, v ∈ V , então T (u + v) = T (u + 1 · v) = T (u) ⊕ 1 ⊙ T (v) = T (u) ⊕ T (v), como querı́amos. Logo, T é uma transformação linear. Exemplo 5.1.1 1. Seja A ∈ Mm,n então definamos T : K n −→K m por TA (x) = Ax ∀x ∈ K n . Então, T é linear pois, TA (x + λy) = A(x + λy) = Ax + λAy = TA (x) + λTA (y) ∀x, y ∈ K n , λ ∈ K 2. Consideremos agora T : R3 −→R3 definida por T ((x, y, z)) = (x, y, 0). Então T é linear, pois T ((x, y, z) + λ(x′ , y ′ , z ′ )) = T ((x + λx′ , y + λy ′ , z + λz ′ )) = (x + λx′ , y + λy ′ , 0) = (x, y, 0) + λ(x′ , y ′ , 0) = T (x, y, z) + λT (x′ , y ′, z ′ ) ∀(x, y, z), (x′ , y ′, z ′ ) ∈ R3 , λ ∈ R 3. Seja V = Pn (t), e consideremos a transformação dada pela derivação muito conhecida nos cursos de Cálculo Dt = dtd : V −→V dada por: Dt (p(t) = a0 + a1 t + · · ·+ an tn ) = d (a0 + a1 t + · · ·+ an tn ) = a1 + 2a2 t + · · ·+ nan tn−1 dt ∀p(t) = a0 + a1 t + · · · + an tn ∈ V . A partir dos cursos de cálculo, a transformação anterior é uma transformação linear. 77 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 4. Seja V = Pn (t) e seja W = R e definamos a transformação Z b p(t)dt = a Z b Rb a : V −→W dada por an tn+1 b a1 t2 +···+ )/ (a0 + a1 t + · · · + an t )dt = (a0 t + 2 n+1 a n a ∀p(t) = a0 + a1 t + · · · + an tn ∈ V . A partir dos cursos de cálculo, é conhecido que a transformação anterior é uma transformação linear, pois integral da soma é a soma das integrais, e todo escalar pode sair da integral. 5. É fácil verificar que T (x) = x2 , T (x) = senx, T (x) = 2x+2 não são transformações lineares, de maneira análoga T (x, y) = (2x + 2, 0) não é uma transformação linear entre outras. Proposição 5.1.2 Sejam V, W dois espaços vetoriais de dimensão finita, e sejam B = {v1 , ..., vn } uma base de V , e C = {w1 , ..., wn } um conjunto de vetores de W , não necessariamente diferentes. Então, existe uma única transformação linear T tal que T (vi ) = wi ∀i = 1, ..., n Dem. Seja V um espaço vetorial com base B, então sabemos que v = c1 v1 + · · · + cn vn . Então, consideremos uma transformação T tal que T (vi ) = wi e T (v) = c1 w1 + · · ·+ cn wn . Como B é uma base temos que T (0V ) = 0W . Vejamos agora que a transformação T é linear. Sejam u, v ∈ V e α ∈ K então calculemos T (u + λv) = T ((d1 + λc1 )v1 + · · · + (dn + λcn )vn ) = T (u) + λT (v) como querı́amos. Vejamos agora que a transformação T é única. Seja U uma transformação tal que U(vi ) = wi ∀i = 1, ..., n e seja v = c1 w1 + · · · + cn wn , então temos U(v) = c1 w1 + · · · + cn wn = T (v) ∀v ∈ V pelas propriedades da definição de transformação linear. Portanto temos que T = U, portanto a transformação T é única. 5.1.1 Exercı́cios 1. Mostre que as seguintes transformações são lineares : a) T : R2 −→R2 definida por T (x, y) = (−x, 2y) b) T : R3 −→R2 definida por T (x, y, z) = (−x, 2y + z) c) T : R2 −→R2 definida por T (x, y) = (ax + by, cx + dy) 2. Quais das seguintes transformações são lineares? e justifique. a) T (x, y) = (x2 , y) b) T (x, y) = (senx, seny) c) T (x, y) = (y, x) CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 78 3. Consideremos a Rotação de um vetor (x, y) ∈ R2 em um angulo θ dada por : xcosθ − ysenθ cosθ senθ x Q(x, y) = = xsenθ + ycosθ senθ cosθ y Então mostre que Q(x, y) é uma transformação Linear. 4. Consideremos a transformação T : R3 −→R2 definida por T (x, y, z) = (x, y, 0), conhecida como projeção ortogonal. Mostre que a transformação T é uma transformação Linear. 5. Considere a transformação R : R3 −→R3 definida por R(x, y, z) = (x, y, −z), conhecida como reflexão no plano xy. Mostre que R é uma transformação Linear. 6. Represente geometricamente cada uma das seguintes transformações : a) T (x, y) = (x + y, y) b) T (x, y) = (3x, 0) c) T (x, y) = (y, x) 7. Seja Pn (K) o conjunto dos polinômios de grau menor ou igual a n. Mostre que as transformações a seguir são lineares: T ((a0 + a1 t + · · · + an tn ) = a0 t + a1 t2 + · · · + an tn+1 S(a0 + a1 t + · · · + an tn ) = a1 + a2 t + · · · + an tn−1 8. Sejam V = Mn , e M ∈ Mn . Quais das seguintes transformações são lineares? a) T (X) = MX, ∀X ∈ V b) T (X) = MX − XM, ∀X ∈ V c) T (X) = M − X, ∀X ∈ V 9. Seja V = Mn . Mostre que as seguintes transformações são lineares : a) TP (A) = P A, onde P é inversı́vel. b) T (A) = P AQ, onde P, Q são inversı́veis. c) T (A) = P −1AP , onde P é inversı́vel. d) T (A) = P t AP , onde P é inversı́vel. 10. Sejam V = Pn (R) e T a transformação que leva o polinômio p(t) ∈ V , na sua derivada segunda. Será que T é uma transformação linear? CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 5.2 79 Núcleo e Imagem de Transformações Lineares Nesta seção, daremos algumas ferramentas para poder caracterizar algumas transformações lineares, que serão de muita ajuda no decorrer deste texto. Definição 5.2.1 Sejam V, W dois espaços vetoriais e T : V −→W uma transformação linear. Chamaremos de Núcleo da transformação T ao seguinte conjunto: N(T ) = {v ∈ V /T (v) = 0W } Chamaremos de Imagem da transformação linear T ao seguinte conjunto : I(T ) = {w ∈ W/ ∃v ∈ V tq T (v) = w} Exemplo 5.2.1 Consideremos agora T : R3 −→R3 definida por T ((x, y, z)) = (x, y, 0). Então, o seu nucleo é dado por N(T ) = {(0, 0, 0)}, e seu conjunto Imagem é dado por I(T ) ∼ = R2 Proposição 5.2.1 Sejam V, W dois espaços vetoriais não vazios e, T : V −→W uma transformação linear. Então, N(T ) é um subespaço vetorial de V e I(T ) é um subespaço vetorial de W . Dem. Sejam u, v ∈ N(T ), então temos que T (u) = T (v) = 0W , e seja λ ∈ K, então mostremos que u + λv está em N(T ). Logo, T (u + λv) = T (u) + λT (v), pois T é uma transformação linear, e como u, v ∈ N(T ) segue que T (u + λv) = 0W , portanto u + λv ∈ N(T ), logo o conjunto N(T ) é um subespaço vetorial de V . Mostremos agora que I(T ) é um subespaço vetorial de W . Então, sejam w, w ′ ∈ I(T ) e λ ∈ K. Mas como w, w ′ ∈ I(T ), então temos que existem v, v ′ ∈ V tal que T (v) = w e T (v ′ ) = w ′ , logo w + λw ′ = T (v) + λT (v ′ ) = T (v + λv ′ ) ∈ I(T ) Portanto, I(T ) é um subespaço vetorial de W como querı́amos. Corolário 11 Seja T : V −→W uma transformação linear. Se o conjunto {v1 , ..., vn } é um conjunto gerador do espaço vetorial V , então o conjunto {T (v1 ), ..., T (vn )} é um conjunto gerador de I(T ). Dem. Seja w ∈ I(T ), então existe v ∈ V tal que T (v) = w, mas como o conjunto {v1 , ..., vn } é um conjunto gerador de V , temos que existem c1 , ..., cn ∈ K tal que v = c1 v1 + · · · + cn vn , e como T é linear segue que w = T (v) = T (c1 v1 + · · · + cn vn ) = c1 T (v1 ) + · · · + cn T (vn ) Logo, o vetor w ∈ I(T ) é gerado pelo conjunto {T (v1 ), ..., T (vn )}. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 80 Exemplo 5.2.2 1. Seja V um espaço vetorial e id : V −→V denota a transformação identidade, isto é id(v) = v. Então, N(id) = {0} e I(id) = V . Denotemos por 0 : V −→V , a transformação nula, isto é, 0(v) = 0, então N(0) = V e I(0) = {0}. 2. Seja V = Mm,n e seja TA : K n −→K m dada por TA (x) = Ax, onde A ∈ V . Então, N(TA ) = {x ∈ K n /TA (x) = Ax = 0} logo o núcleo de TA é dado pelo conjunto solução do sistema homogêneo Ax = 0. Agora, o conjunto imagem é dado por: I(TA ) = {y ∈ K m /∃x ∈ K n ; TA (x) = Ax = y} que denota o conjunto solução do sistema não homogêneo determinado por Ax = y. 3. Seja V = R2 e T : R2 −→R2 dada por T (x, y) = (x + y, 2x + y). Então o conjunto N(T ) = {(x, y) ∈ R2 /T (x, y) = (x + y, 2x + y) = (0, 0)} = {(0, 0)}. Agora o conjunto I(T ) = {(u, v) ∈ R2 /∃(x, y) ∈ R2 ; T (x, y) = (u, v)} = {(−u + v, 2u − v)} Exemplo 5.2.3 Consideremos a transformação linear T : R3 −→R3 dada por T (x, y, z) = (x + 2y − z, y + z, x + y − 2z). Então, calculemos uma base para N(T ) e para I(T ). Veja que N(T ) = {(x, y, z) ∈ R3 /T (x, y, z) = (0, 0, 0)}, ou seja, temos o seguinte sistema de equações homogêneo: x+ 2y− z = 0 y+ z = 0 x+ y− 2z = 0 Logo, temos que x = 3z; y = −z; z = z, isto é, (x, y, z) ∈ N(T ) se ele é da seguinte forma (3z, −z, z) = z(3, −1, 1), logo o vetor (3, −1, 1) é gerador de N(T ), e como é não nulo, ele é LI. Portanto, é uma base para N(T ), logo dimK N(T ) = 1. Para calcular a base de I(T ), consideremos a base canônica de R3 dada por B = {(1, 0, 0), (0, 1, 0), (0, 0, 1)}. Logo, I(T ) é gerada por {T ((1, 0, 0)), T ((0, 1, 0)), T ((0, 0, 1))} = {(1, 0, 1), (2, 1, 1), (−1, 1, −2)}, e como este conjunto é LD (verifique!), temos que um dos vetores é combinação linear dos outros, então podemos tirar qualquer vetor, logo podemos considerar o seguinte conjunto {(1, 0, 1), (2, 1, 1)} como base de I(T ) e dimK I(T ) = 2. Definição 5.2.2 Sejam V, W espaços vetoriais e T : V −→W uma transformação linear. Então : 1) T é injetora se T (v1 ) = T (v2 ) ⇒ v1 = v2 . 2) T é sobrejetora se I(T ) = W . 3) T é bijetora se, a transformação T é injetora e sobrejetora. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 81 Na proposição a seguir, damos uma ferramenta prática para poder decidir quando uma transformação linear é ou não injetora, sem recorrer da definição 5.2.2. Proposição 5.2.2 Sejam V, W espaços vetoriais e T : V −→W uma transformação linear. Então, T é injetora se, e somente se, N(T ) = {0V }. Dem. ⇒) Seja T uma transformação injetora. Então calculemos N(T ) = {v ∈ V /T (v) = 0W }. Como T é uma transformação linear temos que T (0V ) = 0W e como T é injetora segue que se v ∈ N(T ), então T (v) = 0W portanto, v = 0, logo N(T ) = {0}. ⇐) Seja T uma transformação linear tal que N(T ) = {0}, então sejam v1 , v2 ∈ V tal que T (v1 ) = T (v2 ). Logo, como T é uma transformação linear segue que T (v1 − v2 ) = 0W , portanto v1 − v2 ∈ N(T ) = {0}, então temos que v1 = v2 e T é uma transformação linear injetora. Exemplo 5.2.4 1. Seja V um espaço vetorial e id : V −→V , então id é injetora e sobrejetora, logo é uma bijeção. Por outro lado, a transformação nula 0 : V −→V , não é injetora nem sobrejetora desde que V 6= {0}. 2. Seja A ∈ Mn e TA : K n −→K n tal que TA (x) = Ax. Esta transformação é injetora desde que a matriz A seja inversı́vel. A proposição a seguir, é de muita utilidade para determinar injetividade e sobrejetividade de uma transformação linear, como mostram o seus corolário. Proposição 5.2.3 Sejam V, W espaços vetoriais de dimensão finita e T : V −→W uma transformação linear. Então, dimK N(T ) + dimK I(T ) = dimK V Dem. Seja V um espaço vetorial tal que dimK V = n e seja {v1 , ..., vt } uma base de N(T ), então existem vt+1 , ..., vn ∈ V tal que o conjunto {v1 , ..., vt , vt+1 , ..., vn } é uma base do espaço vetorial V . Mostremos então que o conjunto {T (vt+1 ), ..., T (vn )} é uma base de I(T ). Claramente, o conjunto {T (v1 ), ..., T (vt ), T (vt+1 ), ..., T (vn )} = {T (vt+1 ), ..., T (vn )} é um conjunto gerador de I(T ), pelo corolário 5.1.1. Então, só resta mostrar que este conjunto é linearmente independente. Então, sejam αt+1 , ..., αn ∈ K tais que αt+1 T (vt+1 ) + · · · + αn T (vn ) = 0W como T é uma transformação linear segue que T (αt+1 vt+1 + · · · + αn vn ) = 0W Então αt+1 vt+1 + · · · + αn vn ∈ N(T ). Agora, como o conjunto {v1 , ..., vt } é uma base de N(T ), temos que existem β1 , ...., βt ∈ K tais que β1 v1 + · · · + βt vt = αt+1 vt+1 + · · · + αn vn CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 82 ou seja β1 v1 + · · · + βt vt − (αt+1 vt+1 + · · · + αn vn ) = 0V Mas, como o conjunto {v1 , ..., vt , vt+1 , ..., vn } é uma base de V , então ele é linearmente independente, portanto todos os escalares β1 , ..., βt , αt+1 , ...., αn são nulos, em particular αt+1 = · · · = αn = 0. Portanto, temos que o conjunto {T (vt+1 ), ..., T (vn )} é uma base de I(T ) e finalmente temos que dimK N(T ) + dimK I(T ) = dimK V como querı́amos. Corolário 12 Sejam V, W espaços vetoriais e T : V −→W uma transformação linear. Se dimK V > dimK W , então a transformação T não pode ser injetora. Dem. Sejam V, W espaços vetoriais tais que dimK V > dimK W . Se T é uma transformação injetora temos que dimK N(T ) = dimK {0V } = 0, logo temos que dimK V = dimK N(T ) + dimK I(T ) = 0 + dimK I(T ) ≤ dimK W que é uma contradição, pois dimK V > dimK W . Corolário 13 Sejam V, W espaços vetoriais e T : V −→W uma transformação linear. Se dimK V < dimK W , então a transformação T não pode ser sobrejetora. Dem. Vamos supor que a transformação T é sobrejetora, então dimK I(T ) = dimK W , então segue que dimK V = dimK N(T ) + dimK I(T ) = dimK N(T ) + dimK W Logo, temos que dimK V ≥ dimK W uma contradição. T U Proposição 5.2.4 Sejam V, W, Z espaços vetoriais e V −→W −→Z duas transformações lineares, então temos que a composta U ◦ T : V −→Z dada por U ◦ T (v) = U(T (v)) é uma transformação linear. Dem. Sejam v, v ′ ∈ V e λ ∈ K, então U ◦ T (v + λv ′ ) = U(T (v + λv ′ )) = U(T (v) + λT (v ′)) = U(T (v)) + λU(T (v ′ )) = U ◦ T (v) + λU ◦ T (v ′ ) pois tanto T como U são transformações lineares, então U ◦ T é uma transformação linear. Consideremos V, W dois espaços vetoriais e T : V −→W uma transformação linear bijetora, então existe T −1 : W −→V tal que T ◦ T −1 = idW e T −1 ◦ T = idV . Será que existe uma transformação linear que admita inversa, sem ela ser uma bijeção? CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 83 Proposição 5.2.5 Sejam, V, W espaços vetoriais e T : V −→W uma transformação linear bijetora, então T −1 tambem é uma transformação linear. Dem. Sejam w, w ′ ∈ W e λ ∈ K. Então, existem v, v ′ ∈ V, T (v) = w, T (v ′) = w ′ T −1 (w + λw ′ ) = T −1 (T (v) + λT (v ′ )) Pois a transformação T é sobrejetora. Agora, como T é linear temos T −1 (w+λw ′) = T −1 (T (v+λv ′)) = v+λv ′ = T −1 (T (v))+λT −1(T (v ′)) = T −1 (w)+λT −1 (w ′) Portanto, T −1 é uma transformação linear. Exemplo 5.2.5 Seja V = R2 = W e T (x1 , x2 ) = (x1 + x2 , x1 ) uma transformação linear. Veja que N(T ) = {(0, 0)} e I(T ) = W , então existe T −1 que podemos definir da seguinte forma: T −1 (u, v) = (v, u − v) pois T ◦ T −1 (u, v) = T (T −1 (u, v)) = T (v, u − v) = (v + (u − v), v) = (u, v) de maneira análoga temos que T −1 ◦ T (x1 , x2 ) = T −1 (x1 + x2 , x1 ) = (x1 , (x1 + x2 ) − x1 ) = (x1 , x2 ) Proposição 5.2.6 Sejam V, W espaços vetoriais e T : V −→W uma transformação linear. Então a transformação T é injetora se, e somente se, T transforma conjuntos linearmente independentes em conjuntos linearmente independentes. Dem. ⇒) Sejam T : V −→W uma transformação linear injetora, {v1 , ..., vn } um subconjunto linearmente independente de V . Então mostremos que o conjunto {T (v1 ), ..., T (vn )} é linearmente independente em W . Logo, sejam α1 , ..., αn ∈ K tal que α1 T (v1 ) + · · · + αn T (vn ) = 0W mas como T é linear, segue que T (0V ) = 0W , e então T (α1 v1 + · · · + αn vn ) = T (0V ) Agora, como T é injetora temos que α1 v1 + · · · + αn vn = 0V . Como o conjunto {v1 , ..., vn } é linearmente independente, segue que α1 = · · · = αn = 0, portanto temos que o conjunto {T (v1 ), ..., T (vn )} é linearmente independente. ⇐) Sabemos que T leva conjuntos linearmente independentes em conjuntos linearmente independentes, então seja v 6= 0V ∈ V . Claramente, v é linearmente independente, então T (v) também é linearmente independente, portanto T (v) 6= 0W . Logo, a transformação T leva vetores não nulos em vetores não nulos, logo N(T ) = {0V }, isto é, T é injetora como querı́amos mostrar. 84 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS Proposição 5.2.7 Sejam V, W dois espaços vetoriais tais que dimK V = dimK W = n e T : V −→W uma transformação linear. Então são equivalentes : i) T é inversı́vel. ii) T é sobrejetora. iii) T é injetora. iv) Toda imagem de uma base por T é uma base. Dem. i) ⇒ ii) Se T é inversı́vel, então segue que dimK V = dimK W , então T é sobrejetora. ii) ⇒ iii) Como dimK N(T ) + dimK I(T ) = dimK V = dimK W = n, e a transformação T é sobrejetora, temos que dimK I(V ) = dimK W = n, logo segue que dimK N(T ) = 0 ou seja que, N(T ) = {0V }, isto é, T é injetora. iii) ⇒ iv) A partir da proposição 5.2.6 T leva conjuntos linearmente independentes em conjuntos linearmente independentes. Então seja {v1 , ..., vn } uma base de V , então o conjunto {T (v1 ), ..., T (vn )} é linearmente independente, e como dimK V = dimK W segue que o conjunto {T (v1 ), ..., T (vn )} é uma base de W . iv) ⇒ i) Seja {v1 , ..., vn } uma base de V , então o conjunto {T (v1 ) = w1 , ..., T (vn ) = wn } é uma base de W . Definamos S : W −→V P tal que S(wi ) = vi onde i = 1, ..., n. Mostremos que S é a inversa de T . Seja v = n1 ci vi , então S ◦ T (v) = S(T (v)) = S(T ( n X ci vi )) = S( 1 n X ci w i ) = 1 n X ci S(wi ) = n X ci vi = v 1 1 Portanto S ◦ T = idV . P Seja agora w ∈ W , então w = n1 ai wi pois {w1 , ..., wn } é base de W . Logo, T ◦ S(w) = T (S(w)) = T (S( = T( n X 1 ai vi ) = n X 1 n X ai wi )) = T ( 1 ai T (vi ) = n X ai S(wi )) = 1 n X ai wi = w 1 Portanto, a transformação T é inversı́vel, e S é a sua inversa. 5.2.1 Exercı́cios 1. Determine dimK I(T ) e dimK N(T ) nas seguintes transformações lineares : a) T (x, y, z) = (x − y, y + z, z + x) b) T (x, y, z) = (y, z, x) CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 85 c) T (x, y, z) = (x + y + z, x − y + z, −x + y + z) 2. Seja T (x, y, z) = (x − y + 2z, 2x + y, −2y + 2z) então : a) Seja (a, b, c) ∈ R3 . Quais são as condições sobre a, b, c tais que (a, b, c) ∈ I(T )?, e calcule dimK I(T ). b) Seja (a, b, c) ∈ R3 . Quais são as condições sobre a, b, c tais que (a, b, c) ∈ N(T )?, e calcule dimK N(T ). 3. Sejam V = R3 , e B = {e1 = (1, 0, 0); e2 = (0, 1, 0); e3 = (0, 0, 1)} a base canônica. Ache T (3, 2, 8) se T ((1, 0, 0)) = (0, 0, 1); T ((0, 1, 0)) = (1, 0, 0); T ((0, 0, 1)) = (0, 1, 0) 4. Seja V um espaço vetorial de dimensão n, e T : V −→V uma transformação linear tal que I(T ) = N(T ). Mostre que n é um número par. 5. i) É possı́vel ter uma transformação linear T : R3 −→R2 que seja injetora? Justifique. ii) É possı́vel ter uma transformação linear T : R2 −→R3 que seja sobrejetora? Justifique. iii) É possı́vel ter uma transformação linear T : Kn −→Kn que seja injetora e não sobrejetora? Justifique. 6. Dê um exemplo de uma transformação linear entre espaços vetoriais de dimensões diferentes que seja injetora mas não sobrejetora, e outra que seja sobrejetora mas não injetora. 7. Sejam B = {v1 = (1, 1, 1); v2 = (−1, 1, 1); v3 = (0, 0, −1)}. a) Mostre que B é uma base. b) Seja T (v1 ) = v1 ; T (v2 ) = −v2 ; T (v3 ) = 2v3 i) Calcule T (e1 ); T (e2 ); T (e3 ), onde {e1 , e2 , e3 } é a base canônica de R3 ii) Obtenha uma expressão genérica pata T (x, y, z) iii) Calcule dimK N(T ) e decida se T é inversı́vel. 8. Seja A ∈ V = Mm,n , e seja T : K n −→K m definida por T (X) = AX. Mostre que : a) T é sobrejetora se, e somente se, o número de linhas não nula da matriz reduzida escalonada associada a matriz A é m. b) T é injetora se, e somente se, o número de linhas não nulas da matriz reduzida escalonada associada a matriz A é n. c) T é inversı́vel se, e somente se, o número de linhas não nulas da matriz reduzida associada a matriz A é m = n. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 5.3 86 Representação de Transformações Lineares por Matrizes Seja V um espaço vetorial e seja B = {v1 , ..., vn } umaP base ordenada de V . Sabemos n que cada vetor v ∈ V admite uma única forma v = 1 αi vi , onde α1 , ..., αn ∈ K. Estes escalares são conhecidas como as coordenadas do vetor v, na base ordenada B, que α1 .. representamos por [v]B = . . Consideremos agora W um espaço vetorial com base αn ′ ordenada B = {w1 , ..., wm }, então T (B) é dada por: T (vi ) = m X aji wj j=1 onde i = 1, ..., n. Então a matriz coordenada de cada T (vi ) é dada da seguinte forma: a1i [T (vi )]B′ = ... ami Então a matriz associada a transformação linear T a11 · · · .. B [T ]B′ = . é dada por am1 .. . am1 · · · amn Exemplo 5.3.1 Sejam V = R3 , W = R2 espaços vetoriais com as suas bases canônicas B = {(1, 0, 0), (0, 1, 0), (0, 0, 1)} e B′ = {(1, 0), (0, 1)}, e a transformação linear dada por: T (x1 , x2 , x3 ) = (x1 − x2 , 2x1 − x2 + x3 ) Então calculemos a matriz [T ]BB′ da seguinte forma: • T (v1 ) = T ((1, 0, 0)) = (1, 2) = 1w1 + 2w2 • T (v2 ) = T ((0, 1, 0)) = (−1, −1) = (−1)w1 + (−1)w2 • T (v3 ) = T ((0, 0, 1)) = (0, 1) = 0w1 + 1w2 Portanto, a matriz de T é dada por: [T ]BB′ = 1 −1 0 2 −1 1 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 87 Definição 5.3.1 Seja V um espaço vetorial. Chamaremos de operador linear a transformação linear T : V −→V . Para calcular a representação matricial do operador T : V −→V sempre consideraremos a mesma base de V , que a denotaremos por [T ]B a menos que seja especificado o contrário. Exemplo 5.3.2 1. Sejam V = R2 , com base canônica B = {(1, 0), (0, 1)}, e T ((x1 , x2 )) = (x1 + kx2 , x2 ) um operador linear. Então calculemos: • T ((1, 0)) = (1, 0) = 1v1 + 0v2 • T ((0, 1)) = (k, 1) = kv1 + 1v2 1 k Portanto, segue que [T ]B = 0 1 2. Sejam V = P2 (t) e B = {1, t, t2} e o operador T = [T ]B da seguinte forma: • • • d dt : V −→V . Então calculemos d (1) = 0 = 0 · 1 + 0 · t + 0 · t2 dt d (t) = 1 = 1 · 1 + 0 · t + 0 · t2 dt d 2 (t ) = 2t = 0 · 1 + 2 · t + 0 · t2 dt 0 1 0 Portanto, segue que [T ]B = [ dtd ]B = 0 0 2 0 0 0 3. Sejam V = R2 e B = {e1 = (1, 0), e2 = (0, 1)} e o operador T definido por : Tθ (x, y) = (−xcosθ − ysenθ, xsenθ + ycosθ), onde 0 ≤ θ ≤ 2π é fixo. Então calculemos da seguinte forma: • Tθ ((0, 1)) = (−cosθ, senθ) = −cosθ(1, 0) + senθ(0, 1) • Tθ ((0, 1)) = (−senθ, cosθ) = −senθ(1, 0) + cosθ(0, 1) Portanto, temos que −cosθ −senθ [Tθ ]B = senθ cosθ Veja que a construção anterior estabelece uma correspondência entre as matrizes quadradas e os operadores lineares, e uma vez fixada a base ordenada do espaço vetorial, esta correspondência será injetora e sobrejetora, como estabelece a seguinte proposição. Proposição 5.3.1 Seja V um espaço vetorial de dimK V = n e base B = {v1 , ..., vn }. Então, Ψ : Mn −→{Operadores lineares em V } é uma bijeção. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 88 Exemplo 5.3.3 Seja V = P2 (t) o espaço vetorial dos polinômios de grau menor ou igual d 2 a dois e T = 2 (t) dada pela derivada. Seja B = {1, t, t }, então sabemos dt : P2 (t)−→P 0 1 0 d 0 0 2 . Então veja que se p(t) = c + bt + at2 ∈ V , temos que que [ dt ]B = 0 0 0 c 0 1 0 c b d [ ]B b = 0 0 2 b = 2a dt a 0 0 0 a 0 Que é exatamente d (c dt + bt + at2 ) = b + 2t + 0t2 . Proposição 5.3.2 Sejam V um espaço vetorial e B = {v1 , ..., vn } uma base ordenada de V , e sejam U, T operadores lineares. Se [T ]B = A, e [U]B = B, então [U ◦ T ]B = BA. Dem. Seja C = [U ◦ T ]B e sejam A = [T ]B , B = [U]B . Logo, basta verificar que para todo v ∈ V temos que [U ◦ T ]B [v]B = [U]B [T ]B [v]B . Corolário 14 Seja T um operador linear. Então T é inversı́vel se, e somente se, [T ]B é inversı́vel. Dem. ⇒) Seja T inversı́vel, então existe T −1 tal que T ◦ T −1 = T −1 ◦ T = idV , logo [T ◦ T −1 ]B = [T ]B [T −1 ]B = [idV ]B = In Portanto, temos que [T −1 ]B = [T ]−1 B . ⇐) Seja a matriz A = [T ]B inversı́vel, então existe uma única matriz A−1 tal que In = A · A−1 = [T ]B [U]B = [T ◦ U]B = [idV ], logo T é inversı́vel como querı́amos. 5.3.1 Ecercı́cios 1. Ache a representação matricial de T onde T é dada por : a) T (x, y) = (2x, 3y) b) T (x, y) = (−x, −y) c) T (x, y) = (x, 3y) d) T (x, y) = (−x + y, 3y) e) T (x, y) = (2x + 3y, −x + y) f) T (x, y) = (3x, 3y) CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 89 2. Seja T (x, y) = (2x, 3x − 2y). Então ache a representação matricial de T onde : a) a base é B = {(1, 0), (0, 1)}. b) a base é B = {(1, 2), (3, 5)}. 3. Sejam V = P3 (t) e T = d . dt Ache a representação matricial para T onde : a) a base é B = {1, t, t2 , t3 }. b) a base é B = {t2 , t, t3 , 1}. 4. Seja o operador T definido por T (x, y, z) = (3x + z, y + z, −x + 2y + 3z), então determine : a) [T ]B onde a base é B = {(1, 0, 0), (0, 1, 0), (0, 0, 1)}. b) [T ]B onde a base é B = {(1, 0, 1), (−1, 2, 1), (2, 1, 1)}. 1 2 e seja T : R2 −→R2 tal que T (v) = Av t . Ache a matriz de T 5. Seja A = 3 5 onde : a) a base é B = {(1, 0), (0, 1)}. b) a base é B = {(1, 3), (2, 5)}. 5.4 Autovalor, Autovetor e Diagonalização Definição 5.4.1 Seja V um K-espaço vetorial de dimensão n, e T : V −→V um operador linear. Um escalar λ ∈ K é dito um autovalor de T se existem vetores 0 6= v ∈ V tal que T (v) = λv. Todo vetor v ∈ V tal que T (v) = λv é dito o autovetor associado ao autovalor λ ∈ K. Denotaremos por Vλ o conjunto de todos os autovetores associados ao autovalor λ. Fixemos um K-espaço vetorial V com base ordenada B = {v1 , ..., vn }, e T : V −→V um operador linear. Se consideramos A = [T ]B e X = [v]B , então temos a seguinte equação matricial AX = λX ou T (v) = λv de onde segue que: (AX − λX) = 0V ⇔ (A − λIn )X = 0V Então, temos a seguinte proposição. Proposição 5.4.1 Sejam V um K-espaço vetorial e T : V −→V um operador linear. Então são equivalentes : i) A equação matricial AX = λX tem soluções não nulas. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 90 ii) A matriz (A − λIn ) não é inversı́vel. iii) det(A − λIn ) = 0 Dem. i) ⇒ ii) Seja A ∈ Mn , e seja X 6= 0V tal que AX = λX. Então temos que o sistema homogêneo (A − λIn )X = 0V admite soluções não triviais, portanto a matriz (A − λIn ) não é inversı́vel. ii) ⇒ iii) Se a matriz (A − λIn ) não é inversı́vel, então o det(A − λIn ) = 0. iii) ⇒ i) Se o det(A−λIn ) = 0, então o número de linhas não nulas da matriz reduzida associada a matriz (A − λIn ) é menor estrito do que n, logo o sistema homogêneo associado terá mais indeterminadas do que equações, portanto admite soluções não triviais. Definição 5.4.2 Chamaremos de polinômio caracterı́stico associada à matriz A ao polinômio p(x) = det(A − xIn ). A equação p(x) = det(A−xIn ) = 0 é conhecida como equação caracterı́stica associada à matriz A, e não é dificil mostrar que as soluções ou raı́zes da equação caracterı́stica dada por p(x) = det(A − xIn ) = 0, correspondem-se com os autovalores associados a matriz A, como mostra-se no seguinte exemplo. 1 2 . Então o polinômio caracterı́stico é dado por Exemplo 5.4.1 Seja A = 3 2 x 0 1 2 ) − p(x) = det((A − xI2 )) = det( 0 x 3 2 1−x 2 = det( ) = (1 − x)(2 − x) − 6 = x2 − 3x − 4 = 0 3 2−x Portanto, os autovalores são λ1 = 4; λ2 = −1 que são as raı́zes de p(x) = x2 − 3x − 4 = 0. Calculemos agora V4 , V−1 . 2 x+ 2y = 4x 4x x x 1 2 x ⇔ x = ( )y }⇔ = =4 / V4 = { 3x+ 2y = 4y 4y y y 3 2 y 3 2/3 2/3 x 2 ]. Logo, V4 é gerado pelo vetor /x = ( 3 )y} = [ Portanto, V4 = { 1 1 y que é linearmente independente, por ser não nulo, e dimK V4 = 1. De maneira análoga x+ 2y = −x −x x x 1 2 x }⇔ ⇔ x = −y = = −1 / V−1 = { 3x+ 2y = −y −y y y 3 2 y −1 x ] /x = −y} = [ Portanto, V−1 = { 1 y CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS Exemplo 5.4.2 1. Seja A = 1 1 0 1 91 . Logo, o polinômio caracterı́stico é dado por : p(x) = det(A − xI2 ) = (1 − x)2 Então o único autovalor de A é λ = 1. Calculemos agora V1 da seguinte forma : x x 1 1 =1 y y 0 1 1 de onde segue que X = é un autovetor correspondente ao autovalor 1. 0 0 −1 2. Seja A = ∈ M2 (R). Então as raı́zes da equação caracterı́stica pA (x) = 1 0 det(A − xI2 ) = x2 + 1 = 0 são λ = i; λ = −i, que não pertencem ao corpo R. Portanto, a matriz A não tem autovalores reais. A partir de agora assumiremos que o corpo K = C dos números complexos. As matrizes sobre R podem ser vistas como matrizes sobre C, pois R ⊆ C, como visto no capı́tulo A. Proposição 5.4.2 Sejam A, B duas matrizes semelhantes, (isto é, existe uma matriz inversı́vel M tal que B = M −1 AM), então : i) det(B) = det(A) ii) pA (x) = det(A − xIn ) = det(B − xIn ) = pB (x), logo têm os mesmos autovalores. iii) Se vλ é um autovetor da matriz A, correspondente ao autovalor λ, então M −1 vλ é um autovetor de M −1 AM correspondente ao autovalor λ. Dem. Sejam A, B semelhantes, isto é, existe uma matriz M inersı́vel tal que B = M −1 AM. i) Logo det(B) = det(M −1 AM) = det(M −1 )det(A)det(M) = det(M)−1 det(A)det(M) = det(A) . ii) Então, temos que : M −1 (A − xIn )M = M −1 AM − xM −1 In M = B − xIn Logo, det(A − xIn ) = det(M −1 (A − xIn )M) = det(B − xIn ) como querı́amos. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 92 iii) Seja vλ um autovetor correspondente ao autovalor λ associado a matriz A, logo Avλ = λvλ . Então, mostremos que M −1 vλ é um autovetor de B = M −1 AM. Para isto, calculemos: BM 1 vλ = (M −1 AM)(M −1 vλ ) = M −1 Avλ Mas, como Avλ = λvλ segue-se que : BM 1 vλ = M −1 (λvλ ) = λ(M −1 vλ ) Portanto, M −1 vλ é um autovetor de M −1 AM correspondente a λ. Corolário 15 Seja A ∈ Mn semelhante a uma matriz diagonal D, então os elementos da diagonal da matriz D são os autovalores da matriz A. Dem. Como as matrizes A e D são semelhantes, temos que elas tem os mesmos autovalores, e claramente os autovalores da matriz D são os elementos da diagonal. Definição 5.4.3 Diremos que uma matriz A é diagonalizável se for semelhante a uma matriz diagonal D. Diremos que a matriz inversı́vel M é diagonalizante se D = M −1 AM. Definição 5.4.4 Diremos que um operador T sobre o espaço vetorial V é diagonalizável, se para alguma base B de V , sua representação matricial [T ]B é uma matriz diagonal, e diremos que a base B diagonaliza T . Proposição 5.4.3 Seja A uma representação matricial de um operador T sobre o espaço vetorial V . Então, a transformação T é diagonalizável se, e somente se, existe uma matriz inversı́vel M tal que D = M −1 AM é uma matriz diagonal. Proposição 5.4.4 Seja A ∈ Mn . A é diagonalizável se, e somente se, a matriz A tem n autovetores linearmente independentes. Nesta proposição temos que os autovalores λ1 , ..., λn ∈ K da matriz A não são necessariamente todos diferentes, como mostra o seguinte exemplo. Exemplo 5.4.3 seja T : R3 −→R3 tal que: 3 1 −1 A = [T ]B = 2 2 1 2 2 0 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 93 Onde B é uma base de R3 . logo, o polinômio caracterı́stico associado a matriz A é dado por: pA (x) = (x − 1)(x − 2)2 e, portanto tem os autovalores 1 e 2. Cálculemos agora os subespaços vetoriais V1 e V2 . x 3 1 −1 x x x V1 = { y / 2 2 1 y = 1 y = y } z 2 2 0 z z z 3x+ y− z = x x = 2z 2x+ 2y+ z = y ⇔ ⇔ y=0 2x+ 2y+ 0z = z 1 Portanto V1 = [ 0 ] 2 1 De maneira análoga, temos que V2 = [ 1 ]. Como os autovetores associados a 2 1 1 0 1 temos que não podemos ter transformação T são múltiplos de ou do vetor 2 2 3 uma base de R formada por autovetores associados a transformação linear T . Portanto, a transformação T não é diagonalizável, pois só admite dois autovetores linearmente independentes e deveriam ser três segundo a proposição 5.4.4. 1 2 Exemplo 5.4.4 Seja A = do exemplo 5.4.1 e sabemos que é diagonalizável 3 2 2 1 pois A admite dois autovetores linearmente independentes, a saber ; Seja 3 −1 2 1 M= , a matriz, cujas colunas são os autovetores da matriz A. Então, podemos 3 −1 obter a matriz diagonal da seguinte forma: 4 0 2 1 1 2 1/5 1/5 −1 =D = M AM = 0 −1 3 −1 3 2 3/5 −2/5 Proposição 5.4.5 Seja A ∈ Mn tal que tem n autovalores diferentes, então a matriz A é diagonalizável. Veja que a recı́proca da proposição 5.4.5 não é verdadeira, isto é, não é verdade que se a matriz A é diagonalizável então os seus autovalores tem que ser diferentes, como mostra o seguinte exemplo. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS Exemplo 5.4.5 Seja T : R3 −→R3 tal que: 1 −2 A = [T ]B = 2 2 −3 2 94 −1 1 −2 Onde B é uma base de R3 . 2 Logo, o polinômio caracterı́stico é dado por pA (x) = (x + 1) (x + 2), de onde te1 0 1 mos que V−1 = [ 0 ; 1 ] e V−2 = [ −1 ]. Veja que a matriz A, admite 2 2 1 um autovalor repetido, a saber −1, mas a partir da proposição 5.4.4 temos a base B′ = 1 0 1 0 ; 1 ; −1 tal que 2 2 1 −1 0 0 −1 0 [T ]B′ = 0 0 0 −2 Logo, a transformação linear T é diagonalizável. A seguir, relacionaremos a multiplicidade de um autovalor λ associado a uma matriz A, com a dimensão do subespaço vetorial formado pelos autovetores associados ao autovalor λ. Para isto, vejamos a seguinte definição. Definição 5.4.5 Seja λ um autovalor associado a matriz A ∈ Mn , cujo polinômio caracterı́stico é dado por pA (x) = (x − λ)m q(x), com q(λ) 6= 0. O número m é chamado de multiplicidade algébrica de λ e o denotaremos por ma (λ). Chamaremos de multiplicidade geométrica de λ à dimensão de Vλ , que denotaremos por mg (λ). Veja que a multiplicidade algébrica de um autovalor λ é o maior ı́ndice j, tal que (x − λ)j divide o polinômio caracterı́stico pA (x). Então, temos a seguinte proposição. Proposição 5.4.6 Seja λ um autovalor associado a matriz A ∈ Mn . Então mg (λ) ≤ ma (λ). Veja, que a partir das proposições 5.4.4 e 5.4.6 temos que uma matriz A ∈ Mn é diagonalizável se, e somente se mg (λi ) = ma (λi para cada autovalor associado à matriz A. Definição 5.4.6 Seja f (x) = an xn + · · · + a0 ∈ C[x]. Se f (A) = an An + · · · + a0 In = 0C , diremos que o polinômio f (x) é um polinômio anulador da matriz A e que a matriz A é um zero de f (x). CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 95 Exemplo 5.4.6 1. seja A ∈ Mn tal que A2 = A, então A2 − A = 0n logo segue que f (x) = x(x − 1) é um polinômio anulador da matriz A. 2. Seja A ∈ Mn tal que Ar = In , onde r é um inteiro positivo. Então Ar − In = 0n e f (x) = xr − 1 é o polinômio anulador da matriz A. Proposição 5.4.7 (Teorema de Caylei Hamilton) Seja f (x) o polinômio caracterı́stico de uma matriz A ∈ Mn , então f (A) = 0n Proposição 5.4.8 Se λ é um autovalor da matriz A ∈ Mn e f (x) é um polinômio anulador da matriz A, então f (λ) = 0. Dem. Seja v 6= 0 um autovetor associado ao autovalor λ da matriz A. Logo Av = λv e pode-se mostrar que f (A)v = f (λ)v. Mas, como f (A) = 0 temos que 0 = f (λ)v. Portanto, f (λ) = 0 como querı́amos. Proposição 5.4.9 Seja A ∈ Mn e seja f (x) um polinômio anulador da matriz A. Se f (x) não possuir raı́zes multiplas em C, então a matriz A é diagonalizável. Exemplo 5.4.7 Toda matriz A ∈ Mn tal que seu polinômio caracterı́stico é dado por f (x) = (x − λ1 ) · · · (x − λn ) é um produto de fatores diferentes, é diagonalizável. Recordar que todo polinômio caracterı́stico em particular é um polinômio anulador. Para finalizar, recordemos que nem toda matriz A ∈ Mn é diagonalizável, mas para superar esta dificuldade pode-se demonstrar que toda matriz é semelhante a uma matriz triangular. Pode-se ainda mostrar que toda matriz A ∈ Mn é semelhante a uma matriz J ”diagonal”da seguinte forma: J1 0 J2 J = . . . Jr onde cada um dos blocos Ji , conhecidos como seguinte forma: λi 1 .. . Ji = 0 0 blocos de Jordan, onde i = 1, ..., r, é da 0 .. .. . 1 λi . e os escalares λ1 , ..., λr são os autovalores da matriz A, não necessariamente diferentes. A matriz J é conhecida como Forma de Jordan da matriz A. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 5.4.1 96 Exercı́cios 1. Seja λ ∈ K um autovalor de T em V . Mostre que Vλ é um subespaço vetorial de V . 2 7 2. Seja A = 3 5 i) Ache o polinômio caracterı́stico de A. ii) Ache os autovalores de A e os autovetores correspondentes. A é diagonalizável?. Justifique!. iii) Ache uma gonal. 2 3. Seja A = 3 1 matriz M inversı́vel tal que a matriz M −1 AM seja uma matriz dia 0 3 5 1 0 3 i) Ache o polinômio caracterı́stico associado a matriz A. ii) Considere A ∈ M3 (C) e calcule os seus autovalores e verifique se a matriz A é diagonalizável. iii) Considere A ∈ M3 (R) e ache os autovalores de A e verifique se a matriz A é diagonalizável. CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 97 4. Seja T (x, y) = (3x − 3y, x + 3y). Então : i) Encontre os autovalores de T e uma base para cada Vλ . ii) Ache uma base B′ de R2 tal que a matriz [T ]B′ seja diagonal. 5. Seja T (x, y, z) = (2x + y, y − z, 2y + 4z). i) Ache os autovalores de T e uma base para cada Vλ . ii) T é diagonalizável? Justifique! 6. Ache uma matriz inversı́vel M tal que M −1 AM é uma matriz diagonal, onde: 3 4 i) A = 4 3 1 −3 3 1 ii) A = 3 4 6 −6 2 7. Seja A é uma matriz inversı́vel. Então, mostre que se λ 6= 0 é um autovalor associado a matriz A, então a matriz A−1 admite λ−1 como autovalor. 8. Se A é uma matriz não nula nilpotente, isto é Ar = 0n para algum inteiro positivo r, então mostre que todos os autovalores A são nulos. 9. Se A2 = A, mostre que todos os autovalores de A são iguais a 1 ou 0. 10. Suponha que λ é um autovalor da matriz A. Mostre que f (λ) é um autovalor da matriz f (A), onde f é um polinômio em C. 11. Seja A ∈ M2 uma matriz simétrica (At = A). Mostre que ela é diagonalizável. 5.5 Reconhecimento de Cônicas Nesta seção consideraremos o corpo K = R e faremos uma pequena aplicação dos conceitos de diagonalização, em particular faremos uso da diagonalisação de matrizes simétricas para reconhecer quadricas e cônicas. Mas primeiro recordemos alguns conceitos de geometria analı́tica. Definição 5.5.1 Chamaremos de distancia entre dois pontos de Rn a função d : Rn −→R dada por p d((x1 , ..., xn ), (y1, ..., yn )) = (x1 − y1 )2 + · · · + (xn − yn )2 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 98 Fácilmente podem ser verificadas as seguintes propriedades para a função d definida em 5.5.1: i) d((x1 , ..., xn ), (x1 , ..., xn )) ≥ 0 ii) d((x1 , ..., xn ), (y1, ..., yn )) = d((y1, ..., yn ), (x1 , ..., xn )) iii) d((x1 , ..., xn ), (y1, ..., yn )) ≤ d((x1 , ..., xn ), (z1 , ..., zn )) + d((z1 , ..., zn ), (y1, ..., yn )) Definição 5.5.2 Seja A ∈ Mn . Diremos que a matriz A é ortogonal se d(Av, (0, ..., 0)) = d(v, para todo v ∈ Rn , e que representaremos da seguinte forma | Av |=| v |= √ (0, ...,√0)), v · v = vtv Recordemos que se B é uma base canônica de Rn então qualquer vetor de Rn pode ser visto como uma matriz coluna da seguinte forma x1 [(x1 , ..., xn )]B = ... xn então v · v = v t v. Agora, como A é ortogonal temos que v t v = v · v = Av · Av = (Av)t Av = v t At Av Portanto segue que At A = In ou seja que A−1 = At . Definição 5.5.3 Chamaremos de Cônica ao lugar geométrico dos pontos (x, y) ∈ R2 , cujas coordenadas, em relação à base canônica de R2 , satisfazem a seguinte identidade polinomial: ax2 + by 2 + 2cxy + dx + ey + f = 0 onde a, b, c, d, e, f ∈ R, e alem disso a, b, c não são todos nulos. Como estamos interessados em usar as ferramentas de diagonalização para reconhecer uma cônica, simplificaremos a equação ax2 +by 2 +2cxy +dx+ey +f = 0 dada na definição 5.5.3. Veja que o polinômio ax2 + by 2 + cxy, que é conhecido como forma quadrática do plano, pode ser vista da seguinte forma: a c x 2 2 2 = v t Av ax + by + cxy = x y c b y 2 a 2c x . e a matriz simétrica A é dada por A = onde claramente v = c b y 2 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS 99 Veja que a forma quadrática ax2 + by 2 + cxy está associada a matriz simétrica A. Estudemos agora a diagonalisação da matriz simétrica A. Seja pA (x) = det(A − xI2 ) = x2 − tr(A)x + det(A) = 0 c2 pA (x) = x − (a + b)x + (ab − ) = 0 4 Logo, suas raı́zes estão dadas por : q p 2 (a + b) + (a + b)2 − 4(ab − c4 ) (a + b) + (a − b)2 + c2 = λ1 = 2 2 2 e λ2 = (a + b) − q (a + b)2 − 4(ab − 2 c2 ) 4 = (a + b) − p (a − b)2 + c2 2 2 Observe tambem que se λ1 = λ2 então (a + b)2 = 4(ab − c4 ) ⇔ (a − b)2 + c2 = 0 (*) e se ambos, λ1 , λ2 forem nulos temos que, p (a + b) = (a − b)2 + c2 ⇔ (a + b)2 = (a − b)2 + c2 ⇔ 4ab = c2 Substituido o anterior em (*) temos que (a + b)2 = 0 ⇔ a = −b, ou seja que −4b2 = c2 ⇔ c = a = b = 0. Portanto temos que a matriz A é a matriz nula, o que é uma contradição. Portanto, os autovalores λ1 e λ2 não podem ser zero ao mesmo tempo, por 2 2 outro lado se λ1 = λ2 segue que (a − b) + c = 0 ou seja que c = 0 e, a = b e logo a a 0 , logo ja é diagonal. Então, pelo anterior, matriz A tem a seguinte forma A = 0 a podemos considerar os autovalores λ1 e λ2 diferentes, então pela proposição 5.4.5 temos que a matriz A é diagonalizável. Seja A ∈ Mn uma matriz simétrica diagonalizável com autovalores λ1 , λ2 então sabemos que Av · w = (Av)t w = v t At w = v t Aw = v · (Aw) e como λ1 6= λ2 segue que: λ1 v1 · v2 = Av1 · v2 = v1 · Av2 = v1 · λ2 v2 Portanto segue que: (λ1 − λ2 )v1 · v2 = 0 Ou seja, que os autovetores associados aos autovalores λ1 , λ2 são ortogonais. Po outro lado, como a matriz A é diagonalizável sabemos que existe um matriz P inversı́vel, formada pelos autovetores associados aos autovalores de A tal que D = P −1AP 100 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS onde D é uma matriz diagonal. Fazendo uso do parágrafo anterior, todos os autovetores são ortogonais, ou seja, a matriz P é uma matriz ortogonal, logo P −1 = P t , portanto a matriz diagonal é dada por : λ1 0 t D = P AP = 0 λ2 A matriz P também é conhecida como matriz de mudança de base, isto é, da base dada pelos autovetores que denotaremos por P para a base canônica dada por B, desta forma temos que [v]B = P [v]P Portanto temos que [v]tB A[v]B = (P [v]P )t A(P [v]P ) = ([v]tP P t )A(P [v]P ) Fazendo uso da associatividade das matrizes temos que: [v]tB A[v]B = [v]tP (P t AP )[v]P = [v]tP D[v]P ′ x temos que: Considerando [v]P = y′ ′ λ1 0 a c x x ′ ′ 2 x y = x y c y′ 0 λ2 b y 2 Ou seja, 2 ax2 + by 2 + cxy = λ1 x′ + λ2 y ′ 2 Assim, a forma quadrática ax2 + by 2 + cxy sempre pode ser substituida pela forma quadrática λ1 x′ 2 + λ2 y ′2 . Portanto a nossa equação a c x x 2 2 2 ax + by + cxy + dx + ey + f = x y +f =0 + d e c y y b 2 É identificada agora com: ′ λ1 0 x ′ ′ x y + y′ 0 λ2 d e P x′ y′ +f =0 ou seja λ1 x′ 2 + λ2 y ′ 2 + px′ + qy ′ + f = 0. Lembre que esta nova equação refere-se ao sistema de coordenadas x′ 0y ′ cujos eixos estão determinados pela base dada pelos autovetores associados nos autovalores λ1 , λ2 . Fazendo uma translação nos eixos temos que λ1 x′ 2 + λ2 y ′ 2 + px′ + qy ′ + f = 0 pode ser vista como λ1 X 2 + λ2 Y 2 = F esta equação é conhecida como equação reduzida da cônica centrada na origem. 101 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS Então segue que 1) Se λ1 , λ2 6= 0 temos: i) Se λ1 e λ2 tem o mesmo sinal, diremos que é uma Elipse. ii) Se λ1 e λ2 tem sinal diferente diremos que é uma Hipérbole 2) Se λ1 ou λ2 é nulo, diremos que é uma Parábola Exemplo 5.5.1 Determinar a equação reduzida e o tipo de cônica que é representada pela equação : 9 11 4x2 − y 2 − 6xy − 4x + y − 12 = 0 16 2 Veja que podemos escrever a equação anterior da seguinte forma: x 4 x −3 9 x y + −4 2 − 12 = 0 11 y y −3 16 A partir doque temos calculado anteriormente, temos que os autovalores associados 4 −3 são λ1 = 4 e λ2 = −1, onde os autovetores associados são a matriz A = −3 11 16 1 3 v1 = associado a λ1 e v2 = associado a λ2 . 0 4 Mas como estamos interessados em vetores unitarios, consideraremos u1 = |vv11 | e u2 = v2 como sendo as colunas da minha matriz de mudança de base. Portanto, segue que: |v2 | ′ x y ′ 4 0 0 −1 x′ y′ −4 + 9 2 1 0 3 5 4 5 x′ y′ − 12 = 0 Ou seja, temos a seguinte equação: 2 2 4x′ − y ′ − 4x′ − 6y ′ − 12 = 0 Fazendo agora o completamento de quadrados da equação anterior segue que: 2 2 4x′ − 4x′ + 1 − (y ′ + 6y ′ + 9) = 12 + 1 − 9 1 4(x′ − )2 − (y ′ + 3)2 = 4 2 (x′ − 12 )2 (y ′ + 3)2 =1 − 4 4 4 102 CAPÍTULO 5. TRANSFORMAÇÕES LINEARES E CÔNICAS Portanto, a equação 4x2 − 11 2 9 y − 6xy − 4x + y − 12 = 0 16 2 tem como equação reduzida (x′ − 21 )2 (y ′ + 3)2 − =1 1 4 Que representa uma Hipérbole com foco ( 12 , −3) e distância 5.5.1 √ 5 Exercı́cios Em cada um dos exercı́cios a continuação determine a forma reduzida e determine o tipo de Cônica representada pela equação: 1. x2 − 6x + 8y + 1 = 0 2. 7x2 + y 2 − 6xy − 7x + 8y + 1 = 0 √ 3. 4x2 + y 2 + 4xy − 7 5x + 8y + 5 = 0 √ √ 4. x2 + y 2 + xy + 5 3x + 3 5y + 5 = 0 5. 3x2 + 3y 2 − 2xy + 2x − 3y + 4 = 0 6. x2 + y 2 − 2xy + x − y − 16 = 0 Apêndice A Introdução à Estruturas Algébricas A.1 Conjuntos A matemática, como ela é mostrada geralmente nos dias de hoje, é tão abstrata que fica muito difı́cil entender como ela foi construı́da, ou descoberta. Mas a base de qualquer estrutura matemática está baseada na noção de conjunto, e isto mostra a força deste conceito, que por outro lado, é um dos conceitos mais amplos e simples que existem. Então vejamos a seguinte definição. Definição A.1.1 Um Conjunto é um agrupamento ou reunião de objetos que chamaremos de elementos. Para denotar um conjunto usaremos letras maiúsculas, e para denotar os elementos do conjunto usaremos letras minúsculas. Esta noção é tão familiar, que basta olhar ao redor que vemos muitos exemplos de conjuntos, como o conjunto formado pelos alunos da aula de álgebra linear, como o conjunto dos alunos do curso de computação, como o conjunto formado pelos objetos da sua mochila, etc. Então, todo conjunto está determinado pela natureza dos seus elementos que o componhem, assim diremos que dois conjuntos são iguais se ambos tem os mesmos elementos. Seja A um conjunto, e a um elemento (este elemento pode ser um conjunto) então, gostarı́amos de saber qual é a relação entre o elemento a e o conjunto A. Será que o elemento a faz parte do conjunto A?, se ele fizer, diremos que o elemento a faz parte do conjunto A, que denotaremos por a ∈ A, caso contrario, diremos que o elemento a não faz parte do conjunto A, que denotaremos por a ∈ / A. No decorrer deste texto, estaremos interessados fundamentalmente em conjuntos formados por números, figuras geométricas, entre outros. Por enquanto, para descrever um conjunto, podemos especificar os seus elementos (se for finito), ou especificando a propriedade que satisfazem os seus elementos (se for infinito). 103 APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 104 Exemplo A.1.1 Consideremos as seguintes situações: 1. A = {1, 3, 5} ou B = {João, Carlos, Maria} 2. B = {x/x é uma estrela} (lê-se B é o conjunto formado pelos x tal que x é uma estrela). Existe um conjunto muito interessante, e porque não, curioso!, que é o conjunto vazio, que denotaremos por φ. Este é o conjunto que não tem elementos. A partir de elementos de um conjunto podemos construir novos conjuntos, como os conjuntos unitários, por exemplo {x} que denota o conjunto formado pelo elemento x , agora um exemplo de conjunto vazio pode ser dado por φ = {x/x 6= x}, e claramente φ 6= {φ} visto que {φ} contém um elemento, a saber o φ. Definição A.1.2 Sejam A e B dois conjuntos. Diremos que o conjunto A é subconjunto do conjunto B, que denotaremos por A ⊆ B, se qualquer elemento do conjunto A faz parte dos elementos do conjunto B, caso contrario, isto é, se pelo menos um elemento do conjunto A não faz parte do conjunto B, diremos que o conjunto A não é subconjunto do conjunto B, que denotaremos por A * B. Nesta definição de subconjunto fica a possibilidade do conjunto A ser um subconjunto dele mesmo, visto que todo elemento do conjunto A esta dentro do proprio conjunto A. Neste texto, usaremos a notação A ⊂ B, para indicar que o conjunto A está contido no conjunto B, mas existe pelo menos um elemento no conjunto B que não está no conjunto A, isto é conhecido como inclusão própria ou subconjunto próprio. Podemos considerar como conjunto A os alunos de Engenharia desta universidade, e como conjunto B os alunos desta Universidade, então claramente A ⊂ B, visto que alunos de Letras não faz parte do curso de Engenharia, por exemplo. Assim, como temos definido o conjunto vazio φ, podemos definir o conjunto universal (em muitos textos é conhecido como Universo do discurso ou assunto da discussão) , que denotaremos por U, que indica o conjunto que tem como propriedade, que qualquer outro conjunto A é um subconjunto de U. Por exemplo se A = {x/x é alunodestaUniversidade}, então o conjunto universal U é formado portodos os alunos universitários. Seja A um conjunto qualquer, então podemos construir um novo conjunto, que denotaremos por P(A), que é o conjunto formado por todos o possı́veis subconjuntos do conjunto A, isto é, os elementos do conjunto P(A) são subconjuntos do conjunto A, logo φ e A são elementos de P(A), e não é dificil de mostrar que φ é um subconjunto de qualquer conjunto. Consideremos agora o seguinte exemplo. Exemplo A.1.2 Seja A = {1, 2, 3}, então P(A) = {φ, A, {1}, {2}, {3}, {1, 2}, {1, 3}, {2, 3} Recordemos que dados dois conjuntos, digamos A e B não vazios, podemos construir um novo conjunto chamado de produto cartesiano, que denotaremos por A × B, está formado por todos os pares da forma (x, y) onde x ∈ A e y ∈ B, isto é: A × B = {(x, y)/x ∈ A, y ∈ B} APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 105 Estes conjuntos são muito importantes, pois podemos definir relações do conjunto A no conjunto B da seguinte forma. Definição A.1.3 Sejam A, B ∈ U. Chamaremos de Relação entre o conjunto A e o conjunto B, ao subconjunto R ⊆ A × B formado por todos os pares (x, y) ∈ A × B tal que x esta relacionado com y, que denotaremos por xRy, simbolicamente temos: R = {(x, y) ∈ A × B/xRy} Consideremos uma relação R ⊆ A × B, então o conjunto A é o conjunto de partida, e o conjunto B de chegada da relação R. Chamaremos ao conjunto D = {x ∈ A/∃y ∈ B tal que xRy} ⊆ A, de domı́nio da relação R, e denotaremos por I = {y ∈ B/ ∃x ∈ A tal que xRy} ⊆ B, de conjunto Imagem definido pela relação R. Ilustremos estes conceitos com o seguinte exemplo. Exemplo A.1.3 Sejam A = {1, 2, 3, 4, 5} e B = {1, 2, 3, 6} conjuntos, e seja R = {(1, 2), (1, 3), (2, 1), (2, 6), (5, 1), (5, 2)}. Logo o conjunto A é o conjunto de partida, e o conjunto B é o conjunto de chegada. O domı́nio da relação R é dado pelo conjunto D = {1, 2, 5} e a Imagem da relação R é dado pelo conjunto I = {1, 2, 3, 6}. A relação que definiremos a seguir, é uma das relações mais importantes na matemática em geral, que vocês reconhecerão rapidamente. Definição A.1.4 Sejam A, B ∈ U. A relação R ⊆ A × B dada por: A cada elemento x de A existe um único elemento y em B, tal que (x, y) ∈ R, é conhecida como função do conjunto A, que denota o domonio da função f, no conjunto B, que denota o contradominio da função f e, que será denotada por f : A−→B e f (x) = y tal que x ∈ A e y ∈ B. A relação definida no exemplo A.1.3 não é uma função, visto que os elementos 3, 4 ∈ A não tem um correspondente no conjunto B, ou seja, deveriam estar em R pares da forma (3, ?) e (4, ?), isto é, o conjunto A da relação deve coincidir com o dominio da função definida por esta relação. Veja tambem que se o dominio da relação definida no exemplo 1.1.3 coincidese com o conjunto A, ainda assim não seria uma função, pois se R é uma relação função, então a cada lelemto do conjunto A corresponde um e só um elemento do conjunto B, mas isto tambem não acontece ja que , por exemplo, R comtem os pares (1, 2) e (1, 3), ou seja que o 1 tem duas imagens. Diremos que uma função f : A−→B é Injetora se f (x) = f (y) ⇒ x = y, como exemplo podemos considerar o fato em que a cada Brasilero corresponde um único CPF, e diremos que a função f : A−→B é sobrejetora se o conjunto imagem determinada por f coincide com o conjunto B e como exemplo podemos considerar o fato considerar o vestibular para Medicina em que para cada vaga tem mais de um candidato para preencher esta vaga. Finalmente diremos que a função f : A−→B é uma bijeção se ela for injetora e sobrejetora ao mesmo tempo. Muitas relações são caracterizadas por satisfizerem algumas propriedades, enunciamos algumas delas a seguir. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 106 Definição A.1.5 Sejam A, B ∈ U conjuntos e R ⊆ A × B uma relação. Então diremos que R é: i) Reflexiva se, e somente se xRx ∀x ∈ A onde A é o domı́nio da relação R. ii) Simétrica se, e somente se, xRy ⇒ yRx. iii) Antissimétrica se, e somente se, xRy e yRx ⇒ x = y iv) Transitiva se, e somente se, xRy e yRz ⇒ xRz. Como exemplo, podemos considerar o conjunto formado pelas partes P(U) do conjunto universo U, e a relação R ⊆ P(U) × P(U), onde (A, B) ∈ R se, e somente se, A ⊆ B. Veja que esta relação satisfaz as seguintes propriedades. Proposição A.1.1 Sejam A, B, C conjuntos, então é válido: i) Reflexiva A ⊆ A. ii) Antissimétrica Se A ⊆ B e B ⊆ A, então A = B. iii) Transitiva Se A ⊆ B e B ⊆ C, então A ⊆ C. A relação dada pela proposição anterior é dita uma relação de ordem e, como exemplo podemos citar a realação definida em R dada por xRyse, esomentese, x ≤ y. Uma outra relação muito importante usada em termos matemáticos e a relação R é de equivalência, se ela é Reflexiva, Simétrica e Transitiva. Na relação de antisimetria, está implı́cita a noção de igualdade, visto que se todos os elementos do conjunto A estão no conjunto B, e todos os elementos do conjunto B estão no conjunto A, portanto só nos reta afirmar que os dois conjuntos são iguais. Agora a transitividade, é a base do raciocı́nio lógico dedutivo, por exemplo se A é o conjunto dos seres humanos e, B o conjunto dos animais e C o conjunto dos seres mortais. Então temos que todo ser humano é animal, e todo animal é mortal, logo podemos concluir que todo ser humano é mortal. Em termos simbólicos temos: A ⊆ B e B ⊆ C, então A ⊆ C. Veja também, que a relação de inclusão esta diretamente relacionada com a implicação lógica, por exemplo sejam P e Q as propriedades que definem os conjuntos A e B respectivamente, isto é, x ∈ A (y ∈ B) se x satisfaz a propriedade P (y satisfaz a propriedade Q), então temos que a propriedade P implica a propriedade Q, que denotaremos por P ⇒ Q, para significar que A ⊆ B. Consideremos o seguinte exemplo. Exemplo A.1.4 Sejam as propriedades P : x2 − 1 = 0 e Q : x3 + x2 − x − 1 = 0, então temos que toda solução da equação x2 −1 = 0 é uma solução da equação x3 +2x2 −x−2 = 0, portanto segue que P ⇒ Q. Em termos de conjunto, temos que A = {x/x2 − 1 = 0} é um subconjunto de B = {x/x3 + 2x2 − x − 2 = 0} ou seja A ⊆ B. Para definir nosso próximo conceito, fixaremos o conjunto universal U, logo todos os elementos a serem considerados pertencerão ao conjunto U, e todos os conjuntos serão subconjuntos de U. Logo temos a seguinte definição. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 107 Definição A.1.6 Seja A um subconjunto de U. Chamaremos de complementar do conjunto A, que denotaremos por Ac , ao conjunto formado por todos os elementos do conjunto Universal U, que não estão no conjunto A. Veja que a partir da definição anterior, dado um elemento x ∈ U, só temos duas possibilidades, a saber, x ∈ A ou x ∈ / A, em Lógica o anterior é conhecido como o Principio do terceiro excluı́do, agora o fato de que as duas opções não podem ser verdadeiras ao mesmo tempo é conhecido como principio da não contradição. A partir destes pricı́pios temos as seguintes regras: 1. Para todo A ⊆ U, temos que (Ac )c = A. 2. Se A ⊆ B, então B c ⊆ Ac . Sejam A, B ⊆ U, tais que o conjunto A é definido pela propriedade P , e o conjunto B é definido pela propriedade Q. Então o conjunto Ac é formado pelos elementos que não satisfazem a propriedade P que denotaremos por P ′ (negação de P ), e de maneira análoga B c é dada por Q′ (negação de Q), logo temos: A ⊆ B ⇔ B c ⊆ Ac ou P ⇒ Q se, e somente se, Q′ ⇒ P ′ . Em outras palavras, a implicação P ⇒ Q é equivalente a afirmar que Q′ ⇒ P ′ (a negação de Q implica a negação de P ). A implicação Q′ ⇒ P ′ é conhecida como a contrapositiva da implicação P ⇒ Q, esta é a base da demonstração por absurdo. Consideremos o seguinte exemplo: Exemplo A.1.5 Sejam U = {Seres vivos neste planeta} , {P : Seres humanos} e {Q : Animais}. Claramente P ⇒ Q, mas se queremos usar o absurdo, segue que {P ′ : Existem seres que não são humanos} e a afirmação {Q′ : Existem seres que não são animais}, logo segue que Q′ ⇒ P ′ , visto que se existem seres que não podem ser animais , então estes não podem ser seres humanos. O exemplo anterior mostra que temos que fazer uma distinção entre a idéia matemática de negação e a noção (não matemática) de contrário ou oposto. Se um conceito é expresso por uma palavra, o conceito contrário é expresso pelo antônimo daquela palavra. Por exemplo, o contrário de gigantesco é minúsculo, mas a negação de gigantesco inclui outras gradações de tamanho além de minúscula, pois só não pode ser gigantesco. Vejamos agora algumas operações com conjuntos. Definição A.1.7 Sejam A, B ∈ U então temos as seguintes operações: i) União : A ∪ B = {x/x ∈ A ou x ∈ B}. ii) Interseção: A ∩ B = {x/x ∈ A e x ∈ B}. iii) Diferença: A − B = {x/x ∈ A e x ∈ / B} = A ∩ B c . APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 108 Notemos que, as operações entre conjuntos A ∪ B e A ∩ B constituem a contrapartida matemática dos conectivos lógicos ”ou”e ”e”. Assim, quando o conjunto A é determinado pelos elementos que satisfazem a propriedade P , e o conjunto B é determinado pelos elementos que satisfazem a propriedade Q, então segue que a propriedade que determina o conjunto A ∪ B é ”P ou Q”, denotando que um elemento do conjunto A ∪ B esta determinado pela propriedade que é satisfeita por P ou por Q e de maneira analoga a que determina o conjunto A ∩ B é ”P e Q”. Exemplo A.1.6 Seja A = {x/x2 −3x+ 2 = 0} = {1, 2}, então neste caso o conjunto A é determinado pela propriedade {P : x tal que x2 − 3x + 2 = 0}, e consideremos o conjunto B = {x/x2 − 5x + 6 = 0} = {2, 3}, determinado pela propriedade {Q : x tal que x2 − 5x + 6 = 0}. Assim a afirmação P : x tal que x2 − 3x + 2 = 0 ou Q : x tal que x2 − 5x + 6 = 0 equivale a dizer que ”x ∈ {1, 2, 3}”, e a afirmação {P : x tal que x2 − 3x + 2 = 0} e{Q : x tal que x2 − 5x + 6 = 0} equivale a dizer que x ∈ {2} ou que x = 2. A diferença entre o uso comum e o uso matemático do conectivo ”ou”é ilustrada pela anedota do obstetra que também era matemático. Ao sair da sala de cirurgia, onde acabara de realizar um parto, o obstetra foi abordado pelo pai da criança, que lhe perguntou:”Foi menina ou menino doutor?”. A resposta do medico foi: ”Sim”. Efetivamente, se A é o conjunto das meninas, e B é o conjunto dos meninos e x o recém nascido, certamente tem-se que x ∈ A ∪ B. Vejamos agora algumas propriedades satisfeitas por estas operações entre conjuntos. Proposição A.1.2 Sejam A, B, C ⊆ U. Então são válidas as seguintes afirmações: 1. Comutatividade: A ∪ B = B ∪ A e A ∩ B = B ∩ A. 2. Associatividade: (A ∪ B) ∪ C = A ∪ (B ∪ C) e (A ∩ B) ∩ C = A ∩ (B ∩ C). 3. Distributividade: A∩(B∪C) = (A∩B)∪(A∩C) e A∪(B∩C) = (A∪B)∩(A∪C). 4. Leis de De Morgan: (A ∪ B)c = Ac ∩ B c e (A ∩ B)c = Ac ∪ B c . APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS A.1.1 109 Exercı́cios 1. Sejam P1 , P2 , Q1 , Q2 propriedades referentes a elementos de um conjunto universo U e suponha que P1 e P2 esgotam todas as possibilidades dos elementos de U, e suponha ainda que Q1 e Q2 são incompatı́veis (isto é, excluem-se mutuamente). Suponha finalmente que P1 ⇒ Q1 e P2 ⇒ Q2 . Prove que valem as reciprocas: Q1 ⇒ P1 e Q2 ⇒ P2 . 2. Expressões tais como ”para todo”que denotaremos por ∀ e ”qualquer que seja” são chamados de quantificadores e aparecem em sentenças dos seguintes tipos: i) ”Para todo x é satisfeita a condição P (x)”. ii) ”Existe algum x que satisfaz a condição P (x)”, onde P (x) é uma condição envolvendo a variável x. (a) Seja A = {x/P (x) é verdadeira}. Escreva as sentenças anteriores usando a linguagem de conjunto. (b) Quais são as negações das duas sentenças anteriores, usando linguagem de conjuntos?. 3. Considere os seguintes conjuntos: F = Conjunto de todos os filósofos. M = Conjunto de todos os matemáticos. C = Conjunto de todos os cientistas. P= Conjunto de todos os professores. (a) Exprima cada uma das afirmações abaixo, usando a linguagem de conjuntos: i. ii. iii. iv. v. vi. vii. viii. ix. x. Todos os matemáticos são cientistas. Alguns matemáticos são professores. Alguns cientistas são filósofos. Todos os filósofos são cientistas ou professores. Nem todo professor é cientista. Alguns matemáticos são filósofos. Nem todo filósofo é cientista. Alguns filósofos são professores. Se um filósofo não é matemático, ele é professor. Alguns filósofos são matemáticos. (b) Tomando as primeiras cinco afirmações anteriores como hipóteses, verifique quais das afirmativas restantes são verdadeiras. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 110 4. O artigo 34 da Constituição Brasileira de 1988 diz o seguinte: ”A união não intervirá nos Estados nem no Distrito Federal, exceto para: I Manter a integridade nacional; II Repelir invasão estrangeira ou de unidade da Federação em outra” (a) Suponhamos que o estado do Rio de Janeiro seja invadido por tropas de São Paulo. O texto acima obriga a União a intervir no estado?. Na sua opinião, era a intenção dos legisladores nesse caso?. (b) Rescreva o texto do artigo 34 de modo a torná-lo mais preciso. 5. Mostre as propriedades das operações com conjuntos dadas na proposição 1.1.2. 6. Sejam A, B, C conjuntos. Ache uma condição necessária e suficiente para que: A ∪ (B ∩ C) = (A ∪ B) ∩ C 7. Determine uma condição necessária e suficiente para que tenhamos: A − (B − C) = (A − B) − C A.2 Naturais, Inteiros e Racionais Nesta seção daremos uma construção dos conjuntos numéricos Naturais, Inteiros e Racionais, além de dar algumas das propriedades mais importantes deles. Desde que aprendemos a falar, muitas palavras são ensinadas sem nenhuma definição ou significado mas de certa forma passam a fazer parte das nossas regras de comunicação. Estas palavras são conhecidas como conceitos primitivos. Para poder empregar os conceitos primitivos adequadamente, é necessário dispor de um conjunto de princı́pios ou regras que disciplinem sua utilização e estabeleçam suas propriedades. Na matemática estes princı́pios ou regras são conhecidas como Axiomas ou postulados. Assim como os conceitos primitivos são objetos que não se definem, os axiomas são proposições que não se demonstram. Uma vez feita a lista dos conceitos primitivos e enunciados os axiomas de uma teoria matemática, todas as demais noções devem ser definidas e as afirmações demonstradas, nisto consiste o chamado Método Axiomático. As proposições a serem demonstradas chamam-se Teoremas e suas conseqüências imediatas são conhecidas como Corolários. Uma proposição auxiliar usada na demonstração do Teorema, é conhecida como Lema. No limiar do século vinte, o matemático Italiano Giuseppe Peano consegue dar uma descrição precisa do conjunto dos números naturais, que denotaremos por N, estabelecendo uma construção Axiomática onde os conceitos primitivos são ”número” e ”sucessor”. Intuitivamente, quando n, n′ ∈ N, dizer que n′ é o sucessor de n significa que n′ vem logo depois de n, não havendo outros números naturais no meio. Logo, ”sucessor” se transforma em ”logo depois”, portanto não é uma definição. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 111 Vejamos agora os Axiomas de Peano que regem estes conceitos primitivos: 1. Todo número natural tem um único sucessor. 2. Números naturais diferentes tem sucessores diferentes. 3. Existe um único número natural, chamado um e representado pelo sı́mbolo 1, que não é sucessor de nenhum outro. 4. Seja X um conjunto de números naturais. Se 1 ∈ X e se, o sucessor de todo elemento de X está em X, então X = N. O último axioma de Peano, é conhecido como axioma de indução, que pode ser formulado da seguinte maneira: Seja P (n) a propriedade relativa ao número natural n. Suponhamos que : i) P (i) é válida. ii) Para todo n ∈ N, a validez de P (n) implica a validez de P (n′), onde n′ é o sucessor de n. Então P (n) é válida para qualquer que seja o número natural n. Efetivamente, se chamarmos de X o conjunto dos Numeros naturais n tais que P (n) é verdadeira, temos que 1 ∈ X pela sentença i ) anterior, e se n ∈ X, então n′ ∈ X pela sentença ii ) anterior. Logo, pelo axioma de indução temos que X = N. No seguinte exemplo fica mais clara a força do axioma de indução. Exemplo A.2.1 Seja P (n) : 1 + 2 + · · · + n = n(n+1) . Será que P (n) é verdadeira para 2 todo n natural?. Usemos nosso processo indutivo para responder a pergunta anterior. Para n = 1 temos que P (1) : 1 = 1(1+1) = 1, logo para n = 1 a afirmação P (1) é 2 verdadeira. Então vamos supor agora que a afirmação anterior vale para n = k, ou seja que P (k) é verdadeira (isto é conhecida como hipóteses de indução), e mostremos que vale para n = k + 1. Pela hipóteses de indução temos que : k(k + 1) 2 Como é uma igualdade, podemos somar k + 1 nos dois lados da igualdade e temos que : P (k) : 1 + 2 + · · · + k = k(k + 1) (k + 1)(k + 2) + (k + 1) = : P (k + 1) 2 2 Portanto, P (n) é válido para todo n ∈ N. 1+2+···+k +k +1 = Nos números Naturais, podemos definir a seguinte função + : N × N−→N da seguinte forma: +(n, m) = n + m Esta definição pode ser feita indutivamente, mas não entraremos em detalhes nisto pois, não é o objetivo deste texto. Na seguinte proposição enunciamos as propriedades satisfeitas pela função +, para isto assumiremos que o conjunto dos numéros naturais contem o 0, isto é, N = {0, 1, 2, 3, ...}. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 112 Proposição A.2.1 A função + : N × N−→N satisfaz: i) Associatividade: (a+b)+c=a+(b+c) ii) Neutro: a+0=0+a=a ∀a, b, c ∈ N iii) Comutatividade: a+b=b+a Então, diremos que (N, +) tem uma estrutura algébrica conhecida como Grupoide. Aqui fica claro a falta de elemento inverso, isto é, para qualquer elemento a ∈ N. Será que existe um número a′ ∈ N tal que a + a′ = 0?. Para tentar resolver este problema, consideremos a seguinte relação R0 em N × N tal que: Sejam a, b, c, d ∈ N então (a, b)R0 (c, d) ⇔ a + d = b + c Não é difı́cil verificar que esta relação R0 , é Reflexiva, Simétrica e Transitiva (exercicio), logo é uma relação de equivalência. Mostremos agora algumas classes : [1, 1] = {(a, b) ∈ N × N/1 + b = 1 + a} = {(1, 1), (2, 2), ...} = 0 [2, 1] = {(a, b) ∈ N × N/2 + b = 1 + a} = {(2, 1), (3, 2), ...} = 1 [1, 2] = {(a, b) ∈ N × N/1 + b = 2 + a} = {(1, 2), (2, 3), ...} = −1 Definição A.2.1 Chamaremos de conjunto dos número inteiros, o conjunto cujos elementos são as classes de equivalência determinados pela relação R0 , que denotaremos por: Z = {..., −3, −2, −1, 0, 1, 2, 3...} Como cada classe de equivalência é um número inteiro, podemos definir a seguinte função ⊕ : Z × Z−→Z dada por ⊕(x, y) = x ⊕ y, que vistos como classes temos ⊕([x1 , x2 ], [y1, y2 ]) = [x1 + y1 , x2 + y2 ]. Por exemplo −1 ⊕1 = [1, 2] ⊕[2, 1] = [1 + 2, 2 + 1] = [3, 3] = [1, 1] = 0 como querı́amos. Estamos usando o sı́mbolo ⊕ só para diferenciar da soma usual em N, mas sem medo a ter confusão usaremos o sı́mbolo + no lugar de ⊕. Então vejamos agora as propriedade desta soma de inteiros na seguinte proposição. Proposição A.2.2 Sejam x, y, z ∈ Z, então são válidas: i) Associatividade: (x + y) + z = x + (y + z) ii) Neutro: ∃0 ∈ Z tal que 0 + x = x + 0 = x iii) Inverso: ∀x ∈ Z, ∃ − x ∈ Z tal que x + −x = −x + x = 0 iv) Comutatividade: x + y = y + x APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 113 Assim como temos definido a soma em Z, nas classes de equivalência dadas por R0 , podemos definir o produto em Z, da seguinte forma: ⊙ : Z × Z−→Z dada por ⊙(x, y) = ⊙([x1 , x2 ], [y1 , y2]) = [x1 y1 + x2 y2 , x1 y2 + x2 y1 ] = x ⊙ y, onde x = [x1 , x2 ], y = [y1 , y2 ] ∈ Z. As propriedades deste produto estão dadas pela seguinte proposição. Proposição A.2.3 Sejam x, y, z ∈ Z, então são válidas: i) Associatividade: (x ⊙ y) ⊙ z = x ⊙ (y ⊙ z) ii) Neutro: ∃1 ∈ Z tal que 1 ⊙ x = x ⊙ 1 = x iii) Comutatividade: x ⊙ y = y ⊙ x E relacionando as duas operações temos: iv) Distributividade à direita: x ⊙ (y + z) = x ⊙ y + x ⊙ z v) Distributividade à esquerda: (x + y) ⊙ z = x ⊙ z + y ⊙ z Veja que nem todo número inteiro tem um inverso multiplicativo, i.e., dado um x 6= 0, 1 ∈ Z, não é possı́vel achar um inteiro y ∈ Z tal que x ⊙ y = 1, por exemplo, se consideramos o 2 ∈ Z não é possı́vel achar um inteiro x tal que 2 ⊙ x = 1. O conjunto (Z, +, ⊙) é dito um Anel comutativo com unidade. No produto definido acima, fica implı́cita a noção de divisibilidade, ou seja, o inteiro a divide o inteiro b se existe um inteiro c tal que a = b ⊙ c. Para não carregar muito a notação faremos x ⊙ y = xy. Existem certos inteiros que merecem destaque, como a noção de um inteiro ser primo, isto é, diremos que um número inteiro p, diferente de 1, −1, é primo se os únicos divisores dele são ±1, ±p. Um resultado muito importante é que todo número inteiro α pode-se escrever como o produto de um número finito de números primos, ou seja, α = pα1 1 · pα2 2 · · · pαt t , onde p1 , ..., pt são números primos e α1 , ..., αt ∈ N. Fazendo uma analogia com a construção dos números inteiros a partir de classes de equivalência, podemos fazer a construção de um novo conjunto númerico, que veremos a seguir. Consideremos primeiro o conjunto Z∗ = Z − {0} = {..., −3, −2, −1, 1, 2, 3, ...}, então definamos a seguinte relação R1 no conjunto Z × Z∗ , onde (a, b)R1 (c, d) ⇔ ad = bc. Esta relação é uma relação de equivalência, ou seja R1 é Reflexiva, Simétrica e Transitiva. Então calculemos algumas classes de equivalencias dadas pela relação R1 . APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 114 Exemplo A.2.2 Seja R1 como antes : 1. Calculemos a classe dada pelo par (1, 2) que denotaremos por [1, 2] ou por 12 : 1 = [1, 2] = {(a, b)/(a, b)R1 (1, 2)} 2 1 = {(a, b)/2a = b} = {(±1, ±2), (±2, ±4), (±3, ±6), ....} 2 2. Calculemos a classe dada pelo par (0, 1): 0 = [0, 1] = {(0, ±1), (0, ±2), (0, ±3), ...} 1 Em geral temos que a classe de um par (x, y) ∈ Z × Z∗ é dada por: x = [x, y] = {(a, b) ∈ Z × Z∗ /(a, b)R1 (x, y)} y Logo, temos a seguinte definição. Definição A.2.2 Chamaremos de conjunto dos números racionais, que denotaremos por Q, o conjunto formado por todas as classes de equivalência geradas pela relação R1 , isto é: x x Q = { / é a classe de equivalência determinada por R1 } y y Vejamos a seguir as definições de soma e produto em Q. Definição A.2.3 Sejam ab , dc ∈ Q. Usaremos o sı́mbolo ⊕ e ⊙ para denotar a soma e o produto em Q, dados como segue: a c ad + bc a c ac ⊕ = e ⊙ = b d bd b d bd Na notação ab o inteiro a e chamado de numerador, e o inteiro b é chamado de denominador, então como quociente pode ser visto como a comparação, ou razão, de dois números inteiros. Temos usado a notação ⊕ e ⊙ para denotar a soma e produto de números racionais, mas se considerarmos os denominadores iguais a 1, temos que estaremos com as operações de soma e produto usuais de N e de Z, então de agora em diante usaremos a notação usual de soma e produto. Vejamos agora as propriedades tanto da soma como o produto de números racionais na seguinte proposição. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 115 Proposição A.2.4 Sejam x, y, z ∈ Q, então são válidas com a soma: i) Associatividade: (x + y) + z = x + (y + z) ii) Neutro: ∃0 ∈ Q tal que 0 + x = x + 0 = x iii) Inverso: ∀x ∈ Q, ∃ − x ∈ Q tal que x + −x = −x + x = 0 iv) Comutatividade: x + y = y + x Agora com o produto são válidas: v) Associatividade: (x ⊙ y) ⊙ z = x ⊙ (y ⊙ z) vi) Neutro: ∃1 ∈ Q tal que 1 ⊙ x = x ⊙ 1 = x vii) Inverso: ∀x 6=∈ Q, ∃y 6=∈ Q tal que x · y = y · x = 1 viii) Comutatividade: x ⊙ y = y ⊙ x E relacionando as duas operações temos: ix) Distributividade à direita: x ⊙ (y + z) = x ⊙ y + x ⊙ z x) Distributividade à esquerda: (x + y) ⊙ z = x ⊙ z + y ⊙ z O conjunto dos números Racionais (Q, +, ·) com as propriedades dadas pela proposição anterior é dito de Corpo comutativo com unidade. A.2.1 Exercı́cios 1. Mostre que a relação R0 , que define os Inteiros Z, é uma relação de equivalência. 2. Mostre que dadas duas classes de equivalência quaisquer definidas por R0 são disjuntas. 3. Represente geometricamente as classes [1, 4], [9, 1]e [5, 9] dadas por R0 . 4. Usando a notação das classes em Z, mostre as propriedades da soma e produto em Z. 5. Mostre que a relação R1 que define os números racionais Q, é uma relação de equivalência. 6. Mostre que dadas duas classes de equivalências quaisquer, definidas por R1 são disjuntas. 7. Represente geometricamente as classes [1, 4], [9, 1] e [5, 9] das por R1 . 8. Mostre as propriedades da soma e do produto dos racionais enunciadas na proprosição 1.2.4. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS A.3 116 Reais e Complexos Na seção anterior vimos que (Q, +, ·) tem uma estrutura algébrica chamada de corpo. Muitos filósofos, antes de Cristo, em especial Pitagoras, pensavam que esses eram todos os possı́veis números, ou que dado qualquer medida de segmento sempre era possı́vel achar dois inteiros positivos (também medidas de segmentos) tal que na comparação era a medida do segmento inicial. Tentaram por muito tempo provar esta afirmação até que se depararam com uma medida, a qual mostrava que esta afirmação era realmente falsa, esta medida √ era dada pela diagonal de um quadrado, de lado um, ou seja em nomenclatura de hoje, 2, então mostremos a seguinte proposição. √ Proposição A.3.1 2 não é Racional. Dem. Vamos mostrar isto por absurdo, isto é, vamos supor que existem inteiros, sem √ a fatores em comum a, b ∈ Q tal que 2 = b . Então segue que: 2= a2 ↔ 2b2 = a2 b2 Como os inteiros a, b não tem fatores em comum, e dois é primo, temos que o 2 divide a , logo divide a, isto é, a = 2q para algum q ∈ Q, logo temos que: 2 a2 = 4q 2 ↔ 2b2 = a2 = 4q 2 ↔ b2 = 2q 2 De maneira análoga, segue que 2 divide b2 , ou seja b também é múltiplo de 2, mostrando que √ os inteiros a, b tem um fator em comum (que é 2), o que é uma contradição. Portanto, 2 não é racional. A partir da proposição anterior vemos que construir números, que não podem ser dados como quociente de dois inteiros, é relativamente fácil. Estes números são conhecidos como Irracionais e denotaremos por a I = {x/∄a, b ∈ Z; x = } b o conjunto dos número Irracionais. Seguindo a linha de conjuntos denotaremos por R = S Q I o conjunto dos números Reais (este conjunto é muito usado e trabalhado nas aulas de Cálculo). Usando as operações de soma e produto de Q podemos induzir operações de soma e produto em R, então desta forma R tem uma estrutura algébrica de corpo. Será que existe um outro corpo que contenha o corpo R?. E porque deveria existir, se existisse?. Na verdade, quando trabalhamos numa estrutura como um corpo, podemos trabalhar na busqueda de soluções a problemas de tipo algébricos, como achar soluções de equações algébricas de segundo grao dada por ax2 + bx + c = 0, onde a, b, c ∈ R por exemplo. Então, gostarı́amos que as soluções de uma equação definida em R, como a anterior, tenha todas as suas soluções também em R, mas basta considerar a equação APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 117 x2 + 1 = 0 e vemos que isto não acontece (não existe nenhum número real tal que seu quadrado seja negativo). Então consideremos o seguinte conjunto : C = {z = a + bi/a, b ∈ R, i2 = −1} onde a denota a parte real de z ∈ C, e b a parte imaginária de z ∈ C. O conjunto C é chamado de conjunto dos números Complexos. O conjunto dos números complexos C pode ser identificados com o plano cartesiano 2 R = {(x, y)/x, y ∈ R}, onde a primeira coordenada é identificada com a parte real, e a segunda coordenada é identificada com a parte imaginaria do complexo z = x + yi ∈ C. Consideremos z = x + yi ∈ C, então chamaremos de conjugado de z o complexo z = x − yi, que é o simétrico ao complexo z, com relação ao eixo x, vistos geometricamente em R2 . Definamos agora a soma em C, que denotaremos por ⊕ da seguinte forma : ⊕ : C × C−→C onde ⊕(z1 , z2 ) = z1 ⊕ z2 = (a1 + a2 ) + (b1 + b2 )i, e z1 = a1 + b1 i ; z2 = a2 + b2 i. Na proposição a seguir são dadas as propriedades satisfeitas por esta soma em C. Proposição A.3.2 Seja (C, ⊕) e sejam z1 = a1 + b1 i , z2 = a2 + b2 i, z3 = a3 + b3 i ∈ C. Então são válidas: i) Associatividade: (z1 ⊕ z2 ) ⊕ z3 = z1 ⊕ (z2 ⊕ z3 ) ii) Neutro: ∃0 = 0 + 0i ∈ C tal que 0 ⊕ z1 = z1 ⊕ 0 = z1 iii) Inverso: ∀z = a + bi ∈ C, ∃ − z = −a + (−b)i ∈ C tal que z ⊕ (−z) = (−z) ⊕ z = 0 + 0i = 0 iv) Comutatividade: z1 ⊕ z2 = z2 ⊕ z1 A partir da proposição anterior podemos concluir que (C, ⊕) é um grupo abeliano. Definamos agora o produto em C, que denotaremos por ⊙, da seguinte forma: Sejam z1 = a1 + b1 i ; z2 = a2 + b2 i ∈ C ⊙ : C × C−→C onde ⊙(z1 , z2 ) = z1 ⊙ z2 = a1 a2 − b1 b2 + (a1 b2 + a2 b1 )i. Na seguinte proposição daremos as propriedades satisfeitas por este produto. APÊNDICE A. INTRODUÇÃO À ESTRUTURAS ALGÉBRICAS 118 Proposição A.3.3 Seja (C, ⊙) e sejam z1 = a1 + b1 i , z2 = a2 + b2 i, z3 = a3 + b3 i ∈ C. Então são válidas: i) Associatividade: (z1 ⊙ z2 ) ⊙ z3 = z1 ⊙ (z2 ⊙ z3 ) ii) Neutro: ∃1 = 1 + 0i ∈ C tal que 1 ⊙ z1 = z1 ⊙ 1 = z1 iii) Inverso: ∀z = a + bi ∈ C, ∃ z ′ = 1 + 0i = 1 a a2 +b2 − a2bi = z ⊙ z ∈ C tal que z ⊙ z ′ = z ′ ⊙ z = +b2 iv) Comutatividade: z1 ⊙ z2 = z2 ⊙ z1 E relacionando as duas operações temos: v) Distributividade à direita: z1 ⊙ (z2 ⊕ z3 ) = z1 ⊙ z2 ⊕ z1 ⊙ z3 vi) Distributividade à esquerda: (z1 ⊕ z2 ) ⊙ z3 = z1 ⊙ z3 ⊕ z2 ⊙ z3 Portanto, temos que (C, ⊕, ⊙) é um corpo, onde toda equação algébrica em C tem todas as suas soluções em C, e o corpo com esta propriedade se diz ser Algebricamente fechado. De agora em diante, sem medo a cometer erro, assumiremos z ⊕ z1 = z + z1 e z ⊙ z1 = zz1 ∀ z, z1 ∈ C. A.3.1 Exercı́cios 1. Mostre que a relação ≤ em R, é uma relação Reflexiva, antissimétrica e transitiva (estas relações são conhecidas como relações de ordem). 2. Mostre que todo complexo z = x+yi ∈ C pode-se escrever como z = r(cos α+i sin α) √ −−−−−−−→ onde r = zz e α é o angulo formado pelo vetor (0, 0)(x, y). 3. Mostre as propriedades da soma e produto em C. √ √ √ L √ 4. Seja Q( 2) = {a√ + b 2/a, b ∈ Q}, onde a soma é dada por (a + b 2) (c + d 2) = √ J √ (a + c) +√ (b + d) 2 e o produto é dado √ por (a + b 2) (c + d 2) = (ac + 2bd) + (ad + bc) 2. Mostre que o conjunto Q( 2) é um corpo comutativo com unidade. 2 5. Calcule a seguinte expressão: 2+i 3−4i 6. Mostre que z1 + z2 = z1 + z2 ∀z1 , z2 ∈ C. 7. Resolva a equação iz + 2z + 1 − i = 0. 8. Seja z ∈ C uma solução da equação x2 + bx + c = 0 onde b, c ∈ R, então mostre que z também é solução da equação anterior. √ 9. Seja K o conjunto de todos os números que podem ser escritos na forma a + b 2, onde a e b são números racionais. Mostre que K é um corpo. Referências Bibliográficas [B] M. Barone. Álgebra Linear. IME-USP, 3a ed.,1988. [CL] F. U. Coelho e M. L. Lourenço. Um Curso de Álgebra Linear. Ed. USP, São Paulo, 2001. [H] P. Halmos. Uma Teoria Ingenua de Conjuntos. Ed. Polı́gono, São Paulo, 1973. [H1] P.Halmos. Espaços Vetoriais de Dimensão finita. Ed. Campus, Rio de Janeiro, 1978. [HK] K. Hofmmann e R. Kunze. Álgebra Linear. Ed. LTC., Rio de Janeiro, 1979. [GS] A. Gonçalves e M. R. Lopes de Souza. Introdução à Álgebra Linear. Ed. Edgard Blücher. São Paulo, 1977. [JAP] De la Peña, Jose Antonio. Álgebra en Todas Partes. México,DF. Ed. Fondo de Cultura Economica, 1999. [JAP1] De la Peña, Jose Antonio. Álgebra Lineal avanzada. México,DF. Ed. Fondo de Cultura Economica, 1996. Cristian Patricio Novoa Bustos Depto. de Matemática e Fı́sica Universidade Católica de Goiás Av. Universitária s/n. St. Universitário Goiânia-Goiás. Brasil [email protected] 119