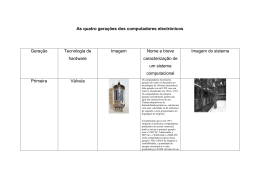

Departamento de Engenharias e Ciência da Computação – DECC Curso de Ciência da Computação Disciplina de Introdução à Informática (35-320) Prof. Ms. Paulo R. B. Betencourt MARCOS DE DESENVOLVIMENTO DA ARQUITETURA DE COMPUTADORES Centenas de computadores de diferentes tipos tem sido projetados e construídos durante a evolução do computador digital moderno. A maioria já foi esquecida, mas alguns tiveram um impacto significativo nas idéias modernas. Apesar dos computadores eletrônicos terem efetivamente aparecido somente na década de 40, os fundamentos em que se baseiam remontam a centenas ou até mesmo milhares de anos. Se levarmos em conta que o termo COMPUTAR, significa fazer cálculos, contar, efetuar operações aritméticas, COMPUTADOR seria então o mecanismo ou máquina que auxilia essa tarefa, com vantagens no tempo gasto e na precisão. Inicialmente o homem utilizou seus próprios dedos para essa tarefa, dando origem ao sistema DECIMAL e aos termos DIGITAL e DÍGITO. Para auxílio deste método, eram usados gravetos, contas e marcas na parede. 2.1 – A GERAÇÃO ZERO Na medida em que os cálculos foram se complicando e aumentando de tamanho, sentiuse a necessidade de um instrumento que viesse em auxílio, surgindo assim há cerca de 5.000 anos na Babilônia o Ábaco. Este era formado por fios paralelos e contas ou arruelas deslizantes, que de acordo com a sua posição, representava a quantidade a ser trabalhada. Os romanos usavam um ábaco que consistia em bolinhas de mármore que deslizavam numa placa de bronze cheia de sulcos. Isto gerou alguns termos matemáticos em latim: CALX significava mármore, logo CALCULUS era uma bolinha do ábaco, e fazer cálculos aritméticos era CALCULARE. A variante do ábaco mais conhecida é o "Soroban", ábaco japonês simplificado (com 5 contas por fio, agrupadas 4x1), ainda hoje utilizado, sendo que em uso de mãos treinadas continuam eficientes e rápidos para trabalhos mais simples. A primeira pessoa a construir uma máquina de calcular foi o cientista francês Blaise Pascal (1623-1662), em cuja honra atribuiu-se o nome da linguagem de programação Pascal. O artefato foi construído quando ele tinha 19 anos e foi projetado para ajudar seu pai, um coletor de impostos do governo francês. Era inteiramente mecânico, utilizava engrenagens e funcionava através de uma manivela operada manualmente. Tal máquina fazia as operações de soma e subtração baseada em 2 conjuntos de discos: um para a introdução dos dados e outro que armazenava os resultados, interligados por meios de engrenagens. A máquina utilizava o sistema decimal para os seus cálculos de maneira que quando um disco ultrapassava o valor 9, retornava ao 0 e aumentava uma unidade no disco imediatamente superior. A Pascalina, como ficou conhecida, foi a primeira calculadora mecânica do mundo. Pascal recebeu uma patente do rei da França para que lançasse sua máquina no comércio. A comercialização de suas calculadoras não foi satisfatória devido a seu funcionamento pouco confiável, apesar de Pascal ter construído cerca de 50 versões. Máquinas de calcular mecânicas, descendentes da Pascalina, até a bem pouco tempo podiam ser encontradas em uso por algumas lojas. Passaram-se 30 anos e o matemático alemão Barão Von Leibnitz (1646-1716) construiu outra máquina mecânica, esta com capacidade de executar também as operações de multiplicação e divisão. As calculadoras da geração da Pascalina executavam somente operações seqüenciais, completamente independentes. A cada cálculo o operador deveria intervir, introduzindo novos dados e o comando para determinar qual operação deveria ser efetuada. Essas máquinas não tinham capacidade para tomar decisões baseadas nos resultados. Em 1801, Joseph Marie Jacquard, mecânico francês, sugeriu controlar máquinas de tecer por meio de cartões perfurados. Os cartões forneceriam os comandos necessários para a tecelagem de padrões complicados em tecidos. A máquina de Jacquard funcionou tão bem que milhares de tecelões desempregados se revoltaram e quase mataram o inventor. Os princípios de programação por cartões perfurados foram também demonstrados por Bouchon, Falcon e Jacques entre 1725 e 1745. Em 1786, o engenheiro J. Muller, planejou a construção de uma máquina para calcular e preparar tabelas matemáticas de algumas funções. Em 1822, o matemático e engenheiro inglês Charles Babbage (1792-1871) inventor do velocímetro, apresentou um projeto à Sociedade Real de Astronomia, baseado nos conceitos de Müller, Bouchon, Falcon, Jacques e no desenvolvimento que Jacquard efetuou com seus teares. O projeto consistia em uma grande calculadora mecânica que ele chamou de "calculador diferencial". O aspecto mais interessante de sua máquina de diferenças era seu método de saída: ele perfurava os resultados numa placa de cobre prenunciando os cartões perfurados e os primeiros discos óticos. Babbage, preocupado com os erros contidos nas tabelas matemáticas de sua época, construiu um modelo para calcular tabelas de funções (logaritmos, funções trigonométricas, etc.) sem a intervenção de um operador humano. Ao operador cabia somente iniciar a cadeia de operações, e a seguir a máquina tomava seu curso de cálculos, preparando totalmente a tabela prevista. Esta máquina baseava-se no princípio de discos giratórios e era operada por uma simples manivela. Em 1823 o governo britânico financiou a construção de uma nova versão mas não obteve resultado satisfatório, devido os limites do ferramental industrial da época. Babbage se viu obrigado a desenhar peças e ferramentas, retardando o desenvolvimento do projeto. Após 10 anos de trabalho, tudo que Babbage havia conseguido era uma pequena máquina de 3 registros e 6 caracteres, sendo que deveria ser, de acordo com o projeto, uma máquina de 7 registros e 20 caracteres cada, além de apresentar seus resultados impressos. Em 1833, Babbage, com o auxílio de Ada Byron King (1815-1852), projetou uma máquina que chamou de "Calculador Analítico", constituída de unidade de controle de memória, aritmética, de entrada e de saída. Sua operação era comandada por um conjunto de cartões perfurados, de modo que, de acordo com os resultados dos cálculos intermediários, a máquina poderia saltar os cartões, modificando dessa forma o curso dos cálculos. Babbage investiu toda sua fortuna pessoal e de seu filho, que com ele trabalhou durante anos, na construção de sua máquina Analítica, vindo a falecer em 1871, sem findar a construção. Hoje, estas partes da máquina construída por Babbage, encontram-se como peças de museu na Inglaterra. Ada Byron King (1815-1852), a condessa de Lovelace, filha do poeta Lord Byron, iniciou, junto com Babbage, o ambicioso projeto de construção da Máquina Analítica. Ada é uma das poucas mulheres a figurar na história do processamento de dados. Matemática talentosa, compreendeu o funcionamento da Máquina Analítica e escreveu os melhores relatos sobre o processo. Criou programas para a máquina, tornando-se a primeira programadora de computador do mundo. Dado a forma de organização da máquina analítica, pode-se dizer que com a sua máquina analítica de Babbage foi o pai (avô) do computador digital moderno. Os fundamentos lógicos que permitem a criação dos programas atuais foram dados pelo inglês George Boole (1815-1864). Em 1854, Boole publicou "An Investigation Into the Law of Thought", estabelecendo uma forma de armazenar e processar informações utilizando relações binárias. Um sistema binário pode apresentar todos os números, usando apenas os algarismos 0, 1 e as potências de 2, como 4 (ou 2 x 2), 8 (ou 2 x 2 x 2), 16 (2 x 2 x 2 x 2) e assim por diante. Nesse sistema de contagem, o número 12 é representado por 1100, ou seja, 1 bloco de 8, 1 bloco de 4, 0 bloco de 2 e 0 bloco de 1. Hermann Hollerith (1860-1929), da mesma forma que Babbage, inspirou-se no tear de Jacquard e inventou uma máquina exclusivamente para acumular e classificar informações. Antes de Hollerith, o Departamento de Censo dos Estados Unidos processava todos os dados manualmente. O censo de 1880 demorou 7 anos e meio para divulgar o resultado! Naquela época (e hoje também), o censo consistia em uma série de perguntas de múltipla escolha. Através disso, desejava-se saber, por exemplo : o número total de cidadãos, quantos tinham de 0 a 2 filhos, quantos moravam em determinada cidade, etc. Hollerich propôs, então, colocar as respostas de cada pessoa em um simples cartão perfurado. Simplificando, cada coluna representava uma pergunta. O furo em determinada coluna representava a resposta àquela pergunta. Os cartões eram lidos por um dispositivo que consistia em uma tábua de pequenos pinos montados sobre molas e que conduziam eletricidade. Quando eles entravam em contato com o cartão, somente os pinos que estivessem sobre os furos passavam. Cada um destes tocava, então, uma pequena cavidade com mercúrio, fechando o circuito elétrico. Cada cavidade estava ligada a um contador, que era acionado toda vez que um pulso elétrico era transmitido. O tabulador de Hollerith reduziu o tempo de processamento de dados do censo de 1890 dos Estados Unidos para "apenas" 2 anos e meio. Mais tarde, a firma de Hollerith prosperou ... e dela acabou surgindo nada menos que a IBM (International Business Machines Corporation), fundada em 1924 nos Estados Unidos. A partir da década de 30 foram feitas várias tentativas de substituir as partes mecânicas dos equipamentos por partes elétricas com o uso dos relés. O alto custo, o tamanho imenso e a baixa velocidade de processamento eram as desvantagens destas máquinas. Na Alemanha, Konrad Zuse concluiu em 1938, o primeiro modelo Z1, utilizando relés eletromagnéticos e a teoria binária. Zuse, que era alemão, tentou vender seu Z1 ao governo para uso militar. Mas os nazistas disseram que a guerra estava "praticamente ganha" e o desprezaram, provavelmente mudando o curso da história. Logo depois, nos EUA, duas pessoas também projetaram calculadoras, John Atanosoff, no Iowa State College, e George Stibbitz, no Bell Labs. A máquina de Atanosoff era surpreendentemente avançada para sua época. Ela utilizava uma aritmética binária e possuía capacitores para a memória que eram periodicamente refrescados para evitar que se descarregassem. As pastilhas modernas de RAM dinâmica, funcionam exatamente da mesma maneira. O próximo passo foi dado por um recém doutor da universidade de Harward chamado Howard Aiken. Ele obteve apoio da marinha e da IBM para desenvolver um computador programável, baseado em relés e em fitas perfuradas, mas sem usar o sistema binário de numeração. A sua primeira máquina, o MARK I que media 15 m x 2,5 m, foi terminado em Harward em 1944, ela tinha 72 palavras de 23 dígitos decimais cada e tinha um tempo de ciclo (isto é, de instrução) de 6 segundos. Para entrada e saída, utilizava-se fita de papel perfurado. Quando Aiken acabou de construir seu sucessor, o MARK II, computadores a relés estavam obsoletos. A era da eletrônica tinha começado. 2.2 – A PRIMEIRA GERAÇÃO - VÁLVULAS (1945 - 1955) A substituição dos relés por válvulas (que foram inventadas antes) permitiu a criação da primeira geração de computadores modernos. O problema era que as válvulas levavam muito tempo até se esquentarem e gastavam muita energia elétrica. Estes computadores eram frágeis, com válvulas de vidro e filamentos bem finos, mas ao mesmo tempo pesavam várias toneladas. Sua manutenção era cara e a sua programação era feita ligando-se fios ou, em modelos mais aperfeiçoados, por cartões perfurados. Todo o circuito era interligado por quilômetros de fios instalados manualmente. Usando válvulas os computadores atingiram velocidades na ordem de milissegundos (1 milissegundo equivale a 1 segundo dividido por mil = 1/1.000). O estímulo para o computador eletrônico foi a Segunda Guerra Mundial. Na primeira fase da guerra os submarinos alemães estavam massacrando os navios britânicos graças as mensagens criptografadas enviadas por um aparelho denominado ENIGMA. Após conseguir uma destas máquinas o governo britânico montou um laboratório ultra-secreto que construiu um computador eletrônico denominado COLOSSUS que decodificava as mensagens alemãs e antecipava os próximos passos do inimigo. O COLOSSUS ficou operacional em 1943, mas como seu projeto era segredo militar sua linha não teve repercussão. Vale salientar entretanto que foi o primeiro computador digital do mundo. Ainda durante a guerra John Mauchley (1907 – 1980) apresentou ao exército americano uma proposta para construir um computador eletrônico, a qual foi aceita em 1943. Mauchley e seu aluno de pós-graduação Presper Eckert (1919 – 1995) construíram um computador eletrônico denominado ENIAC (Eletronic Numerical, Integrator and Computer, ou seja, Computador e Integrador Numérico Eletrônico) Ela construído de 18.000 válvulas e 1.500 relés, pesava 30 toneladas e consumia 140 quilowats de potência. Possuia 20 registradores, cada um capaz de armazenar um decimal de 10 dígitos. Sua programação era feita com 6.000 chaves multiposicionais e da interconexão de um grande número de soquetes e cabos. A máquina ficou pronta somente em 1946, um pouco tarde para o uso em seus objetivos originais. O ENIAC provou, com sucesso, que era uma máquina de emprego geral ao ser utilizado para realização de cálculos em relação ao uso da bomba-H, uma tarefa bem diferente daquela a qual havia sido projetado. No entanto era uma máquina de difícil operação, e de manutenção dispendiosa devido a sucessiva queima de válvulas. Um curso de verão sobre o funcionamento e programação do ENIAC despertou uma explosão no interesse em construir grandes computadores digitais. o primeiro computador operacional foi o EDSAC (1949) construído por Maurice Wilkes. Dentre outros temos o JOHNIAC, o WEIZAC e o MANIAC. Enquanto Eckert e Mauchly iniciaram a construção de um novo computador, o EDVAC, um dos colaboradores do projeto ENIAC, o matemático John von Neumann (1903 – 1957), também iniciou outro projeto aperfeiçoando o computador inicial, denominado IAS, nome do local onde von Neumann foi trabalhar, o Institute for Advanced Studies da universidade de Princeton. É creditada a von Neumann a definição de uma arquitetura de computadores com programa armazenado que, até os dias de hoje, é empregada em máquinas modernas. O IAS foi desenvolvido a partir de um relatório feito pelo próprio von Neumann em que ele discutia como reduzir os inconvenientes do ENIAC, tais como a dificuldade de programar e relocação de fios (que deveria ser feita com os mesmos elementos que representavam os dados eletronicamente) e o tipo de aritmética (substituindo a aritmética decimal pela binária devido a dificuldade de se representar confiavelmente 10 níveis de tensão em vez de 2). Von Neumann é considerado o “pai” do computador moderno por ter apresentado as seguintes proposições para a concepção dos computadores: - utilização de aritmética binária ao invés de aritmética decimal; - organização funcional do computador em quatro unidades principais: a memória, a unidade aritmética e lógica, a unidade de controle e parte de E/S; - construção de computadores de programa armazenado, ou seja, armazenar tanto os dados como também os próprios programas na memória; - Ciclo de instrução repetitivo, isto é, a execução de cada instrução deveria realizar-se a partir de uma seqüência conhecida de etapas, as quais eram repetidas para execução da próxima instrução e assim sucessivamente. O IAS possuía as seguintes características básicas (embora pertença a primeira geração de computadores e tenha sido, para os padrões atuais, uma máquina limitada, o IAS é fundamental no estudo de arquitetura de computadores, pois a grande maioria das especificações permanece válida até o momento): a) era construído com quatro unidades principais: a memória, a UCP, a UC e parte de E/S; b) possuía memória com 1.000 posições denominadas palavras, cada uma podendo armazenar um valor com 40 dígitos binários (bits); c) tanto os dados (valores numéricos) quanto as instruções eram representados na forma binária e armazenados na memória; d) possuía 21 instruções de 20 bits cada uma, constituídas de dois campos com 8 bits e, denominados código de operação; e o outro com 12 bits denominado endereço, para localizar cada uma das 1.000 palavras, endereços 000 a 999; e) operava em modo repetitivo, executando um ciclo de instrução em seguida ao outro. Cada ciclo constituí em dois subciclos: o ciclo de busca, onde o código da operação da próxima instrução era trazido da memória para o IR e a parte de endereço da instrução era armazenado no MAR (Memory Address Registes). Tão logo o código de operação estivesse armazenado na IR, se iniciava o outro subciclo, o ciclo de execução. O circuito de controle interpretava o código de operação e gerava os sinais apropriados para acarretar o movimento de dados ou a realização de uma operação na ULA. Percebe-se que apesar da evolução das máquinas em termos de velocidade, miniaturização, capacidade de armazenamento, etc a arquitetura básica permanece a mesma. Em 1949 a empresa fundada por Mauchly e Eckert construiu com sucesso o primeiro computador para fins comerciais, o UNIVAC I, adquirido pelo censo americano. Em 1953 a IBM, até então mais voltada para a construção e comercialização de equipamentos de processamento por cartão perfurado, lançou seu primeiro computador eletrônico de programa armazenado, o IBM-701, voltado para o processamento científico. Em 1955 a IBM modificou o hardware do 701 para adaptá-lo ao uso comercial, lançando o IBM-702 e em 1956 foi lançado o IBM-704. Nesta altura a IBM já se destacava no mercado em relação à UNIVAC, que vinha sendo a 1a desde 1950. 2.3 – A SEGUNDA GERAÇÃO - TRANSISTORES (1955 - 1965) A eletrônica moderna surgiu em 23 de dezembro de 1947, quando John Bardeen (1908-1991), Walter Brattain (1902-1987), e William Shockley (19101989), cientistas dos Laboratórios Bell, ligados à American Telephone & Telegraph (AT&T), criam o transistor, que faz as mesmas funções das válvulas a um custo bem menor. Além de serem menores e mais baratos do que as válvulas, os transistores consumiam muito menos energia elétrica, eram mais rápidos, menos frágeis e não precisavam "esquentar" antes do funcionamento. Por suas características físicas e elétricas o transistor era menos sujeito a defeitos e isto possibilitou montagens de grandes circuitos em placas compactas de fiação impressa, o que diminuiu a poucos metros a extensão dos fios. Mas foi só em meados da década de 50 é que chegam ao mercado os primeiros computadores totalmente transistorizados, bem menores do que os movidos a válvula e com preço acessível para as grandes empresas e universidades. A primeira companhia a lançar comercialmente um computador transistorizado foi a NCR, e logo em seguida a RCA. As vantagens destas máquinas sobre suas antecessoras eram várias: mais baratas, menores, dissipavam menos calor, e possuíam um menor consumo de energia. O primeiro computador disponível comercialmente foi o UNIVAC, lançado em 1955 pela Eckert-Mauchly Computer Corporation. Sua unidade de aritmética era limitada e a entrada serial, trabalhando com um bit de cada vez, e a capacidade de memória interna era de aproximadamente 1.000 palavras. Esta nova geração de computadores teve a participação ativa da IBM que já se firmava como a mais importante companhia de produção de máquinas científicas. Ela transformou a séria 700 em 7000, esta transistorizada. O 7090 e mais tarde o 7094 possuía um ciclo de instrução de dois microsegundos e 32K palavras de 36 bits. Além do domínio na computação científica a IBM também produziu uma máquina comercial de enorme sucesso, o IBM 1401. Com esta geração de computadores, outros fatos historicamente importantes aconteceram: O aparecimento de outra companhia fabricante de computadores, a DEC. A DEC lançou o seu primeiro computador, o PDP-1, uma máquina de pequeno porte, comparada aos computadores de até então, e com excelente desempenho na sua faixa de preço. Para se ter uma idéia o PDP-1 custava U$120.000 enquanto um IBM custava milhões. Comercialmente a DEC foi líder por um longo período (primeiro com os PDP e, em seguida, com a família VAX). O PDP-8 trouxe uma grande inovação, o barramento, um conjunto de fios paralelos utilizados para conectar os componentes do computador; O aparecimento de unidades aritméticas e lógicas mais complexas, assim como unidades de controle; Aparecimento de linguagens de programação de nível superior ao das linguagens assembly da época (Algol 60 - precursor do pascal; FORTRAN-58; COBOL- 59); O Surgimento de outra companhia, a CDC, que lançou em 1964 o CDC 6600 voltado primariamente para o processamento científico. Era uma máquina com palavras de 60 bits e vários processadores indenpendentes, num total de 10 que garantiam alto paralelismo e liberava a CPU de várias tarefas, tornando o sistema bastante eficiente. 2.4 – A TERCEIRA GERAÇÃO - CIRCUITOS INTEGRADOS (1965 - 1980) Em 1959, Robert Noyce (1927–1990), um físico da Fairchild Semiconductor Corporation da Califórnia, e, independentemente e no mesmo ano, Jack St. Clair Kilby (1923- ), da Texas Instruments, anunciaram a criação do circuito integrado. A invenção do circuito integrado possibilitou que dezenas de transistores, resistores, capacitores fossem colocados sobre uma base de silício (um material semicondutor), chamado de chip. Este encapsulamento permitiu construir computadores menores, maios rápidos e mais baratos. Por volta de 1964 a IBM, fabricante líder tinha o problema de suas duas máquinas de sucesso serem incompatíveis entre si. No momento de substituir estas duas séries a IBM deu um passo radical e lançou uma única linha de produtos o System/360, baseada em circuitos integrados, projetada tanto para a computação científica quanto comercial. Este sistema incorporou diversas inovações, que se tornaram um marco histórico em termos de computação e consolidaram a posição já obtida pela IBM como primeira fabricante de computadores do mundo. Entre as inovações, podemos citar: a) O conceito de família de computadores, em vez de máquina individual. Este conceito permite que o fabricante ofereça o mesmo tipo de máquina com diferentes capacidades e preços; b) A utilização da unidade de controle com microprogramação em vez das tradicionais unidades de controle no hardware; c) O emprego de uma técnica chamada de multiprogramação, pela qual vários programas compartilham a memória principal e dividem o uso da CPU, dando a impressão ao usuário de que estão sendo executados simultaneamente; d) Elevada capacidade de processamento (para a época) com palarva de 32 bits e ciclo de instrução de até 250 nanosegundos, bem como grande capacidade de armazenamento da memória principal 16 Mbytes; e) Memória principal orientada a byte, isto é, cada célula de memória armazena 8 bits de informação independente do tamanho da palavra de dados; f) O lançamento de um programa (ou melhor, conjunto deles) gerenciador de recursos de hardware, o sistema operacional OS/360. Além da família 360 (da IBM), está época de LSI (Low Scale Integration) presenciou também o lançamento de outro minicomputador DEC, com circuitos integrados, memória principal orientada a byte e palavra de 16 bits, o PDP-11, uma das máquinas mais famosas de sua categoria. Seu sucessor, o VAX-11, também teve o esmo sucesso, especialmente no ambiente universitário. Em 1968, Robert Noyce e Gordon Moore fundam, nos Estados Unidos, a Intel Corporation, que criou, em 1969, o chip de memória de 1 KB. Gordon Moore, durante um artigo para uma revista especializada afirmou que a integração de transistores em um circuito integrado dobrava de capacidade a cada 24 meses, mantendo-se os mesmos custos de fabricação. Esta afirmação, válida até os dias atuais conforme pode ser vista na figura abaixo, ficou conhecida posteriormente como Lei de Moore. 2.5 – A QUARTA GERAÇÃO - COMPUTADORES PESSOAIS E VSLI (1980 - ????) Nos anos 80, a VSLI (Very Large Scale Integration) tornou possível colocar dezenas de milhares, centenas de milhares e finalmente milhões de transistores em uma única pastilha. Antes do PDP-1 os computadores eram tão grandes que as companhias e universidades tinham que ter departamentos especiais, denominados centros de computação para operá-los. Em maio de 1969, a empresa japonesa ETI contratou a Intel Corporation para produzir, em um único circuito integrado, o circuito de uma calculadora completa. Assim nasceu, em 1971, criado por Marcian E. Hoff Jr., um engenheiro da Intel, o Intel 4004, um microprocessador de 4 bits e 108 KHz, que possuía 2.300 transistores, velocidade de 60.000 operações por segundo e preço inicial de US$ 200. O mundo nunca mais foi o mesmo desde então. O primeiro microcomputador (o termo "microcomputador" surgiu somente em abril de 1973) a utilizar o Intel 4004 foi o MCS-4. A partir de 1980, as evoluções tecnológicas se deram principalmente na miniaturização dos componentes internos dos computadores e os avanços ficaram relacionados com a ESCALA DE INTEGRAÇÃO dos circuitos integrados, ou seja, em quantos transistores se pode colocar em um único chip. Exemplos: * LSI: Large Scale of Integration - densidade: 1k memórias pequenas, alguns processadores (1971 – Intel 4004) * VLSI: Very Large Scale of Integration - densidade: 1M 1976 – Cray I 1977 – Apple II 1981 – IBM-PC 1984 – Macintosh (Apple) * ULSI: Ultra Large Scale of Integration - densidade: 10 a 100M 1993 – Pentium (Intel) * UVLSI: Ultra Very Large Scale of Integration – densidade: > 100M Power 603 Pentium 3 2.6 - Quinta Geração -??? Nesse final de século surge um novo ramo na informática, a inteligência artificial, que estuda métodos de simular o pensamento humano nos computadores com o objetivo de substituir o homem pela máquina em atividades mecanizadas. Alguns computadores já funcionam com modelos de raciocínio e comportamento humanos, auxiliando médicos em diagnósticos, praticando diversos jogos e compondo músicas. Há também o COG, protótipo de robô que está sendo projetado e construído pelo Instituto de Tecnologia de Massachusetts (MIT). Sua forma é semelhante à do homem: tem cabeça, olhos e braços. O robô, cujo sistema nervoso artificial é 64 vezes mais potente do que um Macintosh, irá simular as fases de crescimento do homem, seus pensamentos e sentimentos. Processadores Quânticos Processadores óticos Processadores Biológicos

Baixar