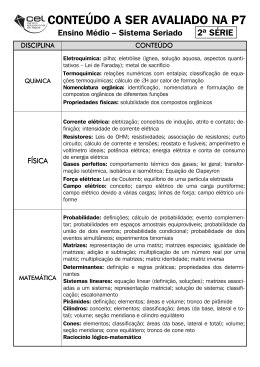

Álgebra Matricial - Nota 07 Produto de Matrizes Márcio Nascimento da Silva Universidade Estadual Vale do Acaraú Curso de Licenciatura em Matemática [email protected] 3 de junho de 2014 Prosseguindo com as operações entre matrizes, passemos ao produto. Diferentemente da soma, a multiplicação entre duas matrizes não é tão “natural”, isto é, não é o resultado do produto elemento a elemento entre duas matrizes de mesma ordem. Mas qual a razão para que o produto não seja, digamos, da maneira “fácil”? Lembremos que, cronologicamente, os sistemas lineares foram objetos de estudo antes da Álgebra Matricial, sendo as matrizes apenas meios para representação de sistemas. Além disso, tudo que viria a ser feito depois dos sistemas, não deveria ir de encontro ao que já estava consolidado. Nesse contexto se desenvolve a Álgebra Matricial. 1 Funções Lineares Sejam A, B conjuntos nos quais estão definidas a operação soma e o produto por escalar. Uma função f : A 7−→ B é dita função linear quando f (X + Y) = f (X) + f (Y) f (c.X) = c. f (X) para X, Y ∈ A Exemplo 1 Considere o plano R2 . A soma de pares ordenados é dada por (a, b) + (c, d) = (a + c, b + d) e o produto por escalar é definido por c.(x, y) = (cx, cy). Seja C o conjunto de escalares. Neste caso: A = R2 , B=R Dados X, Y ∈ R2 , temos que X = (x1 , x2 ) e Y = (y1 , y2 ). Defina f (x1 , x2 ) = x1 + x2 . Daı́ f (X + Y) = = f ((x1 , x2 ) + (y1 , y2 )) f (x1 + y1 , x2 + y2 ) = (x1 + y1 ) + (x2 + y2 ) = (x1 + x2 ) + (y1 + y2 ) = f (x1 , x2 ) + f (y1 , y2 ) = f (X) + f (Y) f (c.X) = = f (c.(x1 , x2 )) f (cx1 , cx2 ) = cx1 + cx2 = c(x1 + x2 ) = c. f (x1 , x2 ) = c. f (X) 1 Portanto, esta é uma função linear. Exemplo 2 Considere o sistema de 2 equações e 3 variáveis ( 2x + 3y + 4z = 3 S 3x − 2y + 2z = 1 Sejam " # 2 3 4 A= , 3 −2 2 e defina a função x X = y , z " # 3 B= 1 f : R3 7−→ R2 f (X) = B Então ! x 2x + 3y + 4z f y = 3x − 2y + 2z z Verifiquemos que se trata de uma função linear. Sejam u, v ∈ R3 . Então u1 v1 u = u2 , v = v2 u3 v3 Daı́, f (u + v) = = = ! u1 v1 u1 + v1 2(u1 + v1 ) + 3(u2 + v2 ) + 4(u3 + v3 ) f u2 + v2 = f u2 + v2 = 3(u1 + v1 ) − 2(u2 + v2 ) + 2(u3 + v3 ) u3 v3 u3 + v3 ! ! ! (2u1 + 3u2 + 4u3 ) + (2v1 + 3v2 + 4v3 ) 2u1 + 3u2 + 4u3 2v1 + 3v2 + 4v3 = + (3u1 − 2u2 + 2u3 ) + (3v1 − 2v2 + 2v3 ) 3u1 − 2u2 + 2u3 3v1 − 2v2 + 2v3 u1 v1 u f 2 + f v2 = f (u) + f (v) u3 v3 ! ! α.u1 u1 2(α.u1 ) + 3(α.u2 ) + 4(α.u3 ) α.(2u1 + 3u2 + 4u3 ) f (α.u) = f α u2 = f α.u2 = = 3(α.u1 ) − 2(α.u2 ) + 2(α.u3 ) α.(3u1 − 2u2 + 2u3 ) u3 α.u3 ! u1 2u1 + 3u2 + 4u3 = α. f u2 = α. f (u) = α 3u1 − 2u2 + 2u3 u3 A ideia do Exemplo 2 pode ser estendida para um sistema qualquer com n equações e m variáveis, isto é, dado um sistema a11 x1 + a12 x2 + . . . + a1m xm = b1 a21 x1 + a22 x2 + . . . + a2m xm = b2 2 .. . an1 x1 + an2 x2 + . . . + anm xm = bn onde A = [ars ]n×m é a matriz dos coeficientes, X = [xi ]m×1 é a coluna das variáveis e B = [bi ]n×1 é a coluna dos termos independentes, temos que f : Rm 7−→ Rn definda por é uma função linear. x1 a11 x1 + a12 x2 + . . . + a1m xm x2 a21 x1 + a22 x2 + . . . + a2m xm f .. = .. . . an1 x1 + an2 x2 + . . . + anm xm n×1 xm 1.1 Produto interno Considere uma matriz linha L = [l1 l2 . . . ln ] e uma matriz coluna c1 c2 C = . .. cn ambas com n entradas. Então L.C := l1 .c1 + l2 .c2 + . . . + ln .cn é chamado produto interno entre L e C. Observe que L ∈ C1×n , C ∈ Cn×1 e L.C ∈ C, isto é, C1×n × Cn×1 −→ C (L, C) 7→ Exemplo 3 Dados L = [(2 − i) 3 − 1] então o produto interno L.C é o número complexo L.C (2 + i) C = 3 −1 (2 − i).(2 + i) + 3.3 + (−1)(−1) = 15 Exemplo 4 Dadas as matrizes 1 7 3 1 2 A = 4 3 2 , B = −4 1 1 0 −1 1 1 O produto interno entre a linha 2 de A e a coluna 2 de B é: A2∗ · B∗2 = 4.7 + 3.1 + 2.1 = 33 3 1.2 Composição de Funções Lineares Por volta de 1855 Arthur Cayley ficou interessado em composição de funções lineares, mais precisamente as funções lineares como no Exemplo 2. Exemplo 5 Considere os sistemas S1 S2 ( ( Ax + By = U Px + Qy = V ax + by + cz = u px + qy + rz = v As matrizes dos coeficientes são, respectivamente " # A B M1 = , P Q " # a b c M2 = p q r Definindo f : R2 → R2 g : R3 → R2 por ! ! x Ax + By f = y Px + Qy ! x ax + by + cz g y = px + qy + rz z e temos que a composta f ◦ g está definida de R3 em R2 da seguinte forma: ! ! x ax + by + cz A(ax + by + cz) + B(px + qy + rz) h(x) = ( f ◦ g)(x) = f (g(X)) = f g y = f = px + qy + rz P(ax + by + cz) + Q(px + qy + rz) z ! (Aa + Bp)x + (Ab + Bq)y + (Ac + Br)z = (Pa + Qp)x + (Pb + Qq)y + (Pc + Qr)z Cayley teve a ideia de representar as funções lineares do tipo descrito no exemplo acima a partir das matrizes dos coeficientes de cada um dos sistemas, isto é, as funções f, g e h seriam representadas pelas matrizes: " # " # " # A B a b c (Aa + Bp) (Ab + Bq) (Ac + Br) F= G= , H =F◦G= P Q p q r (Pa + Qp) (Pb + Qq) (Pc + Qr) Daı́, foi natural para Cayley chamar a matriz H de composição (ou produto) de F e G: " # " # " # A B a b c (Aa + Bp) (Ab + Bq) (Ac + Br) = P Q p q r (Pa + Qp) (Pb + Qq) (Pc + Qr) Repare, ainda, que cada entrada hij da matriz H equivale ao produto escalar Fi∗ .G∗ j entre a linha i de F e a coluna j de G. 4 Dom(f) f g Im(f o g) Im(g) Figura 1: Composição das funções lineares f e g. 1.3 Produto de Matrizes No Exemplo 5, vemos que a imagem da função g e o domı́nio da função f devem ter alguma interseção para que seja possı́vel a composição f ◦ g. Neste caso, o contradomı́nio de g é o conjunto R2 e o domı́nio de f também é R2 , o que viabiliza a existência de interseção. Quanto ao domı́nio de g e ao contradomı́nio de f não há restrições deste tipo. Considerando as matrizes F, G e H associadas as funções f, g e h, vemos que o número de colunas de F corresponde ao número de linhas de G. Já o número de linhas de H será igual ao número de linhas de F e o o número de colunas de H será igual ao número de colunas de G. F2×2 , G2×3 H2×3 ∴ Por outro lado, dada qualquer matriz A, podemos criar uma função linear f onde A é a matriz associada. Definição 6 (Produto de Matrizes) Sejam as matrizes A = [aij ]n×m e B = [bij ]m×r . O produto A.B é definido por (A1∗ · B∗1 ) (A1∗ · B∗2 ) . . . (A1∗ · B∗r ) (A2∗ · B∗1 ) (A2∗ · B∗2 ) . . . (A2∗ · B∗r ) = [(A · A )] A.B = .. .. .. i∗ ∗ j n×r . . . (An∗ · B∗1 ) (An∗ · B∗2 ) . . . (An∗ · B∗r ) n×r isto é, cada entrada xij da matriz A.B é o produto interno entre a linha i da matriz A e a coluna j da matriz B. Observe que o produto só está definido quando o número de colunas da primeira matriz for igual ao número de linhas da segunda matriz. Neste caso, dizemos que as matrizes são compatı́veis para o produto. Exemplo 7 Considere as matrizes 4 (2 + i) 6 B = 5 3 2i " # 2 i 3 A= , 4 3 1 Analisando as ordens das matrizes, temos A 2× B 3 3 ×2 e portanto existe A.B, cuja ordem será 2 × 2. Analogamente, B 3× A 2 5 2 ×3 implica que B.A existe e terá ordem 3 × 3. Vamos a elas. A.B = " # (A1∗ .B∗1 ) (A1∗ .B∗2 ) (A2∗ .B∗1 ) (A2∗ .B∗2 ) " [2.4 + i.5 + 3.3] [2.(2 + i) + i.6 + 3.2i] = [4.4 + 3.5 + 1.3] [4.(2 + i) + 3.6 + 1.2i] " # (17 + 5i) (4 + 14i) = 34 (26 + 6i) # (B1∗ · A∗1 ) (B1∗ · A∗2 ) (B1∗ · A∗3 ) B.A = (B2∗ · A∗1 ) (B2∗ · A∗2 ) (B2∗ · A∗3 ) (B3∗ · A∗1 ) (B3∗ · A∗2 ) (B3∗ · A∗3 ) (4.2 + (2 + i).4) (4.i + (2 + i).3) (4.3 + (2 + i).1) (5.i + 3.6) (5.3 + 6.1) = (5.2 + 6.4) (3.2 + 2i.4) (3.i + 2i.3) (3.3 + 2i.1) (16 + 4i) (6 + 7i) (14 + i) (18 + 5i) (21) = (34) (6 + 8i) (9i) (9 + 2i) No exemplo acima, vemos que A.B , B.A Na verdade, se A tem ordem n × m e B tem ordem m × p com n , p, existe A.B sem que exista B.A! 1.4 Equação matricial de um sistema Considere um sistema linear com n equações e m variáveis a11 x1 + a12 x2 + . . . + a1m xm = b1 a21 x1 + a22 x2 + . . . + a2m xm = b2 .. . an1 x1 + an2 x2 + . . . + anm xm = bn Observe que, sendo A = [ars ]n×m a matriz dos coeficientes do sistema e X = [xi ]m×1 a matriz coluna cujas entradas são as variáveis do sistema, então o primeiro membro de cada uma das equações acima é um produto interno: h a11 x1 + a12 x2 + . . . + a1m xm = a11 a12 h a21 x1 + a22 x2 + . . . + a2m xm = a21 a22 6 x1 i x2 . . . a1m · . = A1∗ · X = b1 .. xm x1 i x2 . . . a2m · . = A2∗ · X = b2 .. xm .. . h an1 x1 + an2 x2 + . . . + anm xm = an1 an2 Ou seja x1 i x2 . . . anm · . = An∗ · X = bn .. xm A·X =B onde B é a matriz coluna de ordem n × 1 cujas entradas são os termos independentes do sistema. 1.5 Propriedades Apesar da terminologia “produto”, esta operação entre matrizes - diferentemente da soma - não possui algumas caracterı́sticas básicas do produto de números complexos. 1.5.1 Não há lei do cancelamento No conjunto dos números complexos C, a igualdade ax = bx implica a = b desde que x , 0. Lembre-se que o zero é o elemento neutro da soma em C. Com matrizes, isso pode não acontecer. Exemplo 8 Considere as matrizes h i A= 2 1 , h i B= 1 0 , " # −1 C= 1 Veja que A.C = B.C com C , 0, mas A , B. Portanto, a lei do cancelamento não vale para o produto de matrizes. 1.5.2 Não há comutatividade Como já vimos, pode ocorrer o produto A.B sem que exista o produto B.A. Mas mesmo que os dois produtos existam, é possı́vel que não ocorra a igualdade. " # " # 2 0 1 4 Exemplo 9 Considere as matrizes A = eB= . Daı́ 3 0 2 3 " # " # 2 8 14 0 A.B = e B.A = 3 12 13 0 e portanto a comutatividade não ocorre sempre. Agora vejamos algumas propriedades válidas para o produto de matrizes. 7 1.6 Distributividade Com os números complexos, sabemos que é válido x.(y + z) = x.y + x.z isto é, vale a distributividade do produto com relação a soma. Além disso, tanto faz escrever x.(y + z) ou (y + z).x, uma vez que em C tem-se comutatividade. No caso das matrizes, devemos ter cuidado ao usar a distributividade. Distributividade à Esquerda: Sejam as matrizes An×m , Bm×p , Cm×p . Então A(B + C) = AB + AC Distributividade à Direita: Sejam as matrizes Dn×m , En×m , Fm×p . Então (D + E).F = DF + EF Provemos a primeira igualdade. Considere A = [aij ]n×m , B = [bij ]m×p , C = [cij ]m×p e sejam xij as entradas da matriz A(B + C). Então xij = Ai∗ · (B + C)∗ j (b1 j + c1 j ) (b2 j + c2 j ) = (ai1 ai2 ... aim ) · .. . (bm j + cm j ) = ai1 .(b1 j + c1 j ) + ai2 .(b2 j + c2 j ) + . . . + aim .(bm j + cm j ) = [ai1 .b1 j + ai2 .b2 j + . . . + aim .bm j ] + [ai1 .c1 j + ai2 .c2 j + . . . + aim .cm j ] b1 j c1 j b2 j c2 j = (ai1 ai2 ... aim ) · . + (ai1 ai2 ... aim ) · . . . .. bm j cm j = Ai∗ · B∗ j + Ai∗ · C∗ j Por outro lado, A.B = [Ai∗ · B∗ j] e A.C = [Ai∗ · C∗ j] Ou seja, A(B + C) = AB + AC e de maneira análoga constata-se a distributividade à direita. 1.7 Associatividade Sejam An×m , Bm×p , Cp×k . Então A.(B.C) = (A.B).C Se A = [aij ]n×m , B = [bij ]m×p , C = [cij ]p×k e xij as entradas da matriz BC. Então xij = Bi∗ · C∗ j = bi1 .c1 j + bi2 .c2 j + . . . + bip .cp j Daı́, se yij são as entradas de A.(BC), então 8 yij = Ai∗ · (BC)∗ j = ai1 .x1 j + ai2 .x2 j + . . . + aim .xm j = ai1 .(b11 .c1 j + b12 .c2 j + . . . + b1p .cp j ) + +ai2 .(b21 .c1 j + b22 .c2 j + . . . + b2p .cp j ) + + . . . + aim .(bm1 .c1 j + bm2 .c2 j + . . . + bmp .cp j ) Por outro lado, denotando por zij as entradas da matriz A.B, temos: zij = Ai∗ · B∗ j = ai1 .b1 j + ai2 .b2 j + . . . + aim .bm j e se wij são as entradas da matriz (AB).C, então wij = (AB)i∗ · C∗ j = zi1 .c1 j + zi2 .c2 j + . . . + zip .cp j = (ai1 .b11 + ai2 .b21 + . . . + aim .bm1 ).c1 j + +(ai1 .b12 + ai2 .b22 + . . . + aim .bm2 ).c2 j + + . . . + (ai1 .b1p + ai2 .b2p + . . . + aim .bmp ).cp j = ai1 .(b11 .c1 j + b12 .c2 j + ... + b1p .cp j ) + +ai2 .(b21 .c1 j + b22 .c2 j + ... + b2p .cp j ) + + . . . + aim .(bm1 .c1 j + bm2 .c2 j + ... + bmp .cp j ) + Comparando yij e wij , concluimos que A(BC) = (AB)C. 1.8 Elemento Neutro Dado um conjunto não vazio Ω com uma operação binária ∗, o elemento neutro é aquele que não influencia no resultado. Em C, o elemento neutro para o produto é o número 1, pois z.1 = z qualquer que seja z ∈ C. E num conjunto de matrizes? Seja A ∈ Cn×m . Procuremos a matriz X tal que A.X = A. Inicialmente, vejamos a ordem de X. Digamos que X tem p linhas e k colunas. Para que o produto A.X exista, é necessário que p = m, uma vez que a ordem de A é n × m. Por outro lado, A.X deve ter ordem n × m. Portanto, k = m. Assim, X deve ser uma matriz quadrada de ordem m × m. Considerando a matriz identidade de ordem m × m, isto é, Temos 1 0 . . . 0 0 1 . . . 0 I = .. .. . . .. . . . . 0 0 . . . 1 m×m a11 a12 . . . a1m 1 0 . . . 0 a21 a22 . . . a2m 0 1 . . . 0 A.I = .. .. .. . .. .. . . .. = A . . . . . . . an1 an2 . . . anm 0 0 . . . 1 Ou seja, I é uma solução para a equação A.X = A. Da mesma forma, I.A = A, quando I e A compatı́veis. A matriz quadrada I é chamada Matriz Identidade. Como se trata de uma matriz quadrada, para nos referirmos à sua ordem usaremos apenas a notação In para denotar a ordem n × n da matriz. 9 1.9 Potências de uma matriz Para matrizes quadradas, podemos usar uma notação análoga a usada para escalares (reais ou complexos). Se A ∈ Cn×n então • A0 = In • A2 = A.A, A3 = A.A.A, ..., An = A.A. · · · .A com n ∈ Z+ | {z } n−vezes Daı́, é correto escrever: Ar .As = Ar+s , (Ar )s = Ar.s , r, s ∈ Z+ r, s ∈ Z+ 1.10 Transpostas e Conjugadas Transpostas Sejam A, B matrizes compatı́veis para o produto A.B. Então (i) (AB)T = BT .AT (ii) (AB)∗ = B∗ A∗ Vamos verificar a primeira igualdade. Sejam A = [aij ]n×m e B = [bij ]m×p . Então A.B = [xij ]n×p e onde xij = Ai∗ · B∗ j (A1∗ · B∗1 ) (A2∗ · B∗1 ) . . . (An∗ · B∗1 ) (A1∗ · B∗2 ) (A2∗ · B∗2 ) . . . (An∗ · B∗2 ) T (A.B) = .. .. .. . . . (A1∗ · B∗p ) (A2∗ · B∗p ) . . . (An∗ · B∗p ) p×n Por outro lado, AT = [a ji ]m×n e BT = [b ji ]p×m . Assim, BT e AT são compatı́veis para o produto BT .AT e BT .AT = [yij ]p×n onde yij = BTi∗ · AT∗ j e cada elemento yij é o produto interno entre a linha i de BT e a coluna j de AT . Ora, mas a linha i de BT é a coluna i de B e a coluna j de AT é a linha j de A. Portanto yij = B∗i · A j∗ = b1i .a j1 + b2i .a j2 + . . . + bmi .a jm = a j1 .b1i + a j2 .b2i + . . . + a jm .bmi b1i b2i = a j1 a j2 . . . a jm · .. . bmi = A j∗ · B∗i e BT .AT = [yij ]p×n (A1∗ · B∗1 ) (A2∗ · B∗1 ) . . . (An∗ · B∗1 ) (A1∗ · B∗2 ) (A2∗ · B∗2 ) . . . (An∗ · B∗2 ) = (A.B)T = .. .. .. . . . (A1∗ · B∗p ) (A2∗ · B∗p ) . . . (An∗ · B∗p ) De maneira similar é possı́vel mostrar que (AB)∗ = B∗ A∗ . 10 Exemplo 10 Seja A uma matriz de ordem n × m. Mostremos que AT .A é simétrica. Com efeito, AT é uma matriz de ordem m × n. Portanto, o produto AT .A existe e terá ordem m × m. Sendo essa uma matriz quadrada, mostrar que ela é simétrica significa mostrar que ela e sua transposta são iguais. Isto é: (AT .A)T = AT .A Partindo do primeiro membro, temos: (AT .A)T = AT .(AT )T = AT .A 2 Exercı́cios 1. Sendo 1 −2 3 A = 0 −5 4 , 4 −3 8 1 2 B = 0 4 3 7 calcule os seguintes produtos quando possı́vel: 1 e C = 2 3 (a) AB (b) BA (c) CB (d) CT B (e) A2 (g) CT C (h) C.CT (i) BBT (j) BT B (k) CT AC (f) B2 2. Considere o seguinte sistema de equações: 2x1 + x2 + x3 = 3 4x1 + 2x3 = 10 2x1 + 2x2 = −2 (a) Escreva a equação matricial do sistema (AX = B). (b) Escreva a solução S do sistema na forma coluna e verifique, usando multiplicação de matrizes, que S satisfaz a equação AX = B. (c) Escreva B como uma combinação das colunas de A. 1 0 0 3. Seja E = 0 1 0 e seja A uma matriz arbitrária de ordem 3 × 3. 3 0 1 (a) Descreva as linhas de EA em termos das linhas de A. (b) Descreva as colunas de AE em termos das colunas de A. 4. Seja e j a j-ésima coluna unitária, isto é, a j-ésima coluna de uma matriz identidade de ordem n. Para uma matriz arbitrária An×n descreva os seguintes produtos: (a) A.e j (b) eTi .A (c) eTi .Ae j 5. Suponha que A e B são matrizes de ordem m × n. Se ocorre Ax = Bx para todo vetor coluna x, mostre que A = B. [Sugestão: o que acontece se x é uma coluna unitária?] 6. Se Cm×1 e R1×n , então a matriz produto Pm×n = CR é, às vezes, chamada de produto externo de C com R. Para matrizes compatı́veis A e B, explique como escrever o produto AB como uma soma de produtos externos envolvendo as colunas de A e as linhas de B. 11 7. Uma matriz quadrada U = [uij ] é dita triangular superior sempre que uij = 0 para i > j, isto é, as entradas abaixo da diagonal principal são todas nulas. (a) Se A e B são duas matrizes do tipo triangular superior, explique por que o produto AB também é uma matriz triangular superior. (b) Se An×n e Bn×n são duas matrizes do tipo triangular superior, o que está na diagonal principal de AB? (c) L = [lij ] é dita triangular inferior quando lij = 0 para i < j. É verdade que o produto de duas matrizes do tipo triangular inferior, é também uma matriz triangular inferior? 8. Seja Am×n uma matriz arbitrária. Mostre que A∗ .A e A.A∗ são matrizes hermitianas. 9. Se A e B são duas matrizes simétricas que comutam, mostre que o produto AB também é simétrico. Se AB , BA, AB é simétrica? 10. Seja f : A → B uma função. Mostre que se f (c.X + Y) = c. f (X) + f (Y), então f é uma função linear. 11. Sejam A, B duas matrizes. Sob que condições tem-se (AB)n = An .Bn ? 12. O traço de uma matriz quadrada é a soma dos elementos de sua diagonal principal, ou seja: traço(A) = a11 + a22 + . . . + ann (a) Qual o traço da matriz I3 ? (b) Qual o traço da matriz In ? (c) Qual o traço da matriz A = [aij ]n×n tal que aij = 2i − j2 ? [Sugestão: 1 + 2 + ... + n = n(n + 1)(2n + 1) ]. 6 e Ym×n . Mostre que traço(XY) = traço(YX). e 12 + 22 + 32 + ... + n2 = (d) Sejam Xn×m 12 n(n + 1) 2

Baixar