Econometria

1.

2.

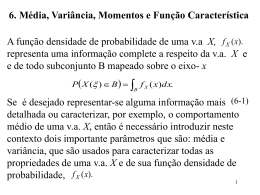

Propriedades finitas dos estimadores MQO

Estimação da Variância do estimador de MQO

Econometria

1.

Propriedades finitas dos estimadores MQO

Algumas considerações

Parâmetros, estimativas e estimadores

Propriedades de um estimador – a distribuição

amostral

Propriedades de “Amostras Finitas”

Propriedades “assintóticas” ou de “grandes

amostras”.

Algumas considerações

Resultados de Amostras finitas:

Não viés

Distribuição precisa de algumas estatísticas de

testes.

Hipóteses fortes necessárias: regressores não

estocásticos e distúrbios normalmente distribuídos.

MQO

b ( X'X ) 1 X'y

= ( X'X ) 1 X'(X + ) = ( X'X ) 1 X'

Also

1

b ( X'X ) X'y= ( X'X )

= ( X'X )

1

n

i1

1

n

i1

xiyi

x i i

= i1 ( X'X ) 1 x ii

n

= i1 v ii (Influence functions)

n

Derivando as Propriedades

Desta forma, b = um vetor de parâmetros + uma

combinação linear de distúrbios, cada um vezes

um vetor.

b é um vetor de variáveis aleatórias.

Regressores (X) não são estocásticos.

A análise é feita condicional a X, ou seja, os

resultados não dependem de um X particular.

O resultado é geral, independente de X.

Propriedades do estimador de MQO

b não é viesado!

Valor esperado de b:

E[b|X] = E[ + (XX)-1X|X]

= + (XX)-1XE[|X]

=+0

E[b]

= EX{E[b|X]}

= E[b].

(Lei das expectativas iteradas!!!)

Propriedades do Estimador MQO

Um resultado importante sobre especificação

Omissão de variáveis:

y = X11 + X22 + (modelo verdadeiro)

Dois conjuntos de variáveis. O que acontece se o

segundo conjunto de variáveis é excluído da

minha regressão?

Propriedades do Estimador MQO

Qual a esperança do estimador desta regressão

menor?

E[b1|(y = X11 + X22 + )]

b1 = (X1X1)-1X1y =

= (X1X1)-1X1(X11 + X22 + )

E[b1] = 1 + (X1X1)-1X1X22

O estimador é viesado.

Propriedades do Estimador MQO

Um resultado importante sobre especificação (inclusão de

uma variável irrelevante):

y = X11 + X22 + (modelo verdadeiro, mas 2 é

igual a 0).

O que acontece se a regressão for computada usando X1 e

X2?

E[b1.2| 2 = 0] = 1

O estimador não será viesado. Contudo, perde-se

eficiência.

Propriedades do Estimador MQO

Aplicação empírica:

Quantidade = 1Preço + 2Renda +

Se regredimos Quantidade em Preço. O que

encontramos?

Propriedades do Estimador MQO

cov( preço, renda )

E (b1) 1

. 2

var(preço)

Usualmente, 1 < 0, 2 > 0, Cov[Preço,Renda] > 0.

Desta forma, a regressão que omite variável (omite renda),

irá super-estimar o coeficiente de preço (podendo até

reverter o sinal do coeficiente).

Outro exemplo prático

Determinar os efeitos que fumar durante a gravidez

exerce sobre a saúde do recém-nascido. A medida de

saúde do recém nascido é o peso de nascimento

(bwght). Como outros fatores que afetam o peso de

nascimento, além de fumar, estão provavelmente

correlacionados com o fumo, devemos levar em

consideração tais fatores. Por exemplo, uma renda

maior geralmente permite acesso a pré-natais

melhores, bem como uma melhor nutrição da mulher.

Considere o modelo:

bwght 0 1.cigs 2 . fa min c u

Outro exemplo prático

Modelo 1: Estimativas OLS usando as 1388 observações 1-1388

Variável dependente: bwght

Variável

const

cigs

faminc

Coeficiente

116,974

-0,463408

0,0927647

Erro Padrão estatística-t

1,04898

111,5118

0,0915768

-5,0603

0,0291879

3,1782

Média da variável dependente = 118,7

Desvio padrão da variável dependente = 20,354

Soma dos resíduos quadrados = 557486

Erro padrão dos resíduos = 20,0628

R2 não-ajustado = 0,0298048

R2 ajustado = 0,0284038

Estatística-F (2, 1385) = 21,2739 (p-valor < 0,0000

14

p-valor

<0,00001

<0,00001

0,00151

***

***

***

Outro exemplo prático

Modelo 2: Estimativas OLS usando as 1388 observações 1-1388

Variável dependente: bwght

Variável

const

cigs

Coeficiente

119,772

-0,513772

Erro Padrão estatística-t

0,572341

209,2668

0,0904909

-5,6776

Média da variável dependente = 118,7

Desvio padrão da variável dependente = 20,354

Soma dos resíduos quadrados = 561551

Erro padrão dos resíduos = 20,1286

R2 não-ajustado = 0,0227291

R2 ajustado = 0,022024

Graus de liberdade = 1386

15

p-valor

<0,00001

<0,00001

***

***

Equações estimadas

bwghtest 116,97 0,463.cigs 0,093. fa min c

n 1388

R 2 0,030

bwghtest 119,77 0,513.cigs

n 1388

R 2 0,023

16

Resultados

O efeito de fumar é relativamente menor quando a

renda familiar é adicionada na regressão, mas a

diferença não é grande.

Isto decorre do fato de faminc e cigs não serem muito

correlacionados e do coeficente de faminc ser

praticamente pequeno. (A variável faminc está em

milhares, logo, R$10,000 a mais aumenta o peso de

nascimento somente em 0,93 quilos).

Corr(faminc, cigs)=-0,173

17

Viés de variável omitida

A variável omitida é faminc

Espera-se que o efeito de faminc sobre o peso

de nascimento seja positivo (β2>0)

Corr(faminc, cigs)=-0,173

O coeficiente passou de -0,463 para -0,513.

cov(x1, x2 )

E (b1) 1

. 2

var(x1)

18

Direção do viés

Corr(x1, x2) > 0 Corr(x1, x2) < 0

2 > 0

Viés positivo

Viés negativo

2 < 0

Viés negativo

Viés positivo

19

Outro exemplo prático

Suponha que o modelo verdadeiro seja dado por

lwage 0 1educ 2 IQ u , mas que

~

~

estimamoslwage 0 1educ v

~

Onde da regressão de IQ em educ, achamos 1 :

~ ~

IQ 0 1educ

20

Outro exemplo prático

Modelo 1: Estimativas OLS usando as 935 observações 1-935

Variável dependente: IQ

Variável

const

educ

Coeficiente

53,6872

3,53383

Erro Padrão estatística-t

2,62293

20,4684

0,19221

18,3853

Média da variável dependente = 101,282

Desvio padrão da variável dependente = 15,0526

Soma dos resíduos quadrados = 155347

Erro padrão dos resíduos = 12,9036

R2 não-ajustado = 0,265943

R2 ajustado = 0,265157

Graus de liberdade = 933

21

p-valor

<0,00001

<0,00001

~

1

***

***

Outro exemplo prático

Modelo 3: Estimativas OLS usando as 935 observações 1-935

Variável dependente: lwage

Variável

const

educ

Coeficiente

5,97306

0,0598392

Erro Padrão estatística-t

0,0813737

73,4029

0,00596309

10,0349

Média da variável dependente = 6,779

Desvio padrão da variável dependente = 0,421144

Soma dos resíduos quadrados = 149,519

Erro padrão dos resíduos = 0,40032

R2 não-ajustado = 0,0974168

R2 ajustado = 0,0964494

Graus de liberdade = 933

22

p-valor

<0,00001

<0,00001

~

1

***

***

Outro exemplo prático

Modelo 4: Estimativas OLS usando as 935 observações 1-935

Variável dependente: lwage

Variável

const

educ

IQ

Coeficiente Erro Padrão estatística-t

5,65829

0,0962408

58,7930

0,0391199 0,00683821

5,7208

0,00586313 0,00099791

5,8754

Média da variável dependente = 6,779

Desvio padrão da variável dependente = 0,421144

Soma dos resíduos quadrados = 144,178

Erro padrão dos resíduos = 0,393316

R2 não-ajustado = 0,129654

R2 ajustado = 0,127786

Estatística-F (2, 932) = 69,4191 (p-valor < 0,00001)

23

p-valor

<0,00001

<0,00001

<0,00001

***

***

***

Direção do viés

Corr(x1, x2) > 0 Corr(x1, x2) < 0

2 > 0

Viés positivo

Viés negativo

2 < 0

Viés negativo

Viés positivo

24

Variância do Estimador MQO

Hipóteses sobres os distúrbios:

i tem média zero e não é correlacionado com

qualquer outro elemento j

Var[i|X] = 2. A variância de i não depende

do dado da amostra. Não depende de X.

1 2

2 0

Var

|X

... 0

n 0

0

2

0

0

0

0

2I

0

2

...

...

...

Variância do Estimador MQO

1 2

0

Var 2 | X

... 0

n 0

0

2

0

0

0

... 0

2I

0

... 2

...

1

1

1

2

2

2

Var

E Var

| X Var E

|X

...

...

...

n

n

n

0

0

E 2I Var = 2I.

...

0

Variância do Estimador MQO

b ( X'X)1 X'y

= ( X'X) 1 X'(X + ) = ( X'X ) 1 X'

E[b|X]= ( X'X) 1 X'E[ | X] = as E[ | X] = 0

Var[b | X] E[(b )(b ) ' | X]

= ( X'X)1 X'E[ ' | X] X( X'X) 1

= ( X'X)1 X'2I X( X'X)1

= 2 ( X'X)1 X'I X( X'X)1

= 2 ( X'X)1 X'X( X'X)1

= 2 ( X'X)1

Erros de especificação

Omitindo variáveis relevantes: Suponha que o modelo

correto é

y = X11 + X22 + .

Computar MQO omitindo X2. É fácil provar que:

Var[b1] é menor que a Var[b1.2].

Temos uma menor variância quando omitimos X2.

(Omitindo X2 , 2 = 0 posso usar mais informação

extra para estimação). Mesmo que a informação não

seja correta, reduz a variância.

Erro de especificação

(Não há almoço grátis!!) E[b1] = 1 + (X1X1)-1X1X22

1. Desta forma, b1 é viesado.(!!!)

O viés pode reverter até o sinal do coeficiente.

b1 deve ser mais preciso

A variância é menor contudo o viés é positivo. Se o viés é

pequeno se favorece a regressão mais simples.

Suponha X1X2 = 0. Viés vai embora

A informação não está correta, é irrelevante.

b1 é igual a b1.2.

Erro de especificação: Inclusão de

variável irrelevante

Os resultados são contrários aos encontrados

acima.

Inserir resultados supérfluos aumenta a variância.

(reduz precisão)

Não causa viés, se X2 é supérflua, 2 = 0, e

E[b1.2] = 1.

Teorema de Gauss-Markov

O EMQO é o melhor estimador linear dentro da classe de

estimadores lineares não viesados.

n

1. Estimador linear =

v

2.

i1

i i

Não viesado: E[b|X] = β

Teorema: Var[b*|X] – Var[b|X] é uma matriz definida

não negativa para qualquer outro estimador linear não

viesado b* que não seja igual a b.

Definição: b é eficiente na classe de estimadores.

Teorema de Gauss-Markov

Resultado geral para a classe de estimadores lineares e

não viesados

b* Cy

E (Cy / X ) CX CE ( / X ) (para não ter viés)

CX

Desta forma: CX I

Existemvárioscandidatospara C. Suponha que C é formadopelas

k primeiraslinhaslinearmente independentes de X e C X -01

Teorema de Gauss-Markov

Como achar a Matriz de variância-covariância de b ?

*

var(b * / X ) E[(b * )(b * )´/ X ]

Lembreque : CX I e b* Cy C ( X ) C

E[(b * )(b * )´/ X ] E[(C )(C )´/ X ]

CE ( ´/ X )C´ 2CC´

C ( X ´ X ) 1 X ´ D

Cy ( X ´ X ) 1 X ´ y Dy

b * b Dy

Teorema de Gauss-Markov

var(b * / X ) 2CC´ 2 [(D ( X ´ X ) 1 X ´)(D ( X ´ X ) 1 X ´)´]

(lembreque CX I DX ( X ´ X ) 1 X ´ X DX I , logo DX será igual a zero)

var(b * / X ) 2 DD´ 2 ( X ´ X ) 1

var(b * / X ) var(b / X ) 2 DD´

Como D é uma matriz definida não negativa, temos que a

var(b*/x) é sempre maior que a var(b/x).

Fixar X ou Condicionar em X?

O papel da hipótese dos regressores não

estocásticos,

Incondicional: Tomar a média em torno de X:

var(b) E x [var(b / X )] Varx [ E (b / X )] 2 E x [( X ´ X )1]

var(b / X ) var(b0 / X ) para qq b b0 e para um X específico.

Logo, se isto vale para um X particular, temosque :

var(b) E x (var(b / X )) isto tambémvalerá para um valor médiode X

Os resultados valem para X estocástico bem como

para X não estocástico.

Econometria

2. Estimação da Variância do estimador de MQO

Contexto

A variância verdadeira de b é 2E[(XX)-1]

Como usamos os dados da amostra para

estimar esta matriz?

Como queremos formar intervalos de confiança

das estimativas da regressão bem como

formular hipóteses, temos que ter estimativas

da variabilidade da distribuição.

Estimando 2

Usaremos os resíduos ao invés dos distúrbios:

Análogo amostral: ee/n para /n

Observação imperfeita de i

Viés para baixo de ee/n.

E[ee] = (n-K)2

= ei + ( - b)xi

Esperança de e’e

e y - Xb

y X ( X ' X ) 1 X ' y

[I X ( X ' X ) 1 X ']y

My M( X ) MX M M

e'e (M'(M

'M'M 'MM 'M

Valor esperado do quadrado dos

resíduos

E[e'e|X ] 'M |X

E[ trace ('M |X ) ] scalar = its trace

E[ trace (M'|X ) ] permute in trace

[ trace E (M'|X) ] linear operators

[ trace M E ('|X ) ] conditioned on X

Traço:

soma dos

elementos

da

diagonal

[ trace M 2I ] model assumption

2 [trace M ] scalar multiplication and I matrix

2 trace [I - X ( X'X )-1 X' ]

2 {trace [I] - trace[X (X'X )-1 X' ]}

2 {n - trace[( X'X )-1 X'X ]} permute in trace

2 {n - trace[I]}

2 {n - K}

Estimando σ2

O estimador não viesado é s2 = ee/(n-K).

s2 = ee/(n-K) = M/(n-K).

Est [Var (b/X)] = s2 [(XX)-1

“Erro padrão” de coeficiente individual é a raiz

quadrada do elemento da diagonal.

X’X

(X’X)-1

s2(X’X)-1

---------------------------------------------------------------------Ordinary

least squares regression ........

LHS=G

Mean

= 226.09444

Standard deviation

=

50.59182

Number of observs.

=

36

Model size

Parameters

=

7

Degrees of freedom

=

29

Residuals

Sum of squares

= 778.70227

Standard error of e =

5.18187 <= sqr[778.70227/(36 – 7)]

Fit

R-squared

=

.99131

Adjusted R-squared

=

.98951

--------+------------------------------------------------------------Variable| Coefficient

Standard Error t-ratio P[|T|>t]

Mean of X

--------+------------------------------------------------------------Constant|

-7.73975

49.95915

-.155

.8780

PG|

-15.3008***

2.42171

-6.318

.0000

2.31661

Y|

.02365***

.00779

3.037

.0050

9232.86

TREND|

4.14359**

1.91513

2.164

.0389

17.5000

PNC|

15.4387

15.21899

1.014

.3188

1.67078

PUC|

-5.63438

5.02666

-1.121

.2715

2.34364

PPT|

-12.4378**

5.20697

-2.389

.0236

2.74486

--------+-------------------------------------------------------------

Download