Nuclear Expert Web Mining System Monitoring and Analysis of Nuclear Acceptance by Information Retrieval and Opinion Extraction on the Internet Thiago Reis Antonio C. O. Barroso Kengo Imakuma Contents Introduction Methodology Methodological Framework Mining Algorithm Performance Evaluation xxx Conclusions Introduction Introduction Although nuclear energy is a well-established method in many countries, the "nuclear theme" often raises major concerns in the population. Public opinion can influence institutions and governments decisions with respect to nuclear development. Nuclear Energy Public Acceptance Influence Decisions Introduction Recently, the Fukushima Dai-ichi nuclear power plant accident evidenced this fact. Many people over the world expressed their views and opinions about the nuclear energy. Introduction These manifestations were especially observed and massively registered in web pages, blogs, forums, and social networking web sites on the Internet. Thus creating a valuable information repository about public opinion. Introduction However, due to the characteristics of the Internet information basis, finding and collecting relevant information, and especially monitoring opinion sources, in a large-scale manner, are nontrivial tasks. Heterogeneous Colaborative Dinamic Internet Multicultural Noisy Introduction This presents both great challenges and opportunities for mining the Internet information from its unstructured and noisy data. Efforts and techniques directed to these problems are usually referred as pertaining to a new research field called Web Mining. Introduction We present a research initiative that aims to collect nuclear related information and to analyze opinionated texts by mining the hypertextual data environment and social networks web sites on the Internet. Nuclear Acceptance Research Initiative Internet Introduction Instead of using traditional statistical techniques, it is proposed a novel Web Mining approach, built around the concept of Expert Systems, for massive and autonomous data collection and analysis. Firstly we have designed a framework capable of supporting the identified needs and goals. This framework represents the initial methodological approach. Methodology Methodology This framework was designed to support and integrate four main Web Mining tasks: Web crawling task Webpage topic identification to decide whether a webpage contains information related to the nuclear domain; Webpage opinion identification regarding to search and collect webpages by browsing the hypertextual web graph; to the decide whether a webpage text presents an opinionated content; Webpage opinion polarity task regarding to the identification if the opinionated text is positive, negative or neutral. Methodology An adaptation of the focused web crawling algorithm called InfoSpider was chosen as the basis method to accomplish the Web crawling and Webpage topic identification tasks. The OpinionObserver algorithm is used as the basis method to accomplish the Webpage opinion identification and Webpage opinion polarity tasks. Methodological Framework The basic data unit in this framework is the webpage. There are three major elements that use as feedstock the webpage data unit and manipulate the graph data structure: the Internet; the Nuclear Experts; and the Expert System. Método Justificativa E, por fim, sendo uma pesquisa singular na intersecção dos campos de Web Mining, Inteligência Artificial e Aceitação Nuclear, contribuindo para o desenvolvimento destes campos. Área Nuclear Proposta Trabalho Inteligência Artificial Web Mining Método Os métodos oriundos de Web Mining e das suas disciplinas interrelacionadas podem ser integrados em uma variedade de combinações para a condução de uma solução ao problema apresentado. Método Logo, é proposta uma opção que se concentra nos métodos que possuem: o maior grau de desenvolvimento até a atualidade, considerados o "estado da arte" em seus campos de estudo, em conjunto de uma arquitetura de sistema computacional que possa ter suas funções estendidas para a junção posterior de técnicas de Opinion Mining, fornecendo os alicerces para trabalhos futuros. Método Este métodos serão implementados dentro de uma arquitetura computacional baseada nos fundamentos de um Expert System devido a necessidade de: um conhecimento léxico profundo, estruturado e extensível da área nuclear, obtido de especialistas nucleares, para a inferência computacional e avaliação autônoma da relevância da informação coletada. Procedimento Metodológico Nesta arquitetura existem três grandes componentes que interagem no processo de recuperação de informação: (1) a Internet, que contem informações inter-relacionadas e altamente distribuídas, provendo o sistema com dados para o processamento; (2) os especialistas no domínio, que provêem o sistema com a base de conhecimento terminológica como também realizam o feedback do processamento como meio de aprendizado supervisionado; e (3) o Sistema Especialista, responsável por integrar a Base de Conhecimento, o Mecanismo de Inferência, o Focused Web Crawler e o Banco de Dados. Procedimento Metodológico Internet Especialistas Sistema especialista de webcrawling Mecanismo de persistência Avaliação de relevância Relevância da página (Cosine Similarity) Repositório de páginas Focused webcrawling agent Termos ponderados Coletor HTTP Vetor de links HTML Parser Links relevantes Fronteira de busca (estratégia best-nfisrt) L1 . L2 Repositório de metadados NLP L3 Ln Coletor links Base de conhecimento Mecanismo de inferência Rede neural artificial Páginas relevantes Vetor de termos X0 X1 W1 X2 W2 W0 T1 Taxonomia nuclear T2 T3 ? X3 W3 Xn Wn Tn tanh() Y Aprendizado por retro propagação do erro Procedimento Metodológico Nesta abordagem, o principal “componente” do sistema são os especialistas, onde eles: irão prover o sistema com o conhecimento léxico da área nuclear e possuirão o papel de “tutores” do sistema, efetuando feedbacks sobre a relevância da informação coletada. Procedimento Metodológico Internamente no sistema, a Base de Conhecimento contem as heurísticas necessárias para o processo de inferência. Estas heurísticas são extraídas do conhecimento e experiência dos especialistas da área nuclear. A Base de Conhecimento é estruturada na forma de uma taxonomia prática dos assuntos da área nuclear. Procedimento Metodológico Os termos de busca utilizados no Mecanismo de Inferência e no Focused Web Crawler são extraídos da taxonomia prática. Estes termos representam o conhecimento dos especialistas de quais palavras-chave melhor discriminam os documentos relevantes dos não relevantes. São associados a um número real, de 0 à 1, que representa a importância do termo. Estes pesos são utilizados para a iniciação dos pesos sinápticos da RNA, discutido adiante. Procedimento Metodológico A Base de Conhecimento será modelada por meio de consultas e entrevistas com especialistas no domínio nuclear, de acordo com o processo de aquisição de conhecimento. Dados, problemas, questões Especialista Especialista do domínio do domínio Engenharia do Engenharia do conhecimento conhecimento Conhecimentos, conceitos, soluções Conhecimento estruturado e formalizado Base de conhecimento Procedimento Metodológico O processo de modelagem da Base de Conhecimento é um ponto crítico para o sucesso do sistema, pois todo o conhecimento a priori do domínio do problema estará contido nela. Procedimento Metodológico Além de uma Base de Conhecimento, um Expert System deve possuir um Mecanismo de Inferência que simule a capacidade de julgamento de um especialista em uma determinada tarefa. O Mecanismo de Inferência e o Focused Web Crawler adotados são uma adaptação do conceituado sistema de Adaptive Focused Web Crawling denominado InfoSpider. Procedimento Metodológico O Mecanismo de Inferência é uma feedforward RNA formada por um perceptron de uma única camada. Ela possui como entrada um vetor de termos e sua saída é um coeficiente que representa a relevância estimada do documento-alvo. Mecanismo de inferência Rede neural artificial X0 X1 W1 X2 W2 X3 W3 Xn Wn W0 ∑ tanh() Y Aprendizado por retro propagação do erro Procedimento Metodológico Especificamente, para cada hiperlink contido em um determinado documento recuperado, cada entrada da RNA é computada através da contagem das palavras do documento recuperado que correspondem aos termos existentes no vetor de termos, onde cada termo do vetor de termos, por sua vez, corresponde a um determinado nó de entrada da RNA. Procedimento Metodológico Esta contagem é ponderada por pesos que decaem com o aumento da distância do termo em relação ao hiperlink em questão, dentro de uma janela de tamanho p. Para cada hiperlink l e cada termo k, a RNA recebe como entrada: Procedimento Metodológico Onde ki é a i-ésima ocorrência do termo k no documento D e dist(ki, l) é a contagem dos hiperlinks existentes entre ki e l (incluindo l e até no máximo de p hiperlinks de distância). Procedimento Metodológico A saída da RNA é o coeficiente que representa a relevância estimada do documento-alvo e é computada através da função de ativação tanh (tangente hiperbólica), logo sua saída é um número real no intervalo de -1 à 1. A função tanh é adotada, pois pode modelar tanto uma correspondência positiva quanto negativa entre os termos de entrada e a relevância estimada de um documento. Procedimento Metodológico A saída da RNA é a primeira estimação da relevância do documento. Após o documento-alvo ser recuperado, é executada uma segunda estimativa da sua relevância, utilizando os termos contidos nele e que anteriormente eram desconhecidos, através da computação da função de Cosine Similarity: Procedimento Metodológico Onde q é o termo, p é o documento e fkd é a freqüência do termo k em d. O resultado da função de Cosine Similarity é utilizado como sinal de reforço do ambiente e valor esperado de saída da RNA para o cálculo do erro e execução on-line do algoritmo de aprendizado backpropagation, assim constituindo um aprendizado por reforço. O Feedback de Relevância feito sob orientação dos especialistas também é utilizado no aprendizado da RNA, constituindo um aprendizado supervisionado, neste caso. A ponderação dos termos da taxonomia prática existente na Base de Conhecimento é utilizada para iniciar os pesos sinápticos da RNA. Procedimento Metodológico O Focused Web Crawler é o componente responsável por coletar as informações na Internet, “navegando” através do grafo formado pelos documentos e seus hiperlinks. Para este fim, o Focused Web Crawler implementa um algoritmo de busca que define a forma pela qual os documentos serão “visitados”. Neste trabalho, o algoritmo de busca a ser utilizado é o BestN-First. Procedimento Metodológico O processo de busca do algoritmo Best-N-First (fig. b) é utilizado pelos Focused Web Crawler que visam procurar e coletar somente documentos relevantes para um determinado tópico, executando uma busca heurística Estratégias de busca tradicionais empregam o algoritmo BreadthFirst (fig. a) como o objetivo de recuperar documentos independentemente do seu conteúdo, executando uma busca exaustiva. Procedimento Metodológico O algoritmo Best-N-First e a contagem ponderada dos termos no documento para a entrada da RNA se valem do Topical Locality como heurística no processo de busca. Além disto, a Base de Conhecimento conterá uma pequena coleção de documentos previamente identificados como relevantes e que logo serão os pontos iniciais das buscas dentro dos clusters de documentos relacionados à área nuclear. Procedimento Metodológico Adicionalmente, no processo de Web Crawling é necessário a utilização de técnicas de NLP para o préprocessamento e “limpeza” do texto extraído dos documentos da Internet. Para este fim, serão utilizadas técnicas de Stemming, para a transformação das palavras para a sua forma raiz, e Stopword Removal, para exclusão de palavras sem relevância semântica do texto. Estas técnicas também serão aplicadas no vetor de termos extraído da Base de Conhecimento. Procedimento Metodológico O Mecanismo de Persistência utilizado é um banco de dados relacional, integrado ao Sistema Especialista de Web Crawling, que possui a função de armazenar o conteúdo coletado da Internet como também os metadados gerados no processo (como a estrutura do grafo dos documentos coletados, coeficiente de relevância dos documentos, pesos sinápticos da RNA, etc) serão armazenados para posteriores avaliações. Procedimento Metodológico Nesta arquitetura, os sub-componentes do Sistema Especialista de Web Crawling podem ser alterados independentemente de modo a refinar os resultados das buscas de informação, como: refinamento da taxonomia contida na base de conhecimento, adição de outros métodos de inferência além da RNA (classificador bayesiano, máquinas de suporte vetorial), adição de outros algoritmos de busca no Focused Web Crawler. Além disto, as técnicas e algoritmos de NLP podem ser alterados para o processamento de outras línguas alem da língua inglesa. Procedimento Metodológico Esta proposta de arquitetura visa atingir os objetivos definidos para este trabalho onde, em resumo: A Base de Conhecimento concede ao sistema um conhecimento léxico especializado na área nuclear e, juntamente com o Mecanismo de Inferência, habilita o sistema a atuar de forma autônoma e adaptável. O Focused Web Crawler em conjunto com o Mecanismo de Persistência concedem ao sistema a capacidade de efetuar buscas recorrentes e escaláveis, armazenando os documentos coletados a cada nova busca. Avaliação de Resultados O processo de avaliação e ajustes será conduzido de acordo com as seguintes etapas: Execução de uma busca a partir de um ponto inicial (documento existente na Base de Conhecimento) que recupere uma quantidade significante de documentos; Feedback de Relevância do sistema, orientado pelos especialistas, dos documentos relevantes e não relevantes recuperados; Avaliação dos parâmetros utilizados no processo de busca e ajustes, se necessário; Calculo de métricas de desempenho; Documentação dos resultados e execução de uma nova avaliação, se necessário. Avaliação de Resultados Este processo de avaliação e ajustes deverá ser re-executado até ponto em que as métricas de desempenho estejam satisfatórias. Avaliação de Resultados A principal métrica para a avaliação de desempenho é o Precision. Esta métrica corresponde à fração de documentos recuperados que são relevantes. Avaliação de Resultados Outra métrica de desempenho é o Recall, sendo ela a fração de documentos relevantes que foram recuperados do total de documentos relevantes. Avaliação de Resultados A Base de Conhecimento poderá ser ajustada, sob a orientação dos especialistas, para compor novos termos que se verificarem importantes e novos pontos iniciais de busca. A RNA será ajustada, por meio de aprendizado supervisionado, através do Feedback de Relevância, também orientado pelos especialistas. Cronograma Cronograma Atividades Modelagem da taxonomia prática Desenvolvimento do sistema Avaliação e ajustes do sistema Obtenção de créditos em disciplinas Seminários de área Publicação de artigo Redação da dissertação Defesa da dissertação 1 2 3 4 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 1 2 3 4 5 6 1 2 3 4 5 6 7 8 1 2 3 1 2 3 1 2 3 dez/12 nov/12 out/12 set/12 ago/12 jul/12 jun/12 mai/12 abr/12 mar/12 fev/12 jan/12 dez/11 nov/11 out/11 set/11 ago/11 A seguir está a proposta de cronograma para o desenvolvimento do trabalho até a conclusão e defesa da dissertação. Este cronograma contempla dezoito meses de atividades. Deve-se considerar que essa proposta de trabalho já está em andamento desde o início do ano de 2010, tendo o candidato já feito vários cursos como ouvinte e estudado o problema com bastante profundidade. Isto faz com que o prazo proposto seja bem realista. jul/11 1 Obrigado! Mestrado TNA Aluno: Thiago Reis Orientador: Prof. Dr. Antonio Barroso Método Extensibilidade Internet World Wide Web (html) Social Web (twitter/facebook/youtube) Semantic Web Experts Knowledge Base Taxonomy Ontology Lexical Database (wordnet/sentiwordnet) Inference Engine Information Retrieval Retrieval Models Artificial Neural Networks Naive Bayesian Classifiers Suport Vector Machines Opinion Extraction Web Crawler Exhaustive Algorithm Heuristic Algorithm Persistence Engine Relational Database Document Warehouse Graph Database NoSQL Database Fundamentação Teórica Estatística Web Mining é um campo da Ciência da Computação Recuperação de Informação Internet com o objetivo de extrair padrões de grandes bancos de dados (Internet) pela combinação de métodos de Web Mining Análise de Redes Sociais relativamente novo e interdisciplinar Inteligência Artificial Data Mining Data Mining, Estatística, Inteligência Artificial, Análise de Redes Sociais Recuperação de Informação. Fundamentação Teórica Web Mining Structure Mining •Estrutura hipertexto/dom •Grafo •Páginas relevantes/ relações sociais •Teoria dos grafos/análise de redes sociais Content Mining Usage Mining •Conteúdo hipertexto •Texto natural •Páginas relevantes/ extração de informação •Text mining/NLP/IR •Logs de servidores •Dados tabulares •Padrões de utilização •Data mining Nuclear Web Mining Como coletar e processar estes dados? Data Mining Estatística Field of computer science And is the process of Inteligência Artificial Banco de Dados relatively young and interdisciplinary extracting patterns from large data sets by combining methods from statistics, artificial intelligence and database management Web Mining Estatística Recuperação de Informação Internet Análise de Redes Sociais Inteligência Artificial Is the application of data mining techniques to discover patterns from the Web According to analysis targets, web mining can be divided into Web usage mining, Web content mining and Web structure mining Opinion Mining Processamento de Linguagem Natural Identify and extract subjective information Using natural language processing, computational linguistics, and text analytics Lingüística Computacional Mineração de Texto To determine the attitude of a speaker or a writer judgment or evaluation affective state intended emotional communication Proposta de Pesquisa

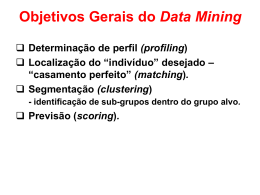

Download