CURSO DE EXTENSÃO EM MATEMÁTICA

INTRODUÇÃO À

ESTATÍSTICA

LUIS PAULO VIEIRA BRAGA

2008

Fundação CECIERJ / Consórcio CEDERJ

SUMÁRIO

Aula 1- Incerteza, dados, informação e modelos

Aula 2- População, censo e amostras

Aula 3- Estatísticas de tendência central

Aula 4- Estatísticas de ordem

Aula 5- Estatísticas de dispersão e de associação

Aula 6- Números-índice

Aula 7- Breve revisão de teoria das probabilidades

Aula 8- Estimadores

Aula 9- Teorema central do limite e aplicações

Aula 10- Testes de hipóteses

int_estatistica_aula7

2

Aula 7

7.1 Objetivo

Breve revisão da teoria das probabilidades

Apresentar o conceito de probabilidade e suas principais propriedades. Introduzir o

conceito de variável aleatória e vetor aleatório.

7.2 Introdução

Vimos anteriormente que a incerteza sobre muitos aspectos da realidade motivou o

desenvolvimento da estatística como um método para orientar decisões e resolver problemas. A

estatística se baseia no conceito de acaso, ou aleatoriedade, que é um conceito abstrato, uma

opção metodológica. Um modelo estatístico não está, necessariamente, imputando a aleatoriedade

como uma propriedade do fenômeno em estudo. A objetividade ou não do acaso é uma discussão

de natureza filosófico-científica.

Aristóteles, 385-322 a.C., o célebre autor do Organom, classificava os eventos em três

tipos :

1) eventos certos que acontecem necessariamente

2) eventos prováveis que acontecem na maioria dos casos

3) eventos imprevisíveis, que acontecem por acaso

Em Tomás de Aquino, 1225-1274, a onisciência de Deus não se resume ao conhecimento

dos fatos reais (passados, presentes e futuros), mas de todos os fatos possíveis. Ou seja, conhece

tudo o que teria se passado se determinada condição fosse diferente.

Para Hume, 1711-1776, o acaso não existe de fato, mas a ignorância sobre a causa de

qualquer evento teria efeito semelhante sobre a compreensão do mundo real, gerando uma

espécie de crença ou opinião sobre os eventos.

Para a tradição clássica elaborada por Fermat, 1601-1665 , Pascal, 1623 -1662, Huygens,

1629-1695, e James Bernoulli, 1654-1705, o conceito de evento aleatório está associado à

imprevisibilidade de ocorrência do evento, mesmo que as condições nas quais ele ocorre pareçam

as mesmas. Para estes eventos, supõe-se a existência de um experimento que ao ser executado

sob condições experimentalmente indistinguíveis, produz resultados imprevisivelmente diferentes.

Evento aleatório é um conjunto definido no contexto de um experimento aleatório, cuja ocorrência

pode ser verdadeira ou não. Von Mises, 1883-1953, estabeleceu a hipótese de que o experimento

poderia ser executado infinitamente, base para o enfoque frequencista. Eventos singulares não

estão incluídos nesta categoria.

Na primeira metade do século XX, Albert Einstein, 1879 - 1955 , discordou do caráter

aleatório da Teoria Quântica proposta por Werner Heisenberg, Paul Dirac, e Erwin Schrödinger. É

de Einstein a famosa frase – Deus não joga dados !, retomando-se assim a controvérsia sobre o

caráter objetivo ou não dos eventos aleatórios. Para ele, embora a teoria quântica representasse a

melhor formulação dos fenômenos atômicos, não acreditava que se pudesse evoluir muito a partir

dela, almejando restaurar o determinismo e a causalidade na física. Crendo, assim, que existe uma

teoria que represente realisticamente os eventos e não apenas a probabilidade de seu

aparecimento.

Ernest Mach, 1838-1916, físico e integrante do Círculo de Viena – núcleo de filósofos,

matemáticos e lógicos - que foi relevante para a renovação do pensamento científico do século XX

– realçou o caráter relativo do conhecimento científico, abandonando a busca da essência ou

causas finais dos fenômenos. Para ele, o objetivo da ciência é descobrir as relações entre os

fenômenos. Um de seus discípulos, Bruno de Finetti, 1906 -1985, apoiando-se nas idéias de

Thomas Bayes, 1701-1761, as quais tornaram-se conhecidas graças a Richard Price, 1723-1791,

elaborou uma teoria probabilística e um método de inferência – a inferência bayesiana. Para De

Finetti, um evento é um caso único que ocorreu ou vai ocorrer, ou ainda não ocorreu, nem vai

ocorrer. Para ele, é somente isto que pode ser observado, não havendo espaço para nenhuma

outra noção. A um nível de informação (para um indivíduo, ou coletividade) um evento pode ser

certo, possível ou impossível.

int_estatistica_aula7

3

George Matheron, 1930-2000, engenheiro, da Escola de Minas de Paris, que desenvolveu

importantes aplicações da teoria das funções aleatórias a problemas no espaço n-dimensional, ao

se referir à aleatoriedade dos fenômenos, prefere dizer que tudo se passa como se o fenômeno

fosse devido ao acaso. Mas se recusa a admitir que o acaso tenha uma ação decisiva sobre o

curso dos eventos. Rejeitando, assim, que a evolução genética, por exemplo, pudesse ser

explicada pela força do acaso. Identificar a incerteza sobre determinado evento com a

aleatoriedade é um equívoco comum, mesmo em exemplos típicos de livros introdutórios sobre

probabilidade, como os jogos de dados ou roleta. Pois se dispuséssemos de todos as condições

iniciais, assim como os modelos dinâmicos, poderíamos prever o resultado do jogo. Os jogos de

azar que motivaram, no século XVI, as primeiras fórmulas do cálculo de probabilidades, são

abstrações da realidade. Matheron prefere falar de modelo probabilístico e de sua correspondência

objetiva. Por outro lado, ainda que a repetição de um experimento, rigorosamente, não consiga

gerar exatamente os mesmos eventos, a diferença entre estes eventos é mínima, de medida nula

se utilizarmos a linguagem da teoria da medida. Portanto, a idéia de repetibilidade pode se aplicar,

contrariando assim a exclusividade de cada evento observado, que municia a argumentação do

enfoque Bayesiano.

Karl Popper, 1902-1994, tem uma importante contribuição para a definição de objetividade

de um enunciado científico. Desdobrando-os em singulares e universais. Os enunciados singulares

referem-se a eventos particulares cuja ocorrência pode ser comprovada ou não. Os enunciados

universais, por outro lado, referem-se a eventos cuja comprovação exigiria infinitas experiências ou

observações – leis da física, por exemplo, mas, ao contrário de um evento metafísico, pode, a

qualquer momento, ser desmentido por uma experiência, ou corroborado por ela. A linha de

demarcação entre os enunciados metafísicos e os objetivos ou empíricos é o critério de

falseabilidade, segundo o qual os enunciados científicos são aqueles que podem ser submetidos à

verificação. Neste sentido a objetividade é um conceito operatório – regular, reproduzível e

mensurável segundo uma escala.

No leste europeu e na União Soviética, o materialismo dialético inspirou o pensamento

científico até a dissolução do regime. Andrei Nikolaevich Kolmogorov, 1903-1987, de origem

humilde, chegou à Universidade de Moscou em 1920 aonde passou boa parte de sua carreira,

sendo considerado um dos maiores matemáticos e probabilistas do século XX. Concebeu uma

formulação matemática para a noção de evento e de probabilidade baseada na teoria da medida .

Esta formulação é consensual tanto para estatísticos objetivistas como subjetivistas. A formulação

matemática para a teoria das probabilidades é considerada também como a única teoria adequada

para tratar a incerteza, em oposição a outros métodos matemáticos e computacionais, como é o

caso da matemática nebulosa (fuzzy). Os princípios sobre os quais a teoria das probabilidades foi

edificada remontam a Galileu (1564-1642), que, embora, não se dedicando a esta teoria, formulou

sua essência. São eles a fórmula clássica para a probabilidade, os princípios da soma e do

produto, e a idéia de convergência.

7.3 Espaço de Probabilidade

Kolmogorov concebeu o conceito de espaço de probabilidade que é constituído do espaço

amostral (não confundir com amostra), de uma sigma álgebra de eventos e da função

probabilidade.

Definição 7.1 Evento é um membro de uma coleção de subconjuntos de um conjunto

denominado espaço amostral Ω, que tem a estrutura de uma σ-álgebra F.

Definição 7.2 Espaço amostral é a coleção dos resultados possíveis, numéricos ou não, da

realização de um experimento ou observação.

Definição 7.3 σ-álgebra é uma coleção de subconjuntos de Ω que satisfazem às propriedades

seguintes:

int_estatistica_aula7

4

i)

A, B ∈ X ⇒ A ∩ B ∈ X

ii ) A ∈ X ⇒ Ac ∈ X

∞

iii ) Ai ∈ X , i = 1, ∞ ⇒ U Ai ∈ X

i =1

Esta conceituação permitiu tratar espaços amostrais finitos ou infinitos, enumeráveis ou

não. Por exemplo, se o experimento consiste em registrar o instante em que determinado

componente falha, o espaço amostral consiste no intervalo real [0, a) aonde a representa um

valor razoável para a vida útil máxima do componente. A construção da σ-álgebra é feita em duas

etapas, na primeira supõe-se uma lista de resultados possíveis associados à execução do

experimento (espaço amostral). Em seguida, através de operações de complementaridade, de

interseção e de união destes conjuntos são obtidos os demais eventos, cuja ocorrência pode ser

verificada em função da ocorrência ou não dos eventos da lista inicial, a qual é denominada

espaço amostral. A generalidade da definição abarca tanto o conceito bayesiano, como o clássico

e o frequencista de evento, passando a ser condição necessária para a construção de uma teoria

das probabilidades coerente. Um caso particular de sigma-álgebra de extrema importância para a

teoria das probabilidades é a sigma-álgebra de Borel, que é a menor sigma-álgebra que contem

todos os abertos e fechados na reta real. Falta definir matematicamente a função probabilidade, o

que vai depender do experimento que está sendo analisado. No entanto, Kolmogorov precisou qual

o conjunto de propriedades que uma função deve satisfazer para ser considerada uma

probabilidade.

O marco histórico da abordagem clássica é um pequeno ensaio escrito por Galileu Galilei

em 1620 sobre quais somas são mais comuns em um jogo com três dados. Os jogadores

profissionais acreditavam que eram 10 e 11, mas não tinham provas disto. Embora o problema

fosse trivial que Galileu resolveu em quatro páginas, deste ensaio depreendem-se os princípios

fundamentais que sempre nortearam o desenvolvimento da teoria das probabilidades :

Na abordagem clássica, ou Laplaceana, a probabilidade (numérica) de um evento é o

quociente entre os casos favoráveis e os casos possíveis. Utilizando a notação para eventos

introduzida no capítulo anterior, neste caso o espaço amostral Ω, ver definição 7.2 , é finito e

discreto, e os resultados do experimento têm a mesma propensão a ocorrer, sendo a σ- álgebra

de eventos, definição 7.3, o conjunto das partes de Ω. Então a probabilidade de um evento é

definida por uma função que a cada evento associa um número:

Definição 7.4 Definição clássica de probabilidade

P( A) =

#A

;

#Ω

A⊆Ω

Aonde # é a cardinalidade do conjunto.

A motivação para esta definição é óbvia e pode ser facilmente verificada nos experimentos

relacionados a jogos de azar tais como dados, roleta, baralho, etc...A coerência da definição é

ainda assegurada pelo fato de que a imagem inversa de quaisquer subconjuntos de números

inteiros corresponde a um subconjunto do espaço amostral.

Exemplo 7.1 Combinatória e contagem

A definição clássica de probabilidade supõe que os resultados do experimento tenham

igual chance e que o número de resultados possíveis seja finito. Daí é óbvia a conclusão de que a

probabilidade de sortear uma determinada face no lançamento de um dado seja igual a 1/6, porém

para calcular a probabilidade de um evento A mais complexo a contagem dos elementos de A

requer, em muitos casos, a ajuda da combinatória. Vimos na aula 2 a importância da amostragem

para levantar informações sobre uma dada população, suponha uma população finita com N

5

elementos, da qual vai se sortear um número finito de k elementos para constituir uma amostra.

Quantas amostras diferentes podem ser construídas em cada caso ? Em cada caso a resposta é

dada respectivamente pelas fórmulas de arranjos com repetição de N elementos k a k ,

combinações com repetição de N elementos k a k, arranjos de N elementos k a k e combinações

de N elementos k a k.

ordem importa : N k

%

N + k − 1

com reposiçao

% importa :

ordem nao

k

amostragem

N!

ordem importa : ( N − k )!

sem reposiçao

%

N!

% importa :

ordem nao

N

k

k

(

−

)!

!

São óbvias as limitações da definição, algumas tentativas foram feitas para aumentar sua

abrangência através do conceito de definição geométrica de probabilidade, na qual se identificam

os eventos e o espaço amostral a figuras geométricas, de dimensão qualquer, e, ao invés de

contar elementos, o que seria impossível de toda forma, calcula-se a área ou o volume, definindose a probabilidade de um evento como a razão entre sua área (volume) e a área (volume) do

espaço amostral. A primeira dificuldade da abordagem é a identificação entre o experimento e sua

formulação geométrica, o que pode ser não trivial para experimentos mais complexos, podendo

levar a diferentes valores de probabilidades para o mesmo evento. Ver no anexo ao final deste

capítulo o paradoxo de Bertrand (A7.1) e o problema da agulha de Buffon (A7.2) .

Algumas propriedades se destacam desta definição

P( A) ≥ 0

P ( Ω) = 1

A ∩ B = ∅ ⇒ P( A ∪ B) = P( A) + P( B)

O conjunto de propriedades acima foi concebido como um conjunto axiomático de

propriedades que uma função deveria satisfazer para poder ser uma probabilidade. A ferramenta

principal para a construção de probabilidades nos casos em que o paradigma clássico não se

aplica é a variável aleatória, que será vista mais adiante.

Definição 7.5 Axiomas da função Probabilidade

a1) P ( A) ≥ 0, A ∈ F

a 2) P(Ω) = 1

∞

∞

i =1

i =1

a3) Ai ∩ Aj = ∅ ⇒ P(U Ai ) = ∑ P( Ai ), Ai eAj ∈ F

Como conseqüência destes axiomas, deduzimos as seguintes propriedades adicionais da

função probabilidade:

i)

c

P(A )=1 – P(A)

6

c

A sua verificação resulta da aplicação do segundo e do terceiro axioma para A e A . Como

c

A∪A = Ω e P(Ω) = 1, temos o resultado.

ii)

P(A∪ B)=P(A) + P(B) – P(A∩B)

Se A∩B=∅ o resultado resulta do axioma 3, senão é necessário subtrair P(A∩B) para que

a interseção não seja contada duas vezes.

iii)

A⊆B ⇒ P(A) ≤ P(B)

7.4 Exercícios

1. Um experimento consiste em lançar 2 vezes um dado, obtendo-se um par de valores.

a)Determine o espaço amostral deste experimento

b)Determine o evento : soma dos elementos do par <= 8.

c)Determine o evento: complemento de a)

2. Considere uma urna com bolas numeradas de 1 a 100 (números inteiros). Determine a

probabilidade de sortear um número que seja ou ímpar ou começado por cinco ou terminado por

três. O número cinco satisfaz e o número três também.

3. Sejam A, B e C três eventos relativos a um espaço amostral. Exprima os eventos abaixo, usando

operações de união, interseção e complementação.

a)A e C ocorrem e B não ocorre

b)Nenhum dos eventos citados acima ocorre

c)Nenhum evento ocorre

d)A ou C ocorrem e B ocorre

4. Em uma comunidade as probabilidades de um indivíduo ter determinado tipo sangüíneo são :

c

c

P(A)= 0,2

P(B )=0,9

P((AB) )=0,95

a)Qual a probabilidade de um indivíduo ter sangue do tipo O ?

b)Qual a probabilidade de um indivíduo não ter o tipo B ou o tipo AB ?

5. Em um baralho com 52 cartas, 3 cartas são sorteadas ao acaso. Ache a probabilidade de que

exatamente um ás é sorteado.

6. Para o mesmo experimento do exercício 5, calcule agora a probabilidade de que pelo menos um

ás seja sorteado.

7. Em um jogo de poker determine a probabilidade para cada uma das situações seguintes, aonde

cinco cartas estão com um jogador:

a) exatamente um par (duas cartas de igual valor + três cartas de valores distintos)

b) exatamente dois pares

c) exatamente um trio (três cartas de igual valor + duas cartas de valores distintos)

d) full house (um par e um trio)

e) four of a kind (exatamente quatro cartas de igual valor)

f) straight (cinco cartas em seqüência, o ás pode ser utilizado tanto como maior ou menor carta,

inclui-se o straight flush neste caso)

g) flush (todas as cartas do mesmo naipe, inclui-se o straight flush)

h) straight flush (cinco cartas em seqüência e do mesmo naipe)

i) royal flush ( straight flush com a seqüência de 10, valete,rainha,rei e ás)

j) nenhuma das seqüências acima

int_estatistica_aula7

7

7.5 Respostas

2. 0,55

5.

4 48

1 2

= 0, 2042

52

3

6. À probabilidade calculada anteriormente vamos somar (regra da soma) as probabilidades de

4 48

4 48

2 1

= 0,0130 3 0 = 0, 0002

52

52

3

3

sortear pelo menos dois ases e três ases, obtendo-se 0,2174.

7. Considerando que um baralho tem 52 cartas existem 2.598.960 combinações diferentes de 52

cartas cinco a cinco. Há ainda 13 valores de face de 1 a 10 mais valete, rainha, rei e ás. Os naipes

são quatro: espadas, copas, ouro e ...

a) O valor de um par pode ser sorteado de 13 maneiras diferentes, como existem 4 naipes as

seqüências podem ser compostas por combinações de 4 naipes dois a dois. Os três valores

distintos podem ser sorteados por combinações de 12 valores 3 a 3. Os naipes para estes

3

valores distintos podem ser sorteados de 4 maneiras distintas. Aplicando-se o princípio do

produto e a fórmula clássica da probabilidade, obtem-se o valor desejado

4 12

13 × × × 43

2 3

≅ 0, 42

52

5

b)

2

13 4

× × 11× 4

2 2

≅ 0, 048

52

5

c)

12

13 × 4 × × 4 2

2

≅ 0, 021

52

5

8

d)

4

13 × 4 × 12 ×

2 ≅ 0, 0014

52

5

e)

13 × 12 × 4

≅ 0, 0024

52

5

f)

10 × 45

≅ 0, 0039

52

5

g)

13

4×

5 ≅ 0, 0020

52

5

h)

10 × 4

≅ 0, 000015

52

5

i)

4

≅ 0, 000002

52

5

j)

Devem ser considerados 5 valores distintos, excluindo-se o straight. Em seguida deve-se levar

em conta os diferentes naipes, excluindo-se o flush.

13

5

− 10 × (4 − 4)

5

≅ 0,501177

52

5

9

7.6 Probabilidade Condicional e Independência

O conceito de probabilidade condicional é tão importante quanto o de probabilidade e, de certa

forma, mais próximo do que o senso comum identifica como sendo probabilidade. Por exemplo,

quando estamos em dúvida se devemos levar o guarda-chuva antes de sair de casa, procuramos

ao olhar pela janela se as nuvens estão carregadas, se o vento está mais intenso, se a umidade

aumentou etc...Ou seja, a partir da confirmação de alguns eventos que julgamos associados à

ocorrência de chuva, avaliamos a chance dela ocorrer. Na maioria dos casos vamos proceder

desta maneira, exceto em experimentos sintéticos como os de jogos de azar, por exemplo. A

probabilidade condicional pode ser definida a partir do conceito de probabilidade, constituindo ela

própria uma probabilidade, isto é, satisfaz os três axiomas que definem uma função probabilidade.

Definição 7.6 Probabilidade Condicional de um evento H dado que o evento D ocorreu

P( H ∩ D)

; se P( D) ≠ 0

P( D)

P( H | D) = P( H ); se P( D) = 0

P( H | D) =

Observe que foi colocada uma alternativa de definição para o caso de P(D) =0.

Contrariamente ao caso clássico, no qual P(D)=0 é equivalente a D=∅, para espaços amostrais

infinitos podemos ter P(D)=0 e D diferente de ∅.

Duas fórmulas úteis para o cálculo de probabilidades se deduzem da definição 7.6, a

fórmula do produto:

P( A ∩ D) = P( A | D) P( D)

(7.1)

E a fórmula da soma, que para ser aplicada supõe uma partição do espaço amostral, isto

é, uma coleção finita de conjuntos Ai ,disjuntos dois a dois, e cuja união é o espaço amostral. Para

esta partição e um evento A qualquer tem-se que:

n

n

i =1

i =1

P( A) = ∑ P( A ∩ Ai ) = ∑ P( A | Ai ) P( Ai ) (7.2)

Exemplo 7.2 Um restaurante popular apresenta apenas dois tipos de refeições : salada completa

ou um prato à base de carne; 20% dos fregueses do sexo masculino preferem salada ; 30% das

mulheres escolhem carne ; 75% dos fregueses são homens . Considere os seguintes eventos :

H: freguês é homem A: freguês prefere salada

M: freguês é mulher B: freguês prefere carne

Calcular :

a) P(H) , P(A|H) , P(B|M) ;

b) P(A ∩H) , P(A)

O item a) visa verificar a compreensão dos dados do enunciado. É muito comum o iniciante

confundir a probabilidade condicional com a probabilidade da interseção. Obviamente P(H)=0,75,

já P(A|H)= 0,2 e P(B|M)=0,3 porque os porcentuais ou proporções em ambos os casos não se

aplicam sobre a totalidade dos clientes mas sobre os homens e as mulheres, respectivamente.

O item b) visa verificar a compreensão das fórmulas 7.1 e 7.2 . Pela 7.1,

P(A ∩H)=P(A|H) P(H) = 0,2 x 0,75 = 0,15 . Dado que os eventos H e M são uma partição do

espaço amostral constituído pelos clientes do restaurante, podemos aplicar a fórmula 7.2 para

calcular P(A)= P(A ∩H) + P(A ∩M)= 0,15 + 0,175= 0,325 .

int_estatistica_aula7

10

Definição 7.7 Independência entre eventos

Dois eventos A e B são independentes se e somente se (s.s.s)

P(A|B)=P(A)

Equivalentemente podemos dizer que dois eventos A e B são independentes s.s.s

P(A∩B)=P(A)P(B)

É comum o estudante identificar eventos disjuntos como sendo independentes. Entretanto é

exatamente o contrário ! Pois se A e B forem disjuntos, P(A∩ B)=0 e no entanto P(A)P(B) ≠ 0 em

geral.

Exemplo 7.3

Na tabela os números que aparecem são probabilidades relacionadas com a ocorrência de A ,

A ∩ B e assim por diante. Por exemplo, P(A)=0,10 , enquanto que P(A∩B) =0,04. Verifique se A e

B são independentes .

A

c

A

c

B

0,04

0,08

0,12

B

0,06

0,82

0,88

0,1

0,9

1,0

Basta verificar se P(A∩B)=P(A)P(B), como P(A∩B)= 0,04 ≠ P(A)P(B)= 0,1 X 0,12 = 0,012, então

concluímos que não são independentes.

7.7 Fórmula de Bayes

A contribuição central de Bayes foi a concepção de um processo de aprendizado com a

experiência. Assim a probabilidade P(H) de um evento (ou hipótese) não é absoluta em si, mas a

medida que novos eventos (ou dados) são conhecidos, ela pode ser atualizada.

Fórmula de Bayes (forma com uma hipótese):

P( H | D) = P( D | H ) × P( H )

(7.3)

A dedução é imediata.

Os termos desta fórmula recebem denominações particulares que explicam a sua utilidade:

P(H) é a probabilidade a priori de H, representando o valor inicial desta probabilidade antes de se

obterem dados ou outras evidências.

P(D|H) é a verossimilhança, ou o impacto dos dados sobre H. Um baixo valor desta probabilidade

reflete o fato de que as chances de H são baixas, e vice-versa.

P(H|D) é a probabilidade a posteriori de H , ou a probabilidade atualizada de H após a utilização de

nova informação na verossimilhança.

Fórmula de Bayes (forma com n hipóteses)

int_estatistica_aula7

11

P( H j | D) =

P( D | H j ) × P( H j )

n

∑ P( D | H ) × P( H )

i

n

; aonde H i ∩ H j = ∅; U H i = Ω (7.4)

i =1

i

i =1

Neste caso há várias hipóteses concorrentes sendo consideradas. A dedução é muito fácil,

bastando observar que o denominador é igual a P(D) e o numerador a P(D ∩ Hj).

Exemplo 7.4

Retomando o enunciado do exemplo 7.2 determine P(M|A)

Pela fórmula 7.4 , P(M|A) = P(A|M)xP(M) / (P(A|M)xP(M)+P(A|H)xP(H)) =

0,80x0,25 / (0,80x0,25 + 0,20x0,75) = 0,57

Observe que P(A|M)=1 – P(A|H)=1 – 0,20 = 0,80 e P(M) = 1 – P(H) = 0,25

Uma forma usual de expressar uma probabilidade é através da razão de chances, muito

utilizada em apostas de torneios, por exemplo, o time A tem o dobro das chances do time B. Esta

forma não implica na determinação das probabilidades respectivas de A ou B ganharem mas

apenas da chance relativa entre elas. A razão de chances também pode ser enunciada para a

c

ocorrência de um evento A e o seu complemento A :

c

o(A)=P(A)/P(A )

(7.4)

A razão de chances pode servir para se definir uma probabilidade:

o(A) =P(A)/(1-P(A)) ⇒ P(A)=o(A) / [1 + o(A)]

(7.5)

7.8 Variáveis Aleatórias

O conceito de variável aleatória é um dos conceitos fundamentais da teoria das

probabilidades e entre outras aplicações permite a construção de probabilidades para eventos

associados a um experimento. Uma variável aleatória é uma função que associa cada evento de

um espaço amostral a um número. Quando esta associação é possível com os números racionais

dizemos que a variável aleatória é discreta, quando ela só for possível com os números reais então

ela é uma variável aleatória contínua. Como os racionais são enumeráveis, usualmente se define

uma variável aleatória discreta como assumindo valores inteiros. Exige-se também que para uma

função ser uma variável aleatória que sua imagem inversa sempre corresponda a um evento.

Definição 7.8 Variável Aleatória Discreta

X : Ω → {x1 , x2 ,...} ⊆ Z

A a X ( A) = xi

Embora seja uma função, não é uma função real o que dificulta a sua manipulação. Esta

limitação é contornada com as definições de função densidade discreta f(x) e função de

distribuição (acumulada) F(x).

12

Exemplo 7.5

a) Em um jogo de dados com um só dado associar a cada face o número de marcas.

X : Ω → {1, 2, 3, 4,5, 6}

b) Em um jogo de lançamento de uma moeda associar a cada face os números 1 ou 0.

X : Ω → {0,1}

c) Em um sistema de controle de freqüência associar a cada aula o número de alunos presentes.

X : Ω → {0,1, 2,..., 60}

d) Em um call center associar a cada período de tempo pré-fixado (por hora, por dia, etc...) o

número de chamadas

X : Ω → {0,1, 2,3,...}

Observe que neste último caso, teoricamente, podemos ter tantas chamadas quanto

números inteiros, ou seja, trata-se de um experimento com espaço amostral infinito e

consequentemente a variável aleatória (neste caso) tem a imagem infinita, porém discreta.

Um mesmo experimento pode servir para a definição de mais de uma variável aleatória.

Por exemplo, para o jogo com uma moeda, poderíamos definir uma variável aleatória que

associasse ao evento sair cara o número de lançamentos necessários até que isto ocorresse.

Definição 7.9 Função densidade discreta

A dificuldade operacional da definição de variável aleatória é contornada com a definição

de densidade discreta, também conhecida como função de massa, ou ainda, função distribuição de

probabilidades. Esta função associa ao valor que pode ser assumido pela variável a uma

probabilidade. Uma função é uma densidade se for não negativa e a soma de todos os valores

assumidos for igual a 1.

f ( x) = P{ A ⊆ Ω | X ( A) = x} = P( X = x)

(7.6)

Exemplo 7.6

a) Distribuição uniforme: utilizada para modelar experimentos aleatórios puros

X : Ω → {1, 2,..., n}

1

f (k ) = P( X = k ) = ; k = 1,..., n

n

b) Distribuição de Bernoulli: utilizada para modelar experimentos aleatórios dicotômicos

X : Ω → {0,1}

f (1) = P( X = 1) = p

f (0) = P( X = 0) = q = 1 − p

int_estatistica_aula7

13

c) Distribuição Binomial: utilizada para modelar experimentos compostos de Bernoulli

X : Ω → {1, 2,..., n}

n

f (k ) = P( X = k ) = p k q n − k ; k = 1,..., n

k

d) Distribuição Geométrica: utilizada para modelar experimentos com condição de parada

a

a

simples ( 1 ocorrência, 1 falha, etc...)

X : Ω → {1, 2,3,...}

f (k ) = pq k −1

e) Distribuição de Poisson: utilizada para modelar experimentos durante um intervalo de

tempo contínuo, porém com um número discreto de resultados ( acidentes por mês,

terremotos por ano, etc...)

X : Ω → {0,1, 2,...}

f (k ) =

µk

k!

e− µ

f) Distribuição Hipergeométrica: utilizar para modelar experimentos com espaços amostrais

finitos e discretos para os quais a chance de ocorrência de evento varia à medida que os

sorteios são feitos (amostragem sem reposição, por exemplo)

X : Ω → {0,1,..., n}

r N − r

k n − k

f (k ) =

N

n

Exemplo 7.7(associado aos itens do exemplo anterior)

a)

Considere uma urna com bolas numeradas de 1 a 100. Determine a probabilidade de

sortear um número que seja ímpar ou iniciado por 5 e terminado por 3. O número 5 satisfaz

e o número 3 também.

O experimento pode ser modelado pela distribuição uniforme discreta: U(1,2,...,100). Os

números ímpares são no total de 50 para o intervalo considerado e incluem o 3, o 5 e os números

terminados por 3. Da condição restante, números que começam por 5, temos cinco valores que

não estão incluídos nos ímpares: 50, 52, 54, 56, 58. Portanto o total de números que satisfaz a

condição é de 55. Pela densidade discreta a probabilidade de sortear cada um destes números é

igual a 1/100, como são 55 a probabilidade pedida é igual a 0,55.

int_estatistica_aula7

14

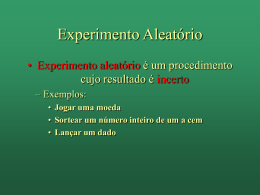

b)

Faça o gráfico da função densidade para uma distribuição de Bernoulli com

parâmetro p = 0,1.

Usualmente associa-se o termo sucesso quando a variável assume o valor 1, mas isto é

apenas uma convenção, não necesseriamente o evento que é associado ao valor 1 representa um

fato positivo ou benéfico, mas apenas o evento de interesse.

1

0,9

0,8

0,7

0,6

0,5

0,4

0,3

0,2

0,1

0

0

0,2

0,4

0,6

0,8

1

c)

Considere um estudante que vai prestar um exame , como ele estudou pouco ,

tem 30% de chance de acertar cada questão . A prova tem 12 questões .Qual a probabilidade

de acertar entre 0 e 4 questões ?

Esta pergunta pode ser respondida modelando-se o experimento por uma distribuição

binomial com parâmetros p = 0,3 e n = 12. Pela fórmula dada no item c) do exemplo 7.6,

podemos calcular (aproximadamente) as probabilidades sucessivamente para k=0, 1, 2, 3, e 4:

0,014; 0,071; 0,17; 0,24 e 0,23. Somando estes valores obtemos 0,73.

d)

Um estudante saiu para comemorar sua aprovação no curso de Estatística,

como bebeu muito ao voltar para casa tenta aleatoriamente encontrar a chave que abre a

porta do seu apartamento. Se a chave não serve, tenta novamente, podendo, devido ao seu

estado de embriaguez, escolher de novo as chaves tentadas anteriormente (sorteio com

reposição). Qual a chance de abrir a porta na terceira tentativa, se o seu chaveiro tem 10

chaves e somente uma abre a porta ?

Este experimento pode ser modelado pela distribuição geométrica com parâmetro

p = 0,1 e k=3. Pela função densidade discreta o valor da probabilidade procurada é :

2

0,1(0,9) =0,081.

f)

Pequenos motores são guardados em caixas com 50 unidades. Um inspetor de

qualidade examina cada caixa, antes da posterior remessa, testando 5 motores. Se nenhum

motor for defeituoso, a caixa é aceita. Se, pelo menos um for defeituoso, todos os motores

são testados. O fornecedor sabe que há 6 motores defeituosos em cada caixa. Qual a

probabilidade de que seja necessário examinar todos os motores da caixa ?

Este experimento pode ser modelado pela distribuição hipergeométrica com os

seguintes parâmetros N=50; r=6; n=5. Vamos calcular a probabilidade de não se encontrar nenhum

motor defeituoso e então a probabilidade desejada é o seu complemento.

44 6

5 0

1 − = 1 − 0,53 = 0, 47

50

5

15

7.9 Exercícios

1. Um estudo estatístico sobre o comportamento eleitoral em um estado produziu os seguintes

resultados , expressos em probabilidades , sobre os votos exclusivos em partidos, assim como

votos em branco e nulos : Partido da Aliança , Partido do Brasil , Partido Democrata , Partido

Nacional , Brancos e Nulos .

P(Aliança)= 0,05 ; P(Brasil)= 0,30 ; P(Democrata)=0,40 ; P(Nacional)=0,04 ; P(Brancos)= 0,20

P(Nulos)= 0,01

Tomando por base estes resultados, calcule as seguintes prrobabilidades :

c

c

c

a) P(D ∩A ∩Na ) =

c

c

b) P(D ∪Bras ) =

c

c) P(D | Bras ) =

c

d) P(Bras∩D ) =

e) P(A∪Na∪Nu) =

c

f) P(A-Nu | Bran ) =

g) P(A∩Bras∩D) =

c

h) P(A ∪Bran∪D) =

c

c

i) P(Nu | Bran ) =

c

c

j) P [ (D∪A) | Na ] =

No item f) , A-Nu denota a interseção de A com o complementar de Nu

2.

Dois sinais de duração T < ½ cada, são transmitidos por um canal de rádio durante um

intervalo de tempo (0,1) ; cada um deles começa a ser transmitido com a mesma probabilidade em

qualquer instante do intervalo (0, 1-T). Se os sinais não se interceptarem eles são transmitidos

com sucesso, senão eles se interferem totalmente. Calcule a probabilidade de que eles sejam

transmitidos com sucesso.

3.

Uma indústria tem três máquinas , A1 , A2 e A3 que produzem , respectivamente , 50% ,

30% e 20% do número total de eixos que fabrica . A porcentagem de produtos defeituosos

oriundos destas máquinas é 3% , 4% e 5% respectivamente .

Tomando base estas informações, calcule as seguintes probabilidades :

a) Se um eixo é escolhido ao acaso , qual é a probabilidade do mesmo não ser defeituoso ?

b) Seja um eixo escolhido ao acaso e que é defeituoso . Qual a probabilidade de ter sido

produzido pela máquina A1 ou A3 ?

c) Se o eixo escolhido ao acaso não for defeituoso , qual a probabilidade de ter sido produzido

pela máquina A1 ?

d) Um cliente da indústria compra o lote de eixos se menos de 4% forem defeituosos. O negócio

será fechado ? Por que ?

int_estatistica_aula7

16

e) Seja um eixo escolhido ao acaso e que é defeituoso . Qual a probabilidade de ter sido produzido

pela máquina A1 ou A2 ?

f) Se o eixo escolhido ao acaso não for defeituoso , qual a probabilidade de não ter sido produzido

pela máquina A1 ?

g) Seja um eixo escolhido ao acaso e que é defeituoso . Qual a probabilidade de ter sido

produzido pela máquina A2 ou A3 ?

h) Caso se deseje melhorar a qualidade do lote de peças e se disponha de recursos para consertar

apenas uma máquina , qual delas você escolheria ? Por que ?

i) Se o eixo escolhido ao acaso não for defeituoso , qual a probabilidade de ter sido produzido pela

máquina A2 ?

j)

Se o eixo escolhido ao acaso for defeituoso , qual a probabilidade de ter sido produzido

pela máquina A1 ?

4. Pedro quer enviar uma carta a Marina. A probabilidade de que Pedro escreva a carta é de 0,8. A

probabilidade de que os Correios não a percam é de 0,9. A probabilidade de que o carteiro a

entregue é de 0,9. Dado que Marina não recebeu a carta, qual é a probabilidade condicional de

que Pedro não a tenha escrito ?

7.10 Respostas selecionadas

c

c

c

1. a) P(D ∩A ∩Na ) = 1-P(Nu ∪ Bran ∪ Bras) =1 - P(Nu) - P(Bran) - P(Bras) = 0,51

c

c

c

c

b)P(D | Bras ) = P(D ∩ Bras ) / P(Bras ) = P(D) / P(Bras ) = 0,40 / 0,70 ≅ 0,57

2.a) P(defeituoso)=P(L1)x P(defeituoso| L1) + P(L2)x P(defeituoso| L2) + P(L3)x P(defeituoso| L3)=

0,5x0,03 + 0,3x0,04 + 0,2x0,05 = 0,037. Logo a P(não defeituoso)=0,963 .

7.11 Média e Variância de Variáveis Aleatórias Discretas

Vimos nas aulas 3 e 5 os conceitos de média e variância amostrais, vamos agora

reintroduzir estes conceitos para variáveis aleatórias. Na estatística clássica paramétrica, a média

e a variância (populacionais) são parâmetros. Diferentemente das estatísticas não variam, são os

mesmos valores para toda a população. A forma de calculá-los vai mudar em conseqüência disso,

pois ao invés de freqüências, temos probabilidades. As definições são dadas a seguir:

n

µ = E ( X ) = ∑ xi P( X = xi )

(7.7)

i =1

n

σ 2 = VAR( X ) = ∑ ( xi − µ ) 2 P( X = xi )

(7.8)

i =1

ou

n

n

i =1

i =1

σ 2 = E ( X 2 ) − ( E ( X )) 2 = ∑ xi2 P( X = xi ) − (∑ xi P( X = xi )) 2

(7.9)

A fórmula (7.9) é o equivalente da fórmula prática para a variância experimental e é

particularmente útil em deduções e aplicações como veremos mais adiante. Para cada uma das

variáveis aleatórias apresentadas no exemplo 7.6 damos respectivamente os valores de suas

17

média e variância. Há ferramentas mais avançadas para o cálculo destes parâmetros, como a

função geradora de momentos, por exemplo, mas não serão vistos aqui.

Exemplo 7.8 Média e variância (associado aos itens do exemplo 7.6)

n +1

2

b) bernoulli : µ = p

σ 2 = pq

a) uniforme : µ =

σ 2 = npq

c) binomial : µ = np

d ) geometrica : µ =

e)

poisson : µ = µ

1

p

σ2 =

(1 − p)

p2

σ2 = µ

f ) hipergeometrica : µ = n ×

r

N −r

Exemplo 7.9 O jogo de roleta

Considere o jogo de roleta tradicional. Neste jogo há várias modalidades de aposta, a mais

simples consiste em apostar em um número de 1 a 36, sendo que há mais duas casas na roleta

que não entram nas apostas e são da casa. Esta modalidade de aposta é a que dá o maior prêmio,

porém é a que tem menor chance para o jogador: 1/38. Supondo-se que a casa paga 35 unidades

monetárias para cada unidade apostada em um número premiado, calcule a esperança de ganho

de um jogador nesta modalidade.

É necessário construir a distribuição de probabilidade neste caso, já que não corresponde

a nenhum dos modelos tradicionais apresentados, embora tenha a mesma estrutura da distribuição

de Bernoulli. A densidade discreta associada a variável aleatória ganho é dada pela tabela:

xi

f(xi)

35

1/38

-1

37/38

De acordo com a fórmula (7.7) a média ou esperança de ganho do jogador é:

E ( X ) = µ = 35.

1

37

2

+ (−1). = − ≅ −0, 05

38

38

38

Ou seja, como era de se esperar o jogo favorece a banca.

Exemplo 7.10

Entropia é um conceito usualmente associado à física, maior entropia significa

maior desordem em um sistema, menor entropia, o contrário. Podemos definir entropia para uma

18

variável aleatória tomando como referência a teoria da informação de Shannon(1916-2001) que

define o nível de informação a partir do logaritmo do recíproco da probabilidade, e a entropia como

sendo a média destes valores.

X v.a. discreta

{xk | k = 0, ±1,..., ± K }

K

P( X = xk ) = pk ; 0 ≤ pk ≤ 1 ;

∑

pk = 1

k =− K

O nível de informação de xk é dado por

I ( xk ) = log (

1

) = −log pk

pk

Definindo-se assim uma nova v.a discreta cuja média é denominada de entropia

K

∑

pk I ( xk ) = − ∑ pk log ( pk )

k =− K

k =− K

H ( X ) = E[ I ( X )] =

K

0 ≤ H ( x) ≤ log (2 K + 1)

H ( X ) = 0 ⇔ pk = 1; i ≠ k pi = 0 nenhuma incerteza

H ( X ) = log (2k + 1) ⇔ pk =

1

∀k incerteza maxima

2k + 1

Nos dois casos apresentados, verificamos que a menor entropia (incerteza) corresponde a

uma variável quase determinística, e a incerteza máxima à distribuição uniforme. Neste exemplo

implicitamente usamos o conceito de função de variável aleatória, que é aplicado quando

deduzimos I(X) a partir de X. Um resultado da teoria das probabilidades assegura que a média da

função de uma variável aleatória é calculada de acordo com a fórmula

K

E[ I ( X )] =

∑

pk I ( xk )

(7.10)

k =− K

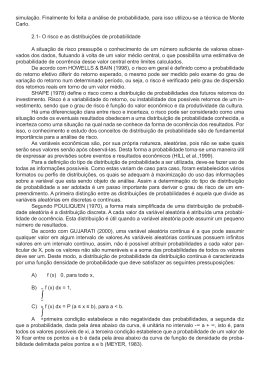

7.12 Variáveis aleatórias contínuas

Experimentos com espaços amostrais não enumeráveis representaram uma dificuldade

para a construção de modelos de probabilidade, no anexo os paradoxos de Buffon e Bertrand são

exemplos disto. A extensão da definição de variável aleatória para o caso contínuo vai permitir a

construção de modelos de variáveis aleatórias que permitirão o cálculo operacional de

probabilidades.

Definição 7.10 Variáveis aleatórias contínuas

X :Ω → R

A a X ( A) ∈ℜ

int_estatistica_aula7

19

X deve ser definido de forma que a imagem inversa de qualquer intervalo real corresponda

a um evento.

Definição 7.11 Função densidade contínua

No caso contínuo a probabilidade de um evento que leva a um número particular é 0.

Portanto a função densidade no caso contínuo precisa ser definida para intervalos conforme a

expressão abaixo. Uma função é uma densidade se for não negativa e sua integral de -∞ a +∞ for

igual a 1.

b

P(a ≤ X ≤ b) = ∫ f (t )dt

(7.11)

a

Exemplo 7.11 Exemplos de distribuições contínuas e suas funções densidade

a) Uniforme (a,b)

X : Ω → ( a, b)

f( x)

0 se − ∞ < x ≤ a

1

f ( x) =

se a < x < b

b − a

0 se b ≤ x < ∞

1/ (b-a)

a

b

x

b) Exponencial (λ)

X : Ω → (0, ∞)

0 se x < 0

f ( x) = − λ x

λ e se x ≥ 0

Densidade Exponencial (lambda=1)

1

0,8

0,6

0,4

0,2

0

int_estatistica_aula7

20

2

c) Normal (µ, σ )

0,45

X :Ω → R

2

2

1

f ( x) =

e − ( x − µ ) / 2σ

σ 2π

0,4

0,35

0,3

0,25

0,2

0,15

0,1

0,05

0

A distribuição normal tem um papel central na estatística clássica, embora tivesse sido

identificada desde o século XVI a partir dos trabalhos de Abraham de Moivre (1667 – 1754), é com

Carl Friedrich Gauss (1777 – 1855) que sua formalização matemática é consolidada a partir da

teoria sobre a distribuição de erros.

Definição 7.12 Função de distribuição (acumulada)

A definição geral é válida tanto para variáveis discretas como contínuas.

F(x) = P( X x )

No caso contínuo o cálculo da Função de distribuição acumulada pode ser feito através da

integração da função densidade. Em casos mais simples esta integral tem forma fechada,

podendo-se explicitar a função que dá a probabilidade acumulada até o limiar. Mas, na maioria dos

casos a integral tem que ser calculada aproximadamente, como na distribuição Normal. Uma

função é uma função de distribuição acumulada se for não negativa, assumindo valores entre 0 e

1, não decrescente e contínua à direita.

Exemplo 7.12 Funcões de distribuição acumulada

a)Uniforme (a,b)

0 se − ∞ < x ≤ a

x−a

F ( x) =

se a < x < b

b

−

a

1 se b ≤ x < ∞

b)Exponencial()

0 se x < 0

F ( x) =

−λ x

1 − e se x ≥ 0

No caso normal não é possível obter a forma fechada para F(x). Entretanto uma propriedade que

relaciona normais com média e variância distintas vai facilitar o cálculo aproximado de

probabilidades para qualquer normal a partir do cálculo feito para a Normal padrão, que é a normal

21

com média 0 e variância 1. Antes de apresentarmos esta propriedade, vejamos as definições de

média (ou esperança) e variância para variáveis aleatórias contínuas.

7.13 Média e variância de variáveis aleatórias contínuas

A extensão do conceito de média e variância ao caso contínuo é feito via integração da função

densidade. As fórmulas 7.13, 7.14 e 7.15 são análogas, respectivamente, às fórmulas 7.7, 7.8 e

7.9 .

∞

µ=

∫ tf (t )dt

(7.13)

−∞

∞

σ2 =

∫ (t − µ )

2

f (t )dt

(7.14)

−∞

∞

2

σ =

∫t

∞

2

f (t )dt − ( ∫ tf (t )dt ) 2

−∞

(7.15)

−∞

Exemplo 7.13

a) Uniforme(a,b)

µ=

a+b

2

σ2 =

(b − a)2

12

b) Exponencial(λ)

µ=

1

λ

σ2 =

1

λ2

Exemplo 7.14 Uniforme

a) Se X é uma uniforme contínua definida no intervalo [-2 , 2] , faça o gráfico da distribuição

acumulada de X.

1

-2

2

b) A dureza de rochas em uma jazida segue uma distribuição uniforme contínua no intervalo

[50 , 70] . Calcule a probabilidade de que uma rocha tenha dureza entre 55 e 60.

P( 55<X<60) = F(60) – F(50) para o caso contínuo. Do exemplo 7.12 a) tem-se que:

F(60) = 0,5 e F(55) = 0,25, logo a probabilidade desejada é 0,25.

int_estatistica_aula7

22

Exemplo 7.15 Exponencial

A distribuição exponencial modela experimentos relativos à vida útil de equipamentos. O parâmetro

média dá o valor do tempo esperado de funcionamento. A distribuição exponencial é a única

distribuição contínua que tem a propridedade de ausência de memória, motivo pela qual ela é

adequada para descrever o funcionamento de equipamentos. Formalmente tem-se:

P ( X ≥ a + b | X ≥ b) = P ( X ≥ a )

Ou seja o comportamento é dado pelo intervalo decorrido e não pela origem no tempo. É razoável

esta propriedade para descrever o funcionamento durante o tempo útil porque espera-se que um

equipamento funcione de modo regular toda vez que for acionado, já a duração da utilização é

outra situação. Sabendo-se que o uso contínuo por um período mais prolongado do que outro

período no dia anterior, por exemplo, pode ser mais suscetível a falhas. No caso discreto a

distribuição geométrica é a única distribuição que também tem a mesma propriedade.

Exemplo 7.16 Normal padrão e as funções Z, φ e Φ

Uma normal que tenha média 0 e desvio-padrão 1 é denominada de normal padrão e denotada

pela letra Z. A função densidade de Z é a função φ, e sua função de distribuição acumulada é a

função Φ que só pode ser calculada aproximadamente, ver tabela no anexo II.

φ ( x) =

1 − x2 / 2

e

2π

1,00

0,80

0,60

0,40

0,20

0,00

A distribuição normal tem a seguinte propriedade:

P( X ≤ x) = P( Z ≤

x−µ

σ

)

(7.16)

É devido a (7.16) que podemos calcular probabilidades para qualquer normal a partir de Φ. Basta

achar o limiar equivalente para Z, calculando-se a padronização do limiar x original.

7.14 Exercícios

1. Tomando como referência a tabela da distribuição acumulada da Normal Padrão , escolha

cinco dentre as dez questões a seguir :

a) Para a Normal N(10 ,1) determine P { X≥11}

b) Para a Normal N(10, 4) determine P { X< 2}

23

c) Para a Normal padrão determine L de forma que P{ X>L } = 0,1

d) Para a Normal padrão determine L de forma que P{ 1<X<L} = 0,2

e) Para a Normal padrão determine a P{ X ∉ [ µ ,µ +σ] }

f)

Para a Normal N(10,4) determine c tal que P{ X ∈ [µ , µ + c σ] }= 0,4

g) Para a Normal padrão determine c tal que P{ X ∈ [1 , 2c] }= 0,3

h) Para a Normal N(10,4) determine P{ x>15}

i)

Para a Normal padrão determine um intervalo simétrico em torno da média tal que

P{ -L < X < L} = 0,80

j)

Para a Normal N(-5 , 9) determine P{ X < 0}

2.

As vendas de um determinado produto têm distribuição aproximadamente normal , com

média 500 e desvio padrão 50 . Se a empresa decide fabricar 600 unidades no mês em estudo ,

qual é a probabilidade de que não possa atender todos os pedidos desse mês , por estar com a

produção esgotada ?

3.

As rendas dos membros de uma grande comunidade podem ser representadas por uma

distribuição Normal com média igual a 4.000 e desvio padrão igual a 3.000 unidades monetárias .

Qual porcentagem da população tem renda superior a 7.600 unidades monetárias ?

Determine um intervalo em torno da média que contenha 90% das rendas.

7.15 Respostas selecionadas

1.

a) P(X ≥ 11) = P{Z ≥ (11 – 10)/1}=P(Z ≥ 1) = 1 - P(Z 1) = 1 - Φ(1) = 1 – 0,84 = 0,16

Observe que para variáveis aleatórias contínuas a igualdade não importa, pois a probabilidade de

um valor ocorrer é sempre 0. O valor de Φ(1) foi obtido na tabela do Anexo II deste capítulo.

7.16 Vetores Aleatórios

Vetores aleatórios ou variáveis aleatórias multidimensionais são funções do espaço produto

n

amostral em R . Neste curso vamos nos limitar ao caso n=2. Os vetores aleatórios podem ser

discretos, contínuos ou mistos. Modelam experimentos aonde se observam mais de um atributo.

Definição 7.13 Vetor aleatório (bi-dimensional)

( X ,Y ) :

Ω × Ω → R2

( A, B) a ( X ( A), Y ( B))

Analogamente ao caso unidimensional definem-se as funções densidade conjunta e distribuição

acumulada conjunta:

24

Definição 7.14 Densidade Conjunta

discreta

continua

d b

∫ ∫ f ( x, y)dxdy = P(a < X < b, c < Y < d )

f ( xi , y j ) = P( X = xi , Y = y j )

c a

Definição 7.15 Distribuição Acumulada Conjunta

discreta

F (m, n) =

continua

∑

n m

P( X = xi , Y = y j ) F (m, n) =

i, j

tal que

xi ≤ m

y j ≤n

∫∫

f ( x, y )dxdy

−∞ −∞

Exemplo 7.17

Exemplo de uma densidade de vetor aleatório discreto. Nas margens temos os valores das

variáveis, nas células internas as probabilidades conjuntas (densidades conjuntas) para os pares

de valores correspondentes. A analogia com a tabela de contingência vista na Aula 1 é evidente.

X

1

2

3

Y

1

1/15

0

1/15

2

0

4/15

2/15

3

2/15

0

1/15

4

0

1/15

1/15

5

0

1/15

1/15

Uma função é uma densidade conjunta se for não negativa e somar 1, o que se verifica na tabela

acima.

Definição 7.16 Densidades Marginais

n

f x ( a ) = P ( X = a ) = ∑ P ( X = a, Y = y j )

m

f y (b) = P (Y = b) = ∑ P ( X = xi , Y = b)

j =1

i =1

Exemplo 7.18

Retomando o exemplo 7.17 e aplicando a definição 7.16 obtemos nas margens da tabela as

densidades marginais em relação a X e Y.

X

1

2

3

Y

fy

1

1/15

0

1/15

2/15

2

0

4/15

2/15

6/15

3

2/15

0

1/15

3/15

4

0

1/15

1/15

2/15

5

0

1/15

1/15

2/15

fx

3/15

6/15

6/15

1

25

Definição 7.17 Densidades Condicionais

f X |Y =b ( x | b) =

f ( x, b)

fY (b)

fY | X = a ( y | a ) =

f ( a, y )

f X (a)

Exemplo 7.19

Usando os resultados dos exemplos 7.17 e 7.18 podemos obter as duas densidades condicionais:

fY|X=2

Y

0

1

4/6

2

0

3

fX|Y=2

X

0

1

4/6

2

2/6

3

1/6

4

1/6

5

A esperança condicional de Y|X=x é a esperança da distribuição condicional. Por exemplo,

E(Y|X=2) = 1x0+2x4/6+3x0+4x1/6+5x1/6=17/6 .

7.17 Independência e Covariância

O conceito de independência entre eventos pode ser enunciado para variáveis aleatórias. Não há

graus de independência, duas variáveis são ou não são independentes. Mas quando são

dependentes, o grau de dependência (linear) pode ser medido pela covariância ou pelo coeficiente

de correlação.

Definição 7.18 Independência e dependência entre variáveis aleatórias

X eY

% independentes s.s.s.

sao

f ( x, y ) = f X ( x ) f Y ( y )

Definição 7.19 Covariância e correlação

COV ( X , Y ) = E{[ X − µ X ][Y − µY ]} = E{ XY } − EX EY

ρ ( X ,Y ) =

COV ( X , Y )

σ XσY

Exemplo 7.20

As variáveis X e Y do exemplo 7.18 não são independentes porque f(1,1) = 1/15 mas

fX(1)fY(1)=3/15 x 2/15 = 6/15 . Basta que a igualdade não se verifique apenas uma vez para que a

independência deixe de valer.

26

Exemplo 7.21

A covariância entre X e Y do exemplo 7.18 pode ser calculada usando a versão prática E(XY) –

E(X)E(Y)

E(X)= 1x 3/15 + 2x 6/15 +3x 6/15 ≅ 2,2

E(Y)= 1 x 2/15 + 2x 6/15 + 3 x 3/15 + 4 x 2/15 + 5 x 2/15 ≅ 2,73

E(XY) = 1 x 1 x 1/15 + 1 x 3 x 2/15 + 2 x 2 x 4/15 + 2 x 4 x 1/15 + 2 x 5 x 1/15 + 3 x 1 x 1/15 +

3 x 2 x 2/15 + 3 x 3 x 1/15 + 3 x 4 x 1/15 + 3 x 5 x 1/15 ≅ 6,13

COV(X,Y) ≅ 6,13 – 2,2 x 2,73 = 0,12

int_estatistica_aula7

A covariância é dependente da escala em que X e Y estão representados. O coeficiente de

correlação elimina este efeito.

Exemplo 7.22 Densidade normal bivariada

f ( x, y ) =

1

2πσ xσ y

1

exp −

2

2

1− ρ

2(1 − ρ

x − µ 2

x − µx

x

− 2ρ

σ x

σx

y − µy

σ y

y − µy

+

σy

2

A expressão da densidade bi-variada envolve 5 parâmetros: as médias de X e Y; os desvios

padrão de X e Y, e o coeficiente de correlação ρ entre X e Y . Observe que se este coeficiente for

zero então f(x,y)= fX(x) fY(Y) o que caracteriza a independência entre X e Y.

X e Y independentes ⇒ COV ( X , Y ) = 0 e ρ ( X , Y ) = 0

% dependentes

COV ( X , Y ) ≠ 0 ou ρ ( X , Y ) ≠ 0 ⇒ X e Y sao

Portanto trata-se de uma condição necessária para a independência mas não suficiente.

7.18 Operações entre variáveis aleatórias

Produto por constante

cX ⇒ E (cX ) = cE ( X ) e VAR(cX ) = c 2VAR( X )

Soma de uma constante

X + c ⇒ E ( X + c) = E ( X ) + c e VAR( X + c) = VAR( X )

Soma de duas variaveis aleatorias

X + Y ⇒ E ( X + Y ) = E ( X ) + E (Y )

X e Y independentes ⇒ VAR( X + Y ) = VAR( X ) + VAR(Y )

X e Y dependentes ⇒ VAR( X + Y ) = VAR( X ) + VAR(Y ) + 2COV ( X , Y )

7.19 Funções de Variáveis Aleatórias

Definição 7.21 Função de Variável Aleatória Discreta

27

Se X é uma variável aleatória discreta e h uma função bijetora definida nos números inteiros,

assumindo valores inteiros, então Y = h (X) é uma variável aleatória discreta.

Exemplo 7.22

X ~ Uniforme {1,2,3}

h(x) = 2x + 1

Y ~ Uniforme {3,5,7}

Definição 7.22 Função de Variável Aleatória Contínua

Se X é uma variável aleatória contínua e h uma função real inversível, então Y = h(X) é uma

variável aleatória contínua.

Exemplo 7.23

2

X ~ Normal(µ, σ )

h(x) = (x - µ) / σ

Y ~ Normal(0,1)

Definição 7.23 Esperança de Função de Variável Aleatória Discreta

Sejam X, Y e h como na Definição 7.21, então:

E (Y ) = ∑ h( xi )P( X = xi )

i

Definição 7.24 Esperança de Função de Variável Aleatória Contínua

Sejam X, Y e h como na Definição 7.22, então

∞

E (Y ) =

∫ h(t ) f (t )dt

−∞

7.20 Exercícios

1.

Lançam-se dois dados, X indica o número obtido no primeiro dado e Y o maior ou número

comum nos dois dados. Responda aos itens seguintes:

a)

b)

c)

d)

e)

f)

g)

h)

Represente a densidade conjunta f(x,y)

Determine as densidades marginais

As duas variáveis são independentes ?

Calcule E(XY)

Calcule COV(X,Y)

Calcule E(X+Y)

Calcule VAR(X+Y)

Determine fX|Y=2

2. Seja X uma variável aleatória com distribuição normal N(10,10).

a) P(X < -5)

b) Determine r tal que P(X > 10 + r ou X < 10 – r) = 0,1

28

3. Uma certa liga é formada , combinando a mistura fundida de dois metais. A liga resultante

contem uma certa porcentagem de chumbo X, que pode ser considerada uma variável aleatória

-5

com densidade f(x) = 0,6 . 10 x(100 – x) para 0≤x≤100 e 0 em caso contrário. Suponha que o L,

o lucro líquido obtido na venda desta liga (por unidade de peso) é a seguinte função de X : L = 0,01

+0,02x. Calcule o lucro esperado , isto é, E(L).

4. Para a tabela abaixo que dá a distribuição conjunta de X e Y , determine:

a) COV(X,Y)

b) E(X | Y=5)

Y \ X

3

5

7

10

0

0,1

0,15

15

0,1

0,1

0,25

20

0,1

0,1

0,1

5. Um estudante chega ao ponto de ônibus às 10:00 h , sabe-se que o próximo ônibus vai chegar

a qualquer momento entre 10:00 e 10:30h.

a) Qual a probabilidade que o estudante tenha de esperar menos do que 10 minutos.

b) Se até às 10:15 h o ônibus não tiver chegado, qual a probabilidade de chegar

nos próximos dez minutos ?

7.21 Respostas selecionadas

1.

a)

Y

1

2

3

4

5

6

X

1

1/36

1/36

1/36

1/36

1/36

1/36

2

0

2/36

1/36

1/36

1/36

1/36

3

0

0

3/36

1/36

1/36

1/36

4

0

0

0

4/36

1/36

1/36

5

0

0

0

0

5/36

1/36

6

0

0

0

0

0

6/36

2.

a) 0,055

29

ANEXO I

A7.1 O Paradoxo de Bertrand

Uma corda é escolhida ao acaso em um círculo. Qual a probabilidade de que o seu comprimento

exceda o lado do triângulo equilátero inscrito no círculo ?

Solução 1 – Devido à simetria podemos escolher qualquer direção para a corda. Determinando um

diâmetro perpendicular a esta corda, é óbvio que somente as cordas que interceptarem este

diâmetro entre um quarto e três quartos do seu comprimento excedem o lado do triângulo

equilátero. Portanto, a probabilidade seria igual a 1/2.

Solução 2 – Novamente recorrendo à simetria podemos fixar uma das extremidades da corda. A

tangente ao círculo neste ponto, juntamente com os lados do triângulo equilátero inscrito no

o

círculo, tendo por um dos vértices, justamente, o ponto de tangência, formam três ângulos de 60

cada. Ora, somente as cordas que estão contidas no ângulo do meio excederão em comprimento

ao lado do triângulo. Donde, a probabilidade igual a 1/3 !

int_estatistica_aula7

Solução 3 - A corda está especificada, desde que o seu ponto médio esteja. Considerando um

novo círculo concêntrico com o primeiro, com a metade do raio, sabe-se que toda corda, cujo ponto

médio pertença a este círculo, terá comprimento maior que o lado do triângulo equilátero. Levando

a um novo resultado: ½ !

A dificuldade em compreender os diferentes resultados reside na percep;’ao de que se tratam de

experimentos diferentes. Na primeira e segunda soluções identificou-se a casualidade da posição

da corda com a casualidade de seu comprimento, embora sejam aspectos totalmente diferentes.

Já na terceira solução trata-se de um problema completamente diferente – determinar a

probabilidade de um ponto, escolhido arbitrariamente em um círculo, pertencer a um círculo menor.

A7.2 O Problema da agulha de Buffon

Um plano é particionado por retas paralelas, a intervalos regulares iguais a 2a. Uma agulha de

comprimento 2l (l<a) é jogada casualmente sobre o plano. Qual é a probabilidade de que a agulha

intercepte uma das retas ?

Solução – Sejam x a distância do centro da agulha à reta mais próxima e ϕ o ângulo formado pela

agulha com a reta. Estas duas medidas determinam a posição da agulha. Os intervalos de

variação são respectivamente [0,a] e [0,π]. A condição necessária e suficiente para a agulha

interceptar a reta é que x l senϕ.

A probabilidade (geométrica) é então dada pela razão entre as áreas do evento sobre a área do

espaço amostral

π

∫ l sin ϕ dϕ

P=

0

aπ

=

2l

aπ

Apesar do enunciado ingênuo, o problema envolve a determinação do comprimento de bombas em

problemas de bombardeio.

30

A7.3

Distribuição acumulada da Normal padrão ( função phi)

z

-5,0000

-4,9000

-4,8000

-4,7000

-4,6000

-4,5000

-4,4000

-4,3000

-4,2000

-4,1000

-4,0000

-3,9000

-3,8000

-3,7000

-3,6000

-3,5000

-3,4000

-3,3000

-3,2000

-3,1000

-3,0000

-2,9000

-2,8000

-2,7000

-2,6000

-2,5000

-2,4000

-2,3000

-2,2000

-2,1000

-2,0000

-1,9000

-1,8000

-1,7000

-1,6000

-1,5000

-1,4000

-1,3000

-1,2000

-1,1000

-1,0000

-0,9000

-0,8000

-0,7000

-0,6000

-0,5000

-0,4000

-0,3000

-0,2000

-0,1000

0,0000

F(z)

2,87E-07

4,8E-07

7,94E-07

1,3E-06

2,11E-06

3,4E-06

5,42E-06

8,55E-06

1,34E-05

2,07E-05

3,17E-05

4,81E-05

7,24E-05

0,000108

0,000159

0,000233

0,000337

0,000483

0,000687

0,000968

0,00135

0,001866

0,002555

0,003467

0,004661

0,00621

0,008198

0,010724

0,013903

0,017864

0,02275

0,028716

0,03593

0,044565

0,054799

0,066807

0,080757

0,096801

0,11507

0,135666

0,158655

0,18406

0,211855

0,241964

0,274253

0,308538

0,344578

0,382089

0,42074

0,460172

0,5

z

0,0000

0,1000

0,2000

0,3000

0,4000

0,5000

0,6000

0,7000

0,8000

0,9000

1,0000

1,1000

1,2000

1,3000

1,4000

1,5000

1,6000

1,7000

1,8000

1,9000

2,0000

2,1000

2,2000

2,3000

2,4000

2,5000

2,6000

2,7000

2,8000

2,9000

3,0000

3,1000

3,2000

3,3000

3,4000

3,5000

3,6000

3,7000

3,8000

3,9000

4,0000

4,1000

4,2000

4,3000

4,4000

4,5000

4,6000

4,7000

4,8000

4,9000

5,0000

F(z)

0,5

0,539828

0,57926

0,617911

0,655422

0,691462

0,725747

0,758036

0,788145

0,81594

0,841345

0,864334

0,88493

0,903199

0,919243

0,933193

0,945201

0,955435

0,96407

0,971284

0,97725

0,982136

0,986097

0,989276

0,991802

0,99379

0,995339

0,996533

0,997445

0,998134

0,99865

0,999032

0,999313

0,999517

0,999663

0,999767

0,999841

0,999892

0,999928

0,999952

0,999968

0,999979

0,999987

0,999991

0,999995

0,999997

0,999998

0,999999

0,999999

1

1

int_estatistica_aula7

31

Download